Filter keamanan yang dapat dikonfigurasi

Skor keyakinan dan keparahan atribut keamanan

Konten yang diproses melalui PaLM API Vertex AI dinilai berdasarkan daftar atribut keamanan, yang mencakup "kategori berbahaya" dan topik yang dapat dianggap sensitif.

Setiap atribut keamanan memiliki skor keyakinan terkait antara 0,0 dan 1,0, yang dibulatkan ke satu angka desimal, yang mencerminkan kemungkinan input atau respons termasuk dalam kategori tertentu.

Empat dari atribut keamanan ini (pelecehan, ujaran kebencian, konten berbahaya, dan seksual vulgar), diberi rating keamanan (tingkat keparahan) dan skor keparahan yang berkisar antara 0,0 hingga 1,0, yang dibulatkan ke satu angka desimal. Rating dan skor ini mencerminkan prediksi tingkat keparahan konten yang termasuk dalam kategori tertentu.

Contoh respons

{

"predictions": [

{

"safetyAttributes": {

"categories": [

"Derogatory",

"Toxic",

"Violent",

"Sexual",

"Insult",

"Profanity",

"Death, Harm & Tragedy",

"Firearms & Weapons",

"Public Safety",

"Health",

"Religion & Belief",

"Illicit Drugs",

"War & Conflict",

"Politics",

"Finance",

"Legal"

],

"scores": [

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1

],

"safetyRatings": [

{"category": "Hate Speech", "severity": "NEGLIGIBLE", "severityScore": 0.0,"probabilityScore": 0.1},

{"category": "Dangerous Content", "severity": "LOW", "severityScore": 0.3, "probabilityScore": 0.1},

{"category": "Harassment", "severity": "MEDIUM", "severityScore": 0.6, "probabilityScore": 0.1},

{"category": "Sexually Explicit", "severity": "HIGH", "severityScore": 0.9, "probabilityScore": 0.1}

],

"blocked": false

},

"content": "<>"

}

]

}

Catatan: Kategori dengan skor yang dibulatkan ke 0,0 akan dihilangkan dalam respons. Contoh respons ini hanya untuk ilustrasi.

Contoh respons saat diblokir

{

"predictions": [

{

"safetyAttributes": {

"blocked": true,

"errors": [

150,

152,

250

]

},

"content": ""

}

]

}

Deskripsi atribut keamanan

| Atribut Keamanan | Deskripsi |

|---|---|

| Penghinaan | Komentar negatif atau berbahaya yang menargetkan atribut identitas dan/atau dilindungi. |

| Toksik | Konten yang kasar, tidak sopan, atau tidak senonoh. |

| Seksual | Berisi referensi ke tindakan seksual atau konten cabul lainnya. |

| Kekerasan | Menjelaskan skenario yang menggambarkan kekerasan terhadap individu atau kelompok, atau deskripsi umum tentang adegan menyeramkan. |

| Penghinaan | Komentar yang menghina, menghasut, atau negatif terhadap seseorang atau sekelompok orang. |

| Kata-kata tidak sopan | Bahasa cabul atau vulgar seperti kata-kata umpatan. |

| Kematian, Bahaya & Tragedi | Kematian manusia, tragedi, kecelakaan, bencana, dan tindakan menyakiti diri sendiri. |

| Senjata Api & Senjata | Konten yang menyebutkan pisau, pistol, senjata pribadi, dan aksesori seperti amunisi, sarung pistol, dll. |

| Keselamatan Umum | Layanan dan organisasi yang memberikan bantuan sosial dan memastikan keamanan publik. |

| Kesehatan | Kesehatan manusia, termasuk: Kondisi kesehatan, penyakit, dan gangguan; terapi medis, pengobatan, vaksinasi, dan praktik medis; referensi untuk penyembuhan, termasuk kelompok pendukung. |

| Agama & Kepercayaan | Sistem kepercayaan yang melibatkan kemungkinan adanya hukum dan makhluk supranatural; agama, iman, keyakinan, praktik spiritual, gereja, dan tempat ibadah. Termasuk astrologi dan okultisme. |

| Illicit Drugs | Obat-obatan rekreasional dan terlarang; alat konsumsi dan budi daya narkoba, toko tembakau, dan lainnya. Termasuk penggunaan obat-obatan sebagai obat yang biasanya digunakan untuk tujuan rekreasi (misalnya, ganja). |

| Perang & Konflik | Perang, konflik militer, dan konflik fisik besar yang melibatkan banyak orang. Mencakup diskusi tentang dinas militer, meskipun tidak terkait langsung dengan perang atau konflik. |

| Keuangan | Layanan keuangan konsumen dan bisnis, seperti perbankan, pinjaman, kredit, investasi, asuransi, dan lainnya. |

| Politik | Berita dan media politik; diskusi tentang kebijakan sosial, pemerintahan, dan publik. |

| Hukum | Konten terkait hukum, termasuk: firma hukum, informasi hukum, materi hukum primer, layanan paralegal, publikasi dan teknologi hukum, saksi ahli, konsultan proses pengadilan, dan penyedia layanan hukum lainnya. |

Atribut keamanan dengan rating keamanan

| Atribut Keamanan | Definisi | Tingkat |

|---|---|---|

| Ujaran Kebencian | Komentar negatif atau berbahaya yang menargetkan atribut identitas dan/atau dilindungi. | Tinggi, Sedang, Rendah, Tidak Berpengaruh |

| Pelecehan | Komentar yang jahat, mengintimidasi, menindas, atau melecehkan yang menarget individu lain. | Tinggi, Sedang, Rendah, Tidak Berpengaruh |

| Seksual Vulgar | Berisi referensi ke tindakan seksual atau konten cabul lainnya. | Tinggi, Sedang, Rendah, Tidak Berpengaruh |

| Konten Berbahaya | Mempromosikan atau memungkinkan akses ke barang, layanan, dan aktivitas berbahaya. | Tinggi, Sedang, Rendah, Tidak Berpengaruh |

Nilai minimum keamanan

Nilai minimum keamanan diterapkan untuk atribut keamanan berikut:

- Ujaran Kebencian

- Pelecehan

- Seksual Vulgar

- Konten Berbahaya

Google memblokir respons model yang melebihi skor keparahan yang ditentukan untuk atribut keamanan ini. Untuk meminta kemampuan mengubah nilai minimum keamanan, hubungi tim akun Google Cloud Anda.

Menguji nilai minimum keyakinan dan keparahan

Anda dapat menguji filter keamanan Google dan menentukan nilai minimum keyakinan yang tepat untuk bisnis Anda. Dengan menggunakan nilai minimum ini, Anda dapat mengambil tindakan yang komprehensif untuk mendeteksi konten yang melanggar kebijakan penggunaan atau persyaratan layanan Google dan mengambil tindakan yang sesuai.

Skor keyakinan hanyalah prediksi, dan Anda tidak boleh bergantung pada skor tersebut dalam hal keandalan atau akurasi. Google tidak bertanggung jawab untuk menafsirkan atau menggunakan skor ini untuk keputusan bisnis.

Penting: Probabilitas dan Tingkat Keparahan

Dengan pengecualian empat atribut keamanan dengan rating keamanan, skor keyakinan filter keamanan PaLM API didasarkan pada kemungkinan konten tidak aman, bukan tingkat keparahannya. Hal ini penting untuk dipertimbangkan karena beberapa konten memiliki kemungkinan rendah untuk dianggap tidak aman, meskipun tingkat keparahan bahayanya masih tinggi. Misalnya, membandingkan kalimat:

- Robot itu memukul saya.

- Robot itu menebas saya.

Kalimat 1 dapat menyebabkan kemungkinan konten tidak aman yang lebih tinggi, tetapi Anda dapat menganggap kalimat 2 sebagai tingkat keparahan yang lebih tinggi dalam hal kekerasan.

Oleh karena itu, penting bagi pelanggan untuk menguji dengan cermat dan mempertimbangkan tingkat pemblokiran yang sesuai yang diperlukan untuk mendukung kasus penggunaan utama mereka sekaligus meminimalkan bahaya bagi pengguna akhir.

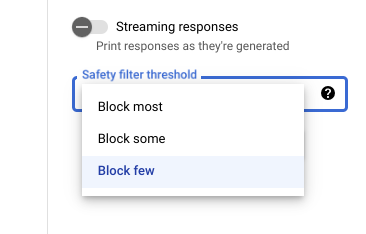

Setelan keamanan di Vertex AI Studio

Dengan nilai minimum filter keamanan yang dapat disesuaikan, Anda dapat menyesuaikan seberapa besar kemungkinan Anda

melihat respons yang dapat berbahaya. Respons model diblokir berdasarkan

probabilitas bahwa konten tersebut berisi pelecehan, ujaran kebencian, konten berbahaya, atau

konten seksual vulgar. Setelan filter keamanan terletak di sisi

kanan kolom perintah di Vertex AI Studio. Anda dapat memilih dari

tiga opsi: block most, block some, dan

block few.

Filter kutipan

Fitur kode generatif kami dimaksudkan untuk memproduksi konten asli dan tidak mereplikasi konten yang sudah ada sepenuhnya. Kami telah mendesain agar sistem kami membatasi kemungkinan terjadinya hal ini, dan terus meningkatkan cara kerja sistem ini. Jika fitur ini mengutip dari suatu halaman web sepenuhnya secara langsung, maka fitur ini akan mengutip halaman tersebut.

Terkadang konten yang sama dapat ditemukan di beberapa halaman web dan kami akan mencoba mengarahkan Anda ke sumber yang populer. Dalam hal kutipan repositori kode, kutipan juga dapat merujuk ke lisensi open source yang berlaku. Mematuhi setiap persyaratan lisensi adalah tanggung jawab Anda.

Untuk mempelajari metadata filter kutipan, lihat Referensi Citation API.

Error keamanan

Kode error keamanan adalah kode tiga digit yang mewakili alasan perintah atau respons diblokir. Digit pertama adalah awalan yang

menunjukkan apakah kode berlaku untuk perintah atau respons, dan

digit lainnya mengidentifikasi alasan perintah atau respons diblokir.

Misalnya, kode error 251 menunjukkan bahwa respons diblokir

karena masalah dengan konten ujaran kebencian dalam respons dari model.

Beberapa kode error dapat ditampilkan dalam satu respons.

Jika Anda mengalami error yang memblokir konten dalam respons dari model

(awalan = 2, misalnya 250),

sesuaikan setelan temperature dalam permintaan Anda. Hal ini membantu menghasilkan

kumpulan respons yang berbeda dengan peluang lebih kecil untuk diblokir.

Awalan kode error

Awalan kode error adalah digit pertama kode error.

| 1 | Kode error berlaku untuk perintah yang dikirim ke model. |

| 2 | Kode error berlaku untuk respons dari model. |

Alasan kode error

Alasan kode error adalah digit kedua dan ketiga dari kode error.

Alasan kode error yang dimulai dengan 3 atau 4 menunjukkan perintah atau respons

yang diblokir karena nilai minimum keyakinan untuk pelanggaran atribut keamanan

terpenuhi.

Alasan kode error yang dimulai dengan 5 menunjukkan perintah atau respons tempat

konten tidak aman ditemukan.

| 10 | Respons diblokir karena masalah kualitas atau setelan parameter yang memengaruhi metadata kutipan. Hal ini hanya berlaku untuk

respons dari model. Artinya, Pemeriksa kutipan mengidentifikasi masalah kualitas atau masalah yang berasal dari

setelan parameter. Coba tingkatkan parameter Untuk mengetahui informasi selengkapnya, lihat Filter kutipan. |

| 20 | Bahasa yang diberikan atau ditampilkan tidak didukung. Untuk mengetahui daftar bahasa yang didukung, lihat Dukungan bahasa. |

| 30 | Perintah atau respons diblokir karena ditemukan berpotensi berbahaya. Istilah disertakan dari daftar yang tidak diizinkan terminologi. Susun ulang perintah Anda. |

| 31 | Konten tersebut mungkin berisi Informasi Identitas Pribadi yang Sensitif (SPII). Susun ulang kata-kata pada perintah Anda. |

| 40 | Perintah atau respons diblokir karena ditemukan berpotensi berbahaya. Konten tersebut melanggar setelan SafeSearch. Susun ulang kata-kata pada perintah Anda. |

| 50 | Perintah atau respons diblokir karena mungkin berisi konten seksual vulgar. Susun ulang kata-kata pada perintah Anda. |

| 51 | Perintah atau respons diblokir karena mungkin berisi konten ujaran kebencian. Susun ulang kata-kata pada perintah Anda. |

| 52 | Perintah atau respons diblokir karena mungkin berisi konten pelecehan. Susun ulang kata-kata pada perintah Anda. |

| 53 | Perintah atau respons diblokir karena mungkin berisi konten berbahaya. Susun ulang kata-kata pada perintah Anda. |

| 54 | Perintah atau respons diblokir karena mungkin berisi konten negatif. Susun ulang kata-kata pada perintah Anda. |

| 00 | Alasan tidak diketahui. Susun ulang kata-kata pada perintah Anda. |

Langkah selanjutnya

- Pelajari responsible AI lebih lanjut.

- Pelajari tata kelola data.