Filtri di sicurezza configurabili

Punteggio di attendibilità e gravità dell'attributo di sicurezza

I contenuti elaborati tramite l'API PaLM di Vertex AI vengono valutati in base a un elenco di attributi di sicurezza, tra cui "categorie dannose" e argomenti che possono essere considerati sensibili.

A ogni attributo di sicurezza viene assegnato un punteggio di affidabilità tra 0.0 e 1.0, arrotondato a un decimale, che riflette la probabilità che l'input o la risposta appartengano a una determinata categoria.

A quattro di questi attributi di sicurezza (molestie, incitamento all'odio, contenuti pericolosi e contenuti sessualmente espliciti) viene assegnata una valutazione di sicurezza (livello di gravità) e un punteggio di gravità compreso tra 0, 0 e 1,0, arrotondato a una cifra decimale. Queste classificazioni e questi punteggi riflettono la gravità prevista dei contenuti appartenenti a una determinata categoria.

Risposta di esempio

{

"predictions": [

{

"safetyAttributes": {

"categories": [

"Derogatory",

"Toxic",

"Violent",

"Sexual",

"Insult",

"Profanity",

"Death, Harm & Tragedy",

"Firearms & Weapons",

"Public Safety",

"Health",

"Religion & Belief",

"Illicit Drugs",

"War & Conflict",

"Politics",

"Finance",

"Legal"

],

"scores": [

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1,

0.1

],

"safetyRatings": [

{"category": "Hate Speech", "severity": "NEGLIGIBLE", "severityScore": 0.0,"probabilityScore": 0.1},

{"category": "Dangerous Content", "severity": "LOW", "severityScore": 0.3, "probabilityScore": 0.1},

{"category": "Harassment", "severity": "MEDIUM", "severityScore": 0.6, "probabilityScore": 0.1},

{"category": "Sexually Explicit", "severity": "HIGH", "severityScore": 0.9, "probabilityScore": 0.1}

],

"blocked": false

},

"content": "<>"

}

]

}

Nota:le categorie con un punteggio arrotondato a 0,0 vengono omesse nella risposta. Questa risposta di esempio è solo a scopo illustrativo.

Risposta di esempio in caso di blocco

{

"predictions": [

{

"safetyAttributes": {

"blocked": true,

"errors": [

150,

152,

250

]

},

"content": ""

}

]

}

Descrizioni degli attributi di sicurezza

| Attributo sicurezza | Descrizione |

|---|---|

| Contenuti dispregiativi | Commenti negativi o dannosi rivolti all'identità e/o agli attributi protetti. |

| Contenuti tossici | Contenuti maleducati, irrispettosi o volgari. |

| Contenuti di natura sessuale | Contiene riferimenti ad atti sessuali o ad altri contenuti osceni. |

| Contenuti violenti | Descrive scenari che raffigurano violenza contro un individuo o un gruppo oppure descrizioni generali di scene di sangue. |

| Insulti | Commento offensivo, provocatorio o negativo verso una persona o un gruppo di persone. |

| Linguaggio volgare | Linguaggio osceno o volgare, come parolacce. |

| Morte, danni e tragedie | Morti umane, tragedie, incidenti, disastri e autolesionismo. |

| Armi e armi da fuoco | Contenuti che menzionano coltelli, pistole, armi per uso personale e accessori come munizioni, fondine e così via. |

| Sicurezza pubblica | Servizi e organizzazioni che forniscono assistenza e garantiscono la sicurezza pubblica. |

| Salute | Salute umana, inclusi: condizioni di salute, malattie e disturbi; terapie mediche, farmaci, vaccinazioni e pratiche mediche; risorse per la guarigione, inclusi i gruppi di supporto. |

| Credo e religione | Sistemi di credenze che trattano la possibilità di leggi e esseri soprannaturali; religione, fede, credenze, pratiche spirituali, chiese e luoghi di culto. Sono incluse l'astrologia e l'occulto. |

| Sostanze stupefacenti illegali | Sostanze stupefacenti legali e illegali; accessori correlati alle sostanze stupefacenti e coltivazione, headshop e altro ancora. Sono inclusi l'uso medicinale di droghe in genere utilizzate per uso ricreativo (ad esempio la marijuana). |

| Guerre e conflitti | Guerre, conflitti militari e gravi conflitti fisici che coinvolgono un gran numero di persone. Sono incluse le discussioni sui servizi militari, anche se non direttamente correlati a una guerra o a un conflitto. |

| Finanza | Servizi finanziari per consumatori e aziende, come servizi bancari, prestiti, credito, investimenti, assicurazioni e altro ancora. |

| Politica | Notizie e media politici; discussioni su politica sociale, governativa e pubblica. |

| Legale | Contenuti relativi alla legge, inclusi: studi legali, informazioni legali, materiale legale di base, servizi legali, pubblicazioni e tecnologia legali, testimoni esperti, consulenti per le cause legali e altri fornitori di servizi legali. |

Attributi di sicurezza con valutazioni di sicurezza

| Attributo sicurezza | Definizione | Livelli |

|---|---|---|

| Incitamento all'odio | Commenti negativi o dannosi rivolti all'identità e/o agli attributi protetti. | Alta, Media, Bassa, Negligible |

| Molestie | Commenti dannosi, intimidatori, prepotenti o illeciti rivolti a un altro individuo. | Alta, Media, Bassa, Negligible |

| Contenuti sessualmente espliciti | Contiene riferimenti ad atti sessuali o ad altri contenuti osceni. | Alta, Media, Bassa, Negligible |

| Contenuti pericolosi | Promuove o consente l'accesso a beni, servizi e attività dannosi. | Alta, Media, Bassa, Negligible |

Soglie di sicurezza

Sono state applicate soglie di sicurezza per i seguenti attributi di sicurezza:

- Incitamento all'odio

- Molestie

- Contenuti sessualmente espliciti

- Contenuti pericolosi

Google blocca le risposte del modello che superano i punteggi di gravità designati per questi attributi di sicurezza. Per richiedere la possibilità di modificare una soglia di sicurezza, contatta il Google Cloud team dedicato al tuo account.

Testare le soglie di confidenza e gravità

Puoi testare i filtri di sicurezza di Google e definire soglie di affidabilità adatte per la tua attività. Utilizzando queste soglie, puoi adottare misure complete per rilevare i contenuti che violano le norme di utilizzo o i Termini di servizio di Google e adottare le misure del caso.

I punteggi di confidenza sono solo previsioni e non devi fare affidamento su questi punteggi per affidabilità o accuratezza. Google non è responsabile dell'interpretazione o dell'utilizzo di questi punteggi per le decisioni aziendali.

Importante: probabilità e gravità

Ad eccezione dei quattro attributi di sicurezza con valutazioni di sicurezza, i punteggi di confidenza dei filtri di sicurezza dell'API PaLM si basano sulla probabilità che i contenuti non siano sicuri e non sulla gravità. Questo è importante da considerare perché alcuni contenuti possono avere una bassa probabilità di essere non sicuri, anche se la gravità del danno potrebbe essere comunque alta. Ad esempio, confrontando le seguenti frasi:

- Il robot mi ha dato un pugno.

- Il robot mi ha tagliato.

La frase 1 potrebbe avere una probabilità più elevata di non essere sicura, ma potresti considerare la frase 2 di maggiore gravità in termini di violenza.

Pertanto, è importante che i clienti testino attentamente e valutino il livello di blocco appropriato per supportare i loro casi d'uso principali, minimizzando al contempo i danni agli utenti finali.

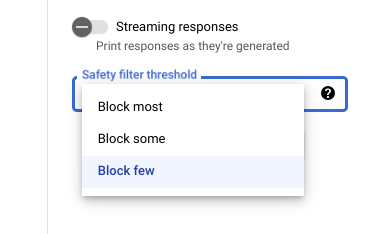

Impostazioni di sicurezza in Vertex AI Studio

Con la soglia del filtro di sicurezza regolabile, puoi regolare la probabilità di vedere risposte potenzialmente dannose. Le risposte del modello vengono bloccate in base alla probabilità che includano molestie, incitamento all'odio, contenuti pericolosi o sessualmente espliciti. L'impostazione del filtro di sicurezza si trova sul lato

destro del campo del prompt in Vertex AI Studio. Puoi scegliere tra tre opzioni: block most, block some e block few.

Filtro citazioni

Le nostre funzionalità di codice generativo mirano a produrre contenuti originali e a non replicare per esteso i contenuti esistenti. Abbiamo progettato i nostri sistemi in modo da limitare le probabilità che ciò accada e continuiamo a migliorarne il funzionamento. Una pagina web eventualmente riprodotta per esteso verrà citata da queste funzionalità.

A volte gli stessi contenuti possono essere presenti su più pagine web e proviamo a indirizzarti a una fonte molto conosciuta. Nel caso di citazioni di repository di codice, la citazione potrebbe anche fare riferimento a una licenza open source applicabile. Il rispetto di eventuali requisiti di licenza è una tua responsabilità.

Per informazioni sui metadati del filtro delle citazioni, consulta la documentazione di riferimento dell'API Citation.

Errori di sicurezza

I codici di errore di sicurezza sono codici a tre cifre che rappresentano il motivo per cui una richiesta o una risposta è stata bloccata. La prima cifra è un prefisso che indica se il codice si applica al prompt o alla risposta e le cifre rimanenti identificano il motivo per cui il prompt o la risposta è stato bloccato.

Ad esempio, un codice di errore 251 indica che la risposta è stata bloccata

a causa di un problema con contenuti di incitamento all'odio nella risposta del modello.

In una singola risposta possono essere restituiti più codici di errore.

Se riscontri errori che bloccano i contenuti nella risposta del modello

(prefisso = 2, ad esempio 250),

modifica l'impostazione temperature nella richiesta. In questo modo, puoi generare un insieme diverso di risposte con meno probabilità di essere bloccato.

Prefisso del codice di errore

Il prefisso del codice di errore è la prima cifra del codice di errore.

| 1 | Il codice di errore si applica al prompt inviato al modello. |

| 2 | Il codice di errore si applica alla risposta del modello. |

Motivo del codice di errore

Il motivo del codice di errore è costituito dalla seconda e dalla terza cifra del codice di errore.

I motivi dei codici di errore che iniziano con 3 o 4 indicano prompt o risposte bloccati perché è stata raggiunta la soglia di attendibilità per una violazione dell'attributo di sicurezza.

I motivi dei codici di errore che iniziano con 5 indicano prompt o risposte in cui sono stati trovati contenuti non sicuri.

| 10 | La risposta è stata bloccata a causa di un problema di qualità o di un'impostazione del parametro che influisce sui metadati della citazione. Questo vale solo per

le risposte del modello. ovvero Lo strumento di controllo delle citazioni identifica problemi di qualità o derivanti da un'impostazione del parametro. Prova ad aumentare i parametri Per ulteriori informazioni, consulta la sezione Filtro citazioni. |

| 20 | La lingua fornita o restituita non è supportata. Per un elenco delle lingue supportate, consulta Supporto linguistico. |

| 30 | Il prompt o la risposta è stato bloccato perché è risultato essere potenzialmente dannoso. Un termine è incluso nella lista bloccata della terminologia. Riformula il prompt. |

| 31 | I contenuti potrebbero includere informazioni sensibili che consentono l'identificazione personale (SPII). Riformula il prompt. |

| 40 | Il prompt o la risposta è stata bloccata perché è stata ritenuta potenzialmente dannosa. I contenuti violano le impostazioni di SafeSearch. Riformula il prompt. |

| 50 | Il prompt o la risposta è stato bloccato perché potrebbe contenere contenuti sessualmente espliciti. Riformula il prompt. |

| 51 | Il prompt o la risposta è stato bloccato perché potrebbe contenere contenuti di incitamento all'odio. Riformula il prompt. |

| 52 | Il prompt o la risposta è stato bloccato perché potrebbe contenere contenuti di molestie. Riformula il prompt. |

| 53 | Il prompt o la risposta è stato bloccato perché potrebbe contenere contenuti pericolosi. Riformula il prompt. |

| 54 | Il prompt o la risposta è stato bloccato perché potrebbe contenere contenuti dannosi. Riformula il prompt. |

| 00 | Motivo sconosciuto. Riformula il prompt. |

Passaggi successivi

- Scopri di più sull'IA responsabile.

- Scopri di più sulla governance dei dati.