데이터 세트에는 출발어와 도착어의 대응하는 문장 쌍으로 번역할 콘텐츠 유형의 대표 샘플이 들어 있습니다. 데이터세트는 모델 학습을 위한 입력으로 사용됩니다.

데이터세트 구축을 위한 주요 단계는 다음과 같습니다.

- 데이터세트를 만들고 출발어와 도착어를 지정합니다.

- 문장 쌍을 데이트세트로 가져옵니다.

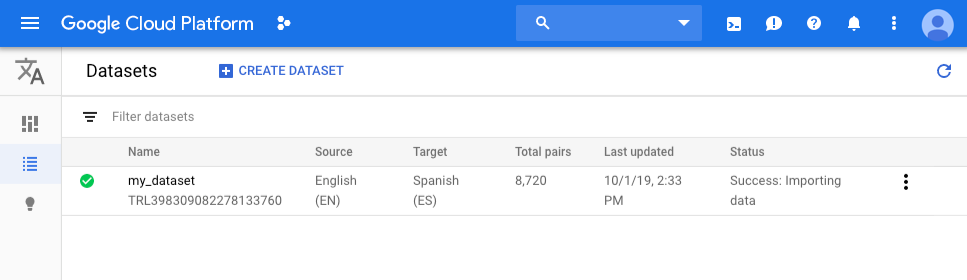

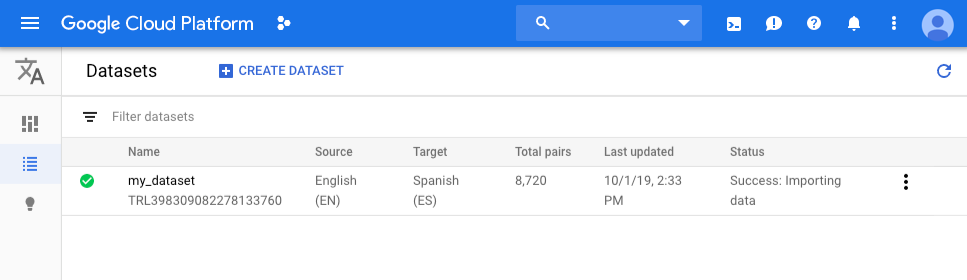

프로젝트에는 서로 다른 모델의 학습에 사용하는 여러 개의 데이터 세트가 있을 수 있습니다. 사용 가능한 데이터 세트 목록을 가져와 더 이상 필요 없는 데이터 세트를 삭제할 수 있습니다.

데이터 세트 만들기

커스텀 모델을 생성하는 첫 단계는 모델 학습용 데이터를 저장할 비어 있는 데이터세트를 만드는 것입니다. 데이터 세트를 만들 때 모델의 출발어와 도착어를 지정합니다. 지원되는 언어 및 변형에 대한 자세한 내용은 커스텀 모델에 대한 언어 지원을 참조하세요.

웹 UI

AutoML Translation UI를 사용하면 새 데이터세트를 만들고 같은 페이지에서 항목을 해당 데이터세트에 가져올 수 있습니다.

AutoML Translation UI로 이동합니다.

제목 표시줄 오른쪽 위의 드롭다운 목록에서 AutoML Translation을 사용 설정한 프로젝트를 선택합니다.

데이터 세트 페이지에서 데이터 세트 만들기를 클릭합니다.

데이터 세트 만들기 대화상자에서 다음을 수행합니다.

- 데이터 세트의 이름을 입력합니다.

드롭다운 목록에서 출발어와 도착어를 선택합니다. 출발어를 선택하면 사용 가능한 도착어가 표시됩니다.

만들기를 클릭합니다. 가져오기 탭이 열립니다.

REST

데이터 세트 생성 요청 보내기

다음은 project.locations.datasets/create 메서드에 POST 요청을 보내는 방법을 보여줍니다.

이 예시에서는 Google Cloud CLI를 사용하는 프로젝트의 서비스 계정을 설정하기 위해 액세스 토큰을 사용합니다.

요청 데이터를 사용하기 전에 다음을 바꿉니다.

- project-id: Google Cloud Platform 프로젝트 ID

- dataset-name: 새 데이터 세트 이름

- source-language-code: 'en'과 같은 ISO 639-1 코드로 번역할 언어

- target-language-code: 'es'와 같은 ISO 639-1 코드로 번역할 언어

HTTP 메서드 및 URL:

POST https://automl.googleapis.com/v1/projects/project-id/locations/us-central1/datasets

JSON 요청 본문:

{

"displayName": "dataset-name",

"translationDatasetMetadata": {

"sourceLanguageCode": "source-language-code",

"targetLanguageCode": "target-language-code"

}

}

요청을 보내려면 다음 옵션 중 하나를 펼칩니다.

다음과 비슷한 JSON 응답이 표시됩니다.

{

"name": "projects/project-number/locations/us-central1/operations/operation-id",

"metadata": {

"@type": "type.googleapis.com/google.cloud.automl.v1.OperationMetadata",

"createTime": "2019-10-01T22:13:48.155710Z",

"updateTime": "2019-10-01T22:13:48.155710Z",

"createDatasetDetails": {}

}

}

결과 가져오기

요청 결과를 가져오려면 operations 리소스에 GET 요청을 보내야 합니다. 아래에 이러한 요청을 보내는 방법이 나와 있습니다.

요청 데이터를 사용하기 전에 다음을 바꿉니다.

- operation-name: API에 대한 원래 호출의 응답으로 반환되는 작업의 이름

- project-id: Google Cloud Platform 프로젝트 ID

HTTP 메서드 및 URL:

GET https://automl.googleapis.com/v1/operation-name

요청을 보내려면 다음 옵션 중 하나를 펼칩니다.

다음과 비슷한 JSON 응답이 표시됩니다.

{

"metadata": {

"@type": "type.googleapis.com/google.cloud.automl.v1.OperationMetadata",

"createTime": "2019-10-01T22:13:48.155710Z",

"updateTime": "2019-10-01T22:13:52.321072Z",

...

},

"done": true,

"response": {

"@type": "resource-type",

"name": "resource-name"

}

}

Go

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Go API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

Java

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Java API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

Node.js

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Node.js API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

Python

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Python API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

추가 언어

C#: 클라이언트 라이브러리 페이지의 C# 설정 안내를 따른 다음 .NET용 AutoML Translation 참고 문서를 참조하세요.

PHP: 클라이언트 라이브러리 페이지의 PHP 설정 안내를 따른 다음 PHP용 AutoML Translation 참고 문서를 참조하세요.

Ruby: 클라이언트 라이브러리 페이지의 Ruby 설정 안내를 따른 다음 Ruby용 AutoML Translation 참고 문서를 참조하세요.

데이터 세트로 항목 가져오기

데이터세트를 만들었으면 이제 학습 문장 쌍을 가져올 수 있습니다. 학습 데이터 준비에 대한 자세한 내용은 학습 데이터 준비를 참조하세요.

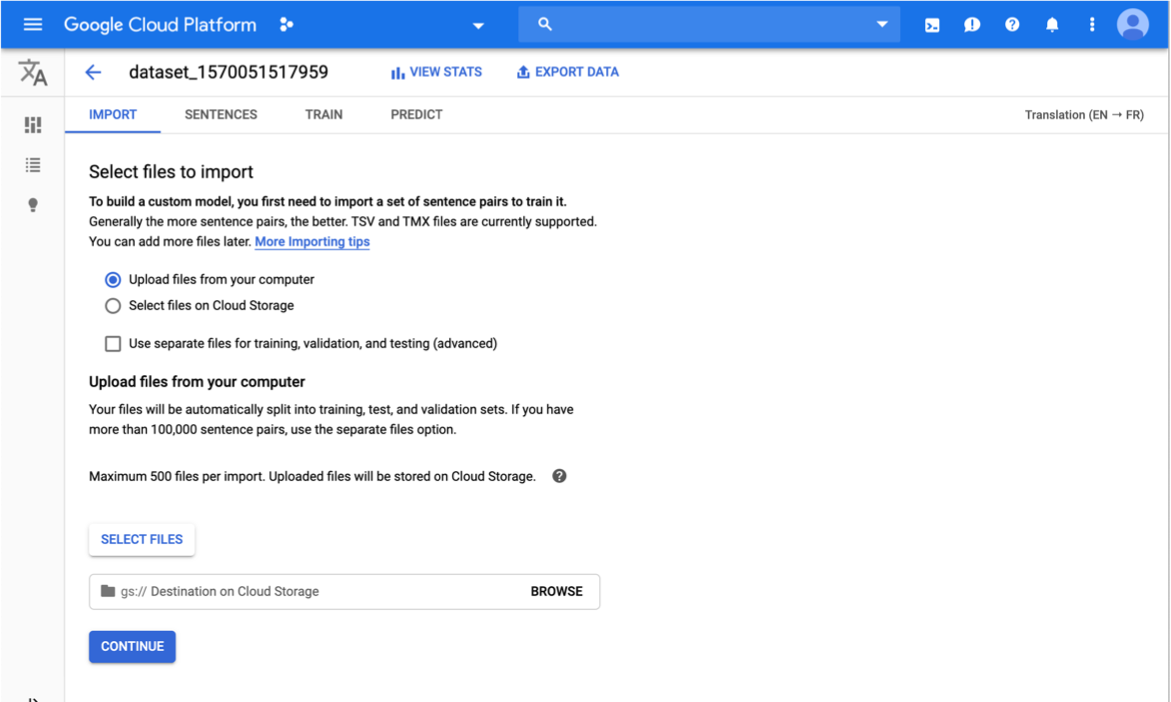

웹 UI

AutoML Translation UI를 사용하면 새 데이터 세트를 만들고 같은 페이지에서 항목을 해당 데이터 세트에 가져올 수 있습니다. 데이터 세트 만들기를 참조하세요. 기존 데이터 세트로 항목을 가져오려면 다음 단계를 따르세요.

데이터 세트 폴더를 만든 후 데이터를 업로드합니다.모델 학습에 사용할 문장 쌍을 업로드합니다.

가져오기 탭에서 로컬 컴퓨터 또는 Cloud Storage에서 TSV 또는 TMX 파일을 업로드할 수 있습니다. 로컬에서 가져온 파일의 경우 파일을 선택한 후 찾아보기를 클릭합니다. 폴더 목록이 표시됩니다. 파일을 업로드할 폴더를 선택합니다. Cloud Storage에서 호스팅되는 이 디렉터리는 데이터 보존을 보장하는 데 필요합니다.

문장 쌍이 포함된 여러 개별 파일을 업로드하려면 학습, 유효성 검사, 테스트에 별도의 파일 사용(Advanced) 체크박스를 선택합니다. 데이터 세트에 100,000개가 넘는 문장 쌍이 있는 경우 이 옵션을 사용하는 것이 좋습니다. 유효성 검사 및 테스트 세트에 10,000개 이하의 문장 쌍을 할당해야 합니다. 그렇지 않으면 AutoML Translation이 오류를 반환합니다.

계속을 클릭합니다.

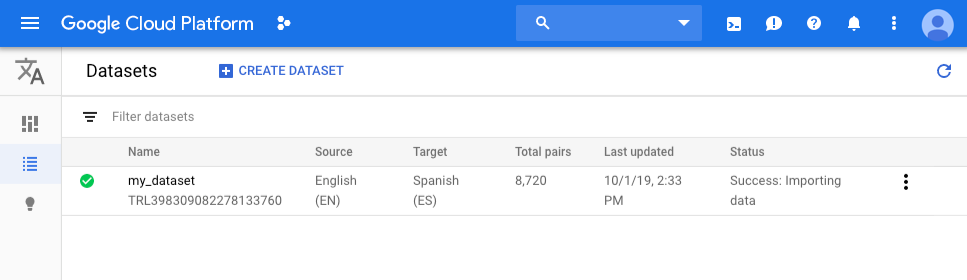

데이터 세트 페이지로 돌아갑니다. 문서를 가져오는 동안 데이터 세트에 진행률 애니메이션이 표시됩니다. 데이터 세트가 정상적으로 업로드되면 프로그램에 가입할 때 사용한 이메일 주소로 메시지가 발송됩니다.

데이터 세트를 검토합니다.

데이터를 정상적으로 가져왔으면 데이터 세트 탭에서 데이터 세트를 선택하여 데이터 세트의 세부정보를 확인합니다. 문장 탭이 사용 설정되고 데이터 세트의 이름이 표시됩니다. 문장 쌍이 나열됩니다. 각 쌍에는 '학습', '유효성 검사' 또는 '테스트'가 할당되며, 각 단계는 해당 쌍이 사용되는 처리 단계를 나타냅니다.

REST

projects.locations.datasets.importData

메서드를 사용하여 데이터 세트로 항목을 가져올 수 있습니다.

요청 데이터를 사용하기 전에 다음을 바꿉니다.

- dataset-name: 데이터 세트를 만들 때 API에서 반환한 데이터 세트의 이름

- bucket-name: 데이터 세트를 설명하는 입력 CSV가 포함된 Cloud Storage 버킷

- csv-file-name: 데이터 세트를 설명하는 입력 CSV 파일의 이름

- project-id: Google Cloud Platform 프로젝트 ID

HTTP 메서드 및 URL:

POST https://automl.googleapis.com/v1/dataset-name:importData

JSON 요청 본문:

{

"inputConfig": {

"gcsSource": {

"inputUris": "gs://bucket-name/csv-file-name"

}

}

}

요청을 보내려면 다음 옵션 중 하나를 펼칩니다.

다음과 비슷한 JSON 응답이 표시됩니다.

{

"name": "projects/project-number/locations/us-central1/operations/operation-id",

"metadata": {

"@type": "type.googleapis.com/google.cloud.automl.v1beta1.OperationMetadata",

"createTime": "2018-04-27T01:28:36.128120Z",

"updateTime": "2018-04-27T01:28:36.128150Z",

"cancellable": true

}

}

Go

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Go API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

Java

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Java API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

Node.js

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Node.js API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

Python

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Python API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

추가 언어

C#: 클라이언트 라이브러리 페이지의 C# 설정 안내를 따른 다음 .NET용 AutoML Translation 참고 문서를 참조하세요.

PHP: 클라이언트 라이브러리 페이지의 PHP 설정 안내를 따른 다음 PHP용 AutoML Translation 참고 문서를 참조하세요.

Ruby: 클라이언트 라이브러리 페이지의 Ruby 설정 안내를 따른 다음 Ruby용 AutoML Translation 참고 문서를 참조하세요.

데이터 세트를 만들고 값을 채웠으면 모델을 학습할 수 있습니다. 모델 만들기 및 관리를 참조하세요.

데이터 세트 관리

데이터 세트 나열

프로젝트에는 수많은 데이터 세트가 포함될 수 있습니다. 이 섹션에서는 프로젝트에 사용할 수 있는 데이터세트의 목록을 검색하는 방법에 대해 설명합니다.

웹 UI

AutoML Translation UI에서 사용할 수 있는 데이터 세트 목록을 확인하려면 왼쪽 탐색 메뉴 맨 위에 있는 데이터 세트 링크를 클릭합니다.

다른 프로젝트의 데이터 세트를 보려면 제목 표시줄 오른쪽 위에 있는 드롭다운 목록에서 프로젝트를 선택하세요.

REST

요청 데이터를 사용하기 전에 다음을 바꿉니다.

- project-id: Google Cloud Platform 프로젝트 ID

HTTP 메서드 및 URL:

GET https://automl.googleapis.com/v1/projects/project-id/locations/us-central1/datasets

요청을 보내려면 다음 옵션 중 하나를 펼칩니다.

다음과 비슷한 JSON 응답이 표시됩니다.

{

"datasets": [

{

"name": "projects/project-number/locations/us-central1/datasets/dataset-id",

"displayName": "dataset-display-name",

"createTime": "2019-10-01T22:47:38.347689Z",

"etag": "AB3BwFpPWn6klFqJ867nz98aXr_JHcfYFQBMYTf7rcO-JMi8Ez4iDSNrRW4Vv501i488",

"translationDatasetMetadata": {

"sourceLanguageCode": "source-language",

"targetLanguageCode": "target-language"

}

},

...

]

}

Go

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Go API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

Java

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Java API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

Node.js

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Node.js API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

Python

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Python API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

추가 언어

C#: 클라이언트 라이브러리 페이지의 C# 설정 안내를 따른 다음 .NET용 AutoML Translation 참고 문서를 참조하세요.

PHP: 클라이언트 라이브러리 페이지의 PHP 설정 안내를 따른 다음 PHP용 AutoML Translation 참고 문서를 참조하세요.

Ruby: 클라이언트 라이브러리 페이지의 Ruby 설정 안내를 따른 다음 Ruby용 AutoML Translation 참고 문서를 참조하세요.

데이터 세트 삭제

웹 UI

AutoML Translation UI의 왼쪽 탐색 메뉴 맨 위에 있는 데이터 세트 링크를 클릭하여 사용 가능한 데이터 세트 목록을 표시합니다.

삭제하려는 행의 맨 오른쪽에 있는 점 3개로 된 메뉴를 클릭하고 삭제를 선택합니다.

확인 대화상자에서 확인을 클릭합니다.

REST

- 데이터 세트를 만들 때 응답에서 dataset-name을 데이터 세트의 전체 이름으로 바꿉니다. 전체 이름은

projects/{project-id}/locations/us-central1/datasets/{dataset-id}형식입니다.

요청 데이터를 사용하기 전에 다음을 바꿉니다.

- dataset-name: 삭제할 데이터 세트의 이름(

project/project-id/locations/us-central1/datasets/dataset-id형식)

HTTP 메서드 및 URL:

DELETE https://automl.googleapis.com/v1/dataset-name

요청을 보내려면 다음 옵션 중 하나를 펼칩니다.

다음과 비슷한 JSON 응답이 표시됩니다.

{

"name": "projects/project-number/locations/us-central1/operations/operation-id",

"metadata": {

"@type": "type.googleapis.com/google.cloud.automl.v1.OperationMetadata",

"createTime": "2019-10-02T16:43:03.923442Z",

"updateTime": "2019-10-02T16:43:03.923442Z",

"deleteDetails": {}

},

"done": true,

"response": {

"@type": "type.googleapis.com/google.protobuf.Empty"

}

}

Go

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Go API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

Java

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Java API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

Node.js

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Node.js API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

Python

AutoML Translation용 클라이언트 라이브러리를 설치하고 사용하는 방법은 AutoML Translation 클라이언트 라이브러리를 참조하세요. 자세한 내용은 AutoML Translation Python API 참조 문서를 확인하세요.

AutoML Translation에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 로컬 개발 환경의 인증 설정을 참조하세요.

추가 언어

C#: 클라이언트 라이브러리 페이지의 C# 설정 안내를 따른 다음 .NET용 AutoML Translation 참고 문서를 참조하세요.

PHP: 클라이언트 라이브러리 페이지의 PHP 설정 안내를 따른 다음 PHP용 AutoML Translation 참고 문서를 참조하세요.

Ruby: 클라이언트 라이브러리 페이지의 Ruby 설정 안내를 따른 다음 Ruby용 AutoML Translation 참고 문서를 참조하세요.

가져오기 문제

데이터 세트를 만들 때 문장 쌍이 너무 길거나 출발어와 도착어에서 쌍이 정확하게 동일한 경우 AutoML Translation에서 문장 쌍이 삭제될 수 있습니다.

문장 쌍이 너무 긴 경우 문장을 약 200단어 이하로 분할한 다음 분할된 쌍을 포함하도록 데이터 세트를 다시 만드는 것이 좋습니다. 데이터를 처리하는 동안 AutoML Translation은 내부 프로세스를 사용하여 입력 데이터를 토큰화하므로 문장의 크기를 늘릴 수 있습니다. 이 토큰화된 데이터는 AutoML Translation이 데이터 크기를 측정하는 데 사용하는 데이터입니다. 따라서 200단어 제한은 최대 길이의 추정치입니다.

출발어와 도착어가 동일한 문장 쌍의 경우 데이터 세트에서 삭제할 수 있습니다. 이러한 문장을 번역하지 않으려면 용어집 리소스를 사용하여 AutoML Translation이 특정 용어를 처리하는 방식을 정의하는 커스텀 사전을 빌드하세요.