Un ensemble de données contient des échantillons représentatifs du type de contenus que vous souhaitez traduire, sous la forme de paires de phrases correspondantes dans les langues source et cible. Il sert d'entrée pour l'entraînement d'un modèle.

Voici les principales étapes à suivre pour créer un ensemble de données :

- Créez un ensemble de données, puis identifiez les langues source et cible.

- Importez des paires de phrases dans l'ensemble de données.

Un projet peut avoir plusieurs ensembles de données, chacun servant à entraîner un modèle distinct. Vous pouvez obtenir la liste des ensembles de données disponibles et supprimer les ensembles de données dont vous n'avez plus besoin.

Créer un ensemble de données

La première étape de l'élaboration d'un modèle personnalisé consiste à créer un ensemble de données vide, qui contiendra à terme les données d'entraînement du modèle. Lorsque vous créez un ensemble de données, vous identifiez les langues source et cible du modèle. Pour plus d'informations sur les langues et les variantes disponibles, consultez la page Langues acceptées pour les modèles personnalisés.

UI Web

L'interface utilisateur d'AutoML Translation vous permet de créer un ensemble de données, puis d'y importer des éléments à partir de la même page.

Accédez à l'interface utilisateur d'AutoML Translation.

Dans la liste déroulante située dans la partie supérieure droite de la barre de titre, sélectionnez le projet pour lequel vous avez activé AutoML Translation.

Dans l'onglet Datasets (Ensembles de données), cliquez sur Create Dataset (Créer un ensemble de données).

Dans la boîte de dialogue Créer un ensemble de données, procédez comme suit :

- Saisissez le nom de l'ensemble de données.

Sélectionnez les langues source et cible dans les listes déroulantes. Lorsque vous sélectionnez une langue source, les langues cibles disponibles s'affichent.

Cliquez sur Créer. L'onglet Importer s'ouvre.

REST

Envoyer la requête de création de l'ensemble de données

Vous trouverez ci-dessous la procédure à suivre pour envoyer une requête POST à la méthode project.locations.datasets/create.

Cet exemple fait intervenir le jeton d'accès associé à un compte de service configuré pour le projet à l'aide de Google Cloud CLI.

Avant d'utiliser les données de requête ci-dessous, effectuez les remplacements suivants :

- project-id : ID de votre projet Google Cloud Platform

- dataset-name : nom de votre nouvel ensemble de données

- source-language-code : langue source, sous la forme d'un code ISO 639-1 tel que "en"

- target-language-code : langue cible sous la forme d'un code ISO 639-1 tel que "es"

Méthode HTTP et URL :

POST https://automl.googleapis.com/v1/projects/project-id/locations/us-central1/datasets

Corps JSON de la requête :

{

"displayName": "dataset-name",

"translationDatasetMetadata": {

"sourceLanguageCode": "source-language-code",

"targetLanguageCode": "target-language-code"

}

}

Pour envoyer votre requête, développez l'une des options suivantes :

Vous devriez recevoir une réponse JSON de ce type :

{

"name": "projects/project-number/locations/us-central1/operations/operation-id",

"metadata": {

"@type": "type.googleapis.com/google.cloud.automl.v1.OperationMetadata",

"createTime": "2019-10-01T22:13:48.155710Z",

"updateTime": "2019-10-01T22:13:48.155710Z",

"createDatasetDetails": {}

}

}

Obtenir les résultats

Pour obtenir les résultats de votre requête, vous devez envoyer une requête GET à la ressource operations. Vous trouverez ci-dessous la procédure à suivre pour envoyer une telle requête.

Avant d'utiliser les données de requête ci-dessous, effectuez les remplacements suivants :

- operation-name : nom de l'opération renvoyé dans la réponse à l'appel d'origine à l'API

- project-id : ID de votre projet Google Cloud Platform

Méthode HTTP et URL :

GET https://automl.googleapis.com/v1/operation-name

Pour envoyer votre requête, développez l'une des options suivantes :

Vous devriez recevoir une réponse JSON de ce type :

{

"metadata": {

"@type": "type.googleapis.com/google.cloud.automl.v1.OperationMetadata",

"createTime": "2019-10-01T22:13:48.155710Z",

"updateTime": "2019-10-01T22:13:52.321072Z",

...

},

"done": true,

"response": {

"@type": "resource-type",

"name": "resource-name"

}

}

Go

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Go.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Java

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Java.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Node.js

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Node.js.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Python

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Python.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Langages supplémentaires

C# : Veuillez suivre les instructions de configuration de C# sur la page des bibliothèques clientes, puis consultez la documentation de référence sur AutoML Translation pour .NET.

PHP : Veuillez suivre les instructions de configuration de PHP sur la page des bibliothèques clientes, puis consultez la documentation de référence sur AutoML Translation pour PHP.

Ruby : Veuillez suivre les instructions de configuration de Ruby sur la page des bibliothèques clientes, puis consultez la documentation de référence sur AutoML Translation pour Ruby.

Importer des éléments dans un ensemble de données

Une fois que vous avez créé un ensemble de données, vous pouvez y importer des paires de phrases d'entraînement. Pour en savoir plus sur la préparation des données d'entraînement, consultez la page Préparer des données d'entraînement.

UI Web

L'UI d'AutoML Translation vous permet de créer un ensemble de données, puis d'y importer des éléments à partir de la même page. Pour en savoir plus, consultez la section Créer un ensemble de données. Les étapes présentées ci-dessous permettent d'importer des éléments dans un ensemble de données existant.

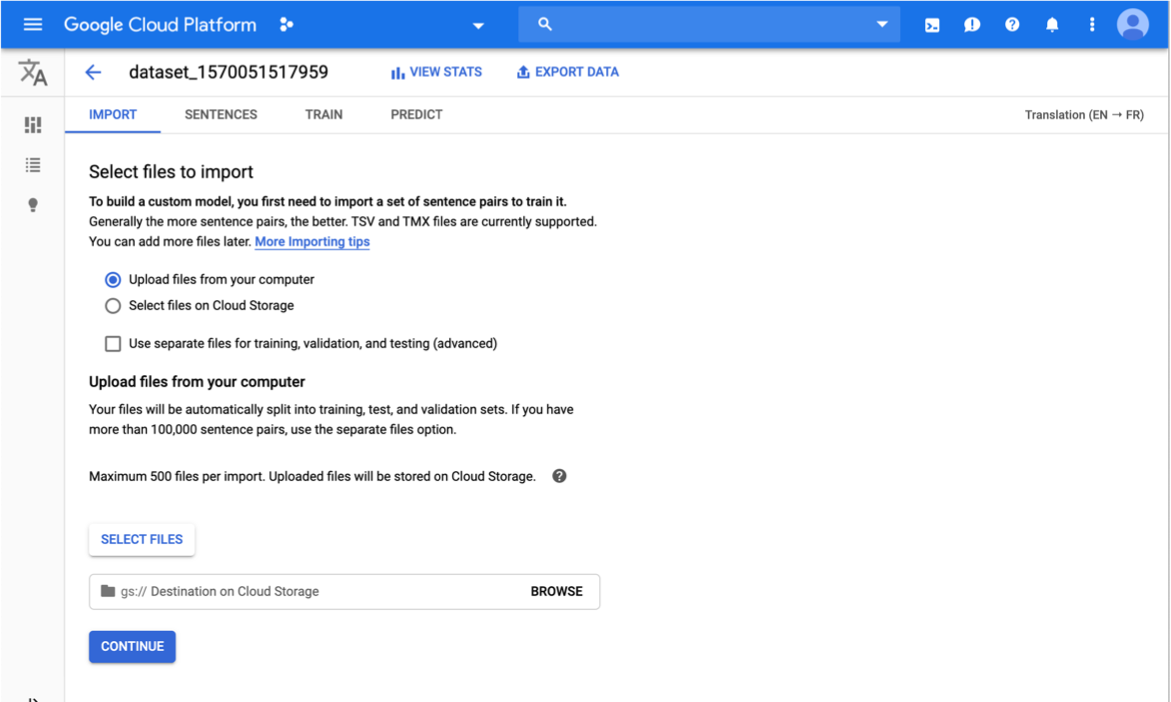

Vous créez le dossier de l'ensemble de données, puis vous importez vos données.Importez les paires de phrases à utiliser pour entraîner le modèle.

Dans l'onglet Import (Importer), vous pouvez importer des fichiers TSV ou TMX depuis votre ordinateur local ou depuis Cloud Storage. Pour les fichiers importés localement, sélectionnez votre fichier, puis cliquez sur Browse (Parcourir). La liste des dossiers s'affiche. Sélectionnez le dossier dans lequel vous souhaitez importer votre fichier. Ce répertoire hébergé sur Cloud Storage est nécessaire pour garantir la résidence des données.

Si vous souhaitez importer des fichiers distincts contenant les paires de phrases, cochez la case Use separate files for training, validation, and testing (advanced) (Utiliser des fichiers distincts pour l'entraînement, la validation et les tests). Cette option est recommandée si l'ensemble de données contient plus de 100 000 paires de phrases. Vous devez allouer 10 000 paires de phrases au maximum pour les ensembles de validation et de test. Dans le cas contraire, AutoML Translation renvoie une erreur.

Cliquez sur Continuer.

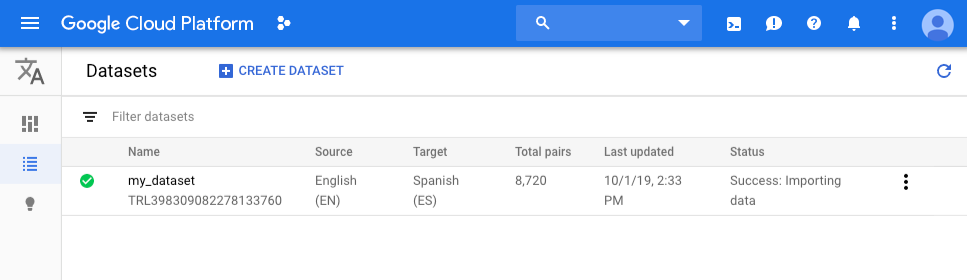

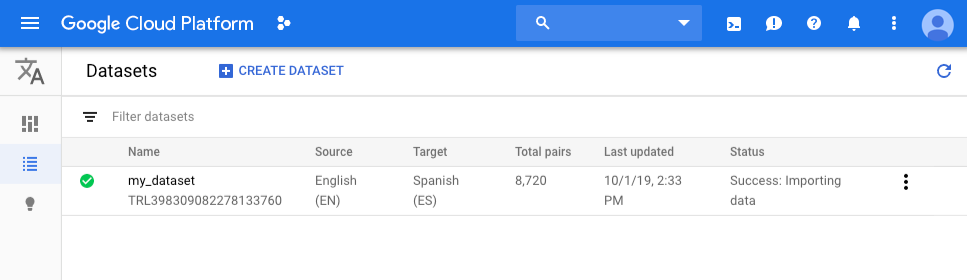

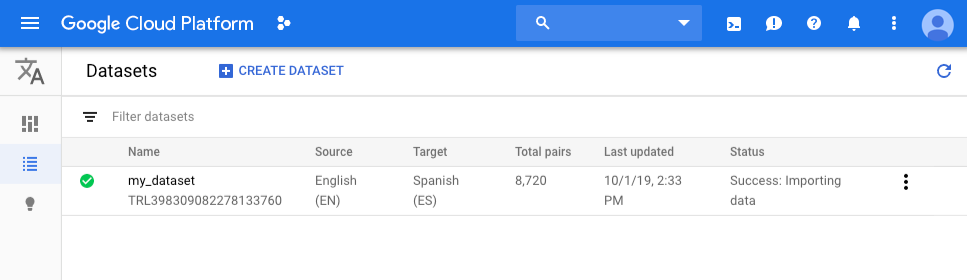

Vous êtes redirigé vers la page Ensembles de données. Pendant l'importation de vos documents, l'ensemble de données affiche une animation indiquant que l'opération est en cours. Une fois l'ensemble de données importé, vous recevez un message à l'adresse e-mail que vous avez utilisée pour vous inscrire au programme.

Examinez l'ensemble de données.

Une fois vos données importées, sélectionnez l'ensemble de données dans l'onglet Ensembles de données pour afficher les informations détaillées le concernant. L'onglet Phrase est activé. Il affiche le nom de l'ensemble de données. Les paires de phrases sont répertoriées. Chaque paire est associée à l'une des étapes suivantes : "entraînement", "validation" ou "test", ce qui indique à quelle étape de traitement elle sera utilisée.

REST

Utilisez la méthode projects.locations.datasets.importData pour importer des éléments dans un ensemble de données.

Avant d'utiliser les données de requête ci-dessous, effectuez les remplacements suivants :

- dataset-name : nom de votre ensemble de données, tel qu'il est renvoyé par l'API lors de sa création

- bucket-name : bucket Cloud Storage contenant le fichier CSV d'entrée qui décrit votre ensemble de données

- csv-file-name : nom du fichier CSV d'entrée qui décrit votre ensemble de données.

- project-id : ID de votre projet Google Cloud Platform

Méthode HTTP et URL :

POST https://automl.googleapis.com/v1/dataset-name:importData

Corps JSON de la requête :

{

"inputConfig": {

"gcsSource": {

"inputUris": "gs://bucket-name/csv-file-name"

}

}

}

Pour envoyer votre requête, développez l'une des options suivantes :

Vous devriez recevoir une réponse JSON de ce type :

{

"name": "projects/project-number/locations/us-central1/operations/operation-id",

"metadata": {

"@type": "type.googleapis.com/google.cloud.automl.v1beta1.OperationMetadata",

"createTime": "2018-04-27T01:28:36.128120Z",

"updateTime": "2018-04-27T01:28:36.128150Z",

"cancellable": true

}

}

Go

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Go.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Java

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Java.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Node.js

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Node.js.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Python

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Python.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Langages supplémentaires

C# : Veuillez suivre les instructions de configuration de C# sur la page des bibliothèques clientes, puis consultez la documentation de référence sur AutoML Translation pour .NET.

PHP : Veuillez suivre les instructions de configuration de PHP sur la page des bibliothèques clientes, puis consultez la documentation de référence sur AutoML Translation pour PHP.

Ruby : Veuillez suivre les instructions de configuration de Ruby sur la page des bibliothèques clientes, puis consultez la documentation de référence sur AutoML Translation pour Ruby.

Une fois que vous avez créé et rempli l'ensemble de données, vous pouvez entraîner le modèle. Pour en savoir plus, consultez la page Créer et gérer des modèles.

Gérer les ensembles de données

Répertorier les ensembles de données

Un projet peut inclure de nombreux ensembles de données. Cette section explique comment récupérer la liste des ensembles de données disponibles pour un projet.

UI Web

Pour afficher la liste des ensembles de données disponibles à l'aide de l'UI d'AutoML Translation, cliquez sur le lien Datasets (Ensembles de données) en haut du menu de navigation de gauche.

Pour afficher les ensembles de données d'un autre projet, sélectionnez le projet dans la liste déroulante située dans la partie supérieure droite de la barre de titre.

REST

Avant d'utiliser les données de requête ci-dessous, effectuez les remplacements suivants :

- project-id : ID de votre projet Google Cloud Platform

Méthode HTTP et URL :

GET https://automl.googleapis.com/v1/projects/project-id/locations/us-central1/datasets

Pour envoyer votre requête, développez l'une des options suivantes :

Vous devriez recevoir une réponse JSON de ce type :

{

"datasets": [

{

"name": "projects/project-number/locations/us-central1/datasets/dataset-id",

"displayName": "dataset-display-name",

"createTime": "2019-10-01T22:47:38.347689Z",

"etag": "AB3BwFpPWn6klFqJ867nz98aXr_JHcfYFQBMYTf7rcO-JMi8Ez4iDSNrRW4Vv501i488",

"translationDatasetMetadata": {

"sourceLanguageCode": "source-language",

"targetLanguageCode": "target-language"

}

},

...

]

}

Go

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Go.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Java

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Java.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Node.js

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Node.js.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Python

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Python.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Langages supplémentaires

C# : Veuillez suivre les instructions de configuration de C# sur la page des bibliothèques clientes, puis consultez la documentation de référence sur AutoML Translation pour .NET.

PHP : Veuillez suivre les instructions de configuration de PHP sur la page des bibliothèques clientes, puis consultez la documentation de référence sur AutoML Translation pour PHP.

Ruby : Veuillez suivre les instructions de configuration de Ruby sur la page des bibliothèques clientes, puis consultez la documentation de référence sur AutoML Translation pour Ruby.

Supprimer un ensemble de données

Interface utilisateur Web

Dans l'UI d'AutoML Translation, cliquez sur le lien Datasets (Ensembles de données) en haut du menu de navigation de gauche pour afficher la liste des ensembles de données disponibles.

Cliquez sur le menu à trois points à l'extrémité droite de la ligne à supprimer, puis sélectionnez Supprimer.

Cliquez sur Supprimer dans la boîte de dialogue de confirmation.

REST

- Remplacez dataset-name par le nom complet de votre ensemble de données, issu de la réponse obtenue lorsque vous avez créé l'ensemble de données. Le nom complet a le format suivant :

projects/{project-id}/locations/us-central1/datasets/{dataset-id}.

Avant d'utiliser les données de requête ci-dessous, effectuez les remplacements suivants :

- dataset-name : nom de l'ensemble de données que vous souhaitez supprimer, au format

project/project-id/locations/us-central1/datasets/dataset-id

Méthode HTTP et URL :

DELETE https://automl.googleapis.com/v1/dataset-name

Pour envoyer votre requête, développez l'une des options suivantes :

Vous devriez recevoir une réponse JSON de ce type :

{

"name": "projects/project-number/locations/us-central1/operations/operation-id",

"metadata": {

"@type": "type.googleapis.com/google.cloud.automl.v1.OperationMetadata",

"createTime": "2019-10-02T16:43:03.923442Z",

"updateTime": "2019-10-02T16:43:03.923442Z",

"deleteDetails": {}

},

"done": true,

"response": {

"@type": "type.googleapis.com/google.protobuf.Empty"

}

}

Go

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Go.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Java

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Java.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Node.js

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Node.js.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Python

Pour savoir comment installer et utiliser la bibliothèque cliente pour AutoML Translation, consultez la page Bibliothèques clientes AutoML Translation. Pour en savoir plus, consultez la documentation de référence de l'API AutoML Translation en langage Python.

Pour vous authentifier auprès d'AutoML Translation, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Langages supplémentaires

C# : Veuillez suivre les instructions de configuration de C# sur la page des bibliothèques clientes, puis consultez la documentation de référence sur AutoML Translation pour .NET.

PHP : Veuillez suivre les instructions de configuration de PHP sur la page des bibliothèques clientes, puis consultez la documentation de référence sur AutoML Translation pour PHP.

Ruby : Veuillez suivre les instructions de configuration de Ruby sur la page des bibliothèques clientes, puis consultez la documentation de référence sur AutoML Translation pour Ruby.

Problèmes d'importation

Lorsque vous créez un ensemble de données, AutoML Translation est susceptible de supprimer des paires de phrases si elles sont trop longues ou si elles sont identiques dans les langues source et cible.

Pour les paires de phrases trop longues, nous vous recommandons de fractionner les phrases à environ 200 mots ou moins, puis de recréer l'ensemble de données en conséquence. Lors du traitement de vos données, AutoML Translation utilise un processus interne pour segmenter les données d'entrée, ce qui peut augmenter la taille de vos phrases. Ces données tokenisées sont celles utilisées par AutoML Translation pour mesurer la taille des données. Par conséquent, la limite de 200 mots est une estimation de la longueur maximale.

Les paires de phrases identiques dans les langues source et cible peuvent être supprimées de votre ensemble de données. Si vous ne souhaitez pas traduire ces phrases, utilisez une ressource de glossaire pour créer un dictionnaire personnalisé qui définit la manière dont AutoML Translation traite les termes spécifiques.