AI Explanations mengintegrasikan atribusi fitur ke dalam AI Platform Prediction. Halaman ini menyediakan ringkasan konseptual singkat tentang metode atribusi fitur yang tersedia dengan AI Platform Prediction. Untuk diskusi teknis yang mendalam, lihat Laporan Resmi AI Explanations.

Penjelasan AI membantu Anda memahami output model untuk tugas klasifikasi dan regresi. Setiap kali Anda meminta prediksi di AI Platform, Penjelasan AI akan memberi tahu Anda seberapa besar kontribusi setiap fitur dalam data terhadap hasil yang diprediksi. Selanjutnya, Anda dapat menggunakan informasi ini untuk memverifikasi bahwa model berperilaku seperti yang diharapkan, mengenali bias dalam model, dan mendapatkan ide terkait cara meningkatkan kualitas model dan data pelatihan Anda.

Atribusi fitur

Atribusi fitur menunjukkan seberapa besar kontribusi setiap fitur dalam model Anda terhadap prediksi untuk setiap instance tertentu. Saat meminta prediksi, Anda mendapatkan nilai prediksi yang sesuai untuk model Anda. Saat meminta penjelasan, Anda akan mendapatkan prediksi beserta informasi atribusi fitur.

Atribusi fitur dapat digunakan dengan data tabel, dan mencakup kapabilitas visualisasi bawaan untuk data gambar. Perhatikan contoh berikut:

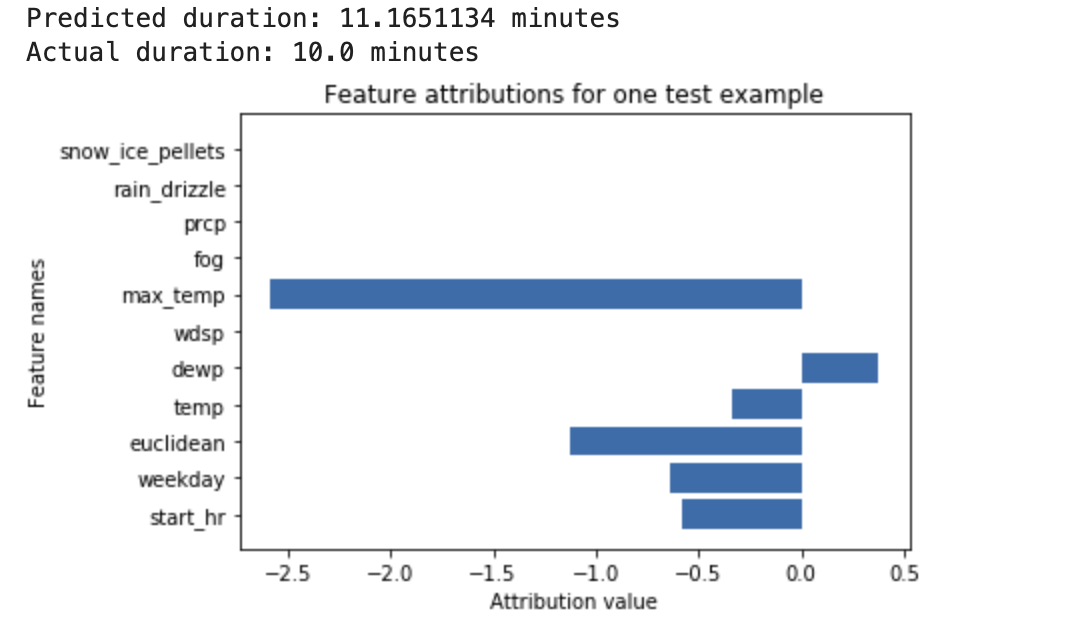

Sebuah jaringan neural dalam dilatih untuk memprediksi durasi bersepeda berdasarkan data cuaca dan data transportasi online sebelumnya. Jika hanya meminta prediksi dari model ini, Anda akan mendapatkan prediksi durasi bersepeda yang berupa jumlah menit. Jika meminta penjelasan, Anda akan mendapatkan prediksi durasi perjalanan sepeda, beserta skor atribusi untuk setiap fitur dalam permintaan penjelasan. Skor atribusi menunjukkan seberapa besar fitur tersebut memengaruhi perubahan nilai prediksi, yang relatif terhadap nilai dasar pengukuran yang Anda tentukan. Pilih baseline yang bermakna yang sesuai untuk model Anda—dalam hal ini, rerata durasi bersepeda. Anda dapat memetakan skor atribusi fitur untuk melihat fitur mana yang paling berkontribusi terhadap prediksi yang dihasilkan:

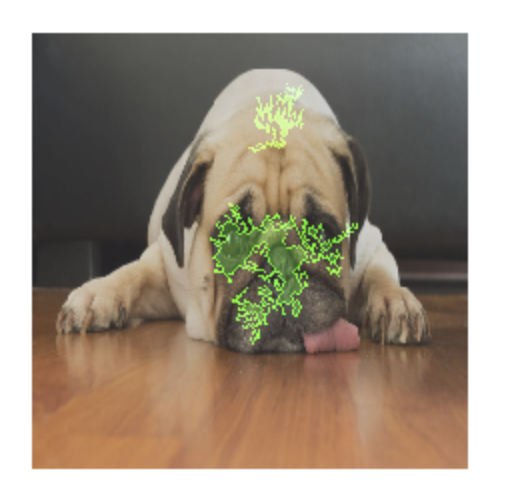

Model klasifikasi gambar dilatih untuk memprediksi apakah gambar tertentu berisi anjing atau kucing. Jika Anda meminta prediksi dari model ini berdasarkan sekumpulan gambar baru, Anda akan menerima prediksi untuk setiap gambar ("dog" atau "cat"). Jika meminta penjelasan, Anda akan mendapatkan prediksi kelas beserta overlay untuk gambar itu, yang menunjukkan piksel mana dalam gambar yang paling berkontribusi terhadap prediksi yang dihasilkan:

Foto kucing dengan overlay atribusi fitur

Foto anjing dengan overlay atribusi fitur Sebuah model klasifikasi gambar dilatih untuk memprediksi spesies bunga dalam gambar. Jika Anda meminta prediksi dari model ini berdasarkan sekumpulan gambar baru, Anda akan menerima prediksi untuk setiap gambar ("daisy" atau "dandelion"). Jika meminta penjelasan, Anda akan mendapatkan prediksi kelas beserta overlay untuk gambar itu, yang menunjukkan area mana dalam gambar yang paling berkontribusi terhadap prediksi yang dihasilkan:

Foto bunga aster dengan overlay atribusi fitur

Kelebihan dan kasus penggunaan

Dengan memeriksa instance tertentu, dan juga menggabungkan atribusi fitur di seluruh set data pelatihan, Anda dapat memperoleh insight lebih dalam tentang cara kerja model. Pertimbangkan kelebihan dan kasus penggunaan berikut:

- Proses debug model: Atribusi fitur dapat membantu mendeteksi masalah dalam data yang biasanya terlewatkan oleh teknik evaluasi model standar. Misalnya, model patologi gambar mencapai hasil bagus (meski mencurigakan) pada set data uji gambar Sinar-X dada. Atribusi fitur mengungkapkan bahwa akurasi tinggi model bergantung pada tanda pena ahli radiologi pada gambar.

- Mengoptimalkan model: Anda dapat mengidentifikasi dan menghapus fitur yang kurang penting, sehingga dapat menghasilkan model yang lebih efisien.

Batasan konseptual

Pertimbangkan batasan atribusi fitur berikut:

- Atribusi bersifat spesifik untuk masing-masing prediksi. Memeriksa atribusi untuk prediksi individual dapat memberikan insight yang baik, meskipun mungkin tidak dapat digeneralisasi ke seluruh class untuk instance individual tersebut, atau ke seluruh model. Untuk mendapatkan insight yang lebih umum, Anda dapat menggabungkan atribusi pada subset pada set data Anda, atau seluruh set data.

- Meskipun dapat membantu proses debug model, atribusi fitur tidak selalu menunjukkan dengan jelas apakah masalah muncul dari model atau dari data yang digunakan untuk melatih model. Gunakan penilaian terbaik Anda, dan diagnosis masalah data umum untuk mempersempit ruang potensi penyebab.

- Atribusi fitur dapat mengalami serangan adversarial yang serupa dengan prediksi dalam model yang kompleks.

Untuk mengetahui informasi selengkapnya tentang batasan, lihat daftar batasan tingkat tinggi dan Laporan Resmi AI Explanations.

Membandingkan metode atribusi fitur

Penjelasan AI menawarkan tiga metode yang dapat digunakan untuk atribusi fitur: sampel Shapley, Integrated Gradients, dan XRAI.

| Metode | Penjelasan dasar | Jenis model yang direkomendasikan | Contoh kasus penggunaan |

|---|---|---|---|

| Integrated Gradients | Metode berbasis gradien untuk mengomputasi atribusi fitur secara efisien dengan properti aksiomatik yang sama dengan nilai Shapley. | Model terdiferensiasi, seperti jaringan neural. Direkomendasikan terutama untuk model dengan ruang fitur yang besar. Direkomendasikan untuk gambar berkontras rendah, seperti sinar-X. |

|

| XRAI (eXplanation with Ranked Area Integrals) | Berdasarkan metode Integrated Gradients, XRAI menilai area gambar yang tumpang-tindih untuk membuat peta saliency, yang menyoroti area gambar yang relevan, bukan piksel. | Model yang menerima input gambar. Direkomendasikan terutama untuk gambar natural, yaitu suasana dunia nyata yang berisi banyak objek. |

|

| Sampled Shapley | Menetapkan kredit hasil ke setiap fitur, dan mempertimbangkan berbagai permutasi fitur. Metode ini memberikan perkiraan sampling dari nilai pasti Shapley. | Model tidak terdiferensiasi, seperti ansambel pohon dan jaringan neural1 |

|

Memahami metode atribusi fitur

Setiap metode atribusi fitur didasarkan pada nilai Shapley—sebuah algoritma teori game kooperatif yang menetapkan kredit kepada setiap pemain dalam game untuk hasil tertentu. Jika diterapkan pada model machine learning, hal ini berarti setiap fitur model diperlakukan sebagai "pemain" dalam game - dan AI Explanations menetapkan kredit yang proporsional ke setiap fitur untuk hasil prediksi tertentu.

Penjelasan AI memungkinkan Anda "memilih" pemain, dengan memilih fitur yang tepat untuk permintaan penjelasan Anda.

Metode Sampled Shapley

Metode Sampled Shapley memberikan perkiraan sampling dari nilai pasti Shapley.

Metode Integrated Gradients

Dalam metode Integrated Gradients, gradien output prediksi dihitung dalam kaitannya dengan fitur input, di sepanjang jalur integral.

- Gradien dihitung pada interval parameter penskalaan yang berbeda. (Untuk data gambar, bayangkan parameter penskalaan ini sebagai "penggeser" yang menskalakan semua piksel gambar menjadi hitam.)

- Gradien "diintegrasikan":

- Gradien dirata-ratakan.

- Hasil per elemen dari rata-rata gradien dan input asli akan dihitung.

Untuk penjelasan intuitif mengenai proses ini dalam penerapannya pada gambar, lihat postingan blog "Attributing a deep network's prediction to its input features". Penulis makalah asli tentang Integrated Gradients (Axiomatic Attribution for Deep Networks) menunjukkan dalam postingan blog sebelumnya seperti apa tampilan gambar di setiap langkah prosesnya.

Metode XRAI

Metode XRAI menggabungkan metode Integrated Gradients dengan beberapa langkah tambahan untuk menentukan area gambar yang paling berkontribusi terhadap prediksi kelas tertentu.

- Atribusi tingkat piksel: XRAI menjalankan atribusi tingkat piksel untuk gambar input. Pada langkah ini, XRAI menggunakan metode Integrated Gradients dengan baseline hitam dan baseline putih.

- Oversegmentasi: Terlepas dari atribusi tingkat piksel, XRAI meng-oversegmentasi gambar untuk membuat tambal sulam area-area kecil. XRAI menggunakan metode berbasis grafik Felzenswalb untuk membuat segmen gambar.

- Pemilihan area: XRAI menggabungkan atribusi tingkat piksel dalam setiap segmen untuk menentukan kepadatan atribusinya. Berdasarkan nilai ini, XRAI memeringkatkan setiap segmen, lalu mengurutkan segmen tersebut dari yang paling positif ke paling tidak positif. Pengurutan ini menentukan area mana pada gambar yang paling salient (kentara), atau paling berkontribusi terhadap prediksi kelas tertentu.

Model terdiferensiasi dan tidak terdiferensiasi

Pada model terdiferensiasi, Anda dapat mengkalkulasi turunan dari semua operasi dalam grafik TensorFlow. Dengan properti ini, propagasi mundur dalam model tersebut dapat dibuat. Misalnya, jaringan neural bersifat terdiferensiasi. Untuk mendapatkan atribusi fitur bagi model terdiferensiasi, gunakan metode Integrated Gradients.

Model tidak terdiferensiasi mencakup operasi yang tidak terdiferensiasi dalam grafik TensorFlow, seperti operasi yang menjalankan tugas decoding dan pembulatan. Misalnya, model yang dibuat sebagai ansambel pohon dan jaringan neural tidak terdiferensiasi. Untuk mendapatkan atribusi fitur bagi model yang tidak terdiferensiasi, gunakan metode Sampled Shapley. Sampled Shapley juga dapat digunakan dengan model terdiferensiasi, tetapi dalam hal ini, secara komputasi metode ini lebih mahal daripada yang diperlukan.

Referensi

Penerapan sampel Shapley, gradien terintegrasi, dan XRAI masing-masing didasarkan pada referensi berikut:

- Bounding the Estimation Error of Sampling-based Shapley Value Approximation

- Axiomatic Attribution for Deep Networks

- XRAI: Better Attributions Through Regions

Pelajari lebih lanjut implementasi AI Explanations dengan membaca Laporan Resmi AI Explanations.

Materi edukasi

Referensi berikut memberikan materi edukasi yang bermanfaat lainnya:

- Interpretable Machine Learning: Shapley values

- Repository GitHub Integrated Gradients Ankur Taly.

- Library SHAP (SHapley Additive exPlanations)

- Introduction to Shapley values