Valutazione dei modelli

Dopo aver addestrato un modello, AutoML Video Intelligence Object Tracking utilizza gli elementi TEST impostato su Valutare la qualità e l'accuratezza del nuovo modello.

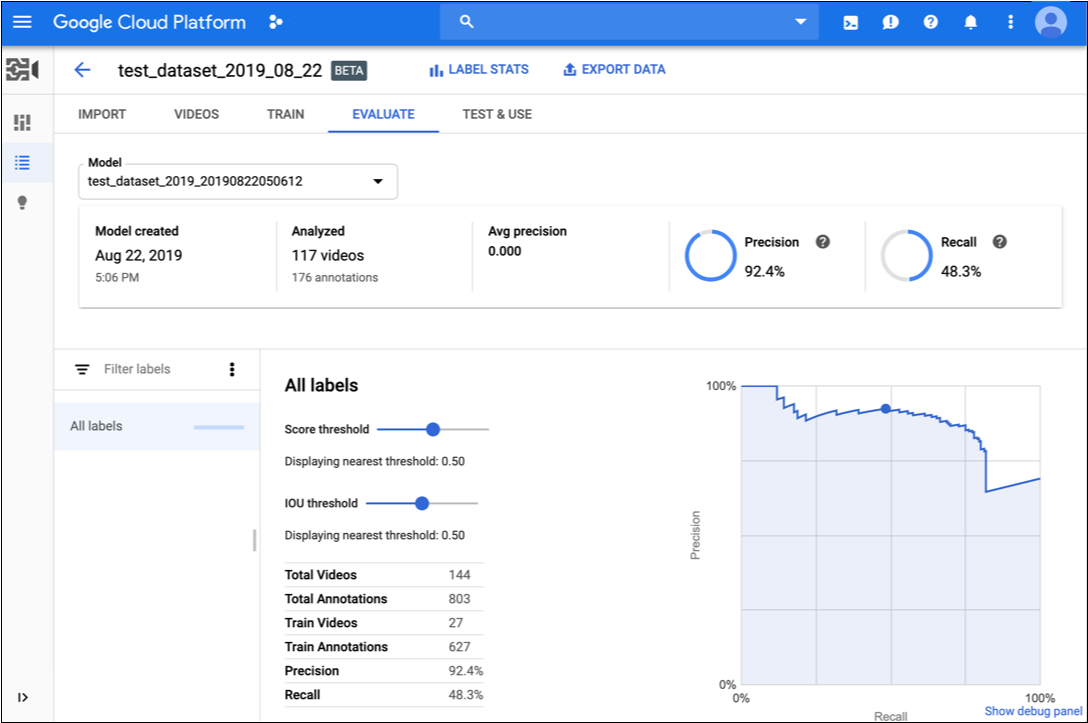

AutoML Video Intelligence Object Tracking fornisce un insieme aggregato di metriche di valutazione che indicano come tutte le prestazioni del modello, oltre che le metriche di valutazione per ogni etichetta di categoria, che indica le prestazioni del modello per quell'etichetta.

IoU : Intersezione su Unione, una metrica utilizzata nel monitoraggio degli oggetti per misurare la sovrapposizione di un intervallo riquadro di delimitazione effettivo per l'istanza di un oggetto in un frame video. Più è vicino i valori previsti del riquadro di delimitazione corrispondono ai valori effettivi del riquadro di delimitazione, maggiori l'intersezione e il valore IoU.

AuPRC : area sotto la curva di precisione/richiamo, chiamata anche "precisione media". Di solito tra 0,5 e 1,0. Valori più alti indicano modelli più accurati.

Le curve di soglia di confidenza mostrano in che modo le diverse soglie di confidenza possono influire sui tassi di precisione, richiamo, veri e falsi positivi. Informazioni la relazione precisione e richiamo.

Usa questi dati per valutare l'idoneità del modello. Punteggi AUC bassi, o punteggi bassi di precisione e richiamo possono indicare che il modello ha bisogno di dati di addestramento o contiene etichette incoerenti. Un punteggio AUC molto alto e perfetto precisione e richiamo possono indicare che i dati sono troppo semplici e potrebbero non essere generalizzati.

Ottieni valori di valutazione del modello

UI web

-

Apri la pagina Modelli nel UI di monitoraggio degli oggetti video AutoML.

-

Fai clic sulla riga relativa al modello da valutare.

-

Fai clic sulla scheda Valuta.

Se l'addestramento del modello è stato completato, mostra le sue metriche di valutazione.

- Per visualizzare le metriche relative a un'etichetta specifica, seleziona il nome dell'etichetta da l'elenco di etichette nella parte inferiore della pagina.

REST

Prima di utilizzare i dati della richiesta, effettua le seguenti sostituzioni:

- model-id: sostituisci con l'identificatore del modello

- project-number: il numero del tuo progetto

- location-id: la regione Cloud in cui deve essere eseguita l'annotazione

posto. Le regioni cloud supportate sono:

us-east1,us-west1,europe-west1,asia-east1. Se nessuna regione è specificata, verrà determinata una regione in base alla posizione del file video.

Metodo HTTP e URL:

GET https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/models/model-id:modelEvaluations

Per inviare la richiesta, scegli una delle seguenti opzioni:

curl

Esegui questo comando:

curl -X GET \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "x-goog-user-project: project-number" \

"https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/models/model-id:modelEvaluations"

PowerShell

Esegui questo comando:

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred"; "x-goog-user-project" = "project-number" }

Invoke-WebRequest `

-Method GET `

-Headers $headers `

-Uri "https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/models/model-id:modelEvaluations" | Select-Object -Expand Content

8703337066443674578.

Java

Per eseguire l'autenticazione ad AutoML Video Object Tracking, configura le credenziali predefinite dell'applicazione. Per ulteriori informazioni, vedi Configura l'autenticazione per un ambiente di sviluppo locale.

Node.js

Per eseguire l'autenticazione ad AutoML Video Object Tracking, configura le credenziali predefinite dell'applicazione. Per ulteriori informazioni, vedi Configura l'autenticazione per un ambiente di sviluppo locale.

Python

Per eseguire l'autenticazione ad AutoML Video Object Tracking, configura le credenziali predefinite dell'applicazione. Per ulteriori informazioni, vedi Configura l'autenticazione per un ambiente di sviluppo locale.

Esegui l'iterazione sul modello

Se i livelli qualitativi non sono soddisfacenti, puoi tornare ai passaggi precedenti per migliorare la qualità:

- Potresti dover aggiungere diversi tipi di video, ad esempio per un angolo più ampio, risoluzione superiore o inferiore, punti di vista diversi.

- Valuta la possibilità di rimuovere completamente le etichette se non hai abbastanza video di addestramento.

- Ricorda che le macchine non possono leggere il nome delle etichette. è solo una stringa casuale di lettere. Se è presente un'etichetta con la dicitura "porta" e un'altra che dice "porta_con_manopola" la macchina non ha modo di comprenderne le sfumature rispetto ai video da te forniti.

- Arricchisci i tuoi dati con un maggior numero di esempi di veri positivi e negativi. Gli esempi particolarmente importanti sono quelli correlati alla decisione confine.

Dopo aver apportato le modifiche, addestra e valuta un nuovo modello fino a raggiungere un livello qualitativo sufficientemente alto.