TPU v3

Este documento descreve a arquitetura e as configurações disponíveis no Cloud TPU v3.

Arquitetura do sistema

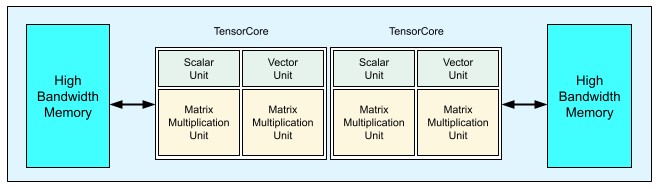

Cada chip da TPU v3 contém dois TensorCores. Cada TensorCore tem duas unidades de multiplicação de matrizes (MXUs), uma vetorial e unidade escalar. A tabela a seguir mostra as principais especificações e os valores de um Pod de TPU v3.

| Principais especificações | Valores do Pod v3 |

|---|---|

| Pico de computação por chip | 123 teraflops (bf16) |

| Capacidade e largura de banda do HBM2 | 32 GiB, 900 GBps |

| Potência mínima/média/máxima medida | 123/220/262 W |

| Tamanho do Pod de TPU | 1.024 chips |

| Topologia de interconexão | Toro 2D |

| Computação máxima por pod | 126 petaflops (bf16) |

| Largura de banda de redução total por pod | 340 TB/s |

| Largura de banda de bissecção por pod | 6,4 TB/s |

O diagrama a seguir ilustra um chip de TPU v3.

Os detalhes de arquitetura e as características de desempenho da TPU v3 estão disponíveis em Um supercomputador específico para domínios voltado ao treinamento de redes neurais profundas.

Benefícios de desempenho da TPU v3 em relação à v2

O aumento de FLOPS por TensorCore e capacidade de memória nas configurações da TPU v3 melhora o desempenho dos modelos no seguinte:

As configurações da TPU v3 fornecem benefícios de desempenho significativos por TensorCore para modelos vinculados à computação. Os modelos vinculados à memória nas configurações da TPU v2 podem não alcançar essa mesma melhoria de desempenho ao serem vinculados à memória nas configurações da TPU v3.

Nos casos em que os dados não cabem na memória nas configurações da TPU v2, a TPU v3 pode melhorar o desempenho e reduzir a necessidade de recalcular valores intermediários (rematerialização).

As configurações da TPU v3 executam novos modelos com tamanhos de lotes que não cabem nas configurações da TPU v2. Por exemplo, a TPU v3 pode permitir modelos do ResNet mais profundos e imagens maiores com RetinaNet.

Os modelos que estão praticamente vinculados à entrada (alimentação) na TPU v2 devido à espera da entrada pelas etapas de treinamento podem estar vinculados à entrada no Cloud TPU v3. O guia de desempenho do pipeline pode ajudar você a resolver problemas de alimentação.

Configurações

Um Pod de TPU v3 é composto por 1.024 chips interconectados com links de alta velocidade. Para

criar um dispositivo ou uma fração de TPU v3, use a flag --accelerator-type

no comando de criação de TPU (gcloud compute tpus tpu-vm). Especifique o tipo de acelerador definindo a

versão da TPU e o número de núcleos de TPU. Por exemplo, para uma única TPU v3, use

--accelerator-type=v3-8. Para uma fração de v3 com 128 TensorCores, use

--accelerator-type=v3-128.

A tabela abaixo lista os tipos de TPU v3 disponíveis:

| Versão da TPU | Fim da disponibilidade |

|---|---|

| v3-8 | (data final ainda não definida) |

| v3-32 | (data final ainda não definida) |

| v3-128 | (data final ainda não definida) |

| v3-256 | (data final ainda não definida) |

| v3-512 | (data final ainda não definida) |

| v3-1024 | (data final ainda não definida) |

| v3-2048 | (data final ainda não definida) |

O comando abaixo mostra como criar uma fração de TPU v3 com 128 TensorCores:

$ gcloud compute tpus tpu-vm create tpu-name \ --zone=europe-west4-a \ --accelerator-type=v3-128 \ --version=tpu-ubuntu2204-base

Para saber como gerenciar TPUs, consulte Gerenciar TPUs. Para mais informações sobre a arquitetura do sistema do Cloud TPU, consulte Arquitetura do sistema.