Chirp es la nueva generación de modelos de voz a texto de Google. La primera versión de Chirp, que representa la culminación de años de investigación, ya está disponible para la transcripción de voz. Tenemos previsto mejorar y ampliar Chirp a más idiomas y ámbitos. Para obtener más información, consulta nuestro documento Google USM.

Hemos entrenado los modelos de Chirp con una arquitectura diferente a la de nuestros modelos de voz actuales. Un único modelo unifica los datos de varios idiomas. Sin embargo, los usuarios siguen especificando el idioma en el que el modelo debe reconocer el habla. Chirp no admite algunas de las funciones de voz de Google que tienen otros modelos. Consulta la lista completa de funciones admitidas y limitaciones.

Identificadores de modelo

Chirp está disponible en la versión 2 de la API Speech-to-Text. Puedes usarlo como cualquier otro modelo.

El identificador de modelo de Chirp es chirp.

Puedes especificar este modelo en solicitudes de reconocimiento síncronas o por lotes.

Métodos de API disponibles

Chirp procesa la voz en fragmentos mucho más grandes que otros modelos. Esto significa que puede que no sea adecuado para un uso en tiempo real. Chirp está disponible a través de los siguientes métodos de API:

v2Speech.Recognize(ideal para audios cortos de menos de 1 minuto)v2Speech.BatchRecognize(adecuado para audios largos de 1 minuto a 8 horas)

Chirp no está disponible en los siguientes métodos de la API:

v2Speech.StreamingRecognizev1Speech.StreamingRecognizev1Speech.Recognizev1Speech.LongRunningRecognizev1p1beta1Speech.StreamingRecognizev1p1beta1Speech.Recognizev1p1beta1Speech.LongRunningRecognize

Regiones

Chirp está disponible en las siguientes regiones:

us-central1europe-west4asia-southeast1

Consulta la página de idiomas para obtener más información.

Idiomas

Puedes consultar los idiomas admitidos en la lista completa de idiomas.

Asistencia y limitaciones de funciones

Chirp no admite algunas de las funciones de la API STT:

- Puntuaciones de confianza: la API devuelve un valor, pero no es una puntuación de confianza real.

- Adaptación de voz: no se admiten funciones de adaptación.

- Diarización: la diarización automática no está disponible.

- Normalización forzada: no se admite.

- Confianza a nivel de palabra: no se admite.

- Detección de idioma: no disponible.

Chirp sí admite las siguientes funciones:

- Puntuación automática: el modelo predice la puntuación. Se puede inhabilitar.

- Tiempos de las palabras: se devuelven de forma opcional.

- Transcripción de audio independiente del idioma: el modelo infiere automáticamente el idioma hablado en tu archivo de audio y lo añade a los resultados.

Antes de empezar

- Sign in to your Google Cloud account. If you're new to Google Cloud, create an account to evaluate how our products perform in real-world scenarios. New customers also get $300 in free credits to run, test, and deploy workloads.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Speech-to-Text APIs.

-

Make sure that you have the following role or roles on the project: Cloud Speech Administrator

Check for the roles

-

In the Google Cloud console, go to the IAM page.

Go to IAM - Select the project.

-

In the Principal column, find all rows that identify you or a group that you're included in. To learn which groups you're included in, contact your administrator.

- For all rows that specify or include you, check the Role column to see whether the list of roles includes the required roles.

Grant the roles

-

In the Google Cloud console, go to the IAM page.

Ir a IAM - Selecciona el proyecto.

- Haz clic en Conceder acceso.

-

En el campo Nuevos principales, introduce tu identificador de usuario. Normalmente, se trata de la dirección de correo de una cuenta de Google.

- En la lista Selecciona un rol, elige un rol.

- Para conceder más roles, haz clic en Añadir otro rol y añade cada rol adicional.

- Haz clic en Guardar.

Install the Google Cloud CLI.

Si utilizas un proveedor de identidades (IdP) externo, primero debes iniciar sesión en la CLI de gcloud con tu identidad federada.

Para inicializar gcloud CLI, ejecuta el siguiente comando:

gcloud init -

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Speech-to-Text APIs.

-

Make sure that you have the following role or roles on the project: Cloud Speech Administrator

Check for the roles

-

In the Google Cloud console, go to the IAM page.

Go to IAM - Select the project.

-

In the Principal column, find all rows that identify you or a group that you're included in. To learn which groups you're included in, contact your administrator.

- For all rows that specify or include you, check the Role column to see whether the list of roles includes the required roles.

Grant the roles

-

In the Google Cloud console, go to the IAM page.

Ir a IAM - Selecciona el proyecto.

- Haz clic en Conceder acceso.

-

En el campo Nuevos principales, introduce tu identificador de usuario. Normalmente, se trata de la dirección de correo de una cuenta de Google.

- En la lista Selecciona un rol, elige un rol.

- Para conceder más roles, haz clic en Añadir otro rol y añade cada rol adicional.

- Haz clic en Guardar.

Install the Google Cloud CLI.

Si utilizas un proveedor de identidades (IdP) externo, primero debes iniciar sesión en la CLI de gcloud con tu identidad federada.

Para inicializar gcloud CLI, ejecuta el siguiente comando:

gcloud init -

-

If you're using a local shell, then create local authentication credentials for your user account:

gcloud auth application-default login

You don't need to do this if you're using Cloud Shell.

If an authentication error is returned, and you are using an external identity provider (IdP), confirm that you have signed in to the gcloud CLI with your federated identity.

- Asegúrate de haberte registrado para obtener una cuenta de Google Cloud y de haber creado un proyecto.

- Ve a Voz en la consola de Google Cloud .

- Habilita la API si aún no lo has hecho.

- Ve a la subpágina Transcripciones.

- Haz clic en New Transcription (Nueva transcripción).

Asegúrate de que tienes un espacio de trabajo de STT. Si no lo tienes, crea uno.

Abre el menú desplegable Espacio de trabajo y haz clic en Nuevo espacio de trabajo.

En la barra lateral de navegación Crear un espacio de trabajo, haz clic en Buscar.

Haz clic para crear un segmento.

Escribe el nombre del contenedor y haz clic en Continuar.

Haz clic en Crear.

Una vez creado el segmento, haz clic en Seleccionar para seleccionarlo.

Haz clic en Crear para terminar de crear tu espacio de trabajo de Speech-to-Text.

Transcribe el audio.

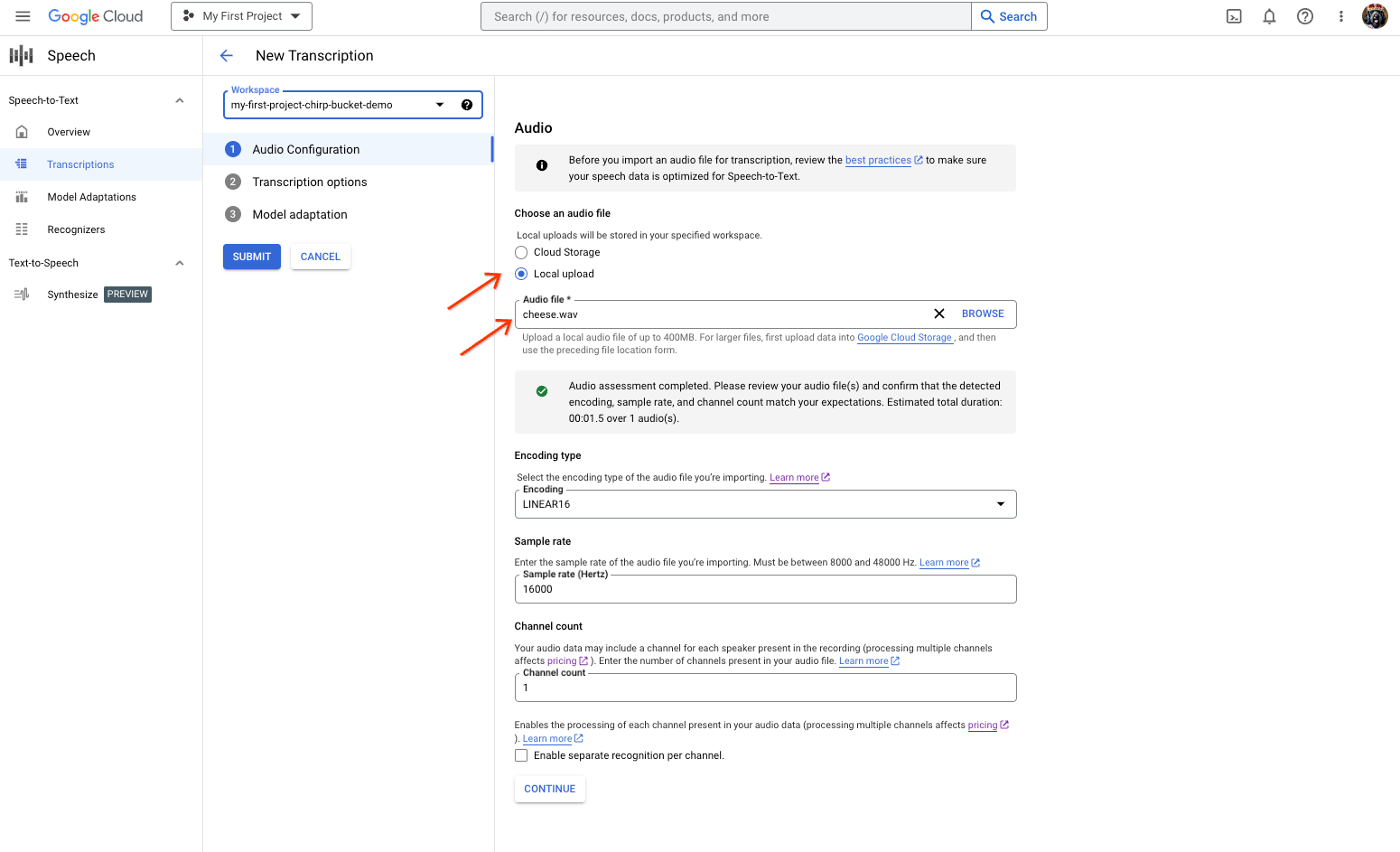

- En la página Nueva transcripción, elige una opción para seleccionar el archivo de audio:

- Para subirlo, haz clic en Subida local.

- Haga clic en Almacenamiento en la nube para especificar un archivo de Cloud Storage.

- Haz clic en Continuar.

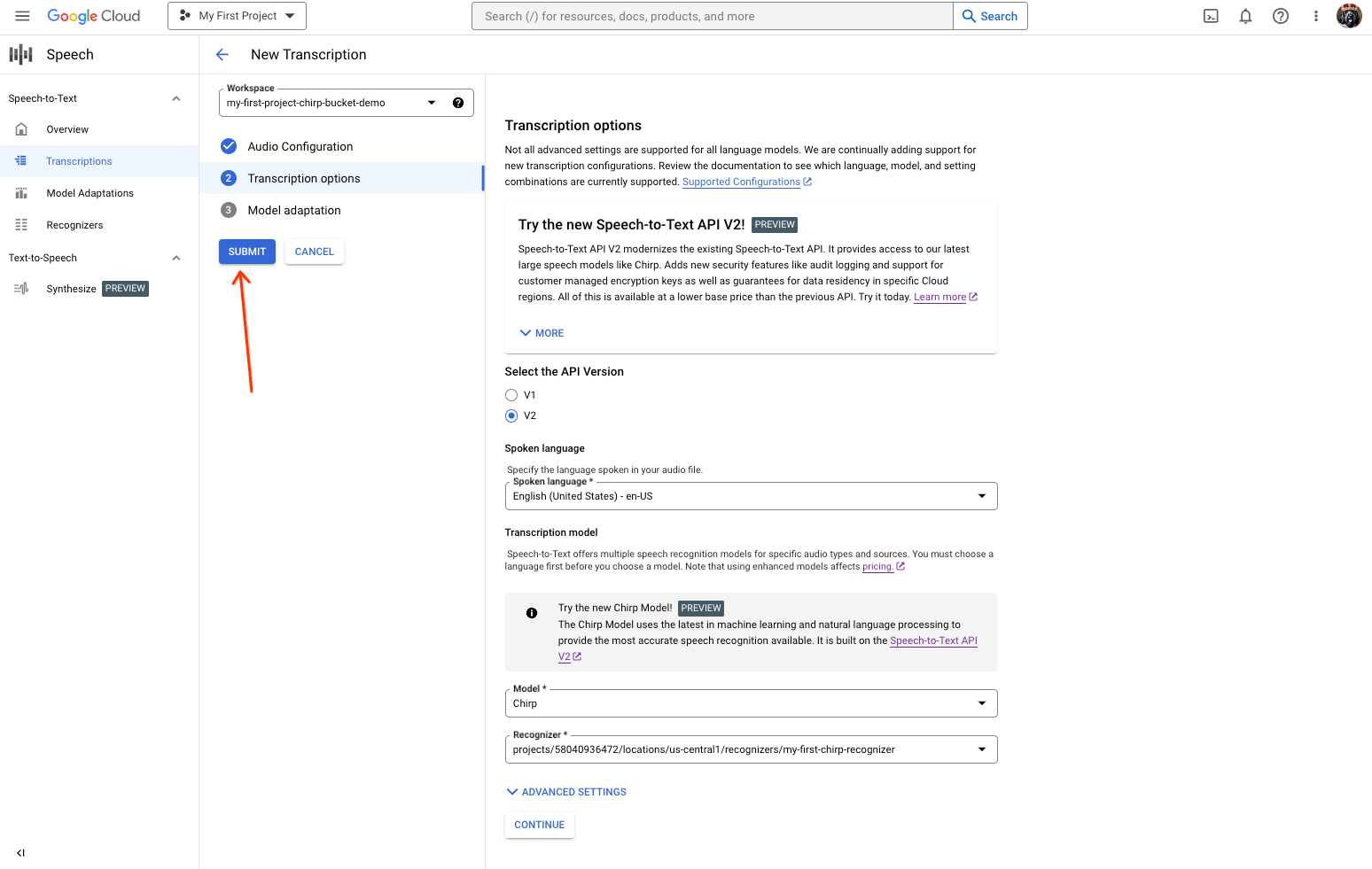

En la sección Opciones de transcripción, selecciona el idioma hablado que quieras usar para el reconocimiento con Chirp en el reconocedor que hayas creado anteriormente.

En el menú desplegable Modelo*, selecciona Chirp.

En el desplegable Región, selecciona una región, como us-central1.

Haz clic en Continuar.

Para ejecutar tu primera solicitud de reconocimiento con Chirp, en la sección principal, haz clic en Enviar.

- En la página Nueva transcripción, elige una opción para seleccionar el archivo de audio:

Consulta el resultado de la transcripción de Chirp.

En la página Transcripciones, haz clic en el nombre de la transcripción.

En la página Detalles de la transcripción, consulta el resultado de la transcripción y, si quieres, reproduce el audio en el navegador.

-

Optional: Revoke the authentication credentials that you created, and delete the local credential file.

gcloud auth application-default revoke

-

Optional: Revoke credentials from the gcloud CLI.

gcloud auth revoke

- In the Google Cloud console, go to the Manage resources page.

- In the project list, select the project that you want to delete, and then click Delete.

- In the dialog, type the project ID, and then click Shut down to delete the project.

- In the Google Cloud console, go to the Manage resources page.

- In the project list, select the project that you want to delete, and then click Delete.

- In the dialog, type the project ID, and then click Shut down to delete the project.

- Practica transcribiendo archivos de audio cortos.

- Consulta cómo transcribir audio de streaming.

- Consulta cómo transcribir archivos de audio largos.

- Para obtener el mejor rendimiento, precisión y otros consejos, consulta la documentación sobre las prácticas recomendadas.

Las bibliotecas de cliente pueden usar las credenciales predeterminadas de la aplicación para autenticarse fácilmente en las APIs de Google y enviar solicitudes a esas APIs. Con las credenciales predeterminadas de la aplicación, puedes probar tu aplicación de forma local e implementarla sin cambiar el código subyacente. Para obtener más información, consulta el artículo Autenticarse para usar bibliotecas de cliente.

También debes instalar la biblioteca de cliente.

Realizar el reconocimiento de voz síncrono con Chirp

A continuación, se muestra un ejemplo de cómo realizar el reconocimiento de voz síncrono en un archivo de audio local con Chirp:

Python

Hacer una solicitud con la transcripción sin lenguaje verbal habilitada

En los siguientes ejemplos de código se muestra cómo hacer una solicitud con la transcripción independiente del idioma habilitada.

Python

Empezar a usar Chirp en la Google Cloud consola

Limpieza

Para evitar que se apliquen cargos en tu cuenta de Google Cloud por los recursos utilizados en esta página, sigue estos pasos.

Consola

gcloud