Chirp est la nouvelle génération de modèles de reconnaissance vocale de Google. Fruit de plusieurs années de recherche, la première version de Chirp est désormais disponible pour Speech-to-Text. Nous avons l'intention d'améliorer et d'étendre le modèle Chirp à d'autres langues et domaines. Pour plus d'informations, consultez notre article, USM de Google.

Nous avons entraîné les modèles Chirp avec une architecture différente de celle de nos modèles de reconnaissance vocale actuels. Un seul modèle unifie les données de nombreuses langues. Les utilisateurs doivent néanmoins toujours spécifier la langue à appliquer par le modèle pour reconnaître la voix. Chirp n'est pas compatible avec certaines des fonctionnalités Google Speech d'autres modèles. Pour obtenir la liste complète, consultez Compatibilité des fonctionnalités et limites.

Identifiants de modèle

Chirp est disponible dans l'API Speech-to-Text v2. Vous pouvez l'utiliser comme n'importe quel autre modèle.

L'identifiant du modèle Chirp est le suivant : chirp.

Vous pouvez spécifier ce modèle dans des requêtes de reconnaissance synchrone ou par lot.

Méthodes d'API disponibles

Chirp traite la reconnaissance vocale en fragments beaucoup plus importants que les autres modèles. Cela signifie qu'il n'est pas forcément adapté à une utilisation en temps réel. Chirp est disponible via les méthodes d'API suivantes :

v2Speech.Recognize(compatible avec les contenus audio courts < 1 min)v2Speech.BatchRecognize(compatible avec les contenus audio longs de 1 min à 8 heures)

Chirp n'est pas disponible dans les méthodes d'API suivantes :

v2Speech.StreamingRecognizev1Speech.StreamingRecognizev1Speech.Recognizev1Speech.LongRunningRecognizev1p1beta1Speech.StreamingRecognizev1p1beta1Speech.Recognizev1p1beta1Speech.LongRunningRecognize

Régions

Chirp est disponible dans les régions suivantes :

us-central1europe-west4asia-southeast1

Pour plus d'informations, consultez la section Langues.

Langues

Vous trouverez la liste des langues disponibles dans la liste complète des langues.

Compatibilité des fonctionnalités et limites

Chirp n'est pas compatible avec certaines fonctionnalités de l'API STT :

- Scores de confiance : l'API renvoie une valeur, mais ce n'est pas réellement un score de confiance.

- Adaptation vocale : aucune fonctionnalité d'adaptation n'est compatible.

- Identification : l'identification automatique du locuteur n'est pas possible.

- Normalisation forcée : non compatible.

- Confiance au niveau du mot : non compatible.

- Détection de la langue : non compatible.

Chirp est compatible avec les fonctionnalités suivantes :

- Ponctuation automatique : la ponctuation est prédite par le modèle. Elle peut être désactivée.

- Temps de chargement du mot : renvoyé selon les options.

- Transcription audio indépendante du langage : le modèle déduit automatiquement le langage parlé dans votre fichier audio et l'ajoute aux résultats.

Avant de commencer

- Sign in to your Google Cloud account. If you're new to Google Cloud, create an account to evaluate how our products perform in real-world scenarios. New customers also get $300 in free credits to run, test, and deploy workloads.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Speech-to-Text APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. -

Make sure that you have the following role or roles on the project: Cloud Speech Administrator

Check for the roles

-

In the Google Cloud console, go to the IAM page.

Go to IAM - Select the project.

-

In the Principal column, find all rows that identify you or a group that you're included in. To learn which groups you're included in, contact your administrator.

- For all rows that specify or include you, check the Role column to see whether the list of roles includes the required roles.

Grant the roles

-

In the Google Cloud console, go to the IAM page.

Accéder à IAM - Sélectionnez le projet.

- Cliquez sur Accorder l'accès.

-

Dans le champ Nouveaux comptes principaux, saisissez votre identifiant utilisateur. Il s'agit généralement de l'adresse e-mail d'un compte Google.

- Dans la liste Sélectionner un rôle, sélectionnez un rôle.

- Pour attribuer des rôles supplémentaires, cliquez sur Ajouter un autre rôle et ajoutez tous les rôles supplémentaires.

- Cliquez sur Enregistrer.

Install the Google Cloud CLI.

Si vous utilisez un fournisseur d'identité (IdP) externe, vous devez d'abord vous connecter à la gcloud CLI avec votre identité fédérée.

Pour initialiser la gcloud CLI, exécutez la commande suivante :

gcloud init -

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Speech-to-Text APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. -

Make sure that you have the following role or roles on the project: Cloud Speech Administrator

Check for the roles

-

In the Google Cloud console, go to the IAM page.

Go to IAM - Select the project.

-

In the Principal column, find all rows that identify you or a group that you're included in. To learn which groups you're included in, contact your administrator.

- For all rows that specify or include you, check the Role column to see whether the list of roles includes the required roles.

Grant the roles

-

In the Google Cloud console, go to the IAM page.

Accéder à IAM - Sélectionnez le projet.

- Cliquez sur Accorder l'accès.

-

Dans le champ Nouveaux comptes principaux, saisissez votre identifiant utilisateur. Il s'agit généralement de l'adresse e-mail d'un compte Google.

- Dans la liste Sélectionner un rôle, sélectionnez un rôle.

- Pour attribuer des rôles supplémentaires, cliquez sur Ajouter un autre rôle et ajoutez tous les rôles supplémentaires.

- Cliquez sur Enregistrer.

Install the Google Cloud CLI.

Si vous utilisez un fournisseur d'identité (IdP) externe, vous devez d'abord vous connecter à la gcloud CLI avec votre identité fédérée.

Pour initialiser la gcloud CLI, exécutez la commande suivante :

gcloud init -

-

If you're using a local shell, then create local authentication credentials for your user account:

gcloud auth application-default login

You don't need to do this if you're using Cloud Shell.

If an authentication error is returned, and you are using an external identity provider (IdP), confirm that you have signed in to the gcloud CLI with your federated identity.

- Assurez-vous d'avoir créé un compte Google Cloud et un projet.

- Accédez à Speech dans la console Google Cloud .

- Si ce n'est pas déjà fait, activez l'API.

- Accédez à la sous-page Transcriptions.

- Cliquez sur Nouvelle transcription.

Assurez-vous de disposer d'un espace de travail STT. Si vous n'en avez pas, créez-en un.

Ouvrez le menu déroulant Espace de travail et cliquez sur Nouvel espace de travail.

Dans la barre latérale de navigation Créer un espace de travail, cliquez sur Parcourir.

Cliquez pour créer un bucket.

Saisissez un nom pour ce bucket, puis cliquez sur Continuer.

Cliquez sur Créer.

Une fois le bucket créé, cliquez sur Sélectionner pour le sélectionner.

Cliquez sur Créer pour terminer la création de votre espace de travail pour Speech-to-Text.

Effectuez une transcription de votre contenu audio.

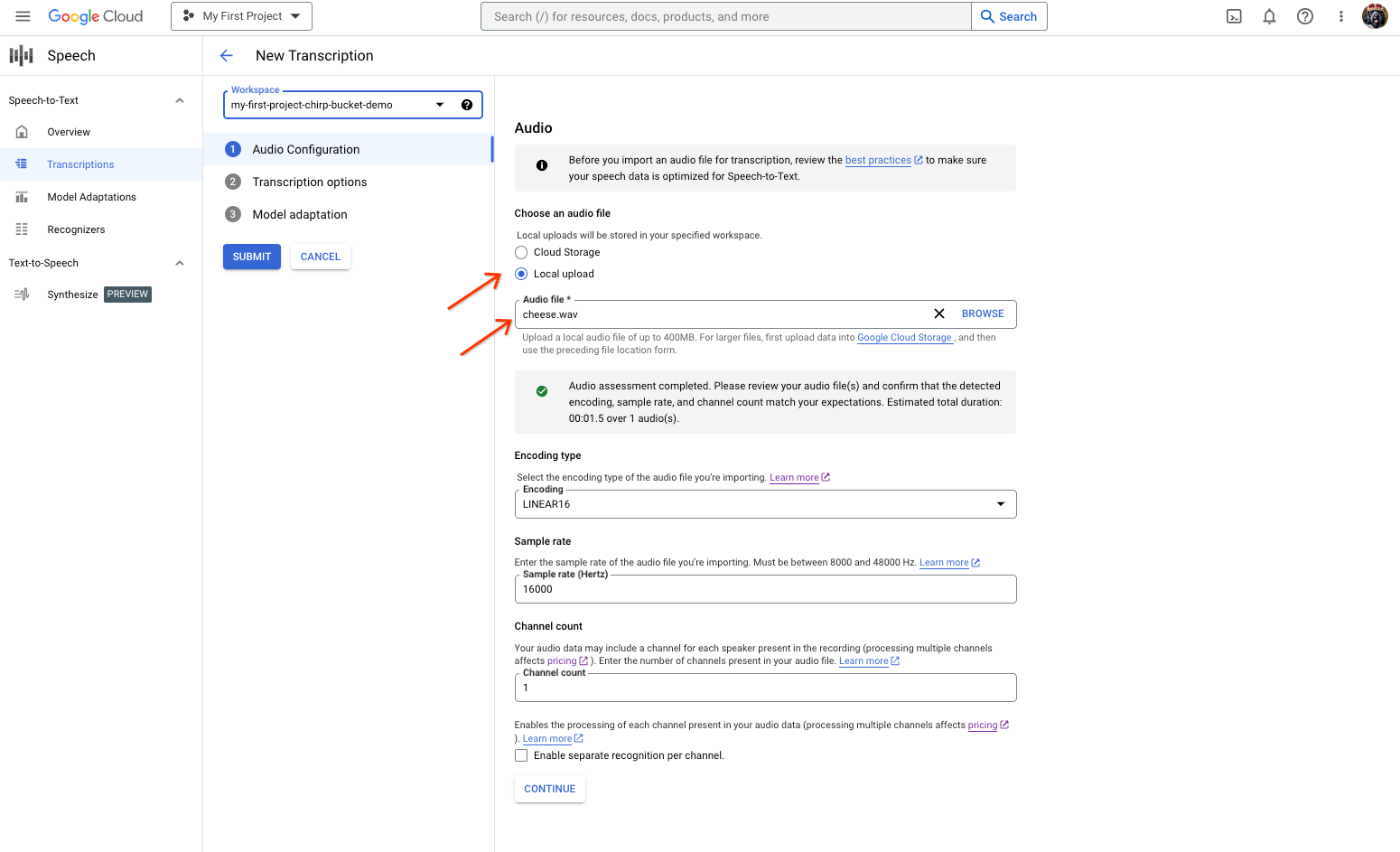

- Sur la page Nouvelle transcription, choisissez une option pour sélectionner votre fichier audio :

- Importez-le en cliquant sur Importation locale.

- Cliquez sur Cloud Storage pour spécifier un fichier Cloud Storage existant.

- Cliquez sur Continuer.

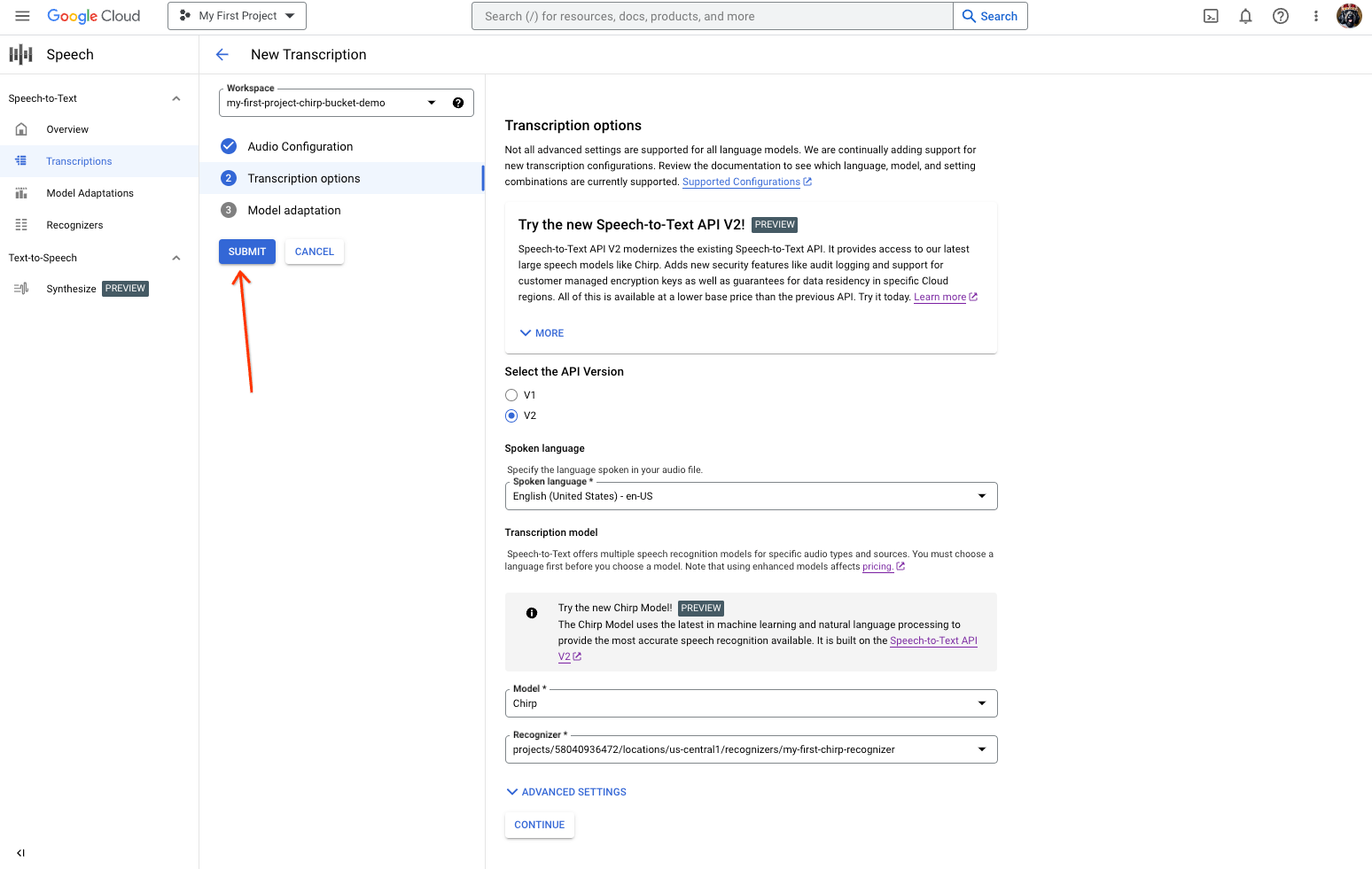

Dans la section Options de transcription, sélectionnez la Langue parlée que vous prévoyez d'utiliser pour la reconnaissance avec le modèle Chirp à partir de l'outil de reconnaissance que vous avez créé précédemment.

Dans le menu déroulant Modèle*, sélectionnez Chirp.

Dans le menu déroulant Région, sélectionnez une région, par exemple us-central1.

Cliquez sur Continuer.

Pour exécuter votre première requête de reconnaissance à l'aide de Chirp, cliquez sur Envoyer dans la section principale.

- Sur la page Nouvelle transcription, choisissez une option pour sélectionner votre fichier audio :

Affichez le résultat de la transcription Chirp.

Sur la page Transcriptions, cliquez sur le nom de la transcription.

Sur la page Détails de la transcription, consultez le résultat de votre transcription et, éventuellement, lancez la lecture du contenu audio dans le navigateur.

-

Optional: Revoke the authentication credentials that you created, and delete the local credential file.

gcloud auth application-default revoke

-

Optional: Revoke credentials from the gcloud CLI.

gcloud auth revoke

- In the Google Cloud console, go to the Manage resources page.

- In the project list, select the project that you want to delete, and then click Delete.

- In the dialog, type the project ID, and then click Shut down to delete the project.

- In the Google Cloud console, go to the Manage resources page.

- In the project list, select the project that you want to delete, and then click Delete.

- In the dialog, type the project ID, and then click Shut down to delete the project.

- Entraînez-vous à transcrire des fichiers audio courts.

- Découvrez comment transcrire du contenu audio diffusé en streaming.

- Découvrez comment transcrire des fichiers audio longs.

- Pour obtenir des conseils, entre autres sur l'optimisation des performances et l'amélioration de la précision, consultez la documentation relative aux bonnes pratiques.

Les bibliothèques clientes peuvent utiliser les identifiants par défaut de l'application pour s'authentifier facilement auprès des API Google et envoyer des requêtes à ces API. Ces identifiants vous permettent de tester votre application localement et de la déployer sans modifier le code sous-jacent. Pour en savoir plus, consultez S'authentifier à l'aide des bibliothèques clientes.

Vérifiez également que vous avez installé la bibliothèque cliente.

Effectuer une reconnaissance vocale synchrone avec Chirp

Voici un exemple d'exécution de reconnaissance vocale synchrone sur un fichier audio local à l'aide de Chirp :

Python

Envoyer une requête avec la transcription indépendante du langage activée

Les exemples de code suivants montrent comment effectuer une requête avec la transcription indépendante du langage.

Python

Premiers pas avec Chirp dans la console Google Cloud

Effectuer un nettoyage

Pour éviter que les ressources utilisées sur cette page soient facturées sur votre compte Google Cloud , procédez comme suit :

Console

gcloud