Um conjunto de dados contém amostras representativas do tipo de conteúdo que você quer classificar, marcado com as etiquetas de categoria que você quer que seu modelo personalizado use. O conjunto de dados serve como entrada para treinar um modelo.

Veja a seguir os principais passos para criar um conjunto de dados:

- Crie um recurso de conjunto de dados.

- Importe dados de treinamento para o conjunto de dados.

- Identifique os documentos ou as entidades.

Para a classificação e análise de sentimento, as etapas 2 e 3 geralmente são combinadas: é possível importar documentos com os rótulos já atribuídos.

Como criar um conjunto de dados

A primeira etapa na criação de um modelo personalizado é criar um conjunto de dados vazio que vai armazenar os dados de treinamento do modelo. O conjunto de dados recém-criado não contém dados até que você importe documentos para ele.

IU da Web

Para criar um conjunto de dados:

Abra a IU do AutoML Natural Language e selecione Primeiros passos na caixa correspondente ao tipo de modelo que pretende treinar.

Será exibida a página Conjuntos de dados, que mostra o status de conjuntos de dados criados anteriormente para o projeto atual.

Para adicionar um conjunto de dados para um projeto diferente, selecione o projeto na lista suspensa no canto superior direito da barra de título.

Clique no botão Novo conjunto de dados na barra do título.

Insira um nome para o conjunto de dados e especifique o Local geográfico para armazená-lo.

Consulte Locais para mais informações.

Selecione o objetivo do modelo, que especifica o tipo de análise que você realizará com o modelo que treinar usando esse conjunto de dados.

- A classificação de rótulo único atribui um único rótulo a cada documento classificado.

- A classificação de vários rótulos permite que um documento seja atribuído a vários rótulos.

- A extração de entidade identifica as entidades nos documentos.

- A análise de sentimento analisa as atitudes nos documentos.

Clique em Criar conjunto de dados.

Será exibida a página Importar do novo conjunto de dados. Consulte Como importar dados para um conjunto de dados.

Amostras de código

Classificação

REST

Antes de usar os dados da solicitação, faça as substituições a seguir:

- project-id: ID do projeto;

- location-id: o local do recurso,

us-central1para o local Global oueupara a União Europeia

Método HTTP e URL:

POST https://automl.googleapis.com/v1/projects/project-id/locations/location-id/datasets

Corpo JSON da solicitação:

{

"displayName": "test_dataset",

"textClassificationDatasetMetadata": {

"classificationType": "MULTICLASS"

}

}

Para enviar a solicitação, expanda uma destas opções:

Você receberá uma resposta JSON semelhante a esta:

{

"name": "projects/434039606874/locations/us-central1/datasets/356587829854924648",

"displayName": "test_dataset",

"createTime": "2018-04-26T18:02:59.825060Z",

"textClassificationDatasetMetadata": {

"classificationType": "MULTICLASS"

}

}

Python

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Python.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Java

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Java.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Node.js

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Node.js.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Go

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Go.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Outras linguagens

C# : Siga as Instruções de configuração do C# na página das bibliotecas de cliente e acesse a Documentação de referência do AutoML Natural Language para .NET.

PHP : Siga as Instruções de configuração do PHP na página das bibliotecas de cliente e acesse Documentação de referência do AutoML Natural Language para PHP.

Ruby Siga as Instruções de configuração do Ruby na página das bibliotecas de cliente e acesse Documentação de referência do AutoML Natural Language para Ruby.

Extração de entidade

REST

Antes de usar os dados da solicitação, faça as substituições a seguir:

- project-id: ID do projeto;

- location-id: o local do recurso,

us-central1para o local Global oueupara a União Europeia

Método HTTP e URL:

POST https://automl.googleapis.com/v1/projects/project-id/locations/location-id/datasets

Corpo JSON da solicitação:

{

"displayName": "test_dataset",

"textExtractionDatasetMetadata": {

}

}

Para enviar a solicitação, expanda uma destas opções:

Você receberá uma resposta JSON semelhante a esta:

{

name: "projects/000000000000/locations/us-central1/datasets/TEN5582774688079151104"

display_name: "test_dataset"

create_time {

seconds: 1539886451

nanos: 757650000

}

text_extraction_dataset_metadata {

}

}

Python

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Python.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Java

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Java.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Node.js

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Node.js.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Go

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Go.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Outras linguagens

C# : Siga as Instruções de configuração do C# na página das bibliotecas de cliente e acesse a Documentação de referência do AutoML Natural Language para .NET.

PHP : Siga as Instruções de configuração do PHP na página das bibliotecas de cliente e acesse Documentação de referência do AutoML Natural Language para PHP.

Ruby Siga as Instruções de configuração do Ruby na página das bibliotecas de cliente e acesse Documentação de referência do AutoML Natural Language para Ruby.

Análise de sentimento

REST

Antes de usar os dados da solicitação, faça as substituições a seguir:

- project-id: ID do projeto;

- location-id: o local do recurso,

us-central1para o local Global oueupara a União Europeia

Método HTTP e URL:

POST https://automl.googleapis.com/v1/projects/project-id/locations/location-id/datasets

Corpo JSON da solicitação:

{

"displayName": "test_dataset",

"textSentimentDatasetMetadata": {

"sentimentMax": 4

}

}

Para enviar a solicitação, expanda uma destas opções:

Você receberá uma resposta JSON semelhante a esta:

{

name: "projects/000000000000/locations/us-central1/datasets/TST8962998974766436002"

display_name: "test_dataset_name"

create_time {

seconds: 1538855662

nanos: 51542000

}

text_sentiment_dataset_metadata {

sentiment_max: 7

}

}

Python

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Python.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Java

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Java.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Node.js

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Node.js.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Go

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Go.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Outras linguagens

C# : Siga as Instruções de configuração do C# na página das bibliotecas de cliente e acesse a Documentação de referência do AutoML Natural Language para .NET.

PHP : Siga as Instruções de configuração do PHP na página das bibliotecas de cliente e acesse Documentação de referência do AutoML Natural Language para PHP.

Ruby Siga as Instruções de configuração do Ruby na página das bibliotecas de cliente e acesse Documentação de referência do AutoML Natural Language para Ruby.

Como importar dados de treinamento para um conjunto de dados

Depois de criar um conjunto de dados, é possível importar URIs e rótulos de documentos de um arquivo CSV armazenado em um bucket do Cloud Storage. Para ver detalhes sobre como preparar os dados e criar um arquivo CSV para importação, consulte Como preparar dados de treinamento.

É possível importar documentos para um conjunto de dados vazio ou importar documentos complementares para um conjunto de dados atual.

IU da Web

Para importar documentos para um conjunto de dados:

Selecione o conjunto de dados em que você quer importar documentos na página Conjuntos de dados.

Na guia Importar, especifique onde encontrar os documentos de treinamento.

Você pode:

Faça o upload de um arquivo .csv que contém os documentos de treinamento e os respectivos rótulos de categoria associados no computador local ou no Cloud Storage.

Fazer upload de uma coleção de arquivos .txt, .pdf ou .zip do seu computador local que contenham os documentos de treinamento.

Selecione os arquivos a serem importados e o caminho do Cloud Storage para os documentos importados.

Clique em Import.

Amostras de código

REST

Antes de usar os dados da solicitação, faça as substituições a seguir:

- project-id: ID do projeto;

- location-id: o local do recurso,

us-central1para o local Global oueupara a União Europeia - dataset-id: o ID do conjunto de dados

- bucket-name: o bucket do Cloud Storage

- csv-file-name: o arquivo de dados de treinamento CSV

Método HTTP e URL:

POST https://automl.googleapis.com/v1/projects/project-id/locations/location-id/datasets/dataset-id:importData

Corpo JSON da solicitação:

{

"inputConfig": {

"gcsSource": {

"inputUris": ["gs://bucket-name/csv-file-name.csv"]

}

}

}

Para enviar a solicitação, expanda uma destas opções:

Será exibido um código semelhante a este. Você pode usar o código da operação para saber o status da tarefa. Veja um exemplo em Como saber o status de uma operação.

{

"name": "projects/434039606874/locations/us-central1/operations/1979469554520650937",

"metadata": {

"@type": "type.googleapis.com/google.cloud.automl.v1beta1.OperationMetadata",

"createTime": "2018-04-27T01:28:36.128120Z",

"updateTime": "2018-04-27T01:28:36.128150Z",

"cancellable": true

}

}

Python

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Python.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Java

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Java.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Node.js

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Node.js.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Go

Para saber como instalar e usar a biblioteca de cliente para o AutoML Natural Language, consulte Bibliotecas de cliente do AutoML Natural Language. Para mais informações, consulte a documentação de referência da API AutoML Natural Language Go.

Para se autenticar no Natural Language do AutoML, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Outras linguagens

C# : Siga as Instruções de configuração do C# na página das bibliotecas de cliente e acesse a Documentação de referência do AutoML Natural Language para .NET.

PHP : Siga as Instruções de configuração do PHP na página das bibliotecas de cliente e acesse Documentação de referência do AutoML Natural Language para PHP.

Ruby Siga as Instruções de configuração do Ruby na página das bibliotecas de cliente e acesse Documentação de referência do AutoML Natural Language para Ruby.

Como rotular documentos de treinamento

Para ser útil para o treinamento de um modelo, cada documento de um conjunto de dados precisa ser rotulado da maneira que você quer que o AutoML Natural Language rotule documentos semelhantes. A qualidade dos dados de treinamento tem forte impacto sobre a eficácia do modelo criado e, por consequência, sobre a qualidade das predições retornadas pelo modelo. Durante o treinamento, o AutoML Natural Language ignora documentos não rotulados.

É possível fornecer rótulos para os documentos de treinamento de três maneiras:

- Inclua os rótulos no seu arquivo .csv (apenas para classificação e análise de sentimento).

- Rotule seus documentos na IU do AutoML Natural Language.

- Use o Serviço de rotulagem de dados do AI Platform para solicitar o serviço de rotuladores profissionais.

A API do AutoML não inclui métodos para rotulagem.

Para detalhes sobre como rotular documentos no arquivo .csv, consulte Como preparar os dados de treinamento.

Rotulagem para classificação e análise de sentimento

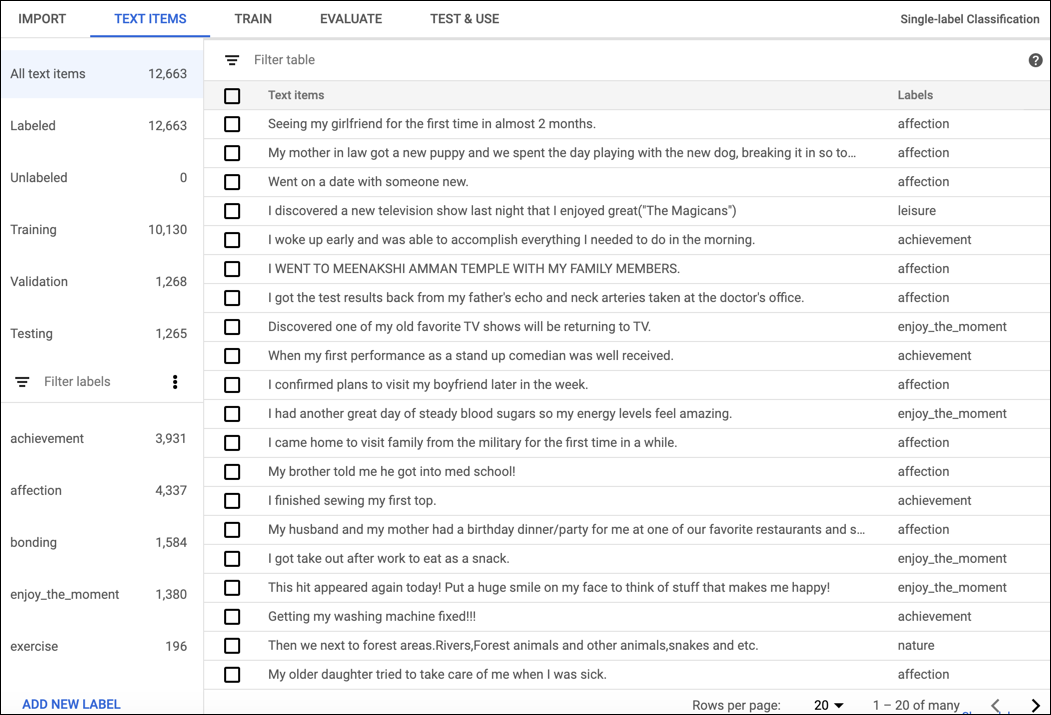

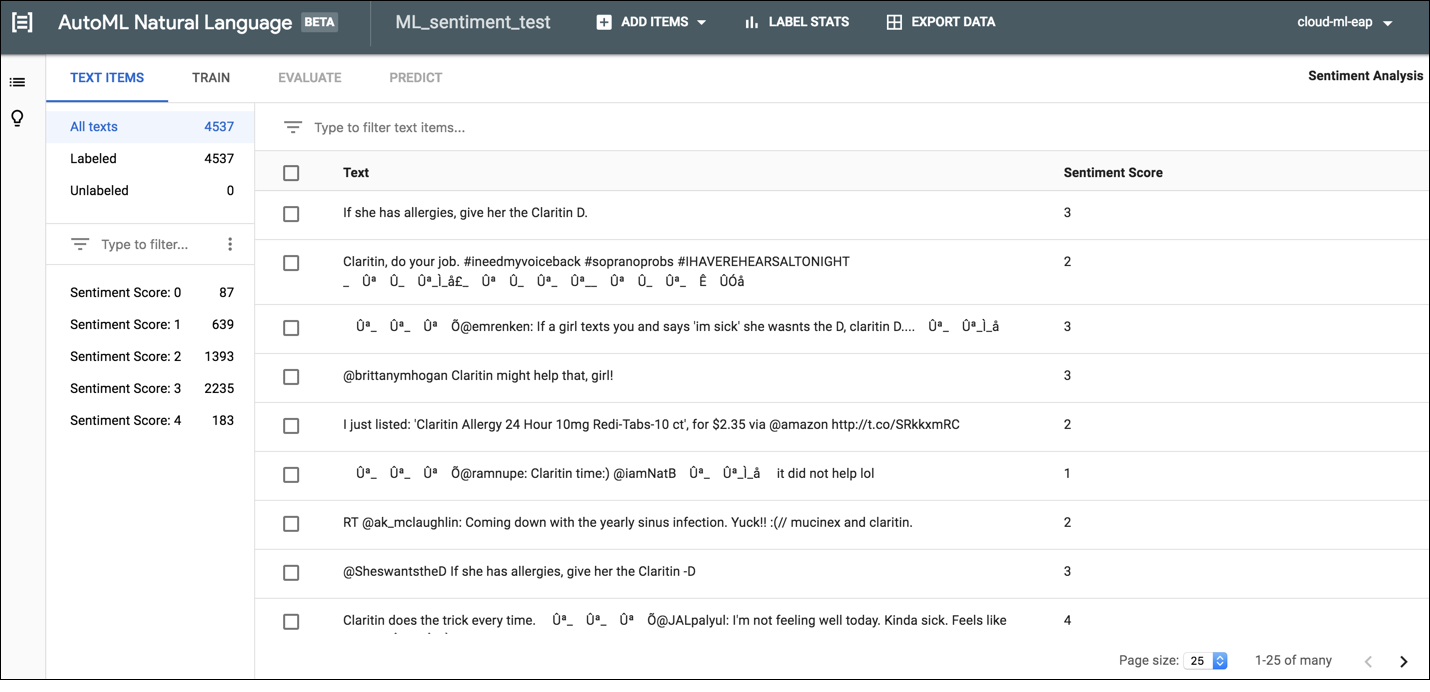

Para rotular documentos na IU do AutoML Natural Language, selecione o conjunto de dados na página de listagem para ver os respectivos detalhes. O nome de exibição do conjunto de dados selecionado aparece na barra de título, e a página relaciona os documentos individuais no conjunto de dados com os respectivos rótulos. A barra de navegação à esquerda resume o número de documentos rotulados e não rotulados e permite filtrar a lista de documentos por rótulo ou valor de sentimento.

Para atribuir rótulos ou valores de sentimento a documentos não rotulados ou alterar esses rótulos, selecione os documentos que você quer atualizar e o(s) rótulo(s) ou valor que você quer atribuir a eles. Há duas maneiras de atualizar o rótulo de um documento:

Clique na caixa de seleção ao lado dos documentos que você quer atualizar e selecione o(s) rótulo(s) para aplicar na lista suspensa Rótulo, que aparece na parte superior da lista de documentos.

Clique na linha do documento que você quer atualizar e selecione o(s) rótulo(s) ou valor a ser aplicado na lista exibida na página Detalhes do texto.

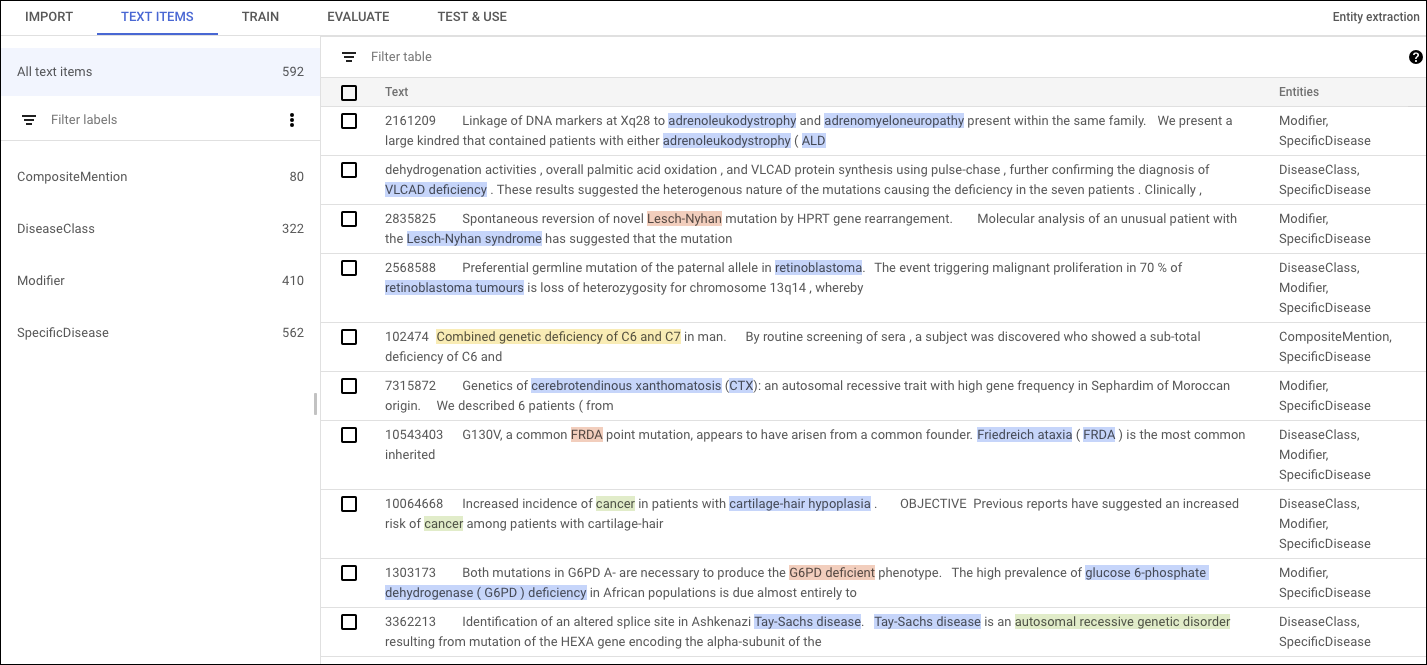

Como identificar entidades para extração de entidade

Antes de treinar seu modelo personalizado, faça anotações nos documentos de treinamento no conjunto de dados. É possível fazer anotações em documentos de treinamento antes de importá-los ou adicionar anotações na IU do AutoML Natural Language.

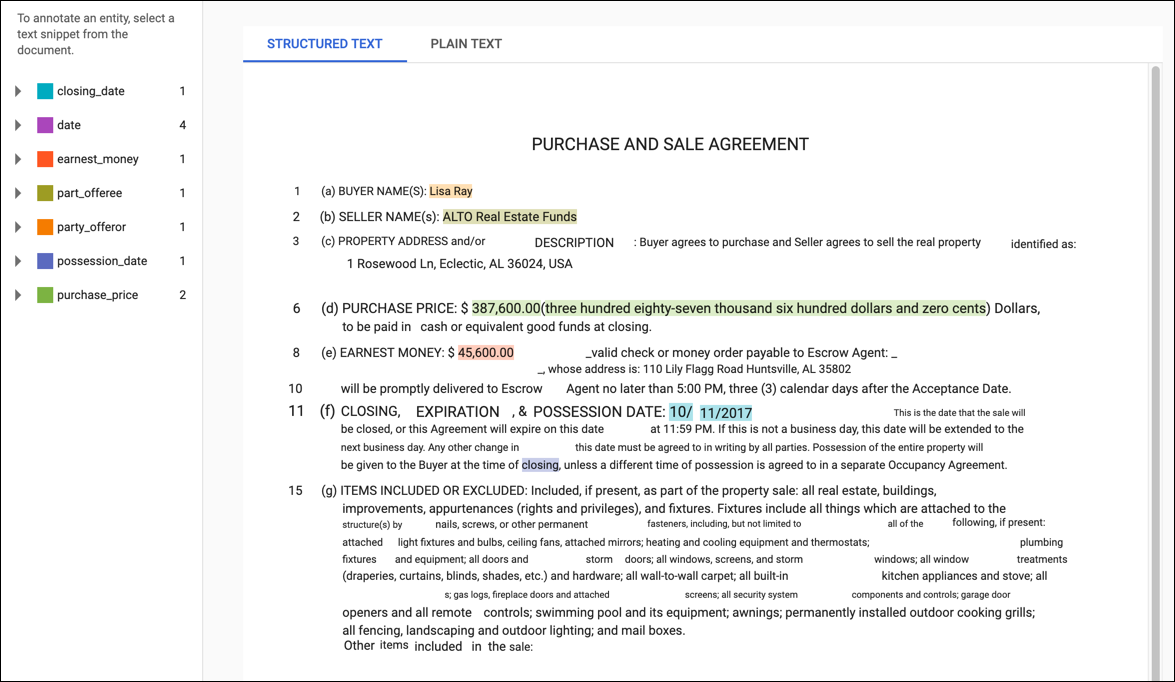

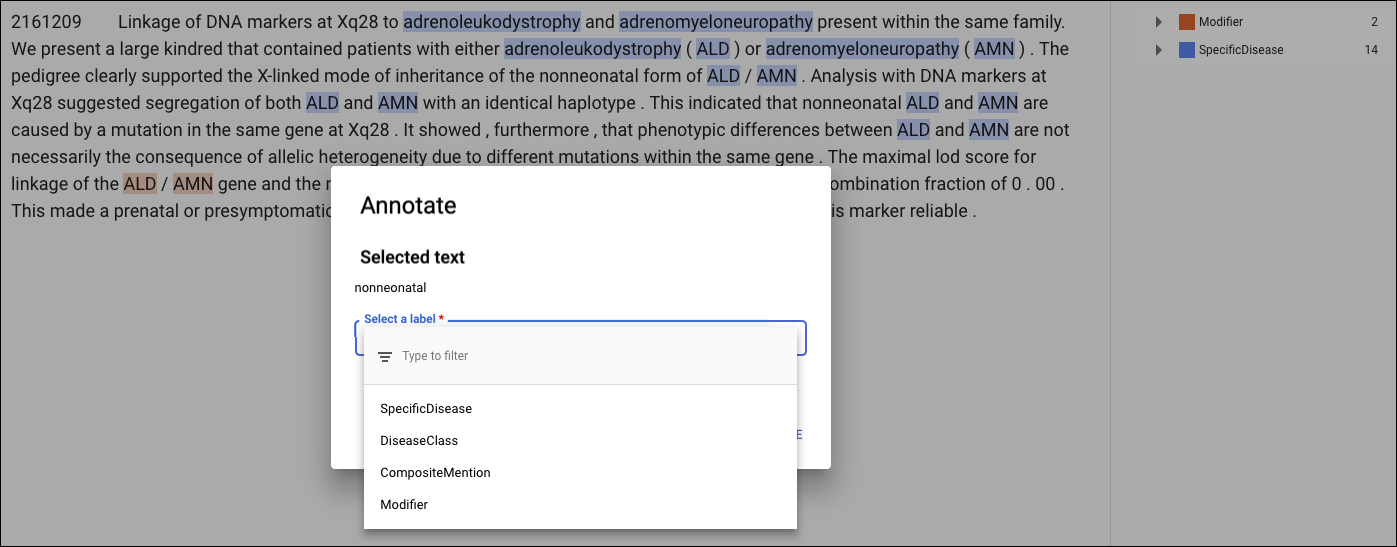

Para fazer anotações na IU do AutoML Natural Language, selecione o conjunto de dados na página de listagem do conjunto de dados para ver os detalhes. O nome de exibição do conjunto de dados selecionado aparece na barra de título, e a página relaciona os documentos individuais no conjunto de dados com as respectivas anotações. A barra de navegação à esquerda resume os rótulos e o número de vezes que cada um aparece. Também é possível filtrar a lista de documentos por rótulo.

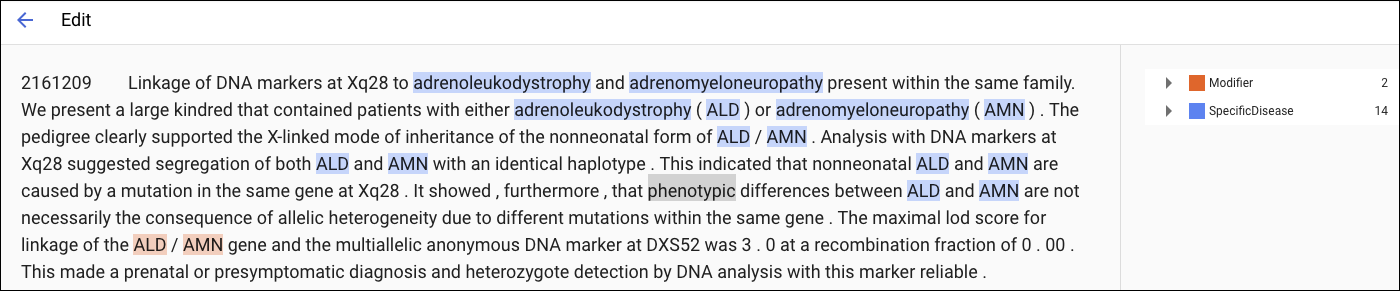

Para adicionar ou excluir anotações de um documento, clique duas vezes no documento que você quer atualizar. A página Editar mostra o texto completo do documento selecionado, com todas as anotações anteriores em destaque.

Para documentos de treinamento em PDF ou documentos importados com informações de layout, a página Editar tem duas guias: texto simples e texto estruturado. A guia Texto simples mostra o conteúdo bruto do documento de treinamento sem qualquer formatação. A guia Texto estruturado recria o layout básico do documento de treinamento. A guia Texto simples também tem um link para o arquivo PDF original.

Para adicionar uma nova anotação, destaque o texto que representa a entidade, selecione o rótulo na caixa de diálogo Anotação e clique em Salvar. Quando você adiciona anotações na guia Texto estruturado, o AutoML Natural Language captura a posição da anotação na página como um fator considerado durante o treinamento.

Para remover uma anotação, localize o texto na lista de rótulos à direita e clique no ícone de lixeira ao lado dele.