生成 AI アプリケーションのモデルとインフラストラクチャを選択する

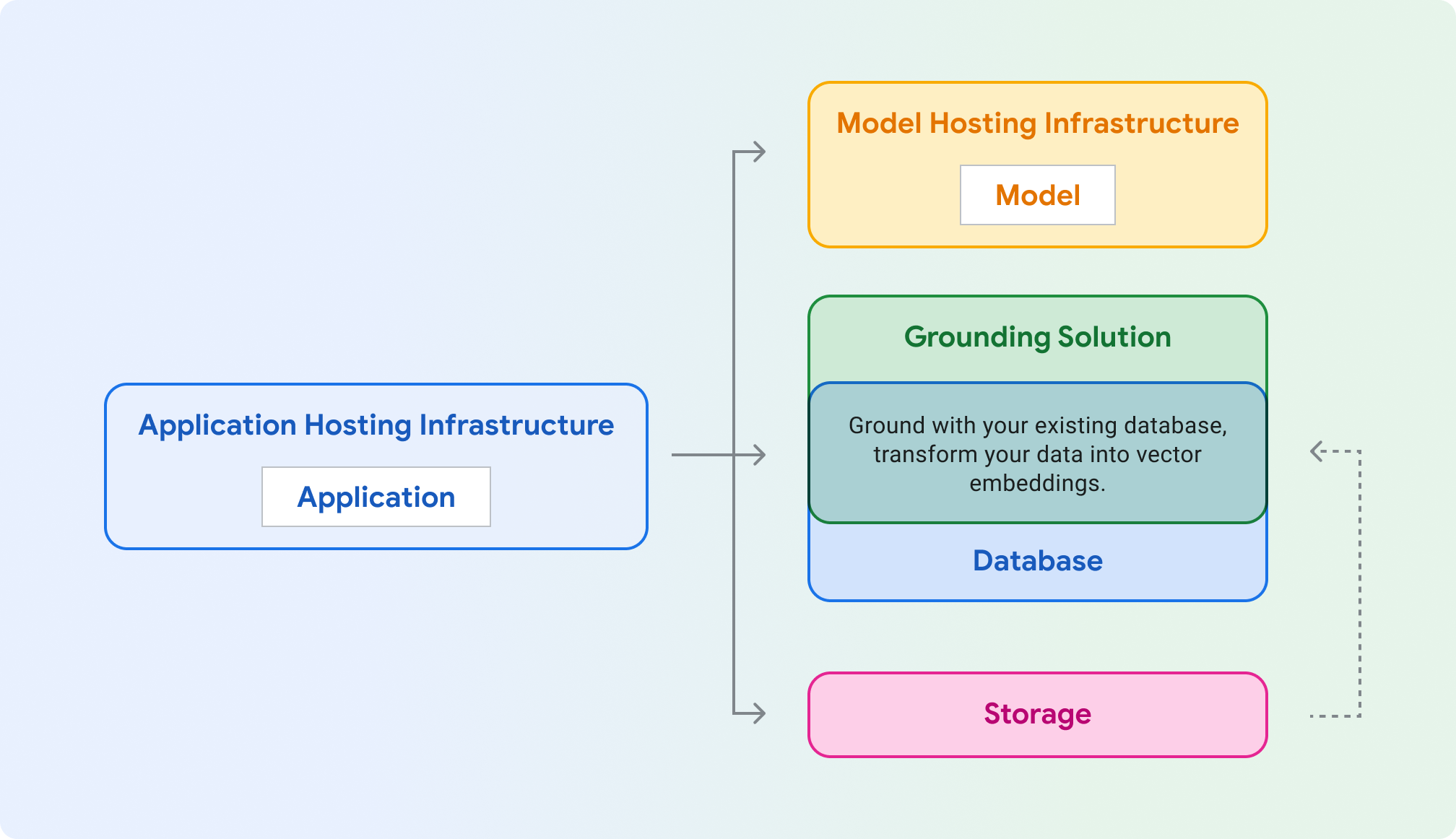

アプリケーション ホスティング: アプリケーションをホストするコンピューティング。アプリケーションは、Google Cloud のクライアント ライブラリと SDK を使用して、さまざまな Cloud プロダクトと通信できます。

モデル ホスティング: 生成モデルのスケーラブルで安全なホスティング。

モデル: テキスト、チャット、画像、コード、エンベディング、マルチモーダルの生成モデル。

グラウンディング ソリューション: 検証可能な最新の情報源とモデルの出力を関連付けます。

データベース: アプリケーションのデータを保存します。SQL クエリによってプロンプトを拡張したり、pgvector などの拡張機能を使用してデータをベクトル エンベディングとして保存することで、既存のデータベースをグラウンディング ソリューションとして再利用できます。

ストレージ: 画像、動画、静的ウェブ フロントエンドなどのファイルを保存します。ストレージを未加工のグラウンディング データ(PDF など)として使用することもできます。このデータを後でエンベディングに変換し、ベクトル データベースに保存します。

以降のセクションでは、これらの各コンポーネントについて説明します。この情報を参考にして、試してみる Google Cloud プロダクトを選択してください。

アプリケーション ホスティング インフラストラクチャ

生成モデルに呼び出しを行うアプリケーション ワークロードをホストして、サービスを提供するプロダクトを選択します。

モデル ホスティング インフラストラクチャ

Google Cloud では、主力の Vertex AI Platform から、カスタマイズ可能でポータブルな Google Kubernetes Engine でのホスティングまで、生成モデルをホストする複数の方法が用意されています。

モデル

Google Cloud では、Vertex AI を通じて一連の最先端基盤モデル(Gemini など)を提供しています。また、サードパーティ モデルを Vertex AI Model Garden にデプロイすることや、GKE、Cloud Run、Compute Engine でセルフホストすることもできます。

グラウンディングと RAG

モデルから裏付けのある正確なレスポンスを取得するには、生成 AI アプリケーションをリアルタイム データでグラウンディングすることをおすすめします。これは、検索拡張生成(RAG)と呼ばれています。

インターネット上の最新情報に基づいてコンテンツを生成する場合、Gemini モデルは、モデルの知識で十分かどうか、または Google 検索によるグラウンディングが必要かどうかを評価できます。

グラウンディングを実装するには、検索エンジンでデータのインデックスを使用します。多くの検索エンジンは、ベクトル データベースにエンベディングを保存しています。これは、類似検索などのオペレーションに最適な形式です。 Google Cloud は、さまざまなユースケースに対応する複数のベクトル データベース ソリューションを提供しています。

注: Cloud SQL や Firestore などの既存のデータベースにクエリを実行してベクトル以外のデータベースを使用してグラウンディングすることや、モデルのプロンプトでクエリの結果を使用することができます。

LlamaIndex のようなインターフェースを持つマネージド オーケストレーターを使用して、RAG 用の検索エンジンを構築する必要がありますか?

データにプログラムでアクセスしますか(OLTP)?すでに SQL データベースを使用していますか?

Google AI モデルをデータベースから直接使用したいですか?低レイテンシが必要ですか?

API によるグラウンディング

Vertex AI Extensions(限定公開プレビュー)

Vertex AI のグラウンディング

構築を開始

LangChain を設定する

LangChain は、プロンプトにコンテキストを組み込み、モデルのレスポンスに基づいて対応できるようにする生成 AI アプリ用オープンソース フレームワークです。

コードサンプルを表示してサンプル アプリケーションをデプロイする

よく使われるユースケースのコードサンプルを確認し、安全性、効率、復元性、パフォーマンス、費用対効果に優れた生成 AI アプリケーションのサンプルをデプロイします。