Ejecuta un DAG de Apache Airflow en Cloud Composer 2

Cloud Composer 3 | Cloud Composer 2 | Cloud Composer 1

En esta guía de inicio rápido, se muestra cómo crear un entorno de Cloud Composer y ejecutar un DAG de Apache Airflow en Cloud Composer 2.

Si eres nuevo en Airflow, consulta el instructivo sobre los conceptos de Airflow en la documentación de Apache Airflow para obtener más información sobre los conceptos, los objetos y su uso.

Si deseas usar Google Cloud CLI en su lugar, consulta Ejecuta un DAG de Apache Airflow en Cloud Composer (Google Cloud CLI).

Si deseas crear un entorno con Terraform, consulta Crea entornos (Terraform).

Antes de comenzar

- Sign in to your Google Cloud account. If you're new to Google Cloud, create an account to evaluate how our products perform in real-world scenarios. New customers also get $300 in free credits to run, test, and deploy workloads.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

-

Verify that billing is enabled for your Google Cloud project.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Cloud Composer API.

-

Para obtener los permisos que necesitas para completar esta guía de inicio rápido, pídele a tu administrador que te otorgue los siguientes roles de IAM en tu proyecto:

-

Para ver, crear y administrar el entorno de Cloud Composer, haz lo siguiente:

-

Administrador de objetos de almacenamiento y entorno (

roles/composer.environmentAndStorageObjectAdmin) -

Usuario de cuenta de servicio (

roles/iam.serviceAccountUser)

-

Administrador de objetos de almacenamiento y entorno (

-

Para ver los registros, usa el Visualizador de registros (

roles/logging.viewer).

Para obtener más información sobre cómo otorgar roles, consulta Administra el acceso a proyectos, carpetas y organizaciones.

También puedes obtener los permisos necesarios a través de roles personalizados o cualquier otro rol predefinido.

-

Para ver, crear y administrar el entorno de Cloud Composer, haz lo siguiente:

Crea una cuenta de servicio nueva, como se describe en la documentación de Identity and Access Management.

Otorga un rol, como se describe en la documentación de Identity and Access Management. El rol requerido es Trabajador de Composer (

composer.worker).En la consola de Google Cloud , ve a la página Crear entorno.

Si este es el primer entorno en tu proyecto, aparecerá la sección Otorga los permisos necesarios a la cuenta de servicio de Cloud Composer.

Agrega la cuenta de agente de servicio de Cloud Composer como una nueva principal en la cuenta de servicio de tu entorno y otórgale el rol de extensión de agente de servicio de la API de Cloud Composer v2.

Confirma que usas la cuenta de servicio prevista para tu entorno y haz clic en Grant.

En el campo Nombre, ingresa

example-environment.En la lista desplegable Ubicación, selecciona una región para el entorno de Cloud Composer. En esta guía, se usa la región

us-central1.Para otras opciones de configuración del entorno, usa los valores predeterminados proporcionados.

Haz clic en Crear y espera a que se cree el entorno.

Cuando termine, aparecerá una marca de verificación verde junto al nombre del entorno.

- Crea un DAG

composer_sample_dag. Este DAG se ejecuta todos los días. - Ejecuta una tarea

print_dag_run_conf. La tarea imprime la configuración de ejecución del DAG con el operador bash. En la consola de Google Cloud , ve a la página Entornos.

En la lista de entornos, haz clic en el nombre de tu entorno,

example-environment. Se abrirá la página Detalles del entorno.Haz clic en Abrir carpeta de DAG. Se abrirá la página Detalles del bucket.

Haz clic en Subir archivos y, luego, selecciona tu copia de

quickstart.py.Para subir el archivo, haz clic en Abrir.

- Analiza el archivo DAG que subiste. Es posible que el DAG tarde unos minutos en estar disponible para Airflow.

- Agrega el DAG a la lista de DAGs disponibles.

- Ejecuta el DAG según el programa que proporcionaste en el archivo del DAG.

Espera unos cinco minutos para que Airflow tenga tiempo de procesar el archivo DAG que subiste anteriormente y completar la primera ejecución del DAG (que se explica más adelante).

En la consola de Google Cloud , ve a la página Entornos.

En la lista de entornos, haz clic en el nombre de tu entorno,

example-environment. Se abrirá la página Detalles del entorno.Ve a la pestaña DAGs.

Comprueba que el DAG

composer_quickstartesté presente en la lista de DAGs.

Figura 1. En la lista de DAGs, se muestra el DAG composer_quickstart (haz clic para ampliarlo). En la pestaña DAGs, haz clic en

composer_quickstart. Se abrirá la pestaña Ejecuciones del DAG.En la lista de ejecuciones de DAG, haz clic en la primera entrada.

Figura 2. La lista de ejecuciones del DAG composer_quickstart (haz clic para ampliar) Se muestran los detalles de la ejecución del DAG, que incluyen información sobre las tareas individuales del DAG de ejemplo.

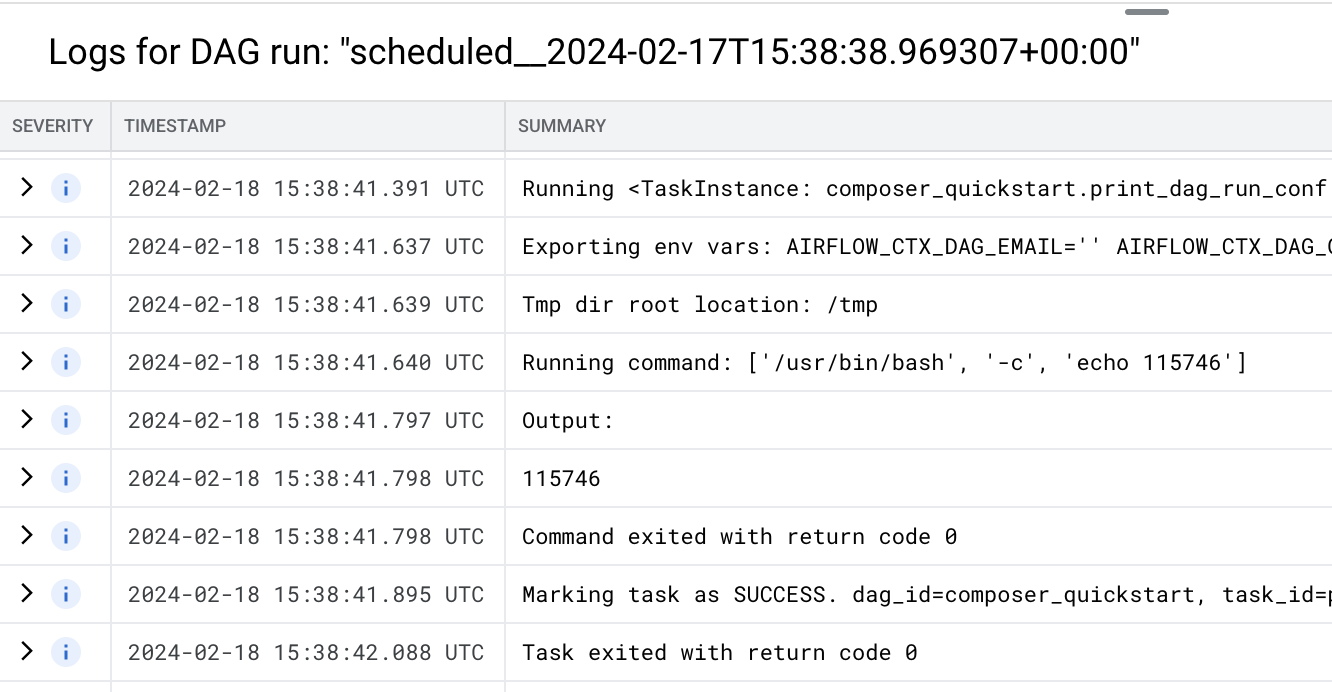

Figura 3: La lista de tareas que se ejecutaron en la ejecución del DAG (haz clic para ampliar) En la sección Logs for DAG run, se enumeran los registros de todas las tareas de la ejecución del DAG. Puedes ver el resultado del comando

echoen los registros.

Figura 4. Registros de la tarea print_dag_run_conf (haz clic para ampliar) Borra el entorno de Cloud Composer:

En la consola de Google Cloud , ve a la página Entornos.

Selecciona

example-environmenty haz clic en Borrar.Espera hasta que se borre el entorno.

Borra el bucket de tu entorno. Aunque borres el entorno de Cloud Composer, no se borra el bucket.

En la consola de Google Cloud , ve a la página Storage > Browser.

Selecciona el bucket del entorno y haz clic en Borrar. Por ejemplo, este bucket puede llamarse

us-central1-example-environ-c1616fe8-bucket.

Crea una cuenta de servicio del entorno

Cuando creas un entorno, especificas una cuenta de servicio. Esta cuenta de servicio se denomina cuenta de servicio del entorno. Tu entorno usa esta cuenta de servicio para realizar la mayoría de las operaciones.

La cuenta de servicio de tu entorno no es una cuenta de usuario. Una cuenta de servicio es un tipo especial de cuenta que usa una aplicación o una instancia de máquina virtual (VM), no una persona.

Para crear una cuenta de servicio para tu entorno, haz lo siguiente:

Crear un entorno

Crea un archivo DAG

Un DAG de Airflow es una colección de tareas organizadas que deseas programar y ejecutar. Los DAG se definen en archivos estándares de Python.

En esta guía, se usa un DAG de Airflow de ejemplo definido en el archivo quickstart.py.

El código de Python en este archivo hace lo siguiente:

Guarda una copia del archivo quickstart.py en tu máquina local:

Sube el archivo de DAG al bucket de tu entorno

Cada entorno de Cloud Composer tiene un bucket de Cloud Storage asociado. Airflow en Cloud Composer programa solo los DAG que se encuentran en la carpeta /dags de este bucket.

Para programar tu DAG, sube quickstart.py desde tu máquina local a la carpeta /dags del entorno:

Cómo ver el DAG

Después de subir el archivo DAG, Airflow hace lo siguiente:

Comprueba que tu DAG se procese sin errores y esté disponible en Airflow. Para ello, míralo en la IU del DAG. La IU del DAG es la interfaz de Cloud Composer para ver la información del DAG en la consola de Google Cloud . Cloud Composer también proporciona acceso a la IU de Airflow, que es una interfaz web nativa de Airflow.

Cómo ver los detalles de la ejecución del DAG

Una sola ejecución de un DAG se denomina ejecución del DAG. Airflow ejecuta de inmediato una ejecución de DAG para el DAG de ejemplo porque la fecha de inicio en el archivo DAG está establecida como ayer. De esta manera, Airflow se pone al día con la programación del DAG especificado.

El DAG de ejemplo contiene una tarea, print_dag_run_conf, que ejecuta el comando echo en la consola. Este comando genera información de metadatos sobre el DAG (identificador numérico de la ejecución del DAG).

Limpia

Sigue estos pasos para evitar que se apliquen cargos a tu cuenta de Google Cloud por los recursos que usaste en esta página.

Borra los recursos que se usaron en este instructivo:

¿Qué sigue?