Cloud Composer 3 | Cloud Composer 2 | Cloud Composer 1

Halaman ini mencantumkan masalah umum Cloud Composer. Untuk informasi tentang perbaikan masalah, lihat Catatan rilis.

Beberapa masalah memengaruhi versi sebelumnya, dan dapat diperbaiki dengan mengupgrade lingkungan Anda.

Rentang alamat non-RFC 1918 didukung sebagian untuk Pod dan Layanan

Cloud Composer bergantung pada GKE untuk memberikan dukungan bagi alamat non-RFC 1918 untuk Pod dan Layanan. Hanya daftar rentang Non-RFC 1918 berikut yang didukung di Cloud Composer:

- 100.64.0.0/10

- 192.0.0.0/24

- 192.0.2.0/24

- 192.88.99.0/24

- 198.18.0.0/15

- 198.51.100.0/24

- 203.0.113.0/24

- 240.0.0.0/4

UI Airflow tidak menampilkan log tugas saat Serialisasi DAG diaktifkan di Composer 1.10.2 dan Composer 1.10.3

Mengaktifkan serialisasi DAG di lingkungan yang menggunakan Composer versi 1.10.2 dan 1.10.3 mencegah log ditampilkan di server web Airflow. Upgrade ke versi 1.10.4 (atau yang lebih baru) untuk memperbaiki masalah ini.

Kegagalan Tugas Intermiten selama penjadwalan di Cloud Composer

Masalah ini terlihat di penjadwal Airflow untuk instance tugas selama eksekusi tugas. Namun, log tidak menjelaskan penyebab kegagalan tugas dan pekerja Airflow serta scheduler Airflow terlihat relatif sehat.

Pesan error pada penjadwal Airflow mungkin terlihat seperti ini:

Executor reports task instance <TaskInstance: xx.xxxx

scheduled__2022-04-21T06:00:00+00:00 [queued]> finished (failed) although the

task says its queued. (Info: None) Was the task killed externally?

Atau, mungkin ada error pada Airflow Worker yang mirip dengan pesan error berikut:

Log file is not found: gs://$BUCKET_NAME/logs/$DAG_NAME/$TASK_NAME/

2023-01-25T05:01:17.044759+00:00/1.log.

The task might not have been executed or worker executing it might have

finished abnormally (e.g. was evicted).

Untuk memastikan ketahanan terhadap error semacam itu yang berasal dari masalah lama di Airflow, sangat disarankan untuk secara proaktif menerapkan strategi coba lagi yang sesuai di tingkat tugas dan DAG. Dengan menggabungkan langkah-langkah ini, sistem dapat secara efektif meminimalkan dampak error ini, sehingga meningkatkan keandalan dan ketahanan alur kerja secara keseluruhan.

GKE Workload Identity Federation for GKE tidak didukung

Di Cloud Composer 1, Anda tidak dapat mengaktifkan

Workload Identity Federation for GKE untuk

cluster lingkungan Cloud Composer. Akibatnya, Anda mungkin melihat temuan WORKLOAD_IDENTITY_DISABLED di Security Command Center.

Label lingkungan yang ditambahkan selama update tidak sepenuhnya diterapkan

Saat Anda memperbarui label lingkungan, label tersebut tidak diterapkan ke VM Compute Engine di cluster lingkungan. Sebagai solusi, Anda dapat menerapkan label secara manual.

Log tugas Airflow tidak tersedia di server web Airflow setelah mengupgrade dari Airflow 1.9.0 ke Airflow 1.10.x

Airflow 1.10.x memperkenalkan perubahan yang tidak kompatibel dengan versi lama pada konvensi penamaan file log. Informasi zona kini ditambahkan ke nama log untuk tugas Airflow.

Airflow 1.9.0 menyimpan dan mengharapkan nama log dalam format berikut:

BUCKET/logs/DAG/2020-03-30T10:29:06/1.log

Airflow 1.10.x menyimpan dan mengharapkan nama log dalam format berikut:

BUCKET/logs/DAG/2020-03-30T10:29:06+00:00/1.log

Akibatnya, jika Anda mengupgrade dari Airflow 1.9.0 ke Airflow 1.10.x

dan ingin membaca log untuk tugas yang dieksekusi dengan Airflow 1.9.0,

server Web Airflow akan menampilkan pesan error berikut:

Unable to read remote log from BUCKET/logs/DAG/2020-03-30T10:29:06+00:00/1.log

Solusi: Ganti nama log yang dihasilkan oleh Airflow 1.9.0 di

bucket Cloud Storage menggunakan format:

BUCKET/logs/DAG/2020-03-30T10:29:06+00:00/1.log

Tidak dapat membuat lingkungan Cloud Composer dengan batasan kebijakan organisasi/compute.disableSerialPortLogging yang diterapkan

Pembuatan lingkungan Cloud Composer gagal jika kebijakan organisasi constraints/compute.disableSerialPortLogging diterapkan pada project target.

Diagnosis

Untuk mengetahui apakah Anda terpengaruh oleh masalah ini, ikuti prosedur berikut:

Buka menu GKE di konsolGoogle Cloud . Buka menu GKE

Kemudian, pilih cluster yang baru Anda buat. Periksa error berikut:

Not all instances running in IGM after 123.45s.

Expect <number of desired instances in IGM>. Current errors:

Constraint constraints/compute.disableSerialPortLogging violated for

project <target project number>.

Solusi:

Nonaktifkan kebijakan organisasi di project tempat lingkungan Cloud Composer akan dibuat.

Kebijakan organisasi dapat selalu dinonaktifkan di tingkat project meskipun kebijakan tersebut diaktifkan di resource induk (organisasi atau folder). Lihat halaman Menyesuaikan kebijakan untuk batasan boolean untuk mengetahui detail selengkapnya.

Menggunakan filter pengecualian

Menggunakan filter pengecualian untuk log port serial. mencapai tujuan yang sama dengan menonaktifkan kebijakan org, karena akan ada log konsol serial di Logging. Untuk mengetahui detail selengkapnya, lihat halaman Filter pengecualian.

Penggunaan Deployment Manager untuk mengelola Google Cloud resource yang dilindungi oleh Kontrol Layanan VPC

Cloud Composer 1 dan Cloud Composer 2 versi 2.0.x menggunakan Deployment Manager untuk membuat komponen lingkungan Cloud Composer.

Pada Desember 2020, Anda mungkin telah menerima informasi bahwa Anda perlu melakukan konfigurasi Kontrol Layanan VPC tambahan agar dapat menggunakan Deployment Manager untuk mengelola resource yang dilindungi oleh Kontrol Layanan VPC.

Kami ingin mengklarifikasi bahwa tidak ada tindakan yang perlu Anda lakukan jika Anda menggunakan Cloud Composer dan tidak menggunakan Deployment Manager secara langsung untuk mengelola Google Cloud resource yang disebutkan dalam pengumuman Deployment Manager.

Deployment Manager menampilkan informasi tentang fitur yang tidak didukung

Anda mungkin melihat peringatan berikut di tab Deployment Manager:

The deployment uses actions, which are an unsupported feature. We recommend

that you avoid using actions.

Untuk deployment Deployment Manager yang dimiliki oleh Cloud Composer, Anda dapat mengabaikan peringatan ini.

Tidak dapat menghapus lingkungan setelah clusternya dihapus

Masalah ini berlaku untuk Cloud Composer 1 dan Cloud Composer 2 versi 2.0.x.

Jika Anda menghapus cluster GKE lingkungan sebelum lingkungan itu sendiri, upaya untuk menghapus lingkungan akan menghasilkan error berikut:

Got error "" during CP_DEPLOYMENT_DELETING [Rerunning Task. ]

Untuk menghapus lingkungan saat cluster-nya sudah dihapus:

Di konsol Google Cloud , buka halaman Deployment Manager.

Menemukan semua deployment yang ditandai dengan label:

goog-composer-environment:<environment-name>goog-composer-location:<environment-location>.

Anda akan melihat dua deployment yang ditandai dengan label yang dijelaskan:

- Deployment bernama

<environment-location>-<environment-name-prefix>-<hash>-sd - Deployment bernama

addons-<uuid>

Hapus secara manual resource yang masih tercantum dalam dua deployment ini dan ada dalam project (misalnya, topik dan langganan Pub/Sub). Untuk melakukannya:

Pilih deployment.

Klik Hapus.

Pilih opsi Hapus 2 deployment dan semua resource yang dibuat olehnya, seperti VM, load balancer, dan disk, lalu klik Hapus semua.

Operasi penghapusan gagal, tetapi resource yang tersisa dihapus.

Hapus deployment menggunakan salah satu opsi berikut:

Di Google Cloud console, pilih kembali kedua deployment. Klik Hapus, lalu pilih opsi Hapus 2 deployment, tetapi pertahankan resource yang dibuat olehnya.

Jalankan perintah gcloud untuk menghapus deployment dengan kebijakan

ABANDON:gcloud deployment-manager deployments delete addons-<uuid> \ --delete-policy=ABANDON gcloud deployment-manager deployments delete <location>-<env-name-prefix>-<hash>-sd \ --delete-policy=ABANDON

Peringatan tentang entri duplikat tugas 'echo' yang termasuk dalam DAG 'echo-airflow_monitoring'

Anda mungkin melihat entri berikut di log Airflow:

in _query db.query(q) File "/opt/python3.6/lib/python3.6/site-packages/MySQLdb/

connections.py", line 280, in query _mysql.connection.query(self, query)

_mysql_exceptions.IntegrityError: (1062, "Duplicate entry

'echo-airflow_monitoring-2020-10-20 15:59:40.000000' for key 'PRIMARY'")

Anda dapat mengabaikan entri log ini, karena error ini tidak memengaruhi pemrosesan DAG dan tugas Airflow.

Kami berupaya meningkatkan kualitas layanan Cloud Composer untuk menghapus peringatan ini dari log Airflow.

Pembuatan lingkungan gagal di project dengan Identity-Aware Proxy API yang ditambahkan ke perimeter Kontrol Layanan VPC

Di project dengan Kontrol Layanan VPC diaktifkan,

akun cloud-airflow-prod@system.gserviceaccount.com memerlukan akses eksplisit

di perimeter keamanan Anda untuk membuat lingkungan.

Untuk membuat lingkungan, Anda dapat menggunakan salah satu solusi berikut:

Jangan menambahkan Cloud Identity-Aware Proxy API dan Identity-Aware Proxy TCP API ke perimeter keamanan.

Tambahkan akun layanan

cloud-airflow-prod@system.gserviceaccount.comsebagai anggota perimeter keamanan Anda dengan menggunakan konfigurasi berikut dalam file kondisi YAML:- members: - serviceAccount:cloud-airflow-prod@system.gserviceaccount.com

Pembuatan lingkungan Cloud Composer 1 gagal saat kebijakan compute.requireOsLogin diaktifkan

Jika kebijakan compute.requireOsLogin disetel ke true di project Anda, maka operasi pembuatan lingkungan Cloud Composer 1 v1 akan gagal.

Untuk membuat lingkungan Cloud Composer 1, nonaktifkan kebijakan ini di project Anda.

Untuk mengetahui informasi selengkapnya tentang kebijakan organisasi ini, lihat Batasan kebijakan organisasi.

Pembuatan atau upgrade lingkungan Cloud Composer gagal jika kebijakan compute.vmExternalIpAccess dinonaktifkan

Masalah ini berlaku untuk lingkungan Cloud Composer 1 dan Cloud Composer 2.

Cluster GKE milik Cloud Composer yang dikonfigurasi dalam

mode IP Publik memerlukan konektivitas eksternal untuk VM-nya. Oleh karena itu, kebijakan compute.vmExternalIpAccess tidak dapat melarang pembuatan VM dengan alamat IP eksternal. Untuk mengetahui informasi selengkapnya tentang kebijakan organisasi ini, lihat Batasan kebijakan organisasi.

Pembuatan lingkungan Cloud Composer 1 gagal jika kebijakan compute.vmCanIpForward dinonaktifkan

Lingkungan Cloud Composer 1 yang dibuat dalam mode non-VPC-Native (menggunakan IP alias) memerlukan kebijakan ini untuk mengizinkan pembuatan VM dengan fitur Penerusan IP yang diaktifkan. Untuk mengetahui informasi selengkapnya tentang kebijakan organisasi ini, lihat Batasan kebijakan organisasi.

Operasi DAG pertama untuk file DAG yang diupload memiliki beberapa tugas yang gagal

Saat Anda mengupload file DAG, terkadang beberapa tugas pertama dari DAG pertama

yang dijalankan gagal dengan error Unable to read remote log.... Masalah ini terjadi karena file DAG disinkronkan antara bucket lingkungan, worker Airflow, dan penjadwal Airflow di lingkungan Anda. Jika scheduler mendapatkan file DAG dan menjadwalkannya untuk dieksekusi oleh worker, dan jika worker belum memiliki file DAG, maka eksekusi tugas akan gagal.

Untuk mengurangi masalah ini, lingkungan dengan Airflow 2 dikonfigurasi untuk melakukan dua kali percobaan ulang untuk tugas yang gagal secara default. Jika gagal, tugas akan dicoba lagi dua kali dengan interval 5 menit.

Untuk memitigasi masalah ini di Airflow 1, ganti

opsi konfigurasi Airflow [core]default_task_retries dan tetapkan ke

angka yang lebih besar dari atau sama dengan 2.

Tugas gagal dengan 'OSError: [Errno 5] Input/output error' di Airflow 1.10.15 atau versi yang lebih lama

Bug di versi Airflow 1 menyebabkan tugas dimasukkan ke antrean tugas lingkungan dua kali dalam beberapa kasus yang jarang terjadi.

Terkadang, hal ini dapat menyebabkan kondisi race pada file log, dan kegagalan tugas berikutnya. Tugas gagal dengan OSError: [Errno 5] Input/output error di

Cloud Logging dan

Task is in the 'running' state which is not a valid state for execution.

di log upaya tugas.

Bug ini telah diperbaiki di Airflow 2. Jika Anda mengalami masalah ini di Airflow 1

dalam tugas yang berjalan lama,

tingkatkan nilai

opsi konfigurasi Airflow [celery_broker_transport_options]visibility_timeout (nilai defaultnya adalah 604800 untuk Composer 1.17.0,

21600 untuk lingkungan yang lebih lama). Untuk tugas yang berjalan singkat, pertimbangkan untuk menambahkan percobaan ulang tambahan ke tugas yang terpengaruh atau memigrasikan lingkungan Anda ke Airflow 2.

Operator Dataproc dan Dataflow gagal dengan Negsignal.SIGSEGV

Masalah ini adalah masalah sementara pada library grcpio, saat digunakan dari pekerja Celery. Masalah ini memengaruhi Airflow 1.10.14 dan versi yang lebih baru.

Solusinya adalah mengubah strategi polling grpcio dengan

menambahkan variabel lingkungan berikut

ke lingkungan Anda: GRPC_POLL_STRATEGY=epoll1. Solusi ini sudah diterapkan di Cloud Composer versi 1.17.1 dan yang lebih baru.

Pengumuman tentang penghapusan dukungan untuk API Beta yang tidak digunakan lagi dari versi GKE

Cloud Composer mengelola cluster GKE pokok yang dimiliki Cloud Composer. Kecuali jika Anda secara eksplisit menggunakan API tersebut di DAG dan kode Anda, Anda dapat mengabaikan pengumuman tentang penghentian penggunaan GKE API. Cloud Composer akan menangani migrasi apa pun, jika diperlukan.

Cloud Composer tidak akan terpengaruh oleh Kerentanan Apache Log4j 2 (CVE-2021-44228)

Sebagai respons terhadap Kerentanan Apache Log4j 2 (CVE-2021-44228), Cloud Composer telah melakukan penyelidikan mendetail dan kami yakin bahwa Cloud Composer tidak rentan terhadap eksploitasi ini.

Worker atau scheduler Airflow mungkin mengalami masalah saat mengakses bucket Cloud Storage lingkungan

Cloud Composer menggunakan gcsfuse untuk mengakses folder /data di bucket lingkungan dan menyimpan log tugas Airflow ke direktori /logs (jika diaktifkan). Jika gcsfuse kelebihan beban atau bucket lingkungan tidak tersedia, Anda mungkin mengalami kegagalan instance tugas Airflow dan melihat error Transport endpoint is not connected di log Airflow.

Solusi:

- Nonaktifkan penyimpanan log ke bucket lingkungan. Opsi ini sudah dinonaktifkan secara default jika lingkungan dibuat menggunakan Cloud Composer 2.8.0 atau versi yang lebih baru.

- Upgrade ke Cloud Composer versi 2.8.0 atau yang lebih baru.

- Kurangi

[celery]worker_concurrencydan tingkatkan jumlah pekerja Airflow. - Kurangi jumlah log yang dihasilkan dalam kode DAG.

- Ikuti rekomendasi dan praktik terbaik untuk menerapkan DAG dan mengaktifkan percobaan ulang tugas.

UI Airflow terkadang tidak memuat ulang plugin setelah diubah

Jika plugin terdiri dari banyak file yang mengimpor modul lain, UI Airflow mungkin tidak dapat mengenali fakta bahwa plugin harus dimuat ulang. Dalam kasus seperti itu, mulai ulang server web Airflow di lingkungan Anda.

Masalah terputus-putus saat berkomunikasi dengan database lingkungan

Masalah umum ini hanya berlaku untuk Cloud Composer 1.

Beberapa lingkungan Cloud Composer 1 (1.16.3 atau yang lebih lama) yang dibuat sebelum 12 Agustus 2021 mungkin mengalami masalah sementara terkait komunikasi ke database Airflow.

Jika Anda mengalami masalah ini, Anda akan melihat pesan error berikut di log tugas Airflow:

"Can't connect to MySQL server on 'airflow-sqlproxy-service.default.svc.cluster.local' (104)"

Tim Cloud Composer sedang berupaya menyelesaikan masalah ini. Sementara itu, jika Anda merasa sangat terpengaruh oleh masalah ini, Anda dapat melakukan tindakan berikut untuk mengatasinya:

Di Google Cloud konsol, buka halaman Environment Configuration dari lingkungan Cloud Composer yang terpengaruh.

Ikuti link lihat detail cluster untuk menavigasi ke cluster GKE yang mendasari lingkungan.

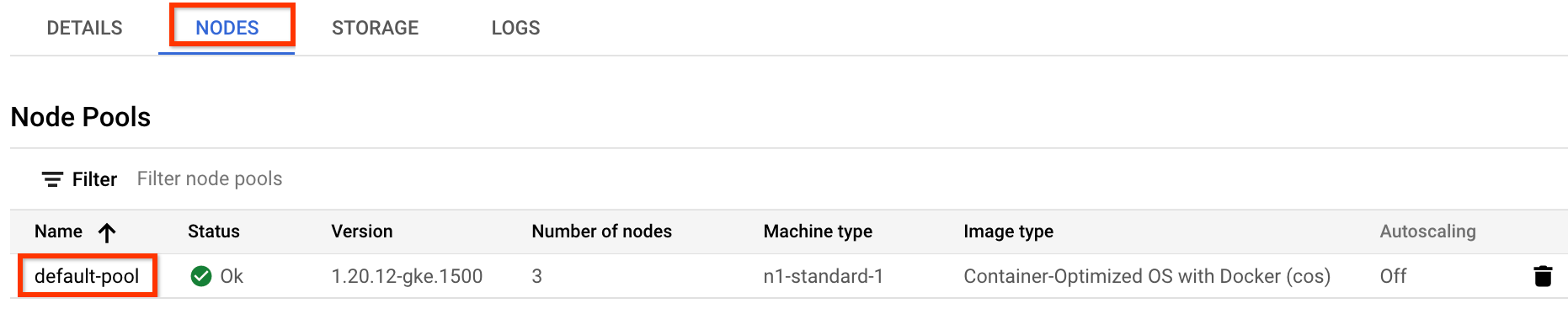

Buka tab Nodes, lalu klik default-pool yang terlihat di bagian Node Pools.

Gambar 1. default-pool dalam daftar Node pool (klik untuk memperbesar) Klik Edit di bagian atas halaman.

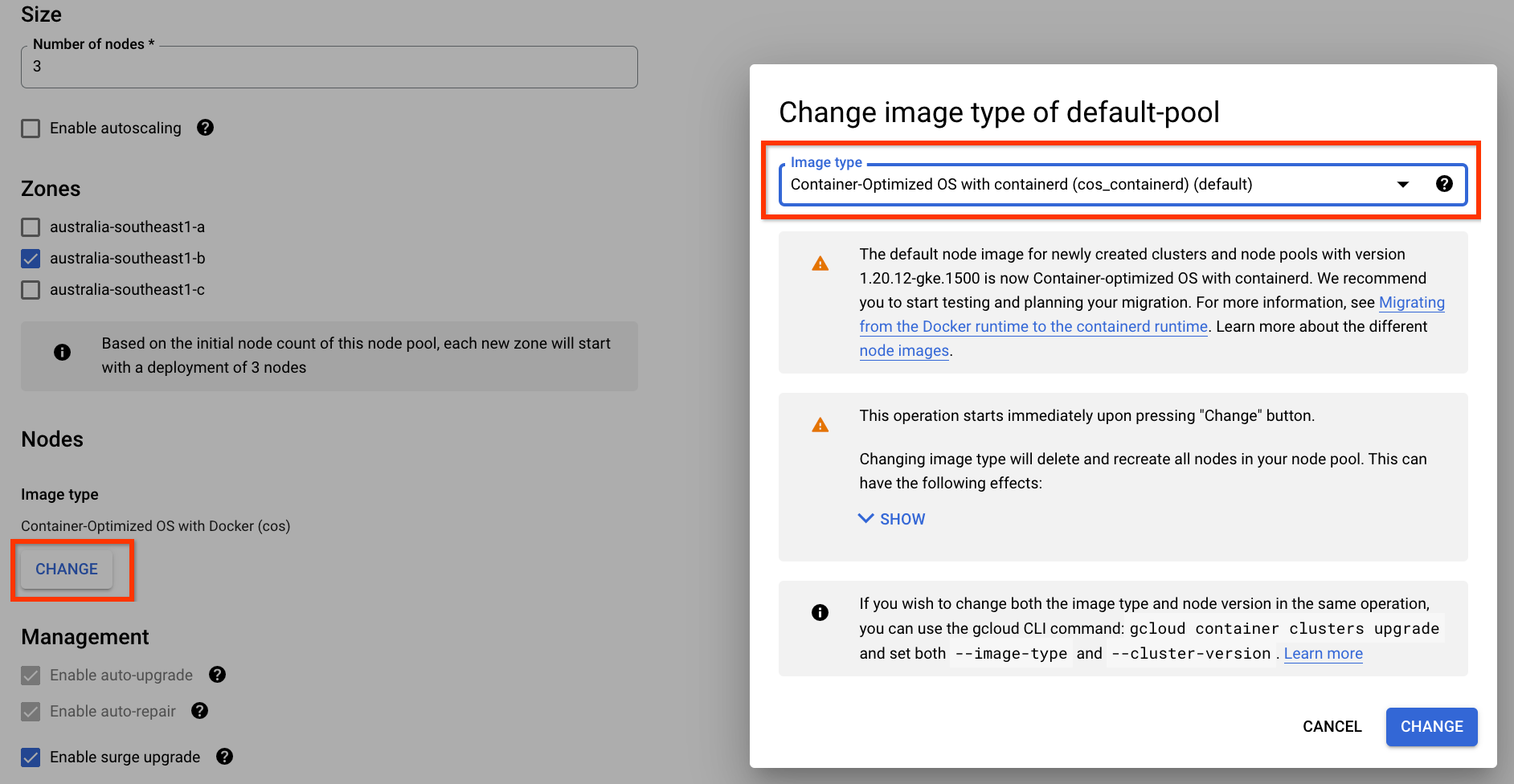

Ubah jenis image menjadi Container-Optimized OS dengan containerd dan simpan konfigurasi:

Gambar 2. Mengubah jenis image Node Pool dari Docker ke containerd (klik untuk memperbesar) Setelah perubahan dikirimkan, node pool default-pool akan dikonfigurasi ulang untuk menggunakan containerd sebagai runtime container-nya. Beberapa tugas Airflow Anda mungkin gagal saat node pool dikonfigurasi ulang. Jika tugas tersebut telah dikonfigurasi untuk percobaan ulang, tugas tersebut akan dijalankan ulang oleh Airflow setelah operasi di node pool selesai.

Error 504 saat mengakses UI Airflow

Anda dapat mengalami error 504 Gateway Timeout saat mengakses UI Airflow. Error ini dapat disebabkan oleh beberapa hal:

Masalah komunikasi sementara. Dalam hal ini, coba akses UI Airflow nanti. Anda juga dapat memulai ulang server web Airflow.

(Khusus Cloud Composer 3) Masalah konektivitas. Jika UI Airflow tidak tersedia secara permanen, dan error waktu tunggu atau 504 terjadi, pastikan lingkungan Anda dapat mengakses

*.composer.googleusercontent.com.(Khusus Cloud Composer 2) Masalah konektivitas. Jika UI Airflow tidak tersedia secara permanen, dan error waktu tunggu atau 504 terjadi, pastikan lingkungan Anda dapat mengakses

*.composer.cloud.google.com. Jika Anda menggunakan Private Google Access dan mengirim traffic melalui IP Virtualprivate.googleapis.com, atau Kontrol Layanan VPC dan mengirim traffic melalui IP Virtualrestricted.googleapis.com, pastikan Cloud DNS Anda juga dikonfigurasi untuk nama domain*.composer.cloud.google.com.Server web Airflow tidak responsif. Jika error 504 terus terjadi, tetapi Anda masih dapat mengakses UI Airflow pada waktu tertentu, server web Airflow mungkin tidak merespons karena kelebihan beban. Berupaya meningkatkan parameter skala dan performa server web.

Error 502 saat mengakses UI Airflow

Error 502 Internal server exception menunjukkan bahwa UI Airflow tidak dapat melayani permintaan masuk. Error ini dapat disebabkan oleh beberapa hal:

Masalah komunikasi sementara. Coba akses UI Airflow nanti.

Gagal memulai server web. Untuk memulai, server web memerlukan file konfigurasi yang disinkronkan terlebih dahulu. Periksa log server web untuk menemukan entri log yang terlihat mirip dengan:

GCS sync exited with 1: gcloud storage cp gs://<bucket-name>/airflow.cfg /home/airflow/gcs/airflow.cfg.tmpatauGCS sync exited with 1: gcloud storage cp gs://<bucket-name>/env_var.json.cfg /home/airflow/gcs/env_var.json.tmp. Jika Anda melihat error ini, periksa apakah file yang disebutkan dalam pesan error masih ada di bucket lingkungan.Jika item tersebut tidak sengaja dihapus (misalnya, karena kebijakan retensi dikonfigurasi), Anda dapat memulihkannya:

Tetapkan variabel lingkungan baru di lingkungan Anda. Anda dapat menggunakan nama dan nilai variabel apa pun.

Mengganti opsi konfigurasi Airflow. Anda dapat menggunakan opsi konfigurasi Airflow yang tidak ada.

UI Airflow di Airflow 2.2.3 atau versi yang lebih lama rentan terhadap CVE-2021-45229

Seperti yang ditunjukkan dalam CVE-2021-45229,

layar "Trigger DAG with config" rentan terhadap serangan XSS

melalui argumen kueri origin.

Rekomendasi: Upgrade ke Cloud Composer versi terbaru yang mendukung Airflow 2.2.5.

Pemicuan DAG melalui jaringan pribadi menggunakan fungsi Cloud Run

Pemicuan DAG dengan fungsi Cloud Run melalui jaringan pribadi dengan penggunaan Konektor VPC tidak didukung oleh Cloud Composer.

Rekomendasi: Gunakan fungsi Cloud Run untuk memublikasikan pesan di Pub/Sub. Peristiwa tersebut dapat menggerakkan Sensor Pub/Sub untuk memicu DAG Airflow atau menerapkan pendekatan berdasarkan operator yang dapat ditangguhkan.

Folder kosong di Scheduler dan Workers

Cloud Composer tidak secara aktif menghapus folder kosong dari pekerja dan penjadwal Airflow. Entitas tersebut mungkin dibuat sebagai hasil dari proses sinkronisasi bucket lingkungan saat folder ini ada di bucket dan akhirnya dihapus.

Rekomendasi: Sesuaikan DAG Anda agar siap melewati folder kosong tersebut.

Entitas tersebut pada akhirnya akan dihapus dari penyimpanan lokal penjadwal dan pekerja Airflow saat komponen ini dimulai ulang (misalnya, sebagai akibat dari operasi penskalaan atau pemeliharaan di cluster lingkungan Anda).

Dukungan untuk Kerberos

Cloud Composer tidak mendukung konfigurasi Kerberos Airflow.

Dukungan untuk Operator Google Campaign Manager 360

Operator Google Campaign Manager di Cloud Composer versi yang lebih lama dari 2.1.13 didasarkan pada Campaign Manager 360 API v3.5 yang tidak digunakan lagi dan tanggal penghentiannya adalah 1 Mei 2023.

Jika Anda menggunakan operator Google Campaign Manager, upgrade lingkungan Anda ke Cloud Composer versi 2.1.13 atau yang lebih baru.

Dukungan untuk Operator Google Display & Video 360

Operator Google Display & Video 360 di Cloud Composer versi sebelum 2.1.13 didasarkan pada Display & Video 360 API v1.1 yang tidak digunakan lagi dan tanggal penghentiannya adalah 27 April 2023.

Jika Anda menggunakan operator Google Display & Video 360, upgrade lingkungan Anda ke Cloud Composer versi 2.1.13 atau yang lebih baru. Selain itu, Anda mungkin perlu mengubah DAG karena beberapa operator Google Display & Video 360 tidak digunakan lagi dan diganti dengan operator baru.

GoogleDisplayVideo360CreateReportOperatortidak digunakan lagi. Sebagai gantinya, gunakanGoogleDisplayVideo360CreateQueryOperator. Operator ini menampilkanquery_id, bukanreport_id.GoogleDisplayVideo360RunReportOperatortidak digunakan lagi. Sebagai gantinya, gunakanGoogleDisplayVideo360RunQueryOperator. Operator ini menampilkanquery_iddanreport_id, bukan hanyareport_id, dan memerlukanquery_id, bukanreport_idsebagai parameter.- Untuk memeriksa apakah laporan sudah siap, gunakan sensor

GoogleDisplayVideo360RunQuerySensorbaru yang menggunakan parameterquery_iddanreport_id. SensorGoogleDisplayVideo360ReportSensoryang tidak digunakan lagi hanya memerlukanreport_id. GoogleDisplayVideo360DownloadReportV2Operatorkini memerlukan parameterquery_iddanreport_id.- Di

GoogleDisplayVideo360DeleteReportOperator, tidak ada perubahan yang dapat memengaruhi DAG Anda.

Batasan nama Rentang Sekunder

CVE-2023-29247 (Halaman detail instance tugas di UI rentan terhadap XSS tersimpan)

UI Airflow di Airflow versi 2.0.x hingga 2.5.x rentan terhadap CVE-2023-29247.

Jika Anda menggunakan Cloud Composer versi yang lebih lama dari 2.4.2 dan mencurigai bahwa lingkungan Anda mungkin rentan terhadap eksploitasi, baca deskripsi dan kemungkinan solusi berikut.

Di Cloud Composer, akses ke UI Airflow dilindungi dengan IAM dan kontrol akses UI Airflow.

Artinya, untuk mengeksploitasi kerentanan UI Airflow, penyerang harus mendapatkan akses ke project Anda terlebih dahulu beserta izin dan peran IAM yang diperlukan.

Solusi:

Verifikasi izin dan peran IAM di project Anda, termasuk peran Cloud Composer yang ditetapkan kepada pengguna perorangan. Pastikan hanya pengguna yang disetujui yang dapat mengakses UI Airflow.

Verifikasi peran yang ditetapkan kepada pengguna melalui mekanisme kontrol akses UI Airflow (ini adalah mekanisme terpisah yang memberikan akses yang lebih terperinci ke UI Airflow). Pastikan hanya pengguna yang disetujui yang dapat mengakses UI Airflow dan semua pengguna baru terdaftar dengan peran yang sesuai.

Pertimbangkan penguatan tambahan dengan Kontrol Layanan VPC.

Penyimpanan Cloud SQL tidak dapat dikurangi

Cloud Composer menggunakan Cloud SQL untuk menjalankan database Airflow. Seiring waktu, penyimpanan disk untuk instance Cloud SQL dapat bertambah karena disk di-scale up agar sesuai dengan data yang disimpan oleh operasi Cloud SQL saat database Airflow bertambah.

Ukuran disk Cloud SQL tidak dapat diperkecil.

Sebagai solusi sementara, jika ingin menggunakan ukuran disk Cloud SQL terkecil, Anda dapat membuat ulang lingkungan Cloud Composer dengan snapshot.

Metrik Penggunaan Disk Database tidak berkurang setelah menghapus data dari Cloud SQL

Database relasional, seperti Postgres atau MySQL, tidak menghapus baris secara fisik saat baris tersebut dihapus atau diperbarui. Sebagai gantinya, tuple tersebut ditandai sebagai "tuple tidak aktif" untuk mempertahankan konsistensi data dan menghindari pemblokiran transaksi serentak.

MySQL dan Postgres menerapkan mekanisme untuk merebut kembali ruang setelah menghapus data.

Meskipun database dapat dipaksa untuk merebut kembali ruang disk yang tidak digunakan, hal ini merupakan operasi yang memakan banyak resource dan mengunci database sehingga Cloud Composer tidak tersedia. Oleh karena itu, sebaiknya gunakan mekanisme pembangunan untuk merebut kembali ruang yang tidak digunakan.

Instance tugas yang berhasil di masa lalu ditandai sebagai GAGAL

Dalam beberapa situasi dan skenario yang jarang terjadi, instance tugas Airflow yang berhasil

di masa lalu dapat ditandai sebagai FAILED.

Jika hal ini terjadi, biasanya dipicu oleh operasi upgrade atau update lingkungan, atau oleh pemeliharaan GKE.

Catatan: masalah itu sendiri tidak menunjukkan adanya masalah di lingkungan dan tidak menyebabkan kegagalan aktual dalam eksekusi tugas.

Masalah ini telah diperbaiki di Cloud Composer versi 2.6.5 atau yang lebih baru.

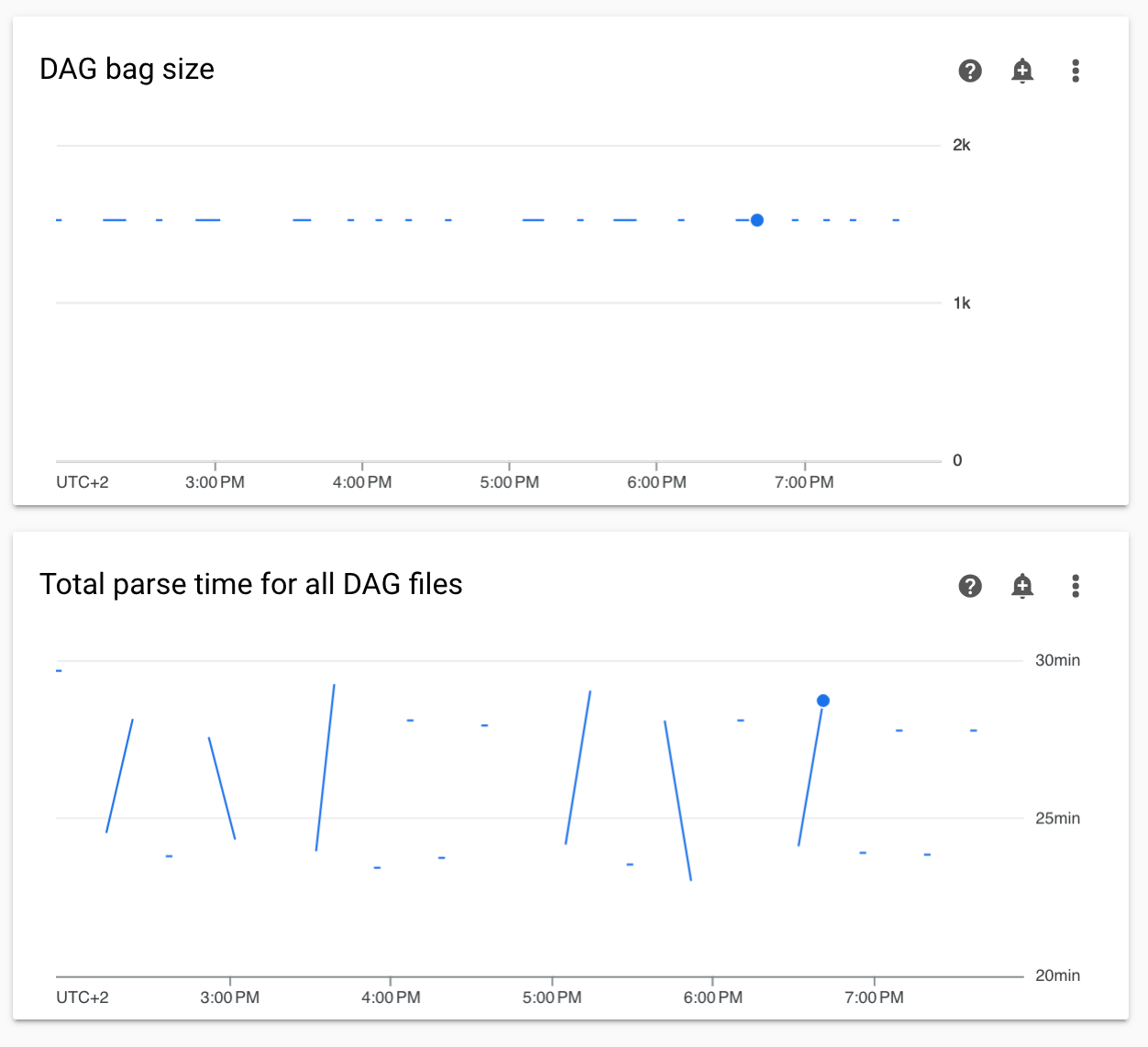

Diagram waktu penguraian DAG yang tidak berkelanjutan dan ukuran DAG bag dalam pemantauan

Diagram waktu parsing DAG yang tidak berkelanjutan dan ukuran DAG di dasbor pemantauan menunjukkan masalah dengan waktu parsing DAG yang lama (lebih dari 5 menit).

Solusi: Sebaiknya pertahankan total waktu penguraian DAG di bawah 5 menit. Untuk mengurangi waktu parsing DAG, ikuti pedoman penulisan DAG.

Mengalihkan cluster lingkungan ke GKE Enterprise Edition tidak didukung

Catatan ini berlaku untuk Cloud Composer 1 dan Cloud Composer 2.

Cluster GKE lingkungan Cloud Composer dibuat dalam GKE Standard Edition.

Mulai Desember 2024, layanan Cloud Composer tidak mendukung pembuatan lingkungan Cloud Composer dengan cluster di Edisi Enterprise.

Lingkungan Cloud Composer tidak diuji dengan GKE Enterprise Edition dan memiliki model penagihan yang berbeda.

Komunikasi lebih lanjut terkait GKE Standard Edition versus edisi Enterprise akan dilakukan pada Kuartal 2 2025.

Lingkungan dalam status ERROR setelah akun penagihan project dihapus atau dinonaktifkan, atau Cloud Composer API dinonaktifkan

Lingkungan Cloud Composer yang terpengaruh oleh masalah ini tidak dapat dipulihkan:

- Setelah akun penagihan project dihapus atau dinonaktifkan, meskipun akun lain ditautkan kemudian.

- Setelah Cloud Composer API dinonaktifkan di project, meskipun diaktifkan kembali.

Anda dapat melakukan hal berikut untuk mengatasi masalah ini:

Anda masih dapat mengakses data yang disimpan di bucket lingkungan Anda, tetapi lingkungan itu sendiri tidak dapat digunakan lagi. Anda dapat membuat lingkungan Cloud Composer baru, lalu mentransfer DAG dan data Anda.

Jika Anda ingin melakukan operasi apa pun yang membuat lingkungan Anda tidak dapat dipulihkan, pastikan untuk mencadangkan data Anda, misalnya, dengan membuat snapshot lingkungan. Dengan cara ini, Anda dapat membuat lingkungan lain dan mentransfer datanya dengan memuat snapshot ini.

Peringatan tentang Anggaran Gangguan Pod untuk cluster lingkungan

Anda dapat melihat peringatan berikut di UI GKE untuk cluster lingkungan Cloud Composer:

GKE can't perform maintenance because the Pod Disruption Budget allows

for 0 Pod evictions. Update the Pod Disruption Budget.

A StatefulSet is configured with a Pod Disruption Budget but without readiness

probes, so the Pod Disruption Budget isn't as effective in gauging application

readiness. Add one or more readiness probes.

Peringatan ini tidak dapat dihilangkan. Kami berupaya menghentikan pembuatan peringatan ini.

Kemungkinan solusi:

- Abaikan peringatan ini hingga masalahnya diperbaiki.

Nilai kolom dalam koneksi Airflow tidak dapat dihapus

Penyebab:

Antarmuka pengguna Apache Airflow memiliki batasan yang tidak memungkinkan pembaruan kolom koneksi ke nilai kosong. Saat Anda mencoba melakukannya, sistem akan kembali ke setelan yang disimpan sebelumnya.

Kemungkinan solusi:

Meskipun Apache Airflow versi 2.10.4 menyertakan perbaikan permanen, ada solusi sementara untuk pengguna yang menggunakan versi sebelumnya. Hal ini melibatkan penghapusan koneksi, lalu membuatnya kembali, khususnya dengan mengosongkan kolom yang wajib diisi. Antarmuka command line adalah pendekatan yang direkomendasikan untuk menghapus koneksi:

gcloud composer environments run ENVIRONMENT_NAME \

--location LOCATION \

connections delete -- \

CONNECTION_ID

Setelah menghapus koneksi, buat ulang menggunakan UI Airflow, pastikan kolom yang ingin Anda biarkan kosong memang dibiarkan kosong. Anda juga dapat membuat koneksi dengan menjalankan perintah connections add Airflow CLI dengan Google Cloud CLI.

Log untuk tugas Airflow tidak dikumpulkan jika [core]execute_tasks_new_python_interpreter disetel ke True

Cloud Composer tidak mengumpulkan log untuk tugas Airflow jika opsi konfigurasi Airflow [core]execute_tasks_new_python_interpreter ditetapkan ke True.

Solusi yang mungkin:

- Hapus penggantian untuk opsi konfigurasi ini, atau tetapkan

nilainya ke

False.