Looker の信頼できる指標を活用した分析 AI エージェントのグラウンディング

John Marshall

VP of Services, Bytecode

※この投稿は米国時間 2024 年 8 月 29 日に、Google Cloud blog に投稿されたものの抄訳です。

生成 AI の発展と導入により、ユーザーはこれまでと違う方法でプロダクトやサービスを扱えるようになりました。組織はこれまで、信頼できるセルフサービス型分析機能の構築に多大な時間とリソースを費やしてきましたが、AI によって、ユーザーがビジネスデータを扱える方法に革命が起きています。たとえば、ユーザーはクエリを作成する代わりに、音声や自然言語を使って質問を入力できます。AI は、ユーザーとクエリされるデータの間に位置する「魔法」のようなもので、どのようなインタラクションやエクスペリエンスをユーザーに提供するかは、プロダクト チームやエンジニアリング チームに任されています。

この 10 年間 Bytecode は、1,000 を超える組織がデータスタックと Looker を構築し、信頼性の高いセルフサービス型分析を実現できるよう支援してきました。現在、お客様からよく聞かれるのは、AI を分析に導入するにはどうすればよいか、導入にはどれくらい時間がかかるか、ということです。Google Cloud の垂直統合されたデータと AI クラウド(BigQuery、Looker、Vertex AI)に投資してきたお客様は、AI の導入が予想以上に簡単かつ迅速であることがわかり、とても喜んでいます。

生成 AI の時代において Looker をご利用のお客様には、信頼性の高いインサイトを迅速に得て AI を活用したビジネス インテリジェンスを実現するために Looker の信頼できる指標を分析エージェントまで拡張することで、ごく短時間で価値を実現できるという利点がもたらされています。

多くの生成 AI ユースケースの中心にあるものが大規模言語モデル(LLM)です。大量のデータで事前トレーニングされた、利用可能な LLM の数は増え続けています。こうした LLM は一般的に、テキストやその他のモダリティを解釈、翻訳、要約する能力には優れていますが、お客様のデータやビジネスに焦点を当てた知識に関しては、大部分がまだ不十分です。組織がデータに AI の「魔法」をかけるまでにかかる時間は、ユーザーが不満を感じる時間と基本的に同じです。既製の LLM は(まだ)お客様固有の言葉を話すようトレーニングされていなければ、お客様独自のビジネスを理解してもいません。LLM が生成した定義と実際のビジネス用語が異なると不満が生じる可能性があります。分析のユースケースでは、これは特に明確となります。たとえば、皆様の組織では価値の高いお客様をどのように定義していますか?全期間を通じた購入金額、最終購入日、繰り返し購入の頻度を組み合わせて定義しているかもしれません。組み合わせは無限にあり、ビジネスごとに異なります。

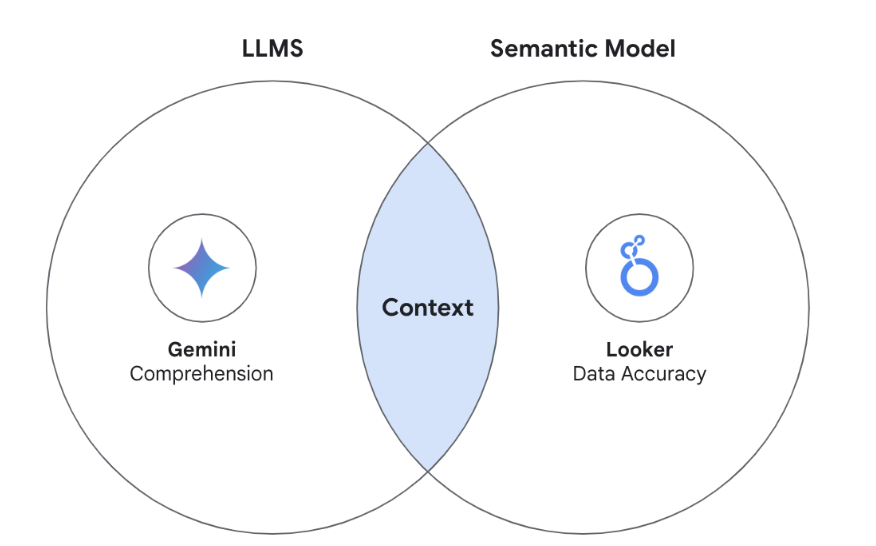

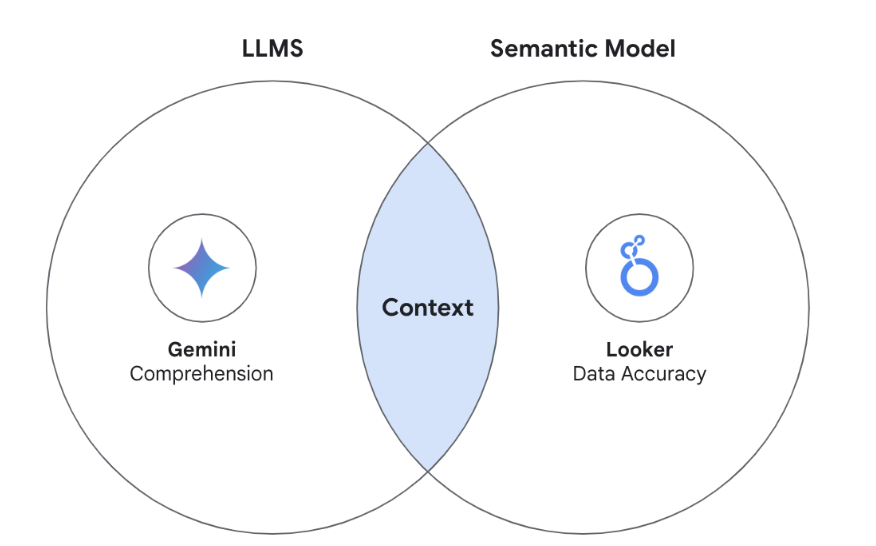

データに関するこのジレンマは、Looker のセマンティック モデリング レイヤなど、Google のデータクラウドへのこれまでの投資を活用して、すべてのユーザーと生成 AI を含むすべてのシステムでビジネス定義をグローバルに利用できるようにする好機でもあります。Bytecode は Gemini の大規模言語モデルと Looker のセマンティック レイヤを組み合わせることにより、お客様の「ビジネスの真理」に基づいて分析エージェントのファインチューニングとグラウンディングをすばやく行い、信頼できるインサイトにエンドユーザーがアクセスして意思決定を行えるようにする、新たなインターフェースを提供しています。

エンドユーザーは、質問するのと同じくらい簡単に分析の回答を得られるようになりました。分析エージェントのデプロイに成功した組織では需要の急増が見られています。

Bytecode のお客様の 1 社に、SaaS 型職場管理プラットフォームの OfficeSpace があります。OfficeSpace は AI エージェントをコア製品に統合し、デスク予約やスペース管理をより迅速かつ簡単に管理できるようにしています。同社の製品の核となっているのが、オフィス スペースの使用状況と使用率に関する分析です。Gemini モデルと Looker を活用することで、ダッシュボードの枠を超え、精度の高い、管理されたインサイトをチャット内で直接提供できるようになりました。AI モデルは OfficeSpace 上でトレーニングされた後、特定のユースケースに合わせてチューニングされ、LookML を使用してクエリを生成します。これにより、ユーザーがチャットで質問を送信しても、ダッシュボードを確認しても、データセットをダウンロードしても、同じ回答が得られるようになります。

課題

LLM は、AI を活用した BI を実現するテクノロジー ソリューションの重要な部分です。OfficeSpace が分析チャットを提供するには、以下の 2 つの課題があります。

-

オフィス スペースの使用率について尋ねるさまざまな言い方を標準的な質問に変換する方法。これは LLM が最も得意とする領域です。

-

オフィス スペースの使用率を正確に計算するクエリの作成方法。これはセマンティック レイヤが最も得意とする領域です。

ソリューション

各テクノロジーの処理内容は以下のとおりです。

-

LLM は以下の処理を行います。

-

エンドユーザーの質問を標準的な質問に変換する

-

質問に最も近い Looker の measure とディメンションを選択する

-

Looker は以下の処理を行います。

-

セマンティック レイヤでビジネス ロジックを定義し、クエリを生成する

-

結果データの要約と可視化を提供する

Gemini と Looker はエンドツーエンドで簡単にやり取りできます。その精度は、堅牢なセマンティック レイヤ、言語モデルのグラウンディング、プロンプト トレーニングにより、質問を正確に変換して LookML の適切なオブジェクトを選択するよう Gemini をチューニングすることで向上します。Gemini を利用したデータ エージェントの作成は、キュレートされたセルフサービス型分析の作成とよく似ています。エンドユーザーに焦点を当て、エンドユーザーが回答を得る必要がある質問を特定し、ユーザー エクスペリエンスをキュレートします。

トレーニング プロセスの解明

トレーニングというと複雑そうに聞こえますが、実際は従来の分析の課題と似ています。ダッシュボードを構築するときと同様に、エンドユーザーが回答を得る必要があるビジネス上の質問を特定し、可視化を行って意思決定を支援します。

トレーニング プロセスにおいても、Bytecode は同じアプローチを取っています。ビジネス上の質問のリストを作成し、予想される Looker Explore の結果を Gemini に提供しています。Gemini に一般的なビジネス上の質問と予想される結果を提供することで、自動生成される回答の精度が劇的に向上します。

障壁を下げ、データを活用するユーザーを増やす

ビジネス インテリジェンス(BI)において信頼できる AI を活用できるようになったことは、社内分析および製品化された分析における重要な進展です。Bytecode は、ユーザーがデータに関する質問の回答を得るためのインターフェースを簡素化しながら、導入に対する障壁をさらに打破しています。お客様の中には、BI で AI を活用して、迅速な回答を必要とする現場の従業員に分析を提供している企業もあります。

Google のデータクラウドと連携することで、プロセスを解明し、AI を活用した精度の高い、管理された BI を提供できることを嬉しく思います。分析 AI エージェントのユースケースを実現する経験豊富なパートナーをお探しなら、Bytecode までお問い合わせください。また、Google Cloud コンソールから Looker、Vertex AI、Gemini モデルにアクセスし、ご自身で利用を開始していただくことも可能です。

ー Bytecode、サービス担当バイス プレジデント John Marshall 氏