Halaman ini menjelaskan opsi ketersediaan tinggi di Google Distributed Cloud (khusus software) untuk VMware.

Fungsi inti

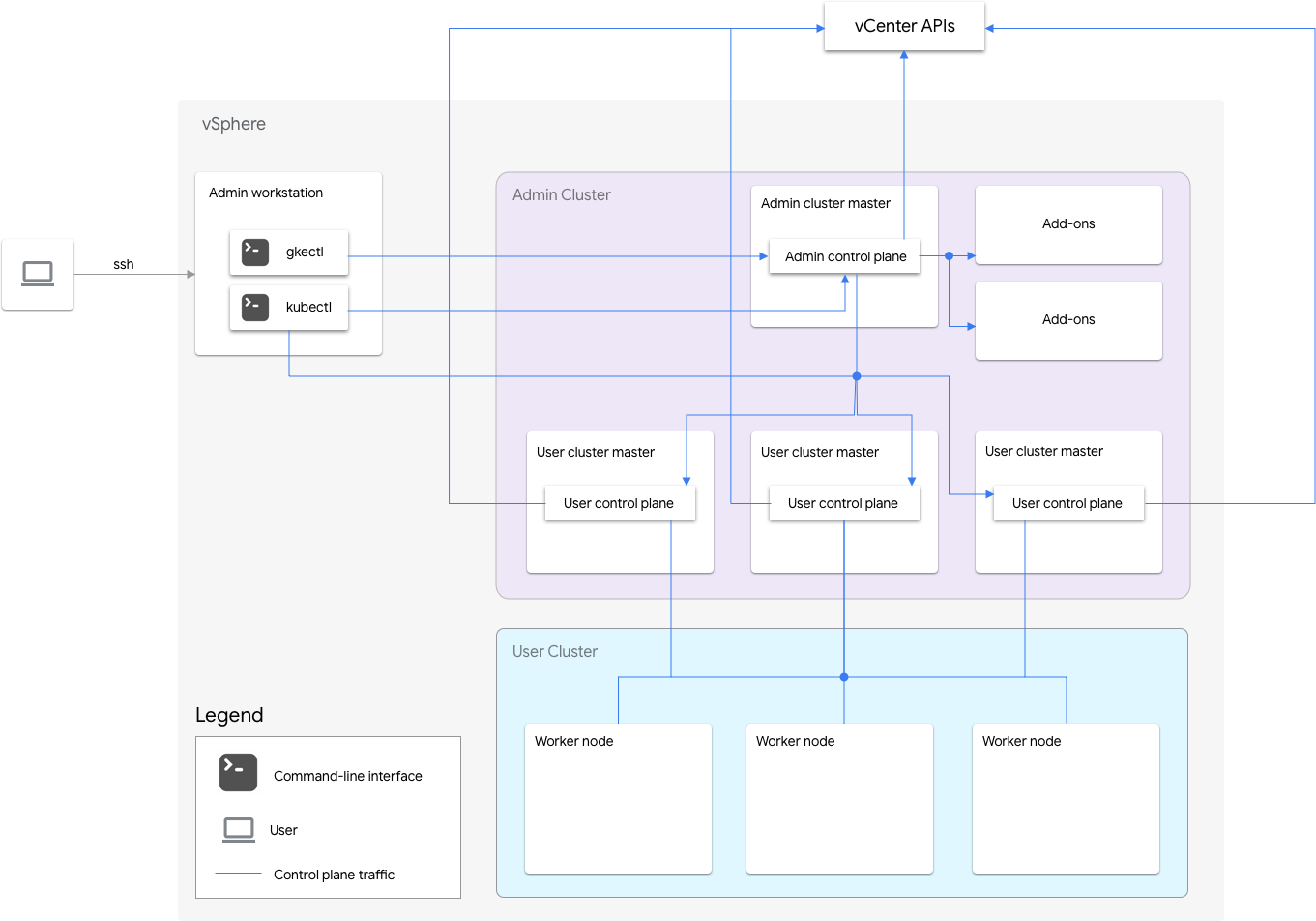

Penginstalan khusus software Google Distributed Cloud untuk VMware mencakup cluster admin dan satu atau beberapa cluster pengguna.

Cluster admin mengelola siklus proses cluster pengguna, termasuk pembuatan, pembaruan, upgrade, dan penghapusan cluster pengguna. Di cluster admin, master admin mengelola node pekerja admin, yang mencakup master pengguna (node yang menjalankan bidang kontrol cluster pengguna terkelola) dan node addon (node yang menjalankan komponen addon yang mendukung fungsi cluster admin).

Untuk setiap cluster pengguna, cluster admin memiliki satu node non-HA atau tiga node HA yang menjalankan bidang kontrol. Bidang kontrol mencakup server Kubernetes API, penjadwal Kubernetes, pengelola pengontrol Kubernetes, dan beberapa pengontrol penting untuk cluster pengguna.

Ketersediaan bidang kontrol cluster pengguna sangat penting untuk operasi workload seperti pembuatan workload, penskalaan peningkatan dan penurunan, serta penghentian. Dengan kata lain, pemadaman layanan bidang kontrol tidak mengganggu beban kerja yang sedang berjalan, tetapi beban kerja yang ada kehilangan kemampuan pengelolaan dari server Kubernetes API jika bidang kontrolnya tidak ada.

Beban kerja dan layanan dalam container di-deploy di node pekerja cluster pengguna. Setiap node pekerja tidak boleh penting untuk ketersediaan aplikasi selama aplikasi di-deploy dengan pod redundan yang dijadwalkan di beberapa node pekerja.

Mengaktifkan ketersediaan tinggi

vSphere dan Google Distributed Cloud menyediakan sejumlah fitur yang berkontribusi pada ketersediaan tinggi (HA).

vSphere HA dan vMotion

Sebaiknya aktifkan dua fitur berikut di cluster vCenter yang menghosting cluster Google Distributed Cloud Anda:

Fitur ini meningkatkan ketersediaan dan pemulihan jika host ESXi gagal.

vCenter HA menggunakan beberapa host ESXi yang dikonfigurasi sebagai cluster untuk memberikan pemulihan

cepat dari pemadaman layanan dan HA yang hemat biaya untuk aplikasi

yang berjalan di virtual machine. Sebaiknya sediakan cluster vCenter

dengan host tambahan dan

aktifkan Pemantauan Host vSphere HA

dengan Host Failure Response ditetapkan ke Restart VMs. VM Anda kemudian dapat

dimulai ulang secara otomatis di host lain yang tersedia jika terjadi kegagalan host ESXi.

vMotion memungkinkan migrasi langsung VM tanpa waktu tunggu dari satu host ESXi ke host lainnya. Untuk pemeliharaan host terencana, Anda dapat menggunakan migrasi langsung vMotion untuk menghindari downtime aplikasi sepenuhnya dan memastikan kelangsungan bisnis.

Cluster admin

Google Distributed Cloud mendukung pembuatan cluster admin ketersediaan tinggi (HA). Cluster admin HA memiliki tiga node yang menjalankan komponen bidang kontrol. Untuk informasi tentang persyaratan dan batasan, lihat Cluster admin ketersediaan tinggi.

Perhatikan bahwa ketidaktersediaan bidang kontrol cluster admin tidak memengaruhi fungsi cluster pengguna yang ada atau beban kerja apa pun yang berjalan di cluster pengguna.

Ada dua node add-on di cluster admin. Jika salah satunya tidak aktif, node lainnya

masih dapat menjalankan operasi cluster admin. Untuk redundansi,

Google Distributed Cloud menyebarkan Layanan add-on penting, seperti kube-dns,

di kedua node add-on.

Jika Anda menetapkan antiAffinityGroups.enabled ke true dalam file konfigurasi

cluster admin, Google Distributed Cloud akan otomatis membuat

aturan anti-afinitas vSphere DRS

untuk node add-on, yang menyebabkannya tersebar di

dua host fisik untuk HA.

Cluster pengguna

Anda dapat mengaktifkan HA untuk cluster pengguna dengan menetapkan masterNode.replicas ke 3 dalam file konfigurasi cluster pengguna. Jika cluster pengguna telah mengaktifkan

Controlplane V2 (direkomendasikan), 3 node control plane akan berjalan di cluster pengguna.

Cluster pengguna kubeception HA lama

menjalankan tiga node panel kontrol di cluster admin. Setiap node

bidang kontrol juga menjalankan replika etcd. Cluster pengguna akan terus berfungsi

selama ada satu bidang kontrol yang berjalan dan kuorum etcd. Kuorum

etcd mengharuskan dua dari tiga replika etcd berfungsi.

Jika Anda menetapkan antiAffinityGroups.enabled ke true dalam file konfigurasi

cluster admin, Google Distributed Cloud akan otomatis membuat aturan anti-afinitas vSphere DRS

untuk tiga node yang menjalankan platform kontrol cluster pengguna.

Hal ini menyebabkan VM tersebut tersebar di tiga host fisik.

Google Distributed Cloud juga membuat aturan anti-afinitas vSphere DRS untuk node pekerja di cluster pengguna Anda, yang menyebabkan node tersebut tersebar di setidaknya tiga host fisik. Beberapa aturan anti-afinitas DRS digunakan per kumpulan node cluster pengguna berdasarkan jumlah node. Hal ini memastikan bahwa node pekerja dapat menemukan host untuk dijalankan, meskipun jumlah host kurang dari jumlah VM di node pool cluster pengguna. Sebaiknya Anda menyertakan host fisik tambahan di cluster vCenter. Konfigurasikan juga DRS agar otomatis sepenuhnya sehingga jika host tidak tersedia, DRS dapat otomatis memulai ulang VM di host lain yang tersedia tanpa melanggar aturan anti-afinitas VM.

Google Distributed Cloud mempertahankan label node khusus,

onprem.gke.io/failure-domain-name, yang nilainya ditetapkan ke nama host

ESXi yang mendasarinya. Aplikasi pengguna yang menginginkan ketersediaan tinggi dapat menyiapkan

aturan podAntiAffinity dengan label ini sebagai topologyKey untuk memastikan bahwa

Pod aplikasi mereka tersebar di berbagai VM serta host fisik.

Anda juga dapat mengonfigurasi beberapa node pool untuk cluster pengguna dengan datastore dan label node khusus yang berbeda. Demikian pula, Anda dapat menyiapkan aturan podAntiAffinity

dengan label node khusus tersebut sebagai topologyKey untuk mencapai ketersediaan

yang lebih tinggi saat datastore gagal.

Untuk memiliki HA bagi beban kerja pengguna, pastikan cluster pengguna memiliki jumlah replika yang memadai di nodePools.replicas, yang memastikan jumlah node pekerja cluster pengguna yang diinginkan dalam kondisi berjalan.

Anda dapat menggunakan datastore terpisah untuk cluster admin dan cluster pengguna guna mengisolasi kegagalannya.

Load balancer

Ada dua jenis load balancer yang dapat Anda gunakan untuk ketersediaan tinggi.

Load balancer MetalLB yang dipaketkan

Untuk

load balancer MetalLB yang dipaketkan,

Anda dapat mencapai HA dengan memiliki lebih dari satu node dengan enableLoadBalancer: true.

MetalLB mendistribusikan layanan ke node load balancer, tetapi untuk satu layanan, hanya ada satu node pemimpin yang menangani semua traffic untuk layanan tersebut.

Selama upgrade cluster, ada beberapa periode nonaktif saat node load balancer diupgrade. Durasi gangguan failover MetalLB meningkat seiring dengan bertambahnya jumlah node load balancer. Dengan kurang dari 5 node, gangguan terjadi dalam waktu 10 detik.

Load balancing manual

Dengan load balancing manual, Anda mengonfigurasi Google Distributed Cloud untuk menggunakan load balancer pilihan Anda, seperti F5 BIG-IP atau Citrix. Anda mengonfigurasi ketersediaan tinggi di load balancer, bukan di Google Distributed Cloud.

Menggunakan beberapa cluster untuk pemulihan dari bencana

Men-deploy aplikasi di beberapa cluster di beberapa vCenter atau platform GKE Enterprise dapat memberikan ketersediaan global yang lebih tinggi dan membatasi radius ledakan selama pemadaman.

Penyiapan ini menggunakan cluster GKE Enterprise yang ada di pusat data sekunder untuk disaster recovery, bukan menyiapkan cluster baru. Berikut adalah ringkasan umum untuk mencapai hal ini:

Buat cluster admin dan cluster pengguna lain di pusat data sekunder. Dalam arsitektur multi-cluster ini, kami mewajibkan pengguna untuk memiliki dua cluster admin di setiap pusat data, dan setiap cluster admin menjalankan cluster pengguna.

Cluster pengguna sekunder memiliki jumlah minimum node pekerja (tiga) dan merupakan hot standby (selalu berjalan).

Deployment aplikasi dapat direplikasi di kedua vCenter menggunakan Config Sync, atau pendekatan yang lebih disukai adalah menggunakan toolchain DevOps aplikasi (CI/CD, Spinnaker) yang ada.

Jika terjadi bencana, cluster pengguna dapat diubah ukurannya sesuai dengan jumlah node.

Selain itu, pengalihan DNS diperlukan untuk merutekan traffic antara cluster ke pusat data sekunder.