Gemini Enterprise Agent Platform

Innovez, créez et déployez des agents adaptés aux entreprises

Gemini Enterprise Agent Platform est la plate-forme complète de Google Cloud qui permet aux développeurs de créer, de faire évoluer, de gérer et d'optimiser des agents. Il s'agit d'une destination unique permettant aux équipes techniques de créer des agents capables de transformer les applications et les workflows d'entreprise en systèmes agentiques puissants.

Les nouveaux clients peuvent obtenir jusqu'à 300 $ de crédits pour essayer Agent Platform et d'autres produits Google Cloud.

Fonctionnalités

Créer, faire évoluer, gérer et optimiser des agents IA de niveau entreprise

Agent Platform est notre plate-forme ouverte et complète qui permet aux entreprises de créer, de faire évoluer, de gérer et d'optimiser rapidement des agents de niveau entreprise ancrés dans leurs données. Elle fournit la base full stack et la flexibilité de développement nécessaires pour transformer vos applications et vos workflows en systèmes agentiques puissants à l'échelle mondiale.

Développement et workflows optimisés par les agents

Disponible dès maintenant via Agent Platform, Google Antigravity fournit une application centralisée pour piloter, personnaliser et orchestrer les agents. Vous pouvez déployer plusieurs agents pour exécuter simultanément des workflows entiers, comme des lancements de produits, en automatisant la génération de code pour votre site Web, la création d'assets conformes à la marque et la production d'e-mails pour les clients. Téléchargez Antigravity et connectez-vous à l'application de bureau ou à la CLI Antigravity à l'aide de vos identifiants Google Cloud standards.

Plus de 200 modèles et outils d'IA Google et tiers

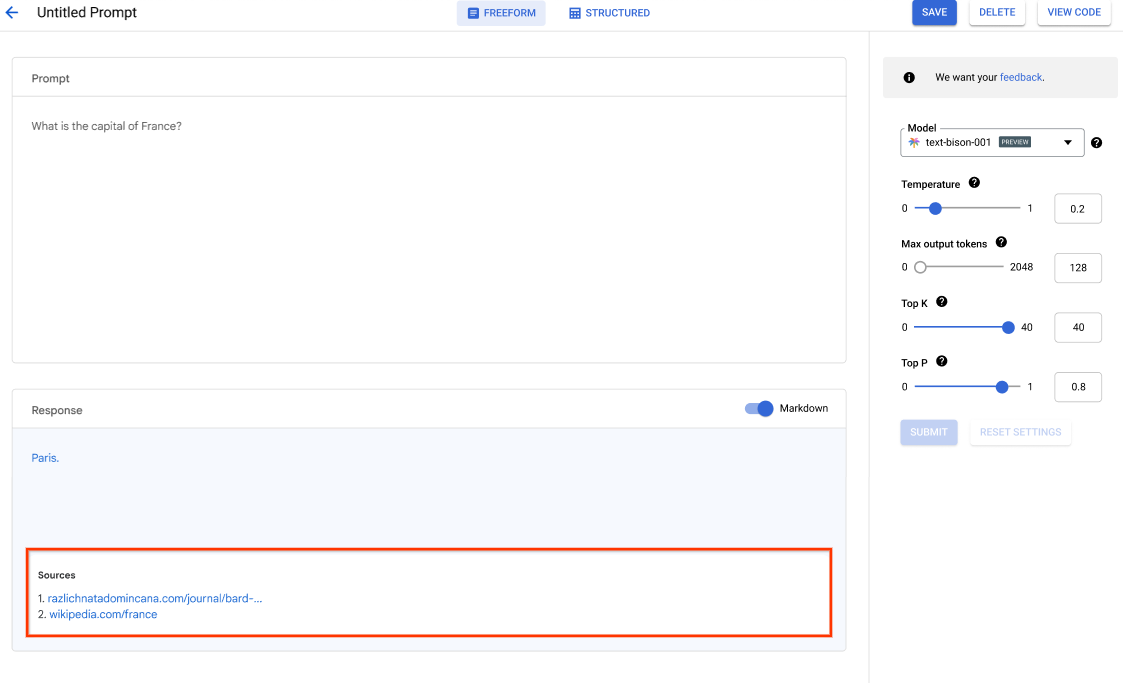

Faites votre choix parmi les derniers modèles multimodaux de Google, comme Gemini 3.5, des modèles tiers comme la famille de modèles Claude d'Anthropic et des modèles ouverts comme Gemma dans Model Garden. Vous pouvez également personnaliser les modèles en fonction de votre cas d'utilisation grâce à différentes options de réglage.

Notre service d'évaluation de modèles fournit des outils pensés pour les entreprises afin d'évaluer les modèles d'IA générative de manière objective et en s'appuyant sur les données.

Plate-forme d'IA ouverte et intégrée

Les data scientists peuvent évoluer plus rapidement grâce aux outils Agent Platform dédiés à l'entraînement, au réglage et au déploiement de modèles de ML.

Les notebooks Agent Platform, y compris Colab Enterprise ou Workbench de votre choix, sont intégrés de façon native à BigQuery et offrent une surface unique pour toutes les charges de travail de données et d'IA.

Agent platform Training et Prediction vous permettent de réduire la durée d'entraînement et de déployer facilement des modèles en production grâce aux frameworks Open Source de votre choix et à une infrastructure d'IA optimisée.

MLOps pour l'IA prédictive et générative

Agent Platform fournit des outils MLOps conçus sur mesure pour que les data scientists et les ingénieurs en ML puissent automatiser, standardiser et gérer les projets de ML.

Les outils modulaires vous aident à collaborer entre les équipes et à améliorer les modèles tout au long du cycle de développement : identifier le meilleur modèle pour un cas d'utilisation avec Model Evaluation, orchestrer les workflows avec Pipelines, gérer n'importe quel modèle avec Model Registry diffuser, partager et réutiliser des caractéristiques de ML avec Feature Store et surveiller les modèles pour détecter les décalages et dérives d'entrée.

Fonctionnement

Agent Platform propose plusieurs options pour créer des agents, entraîner des modèles et les déployer.

- Agent Platform vous permet de créer, de faire évoluer, de gérer et d'optimiser des agents adaptés aux entreprises sur une plate-forme unifiée.

- Agent Studio vous donne accès à de grands modèles d'IA générative comme Gemini 3. Vous pouvez ainsi les évaluer, les ajuster et les déployer pour les utiliser dans vos applications optimisées par l'IA.

- Model Garden vous permet de découvrir, de tester, de personnaliser et de déployer Agent Platform, et de sélectionner des modèles et des éléments Open Source (OSS).

- L'entraînement personnalisé vous offre un contrôle total sur le processus d'entraînement, y compris l'utilisation de votre framework de ML préféré, l'écriture de votre propre code d'entraînement et le choix des options de réglage des hyperparamètres.

Agent Platform propose plusieurs options pour créer des agents, entraîner des modèles et les déployer.

- Agent Platform vous permet de créer, de faire évoluer, de gérer et d'optimiser des agents adaptés aux entreprises sur une plate-forme unifiée.

- Agent Studio vous donne accès à de grands modèles d'IA générative comme Gemini 3. Vous pouvez ainsi les évaluer, les ajuster et les déployer pour les utiliser dans vos applications optimisées par l'IA.

- Model Garden vous permet de découvrir, de tester, de personnaliser et de déployer Agent Platform, et de sélectionner des modèles et des éléments Open Source (OSS).

- L'entraînement personnalisé vous offre un contrôle total sur le processus d'entraînement, y compris l'utilisation de votre framework de ML préféré, l'écriture de votre propre code d'entraînement et le choix des options de réglage des hyperparamètres.

Créer et déployer des agents IA

Exploiter des fonctionnalités d'IA avancées avec Agent Platform

Exploiter des fonctionnalités d'IA avancées avec Agent Platform

Créez des agents et des applications d'IA générative prêts pour la production sur une plate-forme qui évolue selon vos besoins. Notre Agent Platform fournit un environnement sécurisé pour développer et déployer des modèles et des applications d'IA.

Pour les développeurs, Agent Platform reste notre plate-forme avancée qui permet de créer, de personnaliser et d'affiner des agents sophistiqués à l'aide de frameworks tels que Agent Development Kit (ADK).

Lancez-vous avec cet atelier de programmation et créez votre première application d'IA dès aujourd'hui

Tutoriels, guides de démarrage rapide et ateliers

Exploiter des fonctionnalités d'IA avancées avec Agent Platform

Exploiter des fonctionnalités d'IA avancées avec Agent Platform

Créez des agents et des applications d'IA générative prêts pour la production sur une plate-forme qui évolue selon vos besoins. Notre Agent Platform fournit un environnement sécurisé pour développer et déployer des modèles et des applications d'IA.

Pour les développeurs, Agent Platform reste notre plate-forme avancée qui permet de créer, de personnaliser et d'affiner des agents sophistiqués à l'aide de frameworks tels que Agent Development Kit (ADK).

Lancez-vous avec cet atelier de programmation et créez votre première application d'IA dès aujourd'hui

Créer avec les modèle Gemini

Commencez à créer avec Agent Studio

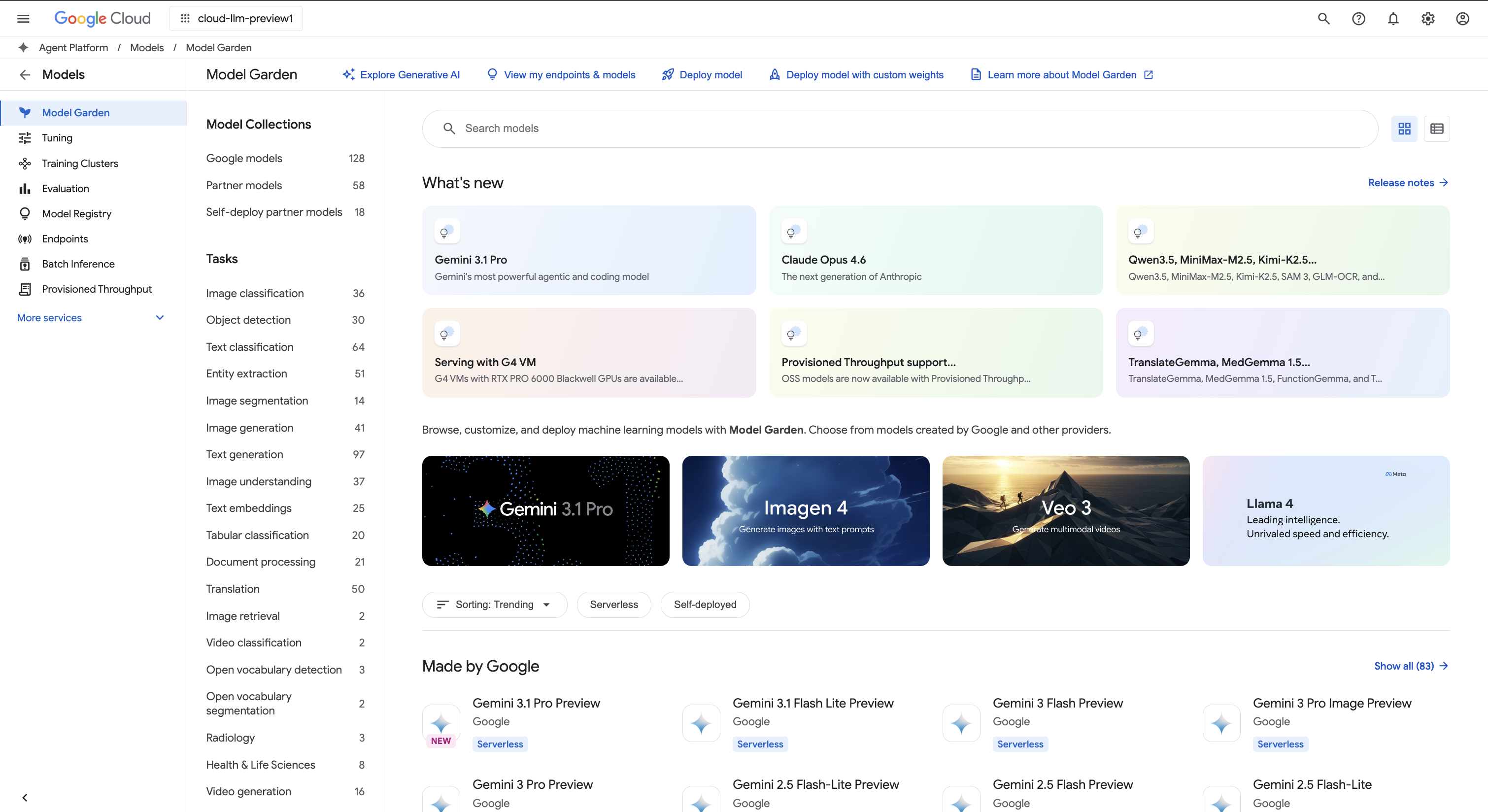

Commencez à créer avec Agent Studio

Utilisez Agent Studio pour concevoir, tester et gérer des prompts pour les modèles Gemini à l'aide du langage naturel, de code, d'images ou de vidéos. Essayez des exemples de prompts pour extraire du texte à partir d'images ou des maquettes d'images au format HTML. Vous pouvez même générer des réponses concernant les images ou les vidéos importées.

Vous pouvez également commencer à tester Gemini sur Agent Platform avec une clé API.

Accédez aux modèles Gemini via l'API Gemini dans Agent Platform

- Python

- JavaScript

- Java

- Aller

- Curl

Tutoriels, guides de démarrage rapide et ateliers

Commencez à créer avec Agent Studio

Commencez à créer avec Agent Studio

Utilisez Agent Studio pour concevoir, tester et gérer des prompts pour les modèles Gemini à l'aide du langage naturel, de code, d'images ou de vidéos. Essayez des exemples de prompts pour extraire du texte à partir d'images ou des maquettes d'images au format HTML. Vous pouvez même générer des réponses concernant les images ou les vidéos importées.

Vous pouvez également commencer à tester Gemini sur Agent Platform avec une clé API.

Exemple de code

Accédez aux modèles Gemini via l'API Gemini dans Agent Platform

- Python

- JavaScript

- Java

- Aller

- Curl

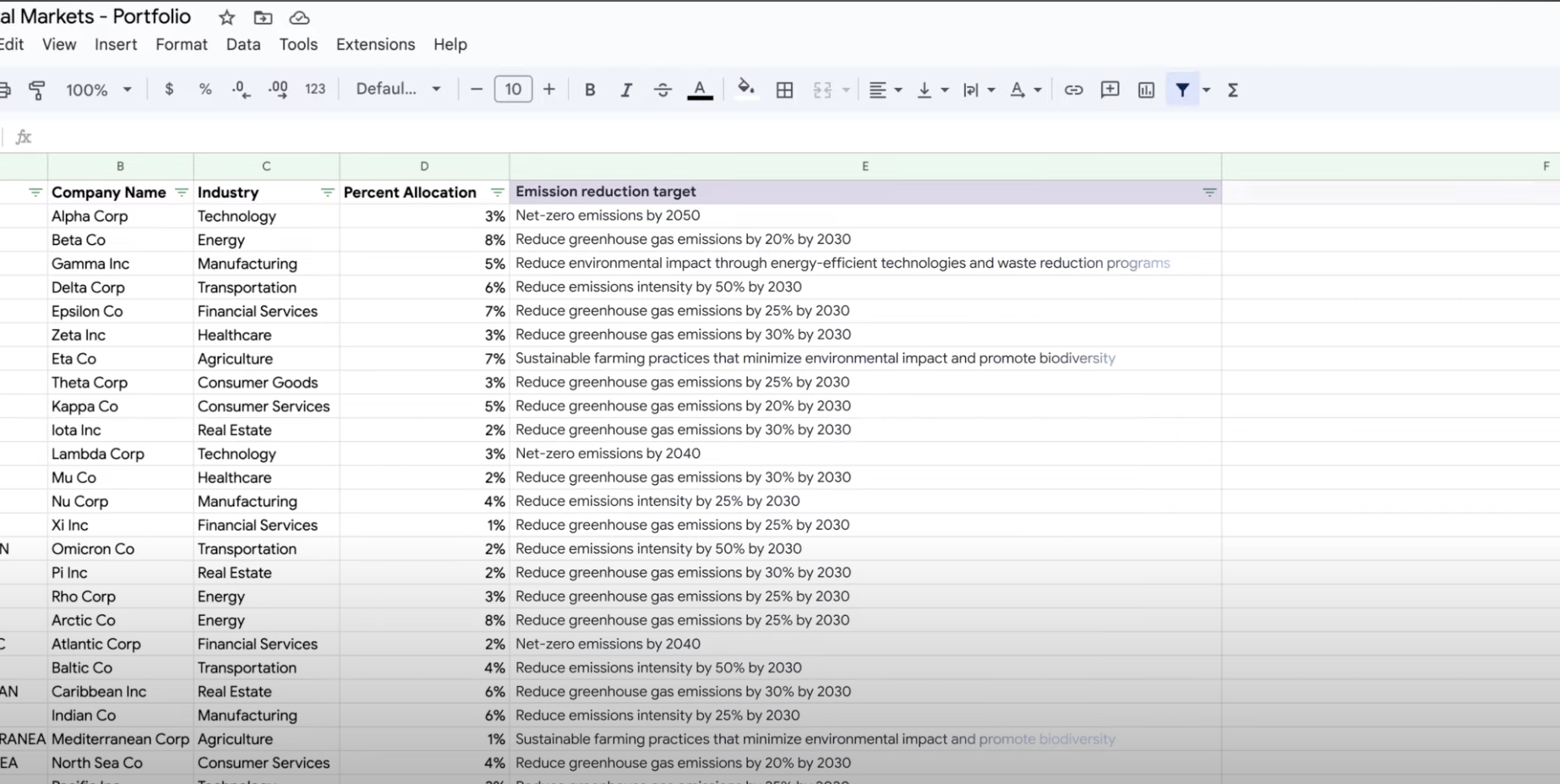

Extraire, synthétiser et classer les données

Utiliser l'IA générative pour la synthèse, la classification et l'extraction

Utiliser l'IA générative pour la synthèse, la classification et l'extraction

Découvrez comment créer des prompts textuels pour gérer un nombre illimité de tâches grâce à la compatibilité d'Agent Platform avec l'IA générative. Certaines des tâches les plus courantes sont la classification, la synthèse et l'extraction. Gemini sur Agent Platform vous permet de concevoir des prompts avec flexibilité en termes de structure et de format.

Tutoriels, guides de démarrage rapide et ateliers

Utiliser l'IA générative pour la synthèse, la classification et l'extraction

Utiliser l'IA générative pour la synthèse, la classification et l'extraction

Découvrez comment créer des prompts textuels pour gérer un nombre illimité de tâches grâce à la compatibilité d'Agent Platform avec l'IA générative. Certaines des tâches les plus courantes sont la classification, la synthèse et l'extraction. Gemini sur Agent Platform vous permet de concevoir des prompts avec flexibilité en termes de structure et de format.

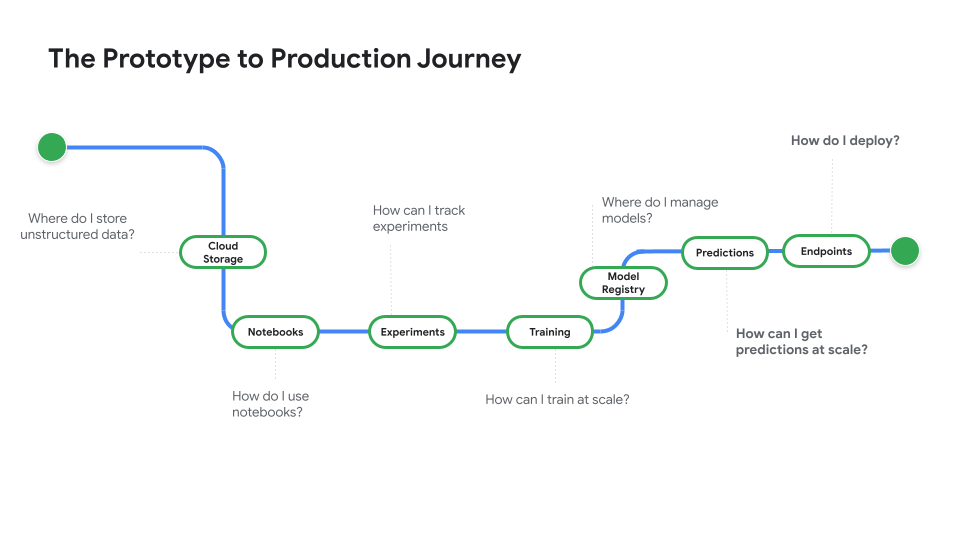

Déployer un modèle pour une utilisation en production

Effectuer des déploiements pour les prédictions par lot ou en ligne

Effectuer des déploiements pour les prédictions par lot ou en ligne

Lorsque vous êtes prêt à utiliser votre modèle pour résoudre un problème concret, enregistrez-le dans Model Registry et utilisez le service de prédiction Agent Platform pour effectuer des prédictions par lot et en ligne.

Regardez Du prototype à la production, une série de vidéos qui vous fait passer du code du notebook au modèle déployé.

Tutoriels, guides de démarrage rapide et ateliers

Effectuer des déploiements pour les prédictions par lot ou en ligne

Effectuer des déploiements pour les prédictions par lot ou en ligne

Lorsque vous êtes prêt à utiliser votre modèle pour résoudre un problème concret, enregistrez-le dans Model Registry et utilisez le service de prédiction Agent Platform pour effectuer des prédictions par lot et en ligne.

Regardez Du prototype à la production, une série de vidéos qui vous fait passer du code du notebook au modèle déployé.

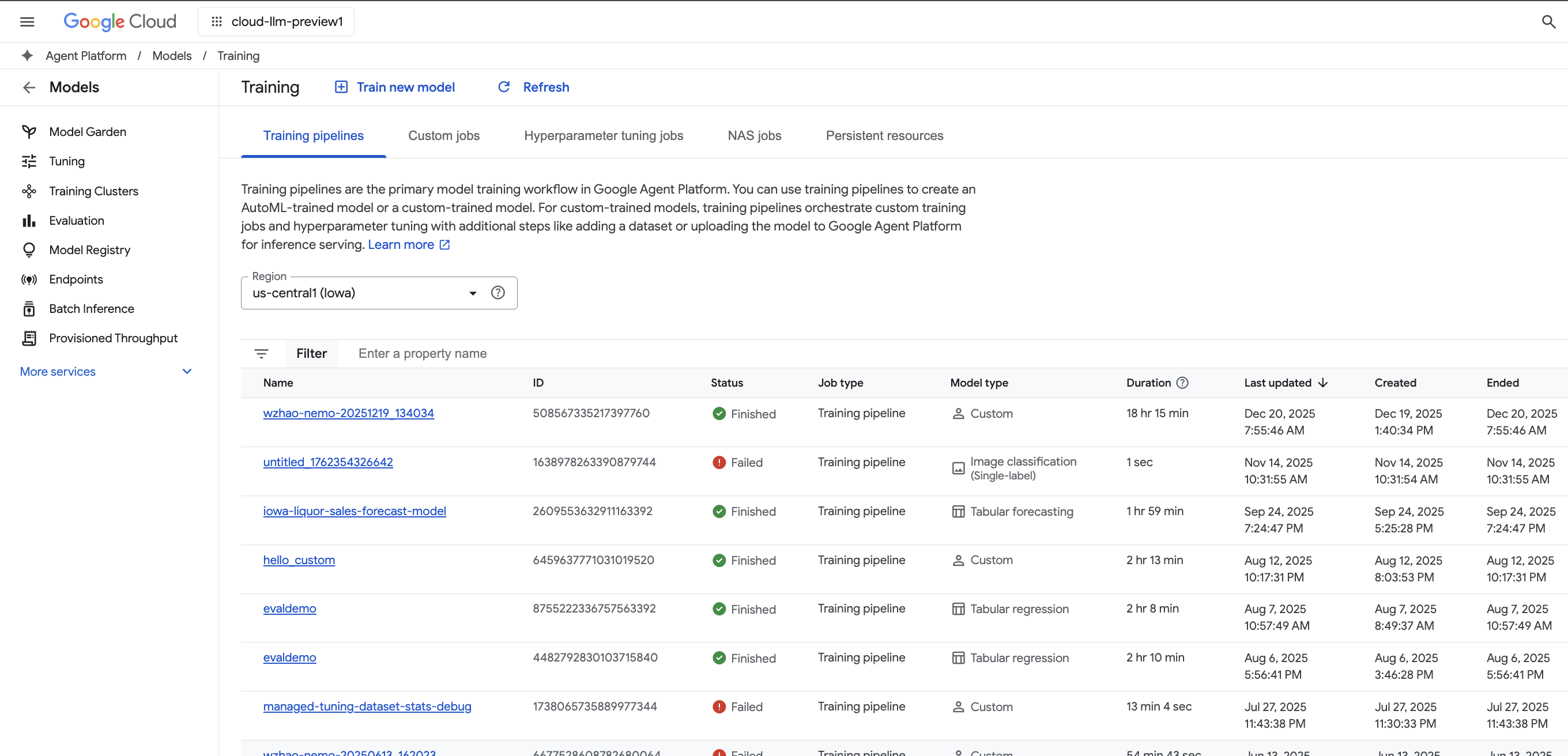

Entraîner des modèles personnalisés

Présentation et documentation de l'entraînement de modèles personnalisés

Présentation et documentation de l'entraînement de modèles personnalisés

Découvrez le workflow d'entraînement personnalisé dans Agent Platform, les avantages de l'entraînement personnalisé et les différentes options d'entraînement disponibles. Cette page détaille également chaque étape du workflow d'entraînement de ML, de la préparation des données aux prédictions.

Regardez un tutoriel vidéo sur la procédure à suivre pour entraîner des modèles personnalisés sur Agent Platform.

Tutoriels, guides de démarrage rapide et ateliers

Présentation et documentation de l'entraînement de modèles personnalisés

Présentation et documentation de l'entraînement de modèles personnalisés

Découvrez le workflow d'entraînement personnalisé dans Agent Platform, les avantages de l'entraînement personnalisé et les différentes options d'entraînement disponibles. Cette page détaille également chaque étape du workflow d'entraînement de ML, de la préparation des données aux prédictions.

Regardez un tutoriel vidéo sur la procédure à suivre pour entraîner des modèles personnalisés sur Agent Platform.

Tarification

| Fonctionnement des tarifs d'Agent Platform | Payez pour les outils Agent Platform ainsi que les ressources de stockage, de calcul et cloud que vous utilisez. Les nouveaux clients bénéficient de 300 $ de crédits pour essayer Agent Platform et d'autres produits Google Cloud. | |

|---|---|---|

| Outils et utilisation | Description | Prix |

IA générative | Modèle Imagen pour la génération d'images Basé sur la saisie d'image ou de caractères, ou sur la tarification d'un entraînement personnalisé. | À partir de 0,0001 $ |

Génération de texte, de chat et de code Tous les 1 000 caractères d'entrée (requête) et tous les 1 000 caractères de sortie (réponse). | À partir de 0,0001 $ pour 1 000 caractères | |

Modèles entraînés personnalisés | Entraînement de modèle personnalisé En fonction du type de machine utilisé par heure, la région et des accélérateurs utilisés. Obtenez une estimation via le service commercial ou notre simulateur de coût. | Contacter le service commercial |

Notebooks Agent Platform | Ressources de calcul et de stockage Basés sur les mêmes tarifs que Compute Engine et Cloud Storage. | Consulter les produits |

Frais de gestion Outre l'utilisation des ressources ci-dessus, des frais de gestion s'appliquent en fonction de la région, des instances, des notebooks et des notebooks gérés utilisés. Afficher les détails. | Voir les détails | |

Pipelines Agent Platform | Frais d'exécution et frais supplémentaires En fonction des tarifs d'exécution, des ressources utilisées et des éventuels frais de service supplémentaires. | À partir de 0,03 $ par exécution de pipeline |

Agent Platform Vector Search | Coûts de diffusion et de compilation En fonction de la taille de vos données, du nombre de requêtes par seconde (RPS) que vous souhaitez exécuter et du nombre de nœuds que vous utilisez. Voir un exemple | Consulter un exemple |

Consultez le détail des tarifs de l'ensemble des fonctionnalités et services Agent Platform.

Fonctionnement des tarifs d'Agent Platform

Payez pour les outils Agent Platform ainsi que les ressources de stockage, de calcul et cloud que vous utilisez. Les nouveaux clients bénéficient de 300 $ de crédits pour essayer Agent Platform et d'autres produits Google Cloud.

IA générative

Modèle Imagen pour la génération d'images

Basé sur la saisie d'image ou de caractères, ou sur la tarification d'un entraînement personnalisé.

Starting at

0,0001 $

Génération de texte, de chat et de code

Tous les 1 000 caractères d'entrée (requête) et tous les 1 000 caractères de sortie (réponse).

Starting at

0,0001 $

pour 1 000 caractères

Modèles entraînés personnalisés

Entraînement de modèle personnalisé

En fonction du type de machine utilisé par heure, la région et des accélérateurs utilisés. Obtenez une estimation via le service commercial ou notre simulateur de coût.

Contacter le service commercial

Notebooks Agent Platform

Ressources de calcul et de stockage

Basés sur les mêmes tarifs que Compute Engine et Cloud Storage.

Consulter les produits

Frais de gestion

Outre l'utilisation des ressources ci-dessus, des frais de gestion s'appliquent en fonction de la région, des instances, des notebooks et des notebooks gérés utilisés. Afficher les détails.

Voir les détails

Pipelines Agent Platform

Frais d'exécution et frais supplémentaires

En fonction des tarifs d'exécution, des ressources utilisées et des éventuels frais de service supplémentaires.

Starting at

0,03 $

par exécution de pipeline

Agent Platform Vector Search

Coûts de diffusion et de compilation

En fonction de la taille de vos données, du nombre de requêtes par seconde (RPS) que vous souhaitez exécuter et du nombre de nœuds que vous utilisez. Voir un exemple

Consulter un exemple

Consultez le détail des tarifs de l'ensemble des fonctionnalités et services Agent Platform.

Commencer votre démonstration de faisabilité

Cas d'utilisation métier

Exploitez tout le potentiel de l'IA générative

"La justesse de la solution d'IA générative de Google Cloud et l'aspect pratique d'Agent Platform nous donnent la confiance dont nous avions besoin pour mettre en œuvre cette technologie de pointe au cœur de nos activités et atteindre notre objectif à long terme : un temps de réponse de zéro minute."

Abdol Moabery, CEO de GA Telesis

Contenu associé

Rapports d'analystes

Google figure parmi les leaders du marché dans le rapport IDC MarketScape sur les logiciels de modèles de fondation pour le cycle de vie de l’IA générative à l’échelle mondiale de 2025. Télécharger le rapport

Google figure parmi les leaders dans le rapport Gartner Magic Quadrant™ sur les plates-formes de développement d'applications d'IA du 4e trimestre 2025. Lire le rapport

Google figure parmi les leaders du marché dans le rapport "The Forrester Wave™: AI/ML Platforms" (Plates-formes d'IA/de ML) du 3e trimestre 2024. Lire le rapport