Mengevaluasi model

Setelah melatih model, AutoML Translation menggunakan kumpulan TEST Anda untuk mengevaluasi kualitas dan akurasi model baru. AutoML Translation mengekspresikan kualitas model menggunakan skor BLEU (Bilingual Evaluation Understudy), yang menunjukkan seberapa mirip teks kandidat dengan teks referensi. Nilai skor BLEU yang lebih dekat ke angka satu menunjukkan bahwa

terjemahan lebih dekat dengan teks referensi.

Gunakan data ini untuk mengevaluasi kesiapan model Anda. Untuk meningkatkan kualitas model, pertimbangkan untuk menambahkan lebih banyak (dan lebih beragam) pasangan segmen pelatihan. Setelah menyesuaikan set data, latih model baru menggunakan set data yang telah ditingkatkan.

Perhatikan bahwa skor BLEU tidak direkomendasikan untuk perbandingan di berbagai korpora dan bahasa. Misalnya, skor BLEU 50 untuk terjemahan dari bahasa Inggris ke bahasa Jerman tidak dapat dibandingkan dengan skor BLEU 50 untuk terjemahan dari bahasa Jepang ke bahasa Inggris. Banyak pakar terjemahan telah beralih ke pendekatan metrik berbasis model, yang memiliki korelasi lebih tinggi dengan rating manusia dan lebih terperinci dalam mengidentifikasi skenario kesalahan.

AutoML Translation hanya mendukung skor BLEU. Untuk mengevaluasi model terjemahan Anda menggunakan metrik berbasis model, lihat Layanan evaluasi AI generatif di Vertex AI.

Mendapatkan evaluasi model

Buka konsol AutoML Translation.

Dari menu navigasi, klik Models untuk melihat daftar model Anda.

Klik model yang akan dievaluasi.

Klik tab Train untuk melihat metrik evaluasi model seperti skor BLEU.

Menguji prediksi model

Dengan menggunakan konsol Google Cloud , Anda dapat membandingkan hasil terjemahan untuk model kustom dengan model NMT default.

Buka konsol AutoML Translation.

Dari menu navigasi, klik Models untuk melihat daftar model Anda.

Klik model yang akan diuji.

Klik tab Prediction.

Tambahkan teks input di kotak teks bahasa sumber.

Klik Terjemahkan.

AutoML Translation menampilkan hasil terjemahan untuk model kustom dan model NMT.

Mengevaluasi dan membandingkan model menggunakan set pengujian baru

Dari konsol Google Cloud , Anda dapat mengevaluasi ulang model yang ada dengan menggunakan serangkaian set data pengujian baru. Dalam satu evaluasi, Anda dapat menyertakan hingga 5 model berbeda, lalu membandingkan hasilnya.

Upload data pengujian Anda ke Cloud Storage sebagai file nilai yang dipisahkan tab (TSV) atau sebagai file Translation Memory eXchange (TMX).

AutoML Translation mengevaluasi model Anda berdasarkan set pengujian, lalu menghasilkan skor evaluasi. Secara opsional, Anda dapat menyimpan hasil untuk setiap model sebagai file TSV di bucket Cloud Storage, dengan setiap baris memiliki format berikut:

Source segment tab Model candidate translation tab Reference translation

Buka konsol AutoML Translation.

Dari menu navigasi, klik Models untuk melihat daftar model Anda.

Klik model yang akan dievaluasi.

Klik tab Evaluate.

Di tab Evaluate, klik New Evaluation.

Pilih model yang ingin Anda evaluasi dan bandingkan, lalu klik Next.

Model saat ini harus dipilih, dan Google NMT dipilih secara default, yang dapat Anda batalkan pilihannya.

Tentukan nama untuk Test set name guna membantu Anda membedakannya dari evaluasi lain, lalu pilih set pengujian baru dari Cloud Storage.

Klik Next.

Untuk mengekspor prediksi, tentukan folder tujuan Cloud Storage.

Klik Start evaluation.

AutoML Translation menampilkan skor evaluasi dalam format tabel di konsol setelah evaluasi selesai. Anda hanya dapat menjalankan satu evaluasi pada satu waktu. Jika Anda menentukan folder untuk menyimpan hasil prediksi, AutoML Translation akan menulis file TSV ke lokasi tersebut yang diberi nama dengan ID model terkait, yang ditambahkan dengan nama set pengujian.

Memahami Skor BLEU

BLEU (BiLingual Evaluation Understudy) adalah metrik untuk mengevaluasi teks yang diterjemahkan mesin secara otomatis. Skor BLEU adalah angka antara nol dan satu yang mengukur kesamaan teks terjemahan mesin dengan kumpulan terjemahan referensi berkualitas tinggi. Nilai 0 berarti output yang diterjemahkan mesin tidak tumpang tindih dengan terjemahan referensi (yang menunjukkan kualitas lebih rendah) sedangkan nilai 1 berarti ada tumpang tindih yang sempurna dengan terjemahan referensi (yang menunjukkan kualitas yang lebih tinggi).

AutoML Translation menampilkan skor BLEU sebagai persentase, bukan desimal antara 0 dan 1.

Penafsiran

Sebagai panduan kasar, interpretasi skor BLEU berikut (dinyatakan sebagai persentase, bukan desimal) mungkin dapat membantu.

| Skor BLEU | Interpretasi |

|---|---|

| < 10 | Hampir tidak berguna |

| 10 - 19 | Sulit untuk memahami intinya |

| 20 - 29 | Intinya jelas, tetapi memiliki kesalahan tata bahasa yang signifikan |

| 30 - 40 | Terjemahan mudah dipahami hingga cukup baik. |

| 40 - 50 | Terjemahan berkualitas tinggi |

| 50 - 60 | Terjemahan berkualitas sangat tinggi, memadai, dan fasih |

| > 60 | Kualitas terjemahan sering kali lebih baik daripada kualitas terjemahan manusia |

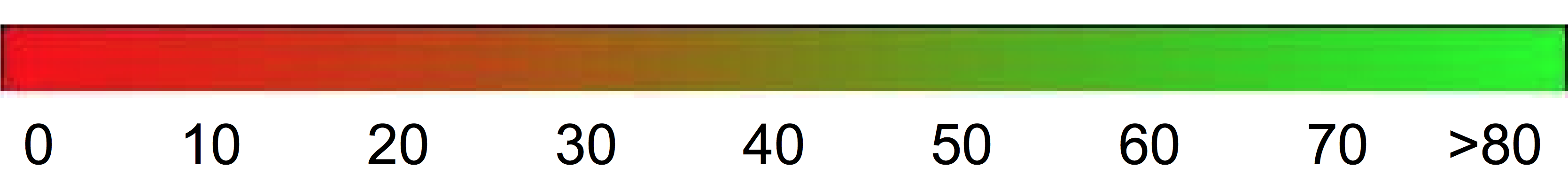

Gradien warna berikut dapat digunakan sebagai penafsiran skor BLEU skala umum:

Rincian matematis

Secara matematis, skor BLEU didefinisikan sebagai:

dengan

\[ precision_i = \dfrac{\sum_{\text{snt}\in\text{Cand-Corpus}}\sum_{i\in\text{snt}}\min(m^i_{cand}, m^i_{ref})} {w_t^i = \sum_{\text{snt'}\in\text{Cand-Corpus}}\sum_{i'\in\text{snt'}} m^{i'}_{cand}} \]

di mana

- \(m_{cand}^i\hphantom{xi}\) adalah jumlah i-gram dalam kandidat yang cocok dengan terjemahan referensi

- \(m_{ref}^i\hphantom{xxx}\) adalah jumlah i-gram dalam terjemahan referensi

- \(w_t^i\hphantom{m_{max}}\) adalah jumlah total i-gram dalam terjemahan kandidat

Formula ini terdiri dari dua bagian: penalti penyingkatan dan tumpang-tindih n-gram.

Penalti Penyingkatan

Penalti penyingkatan akan menghukum terjemahan yang dihasilkan terlalu pendek dibandingkan dengan panjang referensi terdekat dengan peluruhan eksponensial. Sanksi penyingkatan ini mengompensasi fakta bahwa skor BLEU tidak memiliki istilah perolehan.Tumpang-tindih N-Gram

Tumpang-tindih n-gram menghitung jumlah unigram, bigram, trigram, dan empat gram (i=1,...,4) cocok dengan pasangan n-gram dalam terjemahan referensi. Istilah ini berfungsi sebagai metrik presisi. Unigram memperhitungkan kecukupan, sedangkan n-gram yang lebih panjang memperhitungkan kefasihan terjemahan. Untuk menghindari penghitungan berlebih, jumlah n-gram dipotong ke jumlah n-gram maksimal yang terjadi dalam referensi (\(m_{ref}^n\)).

Contoh

Menghitung \(precision_1\)

Pertimbangkan kalimat referensi dan terjemahan kandidat ini:

Referensi: the cat is on the mat

Kandidat: the the the cat mat

Langkah pertama adalah menghitung kemunculan setiap unigram dalam kalimat referensi dan terjemahan kandidat. Perhatikan bahwa metrik BLEU peka terhadap huruf besar/kecil.

| Unigram | \(m_{cand}^i\hphantom{xi}\) | \(m_{ref}^i\hphantom{xxx}\) | \(\min(m^i_{cand}, m^i_{ref})\) |

|---|---|---|---|

the |

3 | 2 | 2 |

cat |

1 | 1 | 1 |

is |

0 | 1 | 0 |

on |

0 | 1 | 0 |

mat |

1 | 1 | 1 |

Jumlah total unigram dalam kandidat (\(w_t^1\)) adalah 5, jadi \(precision_1\) = (2 + 1 + 1)/5 = 0,8.

Menghitung skor BLEU

Referensi:

The NASA Opportunity rover is battling a massive dust storm on Mars .

Kandidat 1:

The Opportunity rover is combating a big sandstorm on Mars .

Kandidat 2:

A NASA rover is fighting a massive storm on Mars .

Contoh di atas terdiri dari satu referensi dan dua kandidat terjemahan. Kalimat tersebut ditokenkan sebelum menghitung skor BLEU seperti yang ditunjukkan di atas; misalnya, periode akhir dihitung sebagai token terpisah.

Untuk menghitung skor BLEU untuk setiap terjemahan, kami menghitung statistik berikut.

- Presisi N-Gram

Tabel berikut berisi presisi n-gram untuk kedua kandidat. - Penalti penyingkatan

Penalti singkatnya sama untuk kandidat 1 dan kandidat 2 karena kedua kalimatnya terdiri dari 11 token. - Skor BLEU

Perhatikan bahwa diperlukan minimal satu gram yang cocok dengan berat 4 gram untuk mendapatkan skor BLEU > 0. Karena terjemahan kandidat 1 tidak memiliki 4 gram yang cocok, terjemahan tersebut memiliki skor BLEU 0.

| Metrik | Kandidat 1 | Kandidat 2 |

|---|---|---|

| \(precision_1\) (1gram) | 8/11 | 9/11 |

| \(precision_2\) (2gram) | 4/10 | 5/10 |

| \(precision_3\) (3gram) | 2/9 | 2/9 |

| \(precision_4\) (4gram) | 0/8 | 1/8 |

| Penalti Penyingkatan | 0,83 | 0,83 |

| Skor BLEU | 0,0 | 0,27 |

Properti

BLEU adalah Metrik Berbasis Korpus

Metrik BLEU berperforma buruk saat digunakan untuk mengevaluasi setiap kalimat. Misalnya, kedua kalimat contoh tersebut mendapatkan skor BLEU yang sangat rendah meskipun keduanya menangkap sebagian besar artinya. Karena statistik n-gram untuk setiap kalimat kurang bermakna, BLEU dibuat dengan merancang metrik berbasis korpus; yaitu, statistik diakumulasikan di seluruh korpus saat menghitung skor. Perhatikan bahwa metrik BLEU yang dinyatakan di atas tidak dapat diperhitungkan untuk kalimat individual.Tidak ada perbedaan antara kata konten dan kata fungsi

Metrik BLEU tidak membedakan antara kata konten dan kata fungsi, yaitu, kata fungsi yang dihapus seperti "a" akan tetap mendapat penalti yang sama seolah-olah nama "NASA" dengan salah diganti dengan "ESA".Tidak pandai dalam menangkap makna dan gramatikalitas kalimat

Penghilangan sebuah kata, seperti kata "not", dapat mengubah polaritas kalimat. Selain itu, dengan hanya mempertimbangkan n-gram dengan n≤4 akan mengabaikan dependensi jarak jauh sehingga BLEU sering kali hanya memberikan penalti kecil untuk kalimat yang tidak memiliki tata bahasa yang baik.Normalisasi dan Tokenisasi

Sebelum menghitung skor BLEU, referensi dan terjemahan kandidat dinormalisasi dan ditokenkan. Pilihan langkah normalisasi dan tokenisasi secara signifikan memengaruhi skor akhir BLEU.