Platform Vertex AI

Berinovasi lebih cepat dengan AI yang siap digunakan perusahaan, yang ditingkatkan dengan model Gemini

Vertex AI adalah platform pengembangan AI terpadu dan terkelola sepenuhnya untuk membangun dan menggunakan AI generatif. Akses dan manfaatkan Vertex AI Studio, Agent Builder, dan lebih dari 200 model dasar.

Pelanggan baru mendapatkan kredit gratis senilai hingga $300 untuk mencoba Vertex AI dan produk Google Cloud lainnya.

Fitur

Gemini, model multimodal tercanggih Google

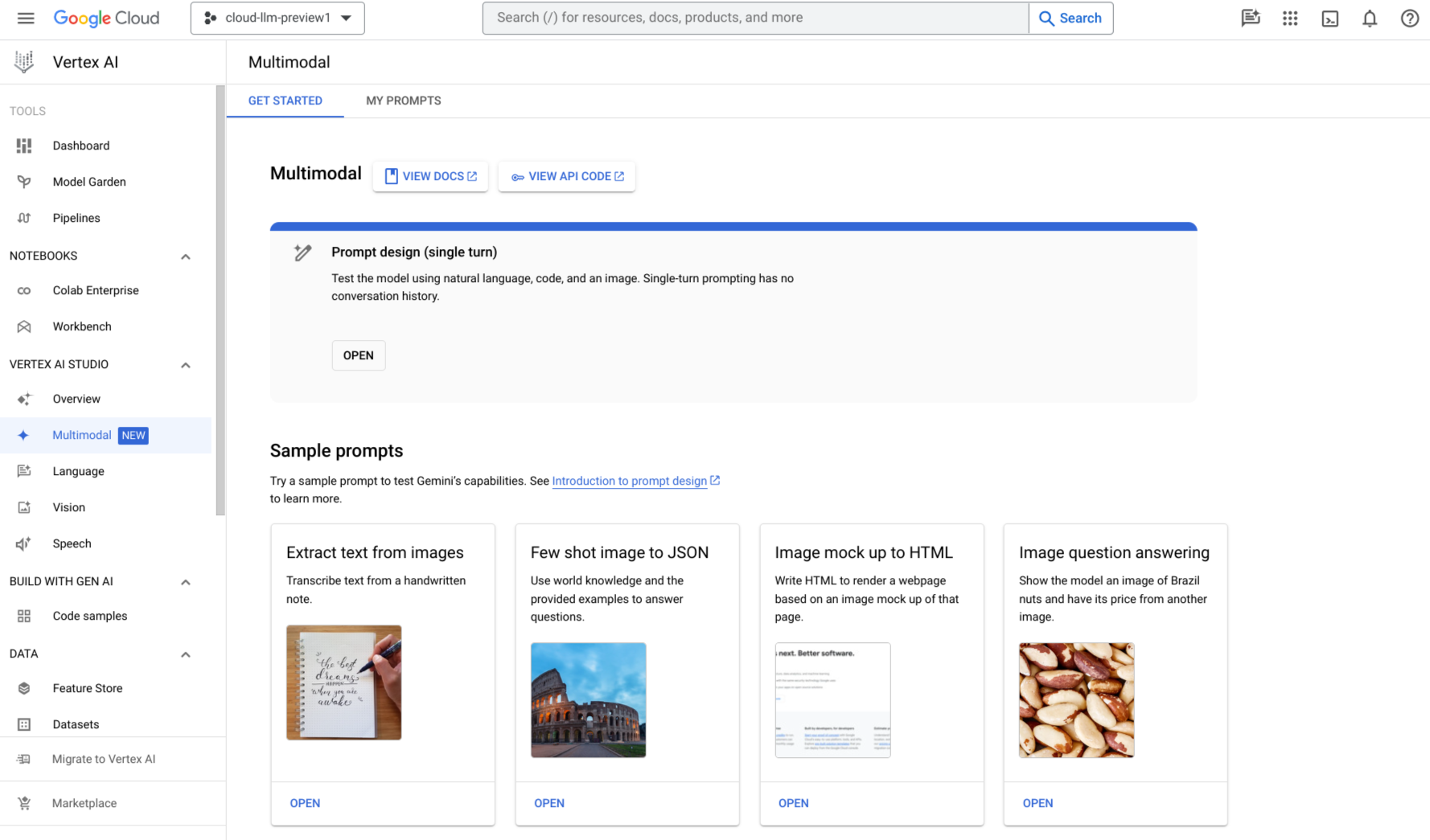

Vertex AI menawarkan akses ke model Gemini terbaru dari Google, termasuk Gemini 3. Gemini mampu memahami secara virtual hampir semua input, menggabungkan berbagai jenis informasi, dan menghasilkan hampir semua output. Buat perintah dan uji Gemini di Vertex AI Studio menggunakan teks, gambar, video, atau kode. Dengan menggunakan penalaran canggih dan kemampuan pembuatan yang canggih dari Gemini, developer dapat mencoba contoh prompt untuk mengekstrak teks dari gambar, mengonversi teks gambar menjadi JSON, dan bahkan menghasilkan jawaban tentang gambar yang diupload untuk membangun aplikasi AI generasi berikutnya.

Lebih dari 200 alat dan model AI generatif

Pilih dari beragam model yang mencakup model pihak pertama (Gemini, Imagen, Chirp, Veo), pihak ketiga (Anthropic Claude Model Family), dan model open source (Gemma, Llama 3.2) di Model Garden. Gunakan ekstensi untuk memungkinkan model mengambil informasi real-time dan memicu tindakan. Anda juga dapat menyesuaikan model dengan kasus penggunaan Anda melalui berbagai opsi penyesuaian.

Layanan evaluasi AI generatif kami menyediakan alat tingkat perusahaan untuk penilaian objektif dan berbasis data terhadap model AI generatif.

Platform AI terbuka dan terintegrasi

Data scientist dapat bergerak lebih cepat dengan alat Vertex AI Platform untuk pelatihan, penyesuaian, dan deployment model ML.

Notebook Vertex AI, termasuk Colab Enterprise atau Workbench pilihan Anda, terintegrasi secara native dengan BigQuery yang menyediakan satu platform untuk semua workload data dan AI.

Vertex AI Training dan Prediction membantu Anda mengurangi waktu pelatihan dan men-deploy model ke produksi dengan mudah menggunakan framework open source dan infrastruktur AI yang dioptimalkan.

MLOps untuk AI prediktif dan generatif

Vertex AI Platform menyediakan alat MLOps yang dibuat khusus bagi data scientist dan engineer ML untuk mengotomatiskan, menstandarkan, dan mengelola project ML.

Alat modular membantu Anda berkolaborasi dengan berbagai tim dan meningkatkan kualitas model di sepanjang siklus proses pengembangan—mengidentifikasi model terbaik untuk kasus penggunaan dengan Vertex AI Evaluation, mengorkestrasi alur kerja dengan Vertex AI Pipelines, mengelola model apa pun dengan Model Registry, menyalurkan, berbagi, dan menggunakan kembali fitur ML dengan Feature Store, serta memantau model untuk skew dan penyimpangan input.

Membangun, menskalakan, dan mengatur agen perusahaan

Vertex AI Agent Builder adalah platform terbuka dan komprehensif kami yang memberdayakan para pelaku bisnis untuk membangun, menskalakan, dan mengatur agen untuk perusahaan dengan cepat yang didasarkan pada data perusahaan Anda. Platform ini menyediakan fondasi full stack dan pilihan developer yang luas yang Anda perlukan untuk mentransformasi aplikasi dan alur kerja Anda menjadi sistem agentic yang andal dan canggih dalam skala global.

Cara Kerjanya

Vertex AI menyediakan beberapa opsi untuk pelatihan dan deployment model:

- AI Generatif memberi Anda akses ke model AI generatif besar, termasuk Gemini 3, sehingga Anda dapat mengevaluasi, menyesuaikan, dan men-deploy model tersebut agar dapat digunakan dalam aplikasi yang didukung AI.

- Dengan Model Garden, Anda dapat menemukan, menguji, menyesuaikan, dan men-deploy di Vertex AI serta memilih model dan aset open-source (OSS).

- Pelatihan kustom memberi Anda kontrol penuh atas proses pelatihan, termasuk menggunakan framework ML pilihan, menulis kode pelatihan Anda sendiri, dan memilih opsi penyesuaian hyperparameter.

Vertex AI menyediakan beberapa opsi untuk pelatihan dan deployment model:

- AI Generatif memberi Anda akses ke model AI generatif besar, termasuk Gemini 3, sehingga Anda dapat mengevaluasi, menyesuaikan, dan men-deploy model tersebut agar dapat digunakan dalam aplikasi yang didukung AI.

- Dengan Model Garden, Anda dapat menemukan, menguji, menyesuaikan, dan men-deploy di Vertex AI serta memilih model dan aset open-source (OSS).

- Pelatihan kustom memberi Anda kontrol penuh atas proses pelatihan, termasuk menggunakan framework ML pilihan, menulis kode pelatihan Anda sendiri, dan memilih opsi penyesuaian hyperparameter.

Penggunaan Umum

Membangun dengan model Gemini

Memulai model multimodal Google

Memulai model multimodal Google

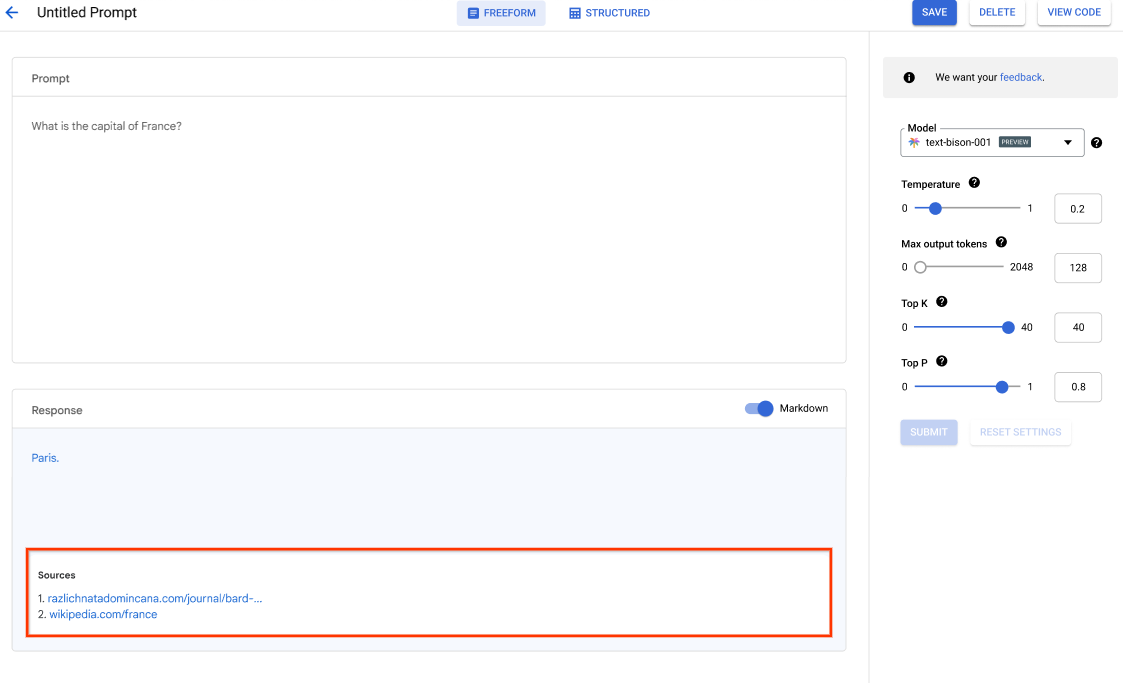

Gunakan Vertex AI Studio untuk merancang, menguji, dan mengelola perintah model Gemini menggunakan bahasa alami, kode, gambar, atau video. Coba contoh perintah untuk mengekstrak teks dari gambar, gambar contoh menjadi HTML, dan bahkan membuat jawaban tentang gambar atau video yang diupload.

Anda juga dapat mulai menguji Gemini di Vertex AI dengan kunci API.

Mengakses model Gemini melalui Gemini API di Google Cloud Vertex AI

- Python

- JavaScript

- Java

- Go

- Curl

Tutorial, panduan memulai, dan lab

Memulai model multimodal Google

Memulai model multimodal Google

Gunakan Vertex AI Studio untuk merancang, menguji, dan mengelola perintah model Gemini menggunakan bahasa alami, kode, gambar, atau video. Coba contoh perintah untuk mengekstrak teks dari gambar, gambar contoh menjadi HTML, dan bahkan membuat jawaban tentang gambar atau video yang diupload.

Anda juga dapat mulai menguji Gemini di Vertex AI dengan kunci API.

Contoh kode

Mengakses model Gemini melalui Gemini API di Google Cloud Vertex AI

- Python

- JavaScript

- Java

- Go

- Curl

Agen dan aplikasi AI

Manfaatkan kemampuan AI tingkat lanjut dengan Vertex AI

Manfaatkan kemampuan AI tingkat lanjut dengan Vertex AI

Bangun agen dan aplikasi AI generatif siap produksi di platform yang dapat diskalakan sesuai kebutuhan Anda. Platform pengembangan AI kami, Vertex AI, menyediakan lingkungan yang aman untuk mengembangkan dan men-deploy model serta aplikasi AI.

Bagi developer, Vertex AI tetap menjadi platform canggih kami yang dapat digunakan untuk membangun, menyesuaikan, dan menyempurnakan agen canggih menggunakan framework seperti Agent Development Kit (ADK).

Mulai dengan codelab ini dan bangun aplikasi AI pertama Anda sekarang juga

Tutorial, panduan memulai, dan lab

Manfaatkan kemampuan AI tingkat lanjut dengan Vertex AI

Manfaatkan kemampuan AI tingkat lanjut dengan Vertex AI

Bangun agen dan aplikasi AI generatif siap produksi di platform yang dapat diskalakan sesuai kebutuhan Anda. Platform pengembangan AI kami, Vertex AI, menyediakan lingkungan yang aman untuk mengembangkan dan men-deploy model serta aplikasi AI.

Bagi developer, Vertex AI tetap menjadi platform canggih kami yang dapat digunakan untuk membangun, menyesuaikan, dan menyempurnakan agen canggih menggunakan framework seperti Agent Development Kit (ADK).

Mulai dengan codelab ini dan bangun aplikasi AI pertama Anda sekarang juga

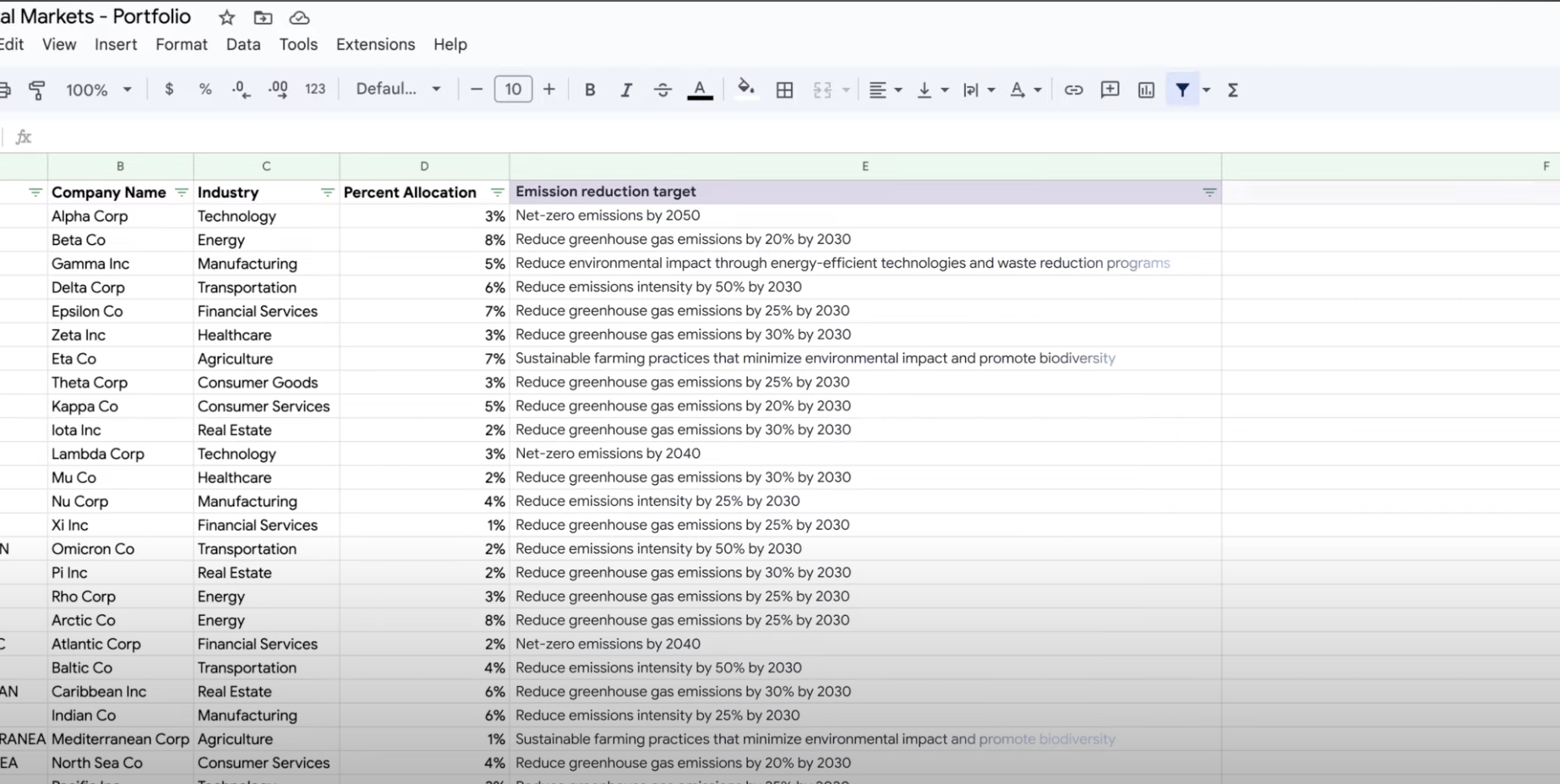

Mengekstrak, meringkas, dan mengklasifikasikan data

Menggunakan AI generatif untuk ringkasan, klasifikasi, dan ekstraksi

Menggunakan AI generatif untuk ringkasan, klasifikasi, dan ekstraksi

Pelajari cara membuat perintah teks untuk menangani sejumlah tugas dengan dukungan AI generatif Vertex AI. Beberapa tugas yang paling umum adalah mengklasifikasi, meringkas, dan mengekstrak. Gemini di Vertex AI memungkinkan Anda mendesain perintah yang fleksibel dalam hal struktur dan formatnya.

Tutorial, panduan memulai, dan lab

Menggunakan AI generatif untuk ringkasan, klasifikasi, dan ekstraksi

Menggunakan AI generatif untuk ringkasan, klasifikasi, dan ekstraksi

Pelajari cara membuat perintah teks untuk menangani sejumlah tugas dengan dukungan AI generatif Vertex AI. Beberapa tugas yang paling umum adalah mengklasifikasi, meringkas, dan mengekstrak. Gemini di Vertex AI memungkinkan Anda mendesain perintah yang fleksibel dalam hal struktur dan formatnya.

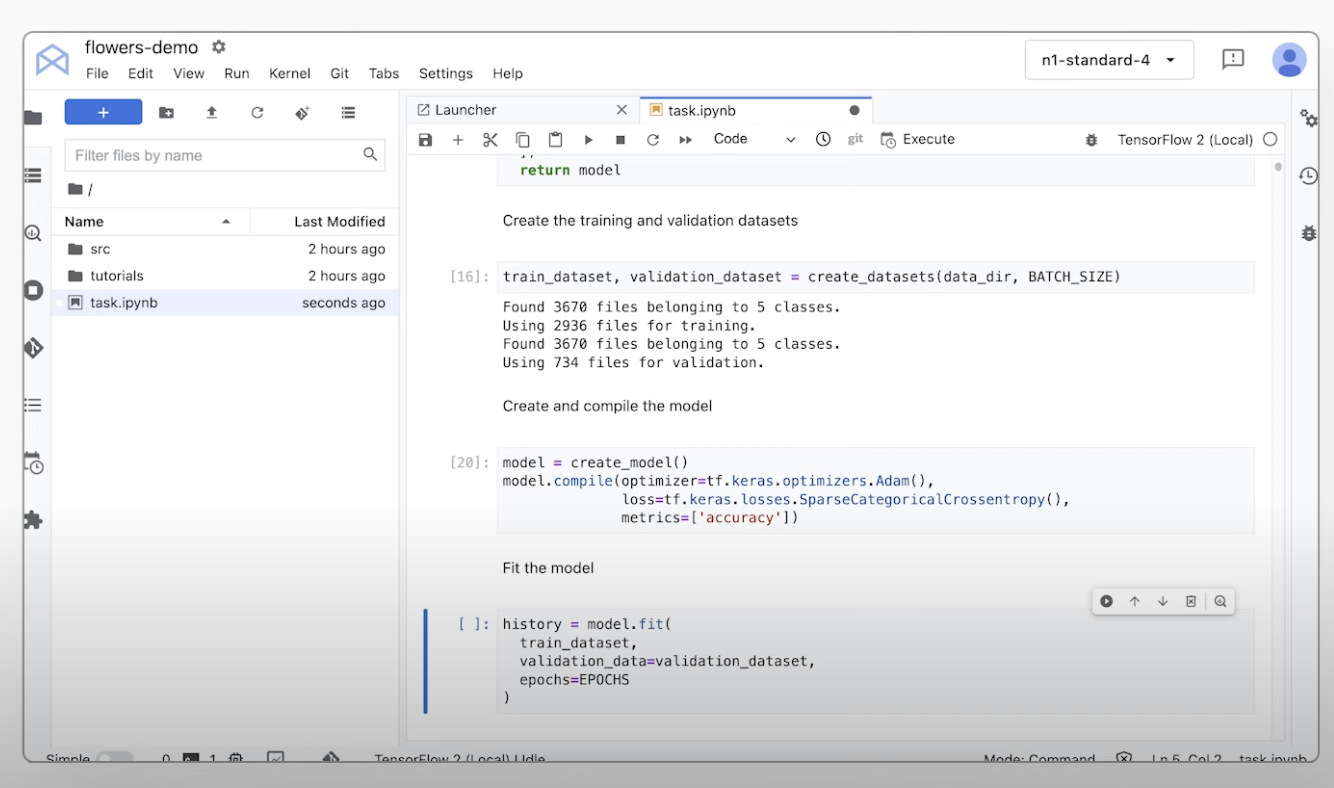

Melatih model ML kustom

Ringkasan dan dokumentasi pelatihan ML kustom

Ringkasan dan dokumentasi pelatihan ML kustom

Dapatkan ringkasan tentang alur kerja pelatihan kustom di Vertex AI, manfaat pelatihan kustom, dan berbagai opsi pelatihan yang tersedia. Halaman ini juga menjelaskan setiap langkah yang terlibat dalam alur kerja pelatihan ML, mulai dari menyiapkan data hingga prediksi.

Dapatkan panduan video tentang langkah-langkah yang diperlukan untuk melatih model kustom di Vertex AI.

Tutorial, panduan memulai, dan lab

Ringkasan dan dokumentasi pelatihan ML kustom

Ringkasan dan dokumentasi pelatihan ML kustom

Dapatkan ringkasan tentang alur kerja pelatihan kustom di Vertex AI, manfaat pelatihan kustom, dan berbagai opsi pelatihan yang tersedia. Halaman ini juga menjelaskan setiap langkah yang terlibat dalam alur kerja pelatihan ML, mulai dari menyiapkan data hingga prediksi.

Dapatkan panduan video tentang langkah-langkah yang diperlukan untuk melatih model kustom di Vertex AI.

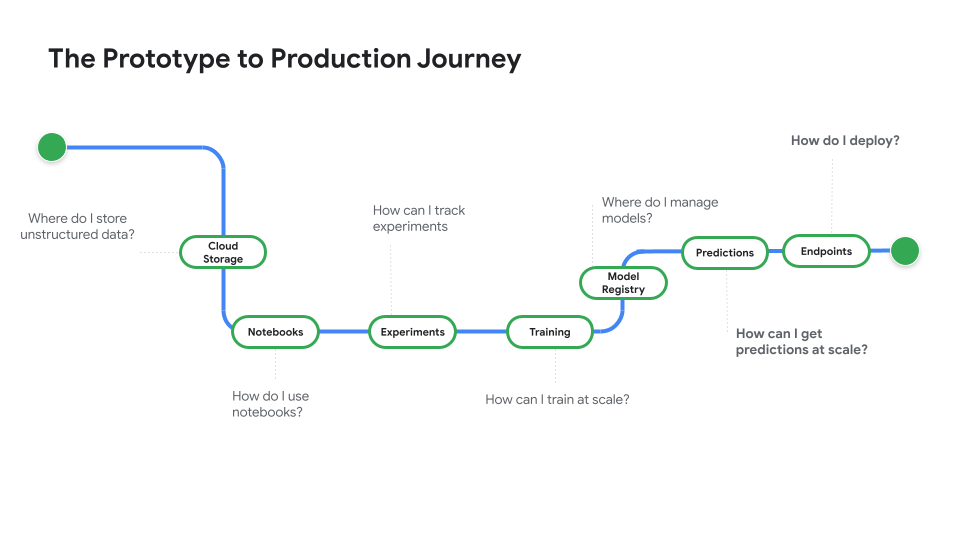

Men-deploy model untuk penggunaan produksi

Men-deploy untuk prediksi batch atau online

Men-deploy untuk prediksi batch atau online

Begitu siap menggunakan model untuk menyelesaikan masalah di dunia nyata, daftarkan model Anda ke Vertex AI Model Registry dan gunakan layanan prediksi Vertex AI untuk prediksi online dan batch.

Tonton Dari Prototipe ke tahap Production, serial video yang membawa Anda dari kode notebook ke model yang di-deploy.

Tutorial, panduan memulai, dan lab

Men-deploy untuk prediksi batch atau online

Men-deploy untuk prediksi batch atau online

Begitu siap menggunakan model untuk menyelesaikan masalah di dunia nyata, daftarkan model Anda ke Vertex AI Model Registry dan gunakan layanan prediksi Vertex AI untuk prediksi online dan batch.

Tonton Dari Prototipe ke tahap Production, serial video yang membawa Anda dari kode notebook ke model yang di-deploy.

Harga

| Cara kerja penetapan harga Vertex AI | Bayar untuk alat, penyimpanan, komputasi, dan resource Cloud Vertex AI yang digunakan. Pelanggan baru mendapatkan kredit gratis senilai $300 untuk mencoba produk Vertex AI dan Google Cloud. | |

|---|---|---|

| Alat dan penggunaan | Deskripsi | Harga |

AI Generatif | Model image untuk pembuatan image Berdasarkan input image, input karakter, atau harga pelatihan kustom. | Mulai dari $0,0001 |

Pembuatan teks, chat, dan kode Berdasarkan setiap 1.000 karakter input (prompt) dan setiap 1.000 karakter output (respons). | Mulai dari $0,0001 per 1.000 karakter | |

Model yang dilatih khusus | Pelatihan model kustom Berdasarkan jenis mesin yang digunakan per jam, region, dan akselerator yang digunakan. Dapatkan perkiraan melalui penjualan atau kalkulator harga kami. | Hubungi bagian penjualan |

Notebook Vertex AI | Resource komputasi dan penyimpanan Berdasarkan tarif yang sama dengan Compute Engine dan Cloud Storage. | Lihat produk |

Biaya pengelolaan Selain penggunaan resource di atas, biaya pengelolaan berlaku berdasarkan region, instance, notebook, dan notebook terkelola yang digunakan. Lihat detail. | Lihat detail | |

Vertex AI Pipelines | Biaya eksekusi dan biaya tambahan Berdasarkan biaya eksekusi, resource yang digunakan, dan biaya layanan tambahan. | Mulai dari $0,03 per operasi pipeline |

Vertex AI Vector Search | Biaya penyajian dan pembuatan Berdasarkan ukuran data Anda, jumlah kueri per detik (QPS) yang ingin dijalankan, dan jumlah node yang Anda gunakan. Lihat contoh. | Lihat contoh |

Lihat detail harga untuk semua fitur dan layanan Vertex AI.

Cara kerja penetapan harga Vertex AI

Bayar untuk alat, penyimpanan, komputasi, dan resource Cloud Vertex AI yang digunakan. Pelanggan baru mendapatkan kredit gratis senilai $300 untuk mencoba produk Vertex AI dan Google Cloud.

AI Generatif

Model image untuk pembuatan image

Berdasarkan input image, input karakter, atau harga pelatihan kustom.

Starting at

$0,0001

Pembuatan teks, chat, dan kode

Berdasarkan setiap 1.000 karakter input (prompt) dan setiap 1.000 karakter output (respons).

Starting at

$0,0001

per 1.000 karakter

Model yang dilatih khusus

Pelatihan model kustom

Berdasarkan jenis mesin yang digunakan per jam, region, dan akselerator yang digunakan. Dapatkan perkiraan melalui penjualan atau kalkulator harga kami.

Hubungi bagian penjualan

Notebook Vertex AI

Resource komputasi dan penyimpanan

Berdasarkan tarif yang sama dengan Compute Engine dan Cloud Storage.

Lihat produk

Biaya pengelolaan

Selain penggunaan resource di atas, biaya pengelolaan berlaku berdasarkan region, instance, notebook, dan notebook terkelola yang digunakan. Lihat detail.

Lihat detail

Vertex AI Pipelines

Biaya eksekusi dan biaya tambahan

Berdasarkan biaya eksekusi, resource yang digunakan, dan biaya layanan tambahan.

Starting at

$0,03

per operasi pipeline

Vertex AI Vector Search

Biaya penyajian dan pembuatan

Berdasarkan ukuran data Anda, jumlah kueri per detik (QPS) yang ingin dijalankan, dan jumlah node yang Anda gunakan. Lihat contoh.

Lihat contoh

Lihat detail harga untuk semua fitur dan layanan Vertex AI.

Mulai bukti konsep Anda

Kasus Bisnis

Memaksimalkan potensi AI generatif

"Akurasi solusi AI generatif Google Cloud dan kepraktisan Vertex AI Platform memberi kami keyakinan yang dibutuhkan untuk menerapkan teknologi canggih ini ke dalam inti bisnis kami dan mencapai sasaran jangka panjang, yaitu waktu respons yang cepat."

Abdol Moabery, CEO GA Telesis

Konten terkait

Bagaimana perujukan model akan membantu Anda memperoleh keunggulan kompetitif.

Baca laporannya

Bagaimana AI generatif menghadirkan kemampuan penelusuran perusahaan yang lebih canggih.

Baca laporannya

Lihat cara pelanggan kami menerapkan AI generatif untuk mentransformasi bisnis mereka.

Pelajari lebih lanjut

Laporan analis

Google dinobatkan sebagai Pemimpin dalam laporan 2025 IDC MarketScape for Worldwide GenAI Life-Cycle Foundation Model Software. Download laporan

Google dinobatkan sebagai Pemimpin dalam laporan Forrester Wave™: AI Foundation Models For Language, Q2 2024. Baca laporannya

Google dinobatkan sebagai pemimpin dalam laporan Forrester Wave™: AI/ML Platforms, Q3 2024. Baca laporannya