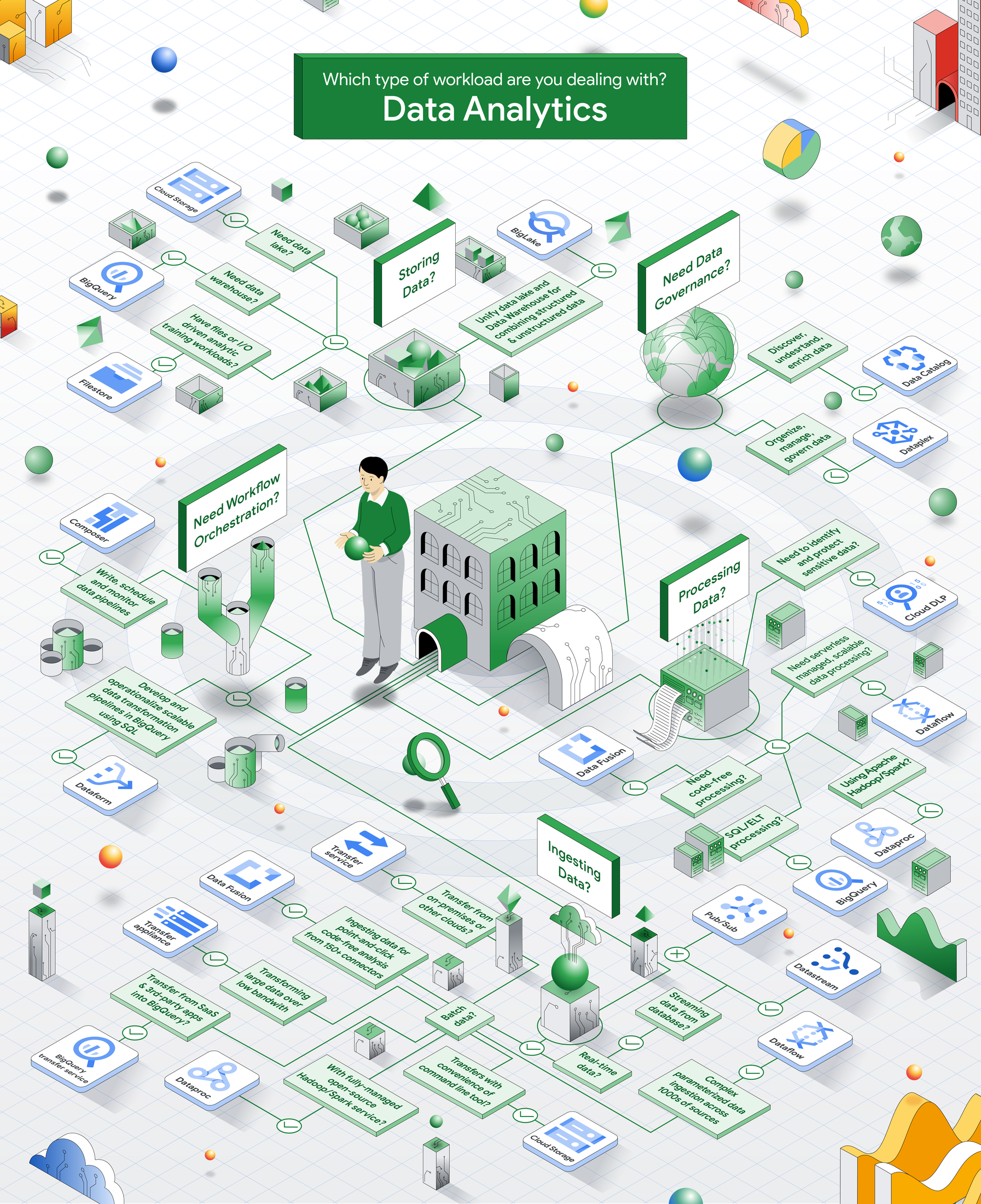

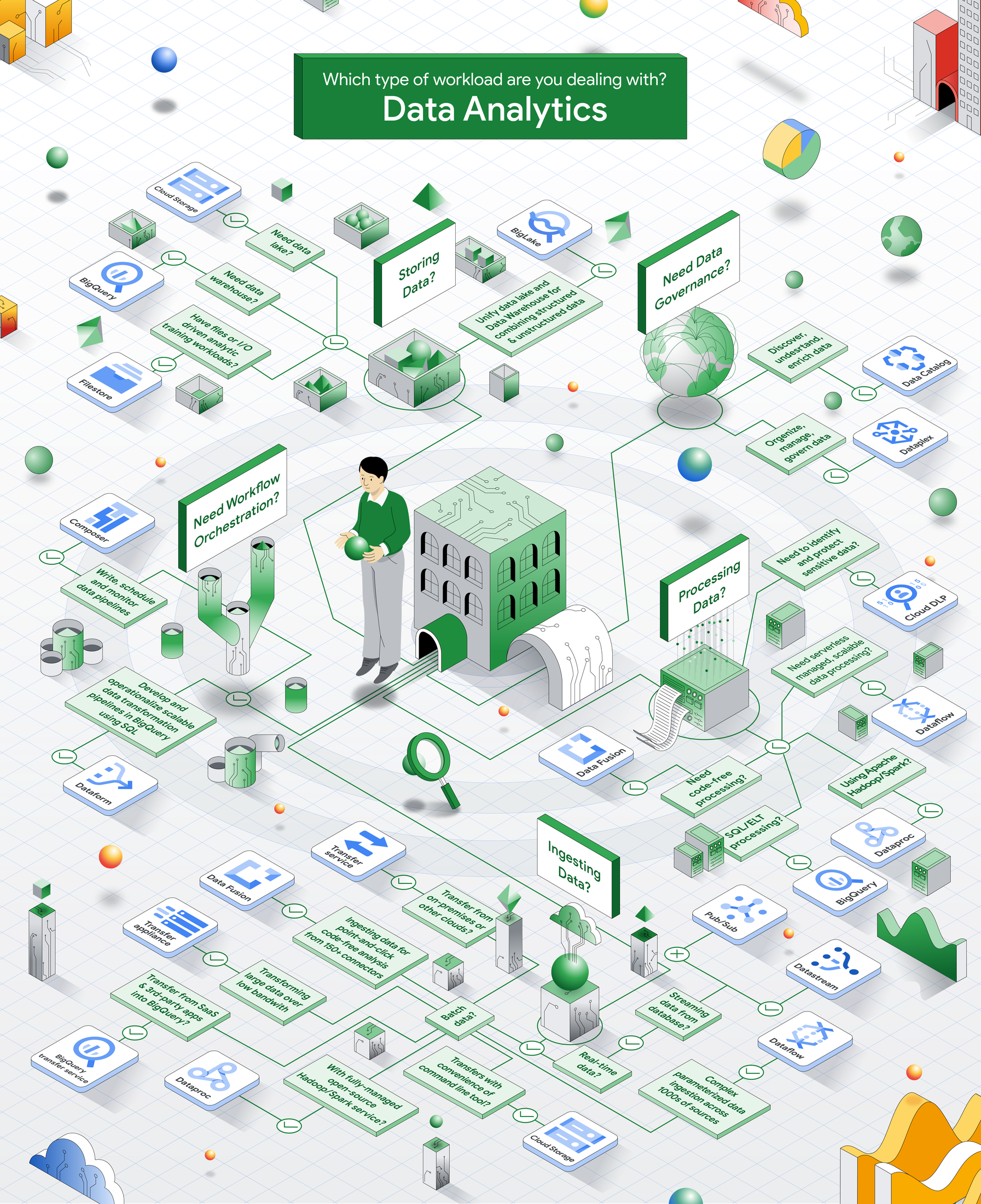

Google Cloud サービスの選択: データと分析のワークロードのデシジョン ツリー

Google Cloud Japan Team

※この投稿は米国時間 2023 年 7 月 26 日に、Google Cloud blog に投稿されたものの抄訳です。

Google Cloud は、データと分析のワークロードを実行するための幅広いサービスを提供しているため、特定のユースケースに適したツールを選択するときには、多くの情報を詳細に検討する必要があります。各ワークロードは、データの取り込みと処理から、保存、ガバナンス、オーケストレーションに至るまで、ワークロード固有のサービス群を必要とします。Google は、意思決定プロセスを簡素化するために、特定のニーズに基づいて最適なサービスを調査、選択するためのロードマップを示す便利なデシジョン ツリーを考案しました。

この投稿では、各ワークロード領域と、それに見合った適切な Google Cloud のサービスの選び方を説明します。

データの取り込み

データと分析のワークフローにおける最初のステップは、データをシステムに取り込むことです。データの取り込みは、データ移行の一環として最初に一括して読み込む場合もあれば、ワークロードが稼働してからも定期的に取り込む必要がある場合もあります。取り込むデータの種類や取り込み元によっては、さまざまなサービスを利用する必要があります。

Pub/Sub は、データが到着するたびにデータを処理、分析する必要がある場合に最適なサービスです。Pub/Sub は、リアルタイムのデータ取り込みのために設計されたフルマネージドのメッセージング サービスで、BigQuery などのデータ処理サービスと直接統合できます。

バッチデータの取り込みには、以下の複数の方法があります。

Cloud Storage: Google Cloud にデータをインポートできる非常に便利な方法として、オブジェクト格納バケットを使用する方法が挙げられます。コマンドライン ツール gsutil を使用すると、クライアントまたは他のバケットからの Cloud Storage バケットへのデータ移行を最適化しながら、最大限の並行処理を実行できます。

Storage Transfer Service: オンプレミスまたは他のクラウドからより大容量のデータを移行する場合は、Storage Transfer Service を使用できます。

Transfer Appliance: 低い帯域幅で大容量のオンプレミス データを移行する必要がある場合、Transfer Appliance を利用することで、Google Cloud に送付する物理デバイスを使用してより安全かつ効率よくデータ移行を行えます。

BigQuery Transfer Service: 特に SaaS またはサードパーティ アプリから BigQuery データ ウェアハウスにデータを取り込む場合は、定評のあるデータソース、スケジューリング機能、モニタリング機能、管理機能にアクセスするためのコネクタが実装された BigQuery Transfer Service を使用できます。

Dataflow: Dataflow を使用すると、その包括的なデータ処理サービスの一部として、何千件に及ぶソース間で大規模、複雑、かつパラメータ化されたデータの取り込みを確実に管理できます。

Dataproc: 100% オープンソースのフルマネージド型 Hadoop / Spark サービスである Dataproc を使用することもできます。Dataproc を使用すると、オンプレミスまたは他のクラウドから、Dataproc Serverless を活用した、すぐに利用可能で構成可能なテンプレートを経由してデータを取り込むことができます。

Data Fusion: Data Fusion では、マウスだけで操作できるインターフェース(およびコード不要の分析ツール)を使用して、150 個以上のコネクタ経由でバッチデータを取り込むことができます。

データ処理

元データを取り込んだら、データをより利用しやすい形式に処理する必要があることもあります。データ処理では、データをより利用しやすく、整理して、理解しやすいようにするためにデータをクリーニング、選別、集約、変換するなどの作業を行います。このために Google Cloud のどのツールを使用するかは、データレーク、データベース、データ ウェアハウスに保存するためのデータの処理をどこで、どのように行うかによって決まります。

Dataflow: Apache Beam のほか、Java、Python、Go などのプログラミング言語を使用してバッチデータとストリーミング データの両方を処理するために、スケーラビリティと信頼性の高いフルマネージド型サーバーレス サービスの利用をご希望の場合は、Dataflow をご利用ください。

Dataproc: Hadoop や Spark のワークロードでは、Dataproc を使用して、Delta、Iceberg、Hudi などの表形式を含む複数のファイル形式で保存されている大容量データを処理できます。

Data Fusion: コード不要の処理が必要な場合は、さまざまな変換タスクに対応する Data Fusion を利用できます。

BigQuery: ワークロードを SQL ベースの ELT 処理で管理できる場合は、サーバーレスで柔軟にスケールでき、費用対効果の高いクラウド データ ウェアハウスである BigQuery を利用できます。

Cloud Data Loss Prevention: Cloud DLP は、機密データの検出、分類、保護を支援するフルマネージド サービスです。データ処理パイプラインの一部として、移行、データ ワークロード、リアルタイムのデータ収集とデータ処理で匿名化をデプロイできます。

データ ストレージ

次に、ビジネス インテリジェンスや ML などの下流のアプリケーションで簡単にデータにアクセスし、データを分析、利用できるよう、データを安全かつ効率よく保存します。Google Cloud にデータを保存する方法は複数あり、どのサービスを選ぶかはユースケースによります。データと分析のワークロードでのデータ保存には、主に以下のサービスを利用できます。

Cloud Storage: データレイクへのデータ保存を開始する場合に手頃なのは Cloud Storage です。Cloud Storage は、スケーラブルで耐久性と可用性の高いオブジェクト保存サービスで、構造化データ、半構造化データ、非構造化データなどのさまざまなデータを保存するために使用されます。デュアルリージョン ストレージにより、低レイテンシで、手動レプリケーション不要の冗長構成を実現し、必要に応じてフェイルオーバーを管理できます。

BigQuery: 構造化データまたは半構造化データ(ネイティブ JSON タイプ、ネスト フィールド)については、BigQuery に保存し、超高速の SQL 分析にアクセスします。

Filestore: I/O 駆動型の分析トレーニング ワークロードなど、ユースケースにより特に高いパフォーマンスと低レイテンシが求められる場合は、Filestore の利用を検討します。

データを BigQuery、Cloud Storage、他のクラウドにまたがって保存できるため、BigLake を使用してデータを統合し、アクセスできるようにしておくことが重要です。BigLake は、複数のデータレイクとデータ ウェアハウスにまたがってデータを統合、管理、分析できるデータアクセス エンジンです。パフォーマンスの向上と、ガバナンスおよび(列と行レベルの)セキュリティの強化を実現します。

ガバナンス

データが正確で、整合性があり、確実に保護され、法規を遵守することを保証するために、データ管理のガイドラインとベスト プラクティスを確立することが、企業にとってますます重要になっています。データ ガバナンスでは、データカタログ、データリネージ、データ品質管理、PII 識別、データアクセス制御などの活動が実施されます。

Dataplex は、こういったタスクを支援し、Google Cloud をはじめとするデータレイク、データ ウェアハウス、データマート全体のガバナンスを一元化します。Dataplex では、フルマネージド型のメタデータ リポジトリである Data Catalogを使用することで、データを検出、理解、充実できます。

Google Cloud のプロダクトには、ガバナンス関連の機能も直接組み込まれます。たとえば、BigQuery は CMEK(顧客管理の暗号鍵)や列レベル、行レベルのセキュリティをサポートしています。この機能は、BigLake のテーブルを介してオブジェクト ストレージにも適用されます。

オーケストレーション

最後に、オーケストレーションにより、ワークフローのさまざまなコンポーネントを調整、管理します。オーケストレーションでは、パイプラインの定義、データ処理ジョブのスケジューリング、データが迅速かつ効率的に処理するためのデータ パイプラインのモニタリングが行われます。

Google Cloud は、以下の 2 つのオーケストレーション サービスを提供しています。

Composer: 上述のデータ処理手段と統合できるこのフルマネージド型 Airflow サービスを使用して、データ パイプラインを記述、スケジューリング、モニタリングできます。

Dataform: SQL を使用して ETL / ELT データ パイプラインを構築、管理したい場合は、Dataform を利用することで、BigQuery にスケーラブルなデータ変換パイプラインを作成し、運用化できます。

データの使用

データ ワークフローを確立したら、次の希望の用途に合わせてデータを利用できます。

高速 SQL 分析を実施したい場合は、BigQuery を利用します。

データを移行せずにデータと分析情報を安全に共有したい場合は、Analytics Hub を利用します。

報告のためにデータを可視化、またはダッシュボードを作成したい場合は、堅牢かつ直感的な BI ツール Looker Studio を利用します。

自身のデータを使用して、特別仕様の ML モデルを作成したい場合は、Vertex AI を使用して、エンドツーエンドで ML ワークフローを統一します。

次のステップ

データおよび分析のワークロードには、さまざまなソースからのデータの取り込みから、データの処理、保存、管理、オーケストレーション、共有まで、複数の段階があります。Google は、お客様のご要望に合った適切なツールとテクノロジーをできるだけ簡単にご確認いただけるようにしたいと考えています。このデシジョン ツリーをブックマークに登録してください。今後他のクラウド ワークロードのデシジョン ツリーも公開しきますのでどうぞお楽しみに。

Cloud Analytics Discord チャンネルにアクセスして、この投稿とディシジョン ツリーに関するご意見をお聞かせください。Innovators と Google Developers Discord に登録しているかご確認ください。

- スタッフ デベロッパー アドボケイト Priyanka Vergadia

- デベロッパー アドボケイト Alicia Williams