O streaming envolve receber respostas a solicitações à medida que são geradas.Ou seja, assim que o modelo gera tokens de saída, eles são enviados.

É possível fazer solicitações de streaming para o modelo de linguagem grande (LLM, na sigla em inglês) da Vertex AI usando o seguinte:

- A API REST da Vertex AI com eventos enviados pelo servidor (SSE)

- A API REST da Vertex AI

- SDK da Vertex AI para Python

- Uma biblioteca cliente

As APIs de streaming e não streaming usam os mesmos parâmetros, e não há diferença de preços e cotas.

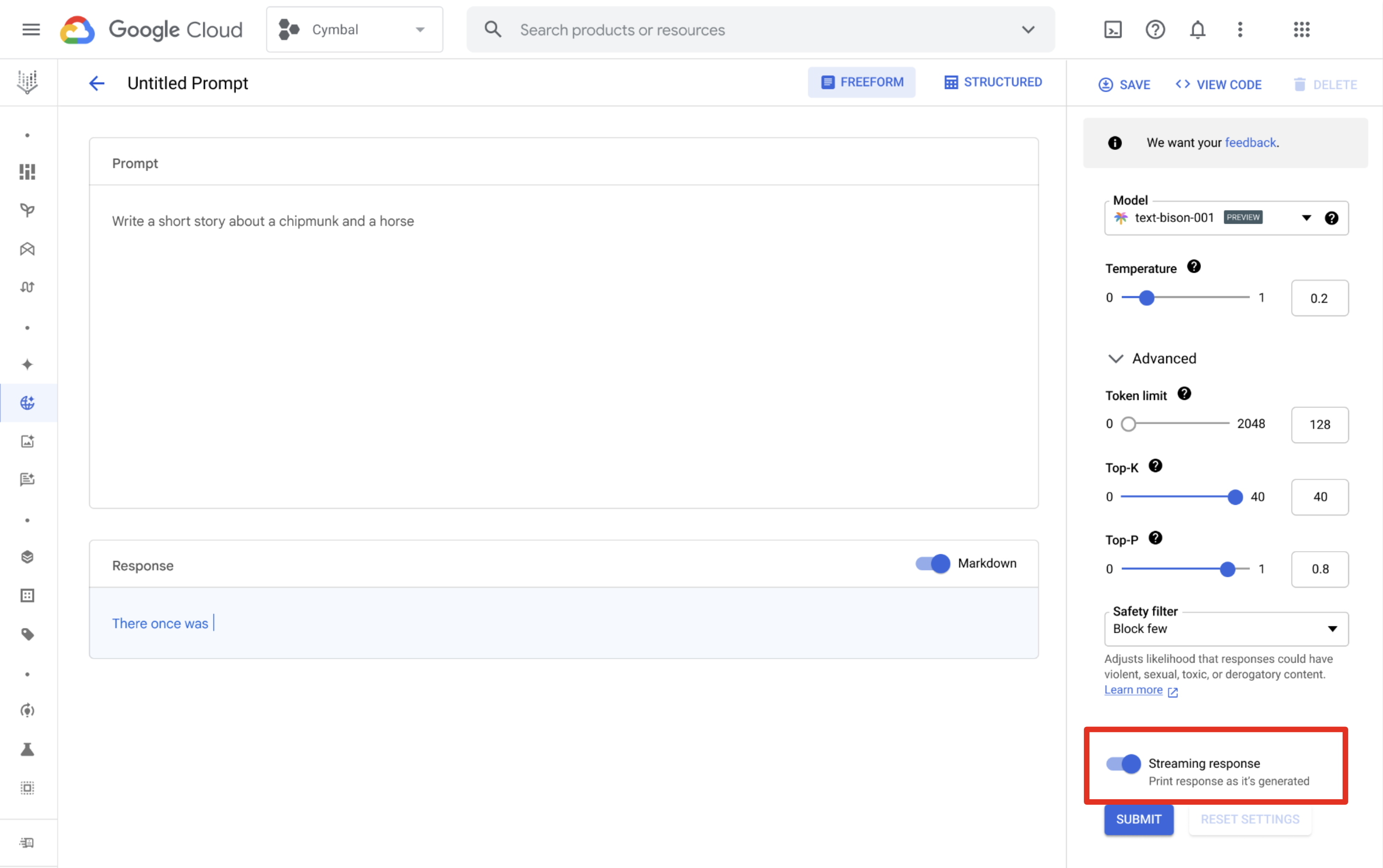

Vertex AI Studio

Use o Vertex AI Studio para projetar e executar comandos e receber as respostas transmitidas. Na página de design da solicitação, clique no botão Streaming Streaming para ativá-lo.

Idiomas compatíveis

| Código do idioma | Idioma |

|---|---|

en |

Inglês |

es |

Espanhol |

pt |

Português |

fr |

Francês |

it |

Italiano |

de |

Alemão |

ja |

Japonês |

ko |

Coreano |

hi |

Hindi |

zh |

Chinês |

id |

Indonésio |

Exemplos

É possível chamar a API Streaming usando uma das seguintes opções:

API REST com eventos enviados pelo servidor (SSE)

Os parâmetros são diferentes entre os tipos de modelo usados nos exemplos a seguir:

Texto

Os modelos com suporte no momento são text-bison e text-unicorn. Veja as versões disponíveis.

Solicitação

PROJECT_ID=YOUR_PROJECT_ID

PROMPT="PROMPT"

MODEL_ID=text-bison

curl \

-X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json" \

https://us-central1-aiplatform.googleapis.com/v1/projects/${PROJECT_ID}/locations/us-central1/publishers/google/models/${MODEL_ID}:serverStreamingPredict?alt=sse -d \

'{

"inputs": [

{

"struct_val": {

"prompt": {

"string_val": [ "'"${PROMPT}"'" ]

}

}

}

],

"parameters": {

"struct_val": {

"temperature": { "float_val": 0.8 },

"maxOutputTokens": { "int_val": 1024 },

"topK": { "int_val": 40 },

"topP": { "float_val": 0.95 }

}

}

}'

Resposta

As respostas são mensagens de evento enviadas pelo servidor.

data: {"outputs": [{"structVal": {"content": {"stringVal": [RESPONSE]},"safetyAttributes": {"structVal": {"blocked": {"boolVal": [BOOLEAN]},"categories": {"listVal": [{"stringVal": [Safety category name]}]},"scores": {"listVal": [{"doubleVal": [Safety category score]}]}}},"citationMetadata": {"structVal": {"citations": {}}}}}]}

Chat

O modelo aceito atualmente é chat-bison. Veja as versões disponíveis.

Solicitação

PROJECT_ID=YOUR_PROJECT_ID

PROMPT="PROMPT"

AUTHOR="USER"

MODEL_ID=chat-bison

curl \

-X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json" \

https://us-central1-aiplatform.googleapis.com/v1/projects/${PROJECT_ID}/locations/us-central1/publishers/google/models/${MODEL_ID}:serverStreamingPredict?alt=sse -d \

$'{

"inputs": [

{

"struct_val": {

"messages": {

"list_val": [

{

"struct_val": {

"content": {

"string_val": [ "'"${PROMPT}"'" ]

},

"author": {

"string_val": [ "'"${AUTHOR}"'"]

}

}

}

]

}

}

}

],

"parameters": {

"struct_val": {

"temperature": { "float_val": 0.5 },

"maxOutputTokens": { "int_val": 1024 },

"topK": { "int_val": 40 },

"topP": { "float_val": 0.95 }

}

}

}'

Resposta

As respostas são mensagens de evento enviadas pelo servidor.

data: {"outputs": [{"structVal": {"candidates": {"listVal": [{"structVal": {"author": {"stringVal": [AUTHOR]},"content": {"stringVal": [RESPONSE]}}}]},"citationMetadata": {"listVal": [{"structVal": {"citations": {}}}]},"safetyAttributes": {"structVal": {"blocked": {"boolVal": [BOOLEAN]},"categories": {"listVal": [{"stringVal": [Safety category name]}]},"scores": {"listVal": [{"doubleVal": [Safety category score]}]}}}}}]}

Código

O modelo aceito atualmente é code-bison. Veja as versões disponíveis.

Solicitação

PROJECT_ID=YOUR_PROJECT_ID

PROMPT="PROMPT"

MODEL_ID=code-bison

curl \

-X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json" \

https://us-central1-aiplatform.googleapis.com/v1/projects/${PROJECT_ID}/locations/us-central1/publishers/google/models/${MODEL_ID}:serverStreamingPredict?alt=sse -d \

$'{

"inputs": [

{

"struct_val": {

"prefix": {

"string_val": [ "'"${PROMPT}"'" ]

}

}

}

],

"parameters": {

"struct_val": {

"temperature": { "float_val": 0.8 },

"maxOutputTokens": { "int_val": 1024 },

"topK": { "int_val": 40 },

"topP": { "float_val": 0.95 }

}

}

}'

Resposta

As respostas são mensagens de evento enviadas pelo servidor.

data: {"outputs": [{"structVal": {"citationMetadata": {"structVal": {"citations": {}}},"safetyAttributes": {"structVal": {"blocked": {"boolVal": [BOOLEAN]},"categories": {"listVal": [{"stringVal": [Safety category name]}]},"scores": {"listVal": [{"doubleVal": [Safety category score]}]}}},"content": {"stringVal": [RESPONSE]}}}]}

Chat de código

O modelo aceito atualmente é codechat-bison. Veja as versões disponíveis.

Solicitação

PROJECT_ID=YOUR_PROJECT_ID

PROMPT="PROMPT"

AUTHOR="USER"

MODEL_ID=codechat-bison

curl \

-X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json" \

https://us-central1-aiplatform.googleapis.com/v1/projects/${PROJECT_ID}/locations/us-central1/publishers/google/models/${MODEL_ID}:serverStreamingPredict?alt=sse -d \

$'{

"inputs": [

{

"struct_val": {

"messages": {

"list_val": [

{

"struct_val": {

"content": {

"string_val": [ "'"${PROMPT}"'" ]

},

"author": {

"string_val": [ "'"${AUTHOR}"'"]

}

}

}

]

}

}

}

],

"parameters": {

"struct_val": {

"temperature": { "float_val": 0.5 },

"maxOutputTokens": { "int_val": 1024 },

"topK": { "int_val": 40 },

"topP": { "float_val": 0.95 }

}

}

}'

Resposta

As respostas são mensagens de evento enviadas pelo servidor.

data: {"outputs": [{"structVal": {"safetyAttributes": {"structVal": {"blocked": {"boolVal": [BOOLEAN]},"categories": {"listVal": [{"stringVal": [Safety category name]}]},"scores": {"listVal": [{"doubleVal": [Safety category score]}]}}},"citationMetadata": {"listVal": [{"structVal": {"citations": {}}}]},"candidates": {"listVal": [{"structVal": {"content": {"stringVal": [RESPONSE]},"author": {"stringVal": [AUTHOR]}}}]}}}]}

API REST

Os parâmetros são diferentes entre os tipos de modelo usados nos exemplos a seguir:

Texto

Os modelos com suporte no momento são text-bison e text-unicorn. Veja as versões disponíveis.

Solicitação

PROJECT_ID=YOUR_PROJECT_ID

PROMPT="PROMPT"

MODEL_ID=text-bison

curl \

-X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json" \

https://us-central1-aiplatform.googleapis.com/v1/projects/${PROJECT_ID}/locations/us-central1/publishers/google/models/${MODEL_ID}:serverStreamingPredict -d \

'{

"inputs": [

{

"struct_val": {

"prompt": {

"string_val": [ "'"${PROMPT}"'" ]

}

}

}

],

"parameters": {

"struct_val": {

"temperature": { "float_val": 0.8 },

"maxOutputTokens": { "int_val": 1024 },

"topK": { "int_val": 40 },

"topP": { "float_val": 0.95 }

}

}

}'

Resposta

{

"outputs": [

{

"structVal": {

"citationMetadata": {

"structVal": {

"citations": {}

}

},

"safetyAttributes": {

"structVal": {

"categories": {},

"scores": {},

"blocked": {

"boolVal": [

false

]

}

}

},

"content": {

"stringVal": [

RESPONSE

]

}

}

}

]

}

Chat

O modelo aceito atualmente é chat-bison. Veja as versões disponíveis.

Solicitação

PROJECT_ID=YOUR_PROJECT_ID

PROMPT="PROMPT"

AUTHOR="USER"

MODEL_ID=chat-bison

curl \

-X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json" \

https://us-central1-aiplatform.googleapis.com/v1/projects/${PROJECT_ID}/locations/us-central1/publishers/google/models/${MODEL_ID}:serverStreamingPredict -d \

$'{

"inputs": [

{

"struct_val": {

"messages": {

"list_val": [

{

"struct_val": {

"content": {

"string_val": [ "'"${PROMPT}"'" ]

},

"author": {

"string_val": [ "'"${AUTHOR}"'"]

}

}

}

]

}

}

}

],

"parameters": {

"struct_val": {

"temperature": { "float_val": 0.5 },

"maxOutputTokens": { "int_val": 1024 },

"topK": { "int_val": 40 },

"topP": { "float_val": 0.95 }

}

}

}'

Resposta

{

"outputs": [

{

"structVal": {

"candidates": {

"listVal": [

{

"structVal": {

"content": {

"stringVal": [

RESPONSE

]

},

"author": {

"stringVal": [

AUTHOR

]

}

}

}

]

},

"citationMetadata": {

"listVal": [

{

"structVal": {

"citations": {}

}

}

]

},

"safetyAttributes": {

"listVal": [

{

"structVal": {

"categories": {},

"blocked": {

"boolVal": [

false

]

},

"scores": {}

}

}

]

}

}

}

]

}

Código

O modelo aceito atualmente é code-bison. Veja as versões disponíveis.

Solicitação

PROJECT_ID=YOUR_PROJECT_ID

PROMPT="PROMPT"

MODEL_ID=code-bison

curl \

-X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json" \

https://us-central1-aiplatform.googleapis.com/v1/projects/${PROJECT_ID}/locations/us-central1/publishers/google/models/${MODEL_ID}:serverStreamingPredict -d \

$'{

"inputs": [

{

"struct_val": {

"prefix": {

"string_val": [ "'"${PROMPT}"'" ]

}

}

}

],

"parameters": {

"struct_val": {

"temperature": { "float_val": 0.8 },

"maxOutputTokens": { "int_val": 1024 },

"topK": { "int_val": 40 },

"topP": { "float_val": 0.95 }

}

}

}'

Resposta

{

"outputs": [

{

"structVal": {

"safetyAttributes": {

"structVal": {

"categories": {},

"scores": {},

"blocked": {

"boolVal": [

false

]

}

}

},

"citationMetadata": {

"structVal": {

"citations": {}

}

},

"content": {

"stringVal": [

RESPONSE

]

}

}

}

]

}

Chat de código

O modelo aceito atualmente é codechat-bison. Veja as versões disponíveis.

Solicitação

PROJECT_ID=YOUR_PROJECT_ID

PROMPT="PROMPT"

AUTHOR="USER"

MODEL_ID=codechat-bison

curl \

-X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json" \

https://us-central1-aiplatform.googleapis.com/v1/projects/${PROJECT_ID}/locations/us-central1/publishers/google/models/${MODEL_ID}:serverStreamingPredict -d \

$'{

"inputs": [

{

"struct_val": {

"messages": {

"list_val": [

{

"struct_val": {

"content": {

"string_val": [ "'"${PROMPT}"'" ]

},

"author": {

"string_val": [ "'"${AUTHOR}"'"]

}

}

}

]

}

}

}

],

"parameters": {

"struct_val": {

"temperature": { "float_val": 0.5 },

"maxOutputTokens": { "int_val": 1024 },

"topK": { "int_val": 40 },

"topP": { "float_val": 0.95 }

}

}

}'

Resposta

{

"outputs": [

{

"structVal": {

"candidates": {

"listVal": [

{

"structVal": {

"content": {

"stringVal": [

RESPONSE

]

},

"author": {

"stringVal": [

AUTHOR

]

}

}

}

]

},

"citationMetadata": {

"listVal": [

{

"structVal": {

"citations": {}

}

}

]

},

"safetyAttributes": {

"listVal": [

{

"structVal": {

"categories": {},

"blocked": {

"boolVal": [

false

]

},

"scores": {}

}

}

]

}

}

}

]

}

SDK da Vertex AI para Python

Para informações sobre como instalar o SDK da Vertex AI para Python, consulte Instalar o SDK da Vertex AI para Python.

Texto

import vertexai

from vertexai.language_models import TextGenerationModel

def streaming_prediction(

project_id: str,

location: str,

) -> str:

"""Streaming Text Example with a Large Language Model"""

vertexai.init(project=project_id, location=location)

text_generation_model = TextGenerationModel.from_pretrained("text-bison")

parameters = {

"temperature": temperature, # Temperature controls the degree of randomness in token selection.

"max_output_tokens": 256, # Token limit determines the maximum amount of text output.

"top_p": 0.8, # Tokens are selected from most probable to least until the sum of their probabilities equals the top_p value.

"top_k": 40, # A top_k of 1 means the selected token is the most probable among all tokens.

}

responses = text_generation_model.predict_streaming(prompt="Give me ten interview questions for the role of program manager.", **parameters)

for response in responses:

`print(response)`

Chat

import vertexai

from vertexai.language_models import ChatModel, InputOutputTextPair

def streaming_prediction(

project_id: str,

location: str,

) -> str:

"""Streaming Chat Example with a Large Language Model"""

vertexai.init(project=project_id, location=location)

chat_model = ChatModel.from_pretrained("chat-bison")

parameters = {

"temperature": 0.8, # Temperature controls the degree of randomness in token selection.

"max_output_tokens": 256, # Token limit determines the maximum amount of text output.

"top_p": 0.95, # Tokens are selected from most probable to least until the sum of their probabilities equals the top_p value.

"top_k": 40, # A top_k of 1 means the selected token is the most probable among all tokens.

}

chat = chat_model.start_chat(

context="My name is Miles. You are an astronomer, knowledgeable about the solar system.",

examples=[

InputOutputTextPair(

input_text="How many moons does Mars have?",

output_text="The planet Mars has two moons, Phobos and Deimos.",

),

],

)

responses = chat.send_message_streaming(

message="How many planets are there in the solar system?", **parameters)

for response in responses:

`print(response)`

Código

import vertexai

from vertexai.language_models import CodeGenerationModel

def streaming_prediction(

project_id: str,

location: str,

) -> str:

"""Streaming Chat Example with a Large Language Model"""

vertexai.init(project=project_id, location=location)

code_model = CodeGenerationModel.from_pretrained("code-bison")

parameters = {

"temperature": 0.8, # Temperature controls the degree of randomness in token selection.

"max_output_tokens": 256, # Token limit determines the maximum amount of text output.

}

responses = code_model.predict_streaming(

prefix="Write a function that checks if a year is a leap year.", **parameters)

for response in responses:

`print(response)`

Chat de código

import vertexai

from vertexai.language_models import CodeChatModel

def streaming_prediction(

project_id: str,

location: str,

) -> str:

"""Streaming Chat Example with a Large Language Model"""

vertexai.init(project=project_id, location=location)

codechat_model = CodeChatModel.from_pretrained("codechat-bison")

parameters = {

"temperature": 0.8, # Temperature controls the degree of randomness in token selection.

"max_output_tokens": 1024, # Token limit determines the maximum amount of text output.

}

codechat = codechat_model.start_chat()

responses = codechat.send_message_streaming(

message="Please help write a function to calculate the min of two numbers", **parameters)

for response in responses:

`print(response)`

Bibliotecas de clientes disponíveis

É possível usar uma das seguintes bibliotecas de cliente para transmitir as respostas:

- Python

- Node.js

- Java

- Go

- C#

Para conferir exemplos de solicitações de código e respostas usando a API REST, consulte Exemplos usando a API REST.

Para ver exemplos de solicitações de código e respostas usando o SDK da Vertex AI para Python, consulte Exemplos que usam o SDK da Vertex AI para Python.

IA responsável

Filtros de inteligência artificial (RAI, na sigla em inglês) responsáveis verificam a saída de streaming conforme o modelo a gera. Se uma violação for detectada, os filtros bloquearão os tokens de saída ofensivos e retornarão uma saída com uma sinalização bloqueada em safetyAttributes, que encerra o stream.

A seguir

- Saiba mais sobre como criar comandos de texto e comandos de chat de texto.

- Saiba como testar comandos no Vertex AI Studio.

- Saiba mais sobre embeddings de texto.

- Tente ajustar um modelo de base da linguagem.

- Saiba mais sobre as práticas recomendadas de IA responsável e os filtros de segurança da Vertex AI.