In dieser Anleitung wird gezeigt, wie Sie mithilfe von Cloud Storage und anderen Google Cloud-Produkten ein automatisiertes System zur Datenquarantäne und -klassifizierung implementieren. Für diese Anleitung wird vorausgesetzt, dass Sie mitGoogle Cloud und der grundlegenden Shell-Programmierung vertraut sind.

In jeder Organisation haben Datenschutzbeauftragte wie Sie mit einer ständig wachsenden Menge von Daten zu tun, die angemessen geschützt und verwaltet werden muss. Angesichts von Hunderten oder Tausenden von Dateien pro Tag kann es kompliziert und zeitaufwendig sein, Daten in Quarantäne zu stellen und zu klassifizieren.

Wie wäre es, wenn Sie jede Datei in ein Quarantäneverzeichnis hochladen und sie dann automatisch klassifizieren und anhand des Klassifizierungsergebnisses an den richtigen Speicherort verschieben lassen könnten? In dieser Anleitung wird beschrieben, wie Sie ein solches System mit Cloud Run-Funktionen, Cloud Storage und Sensitive Data Protection umsetzen können.

Berechtigungen für Dienstkonten gewähren

Im ersten Schritt gewähren Sie Berechtigungen für zwei Dienstkonten: das Cloud Run Functions-Dienstkonto und den Cloud Data Loss Prevention Service Agent.

Berechtigungen für das App Engine-Standarddienstkonto gewähren

Öffnen Sie in der Google Cloud Console die Seite „IAM & Verwaltung“ und wählen Sie das erstellte Projekt aus:

Suchen Sie das App Engine-Dienstkonto. Dieses Konto hat das Format

[PROJECT_ID]@appspot.gserviceaccount.com. Ersetzen Sie[PROJECT_ID]durch Ihre Projekt-ID.Wählen Sie das Bearbeitungssymbol edit neben dem Dienstkonto aus.

Fügen Sie die folgenden Rollen hinzu:

- DLP-Administrator

- DLP API-Dienst-Agent

Klicken Sie auf Speichern.

Berechtigungen für den Cloud Data Loss Prevention-Dienst-Agent erteilen

Der Cloud Data Loss Prevention-Dienst-Agent wird zum ersten Mal erstellt, wenn er benötigt wird.

Erstellen Sie in Cloud Shell den Cloud Data Loss Prevention-Dienst-Agent durch Aufrufen von

InspectContent:curl --request POST

"https://dlp.googleapis.com/v2/projects/PROJECT_ID/locations/us-central1/content:inspect"

--header "X-Goog-User-Project: PROJECT_ID"

--header "Authorization: Bearer $(gcloud auth print-access-token)"

--header 'Accept: application/json'

--header 'Content-Type: application/json'

--data '{"item":{"value":"google@google.com"}}'

--compressedErsetzen Sie

PROJECT_IDdurch Ihre Projekt-ID.Öffnen Sie in der Google Cloud Console die Seite IAM & Verwaltung und wählen Sie das erstellte Projekt aus:

Klicken Sie auf das Kästchen „Von Google bereitgestellte Rollenzuweisungen einschließen“.

Suchen Sie den Cloud Data Loss Prevention-Dienst-Agent. Dieses Konto hat das Format

service-[PROJECT_NUMBER]@dlp-api.iam.gserviceaccount.com. Ersetzen Sie[PROJECT_NUMBER]durch die Projektnummer.Wählen Sie das Bearbeitungssymbol edit neben dem Dienstkonto aus.

Fügen Sie die Rolle Projekt > Betrachter hinzu und klicken Sie auf Speichern.

Quarantäne- und Klassifizierungspipeline erstellen

In diesem Abschnitt erstellen Sie die im folgenden Diagramm dargestellte Quarantäne- und Klassifizierungspipeline.

Die Zahlen in dieser Pipeline entsprechen folgenden Schritten:

- Hochladen der Dateien in Cloud Storage

- Aufrufen einer Funktion von Cloud Functions

- Überprüfung und Klassifizierung der Daten durch Sensitive Data Protection

- Verschieben der Datei in den entsprechenden Bucket

Cloud Storage-Buckets erstellen

Erstellen Sie gemäß den Hinweisen zur Namensgebung für Buckets drei eindeutig benannte Buckets zur Verwendung in dieser Anleitung:

- Bucket 1: Ersetzen Sie

[YOUR_QUARANTINE_BUCKET]durch einen eindeutigen Namen. - Bucket 2: Ersetzen Sie

[YOUR_SENSITIVE_DATA_BUCKET]durch einen eindeutigen Namen. - Bucket 3: Ersetzen Sie

[YOUR_NON_SENSITIVE_DATA_BUCKET]durch einen eindeutigen Namen.

Console

Öffnen Sie in der Google Cloud Console den Cloud Storage-Browser:

Klicken Sie auf Bucket erstellen.

Geben Sie im Textfeld Bucket-Name den Namen ein, den Sie für

[YOUR_QUARANTINE_BUCKET]ausgewählt haben, und klicken Sie auf Erstellen.Wiederholen Sie diesen Vorgang für die Buckets

[YOUR_SENSITIVE_DATA_BUCKET]und[YOUR_NON_SENSITIVE_DATA_BUCKET].

gcloud

Öffnen Sie Cloud Shell:

Erstellen Sie mit folgenden Befehlen drei Buckets:

gcloud storage buckets create gs://[YOUR_QUARANTINE_BUCKET] gcloud storage buckets create gs://[YOUR_SENSITIVE_DATA_BUCKET] gcloud storage buckets create gs://[YOUR_NON_SENSITIVE_DATA_BUCKET]

Pub/Sub-Thema und -Abo erstellen

Konsole

Seite Pub/Sub-Themen öffnen:

Klicken Sie auf Thema erstellen.

Geben Sie in das Textfeld einen Themennamen ein.

Klicken Sie auf das Kästchen Standardabo hinzufügen.

Klicken Sie auf Thema erstellen.

gcloud

Öffnen Sie Cloud Shell:

Erstellen Sie ein Thema und ersetzen Sie dabei

[PUB/SUB_TOPIC]durch einen Namen Ihrer Wahl:gcloud pubsub topics create [PUB/SUB_TOPIC]

Erstellen Sie ein Abo und ersetzen Sie dabei

[PUB/SUB_SUBSCRIPTION]durch einen Namen Ihrer Wahl:gcloud pubsub subscriptions create [PUB/SUB_SUBSCRIPTION] --topic [PUB/SUB_TOPIC]

Cloud Run-Funktionen erstellen

In diesem Abschnitt wird das Bereitstellen des Python-Skripts beschrieben, das die folgenden zwei Cloud Run Functions-Funktionen enthält:

- Eine Funktion, die beim Hochladen eines Objekts in Cloud Storage aktiviert wird.

- Eine Funktion, die bei Eingang einer Nachricht in der Pub/Sub-Warteschlange aufgerufen wird.

Das Python-Skript, das Sie für diese Anleitung verwenden, ist in einem GitHub-Repository enthalten. Um die erste Cloud Functions-Funktion zu erstellen, müssen Sie die richtigen APIs aktivieren.

So aktivieren Sie die APIs:

- Wenn Sie in der Konsole arbeiten, klicken Sie auf Funktion erstellen, um zu erfahren, wie die APIs aktiviert werden, die Sie zur Verwendung von Cloud Functions benötigen.

- Wenn Sie in der gcloud CLI arbeiten, müssen Sie die folgenden APIs manuell aktivieren:

- Artifact Registry API

- Eventarc API

- Cloud Run Admin API

Die erste Funktion erstellen

Console

Öffnen Sie die Seite Cloud Run Functions – Übersicht:

Wählen Sie das Projekt aus, für das Sie Cloud Run Functions aktiviert haben.

Klicken Sie auf Funktion erstellen.

Ersetzen Sie im Textfeld Funktionsname den Standardnamen durch

create_DLP_job.Wählen Sie im Feld Trigger die Option Cloud Storage aus.

Wählen Sie im Feld Ereignistyp die Option Finalisieren/Erstellen aus.

Klicken Sie im Feld Bucket auf Durchsuchen, markieren Sie den Quarantäne-Bucket in der Drop-down-Liste und klicken Sie auf Auswählen.

Klicken Sie auf Speichern.

Klicken Sie auf Weiter.

Wählen Sie unter Laufzeit die Option Python 3.7 aus.

Setzen Sie unter Quellcode ein Häkchen bei Inline-Editor.

Ersetzen Sie den Text im Feld main.py durch den Inhalt der folgenden Datei

https://github.com/GoogleCloudPlatform/dlp-cloud-functions-tutorials/blob/master/gcs-dlp-classification-python/main.py.Ersetzen Sie Folgendes:

[PROJECT_ID_DLP_JOB & TOPIC]: die ID des Projekts, in dem die Cloud Run-Funktion und das Pub/Sub-Thema gehostet werden.[YOUR_QUARANTINE_BUCKET]: der Name des Buckets, in den Sie die zu verarbeitenden Dateien hochladen.[YOUR_SENSITIVE_DATA_BUCKET]: der Name des Buckets, in den Sie vertrauliche Dateien verschieben.[YOUR_NON_SENSITIVE_DATA_BUCKET]: der Name des Buckets, in den Sie die zu verarbeitenden Dateien hochladen.[PUB/SUB_TOPIC]: der Name des Pub/Sub-Themas, das Sie zuvor erstellt haben.

Ersetzen Sie im Textfeld Einstiegspunkt den Standardtext durch Folgendes:

create_DLP_job.Ersetzen Sie den Text im Textfeld requirements.txt durch den Inhalt der folgenden Datei:

https://github.com/GoogleCloudPlatform/dlp-cloud-functions-tutorials/blob/master/gcs-dlp-classification-python/requirements.txt.Klicken Sie auf Bereitstellen.

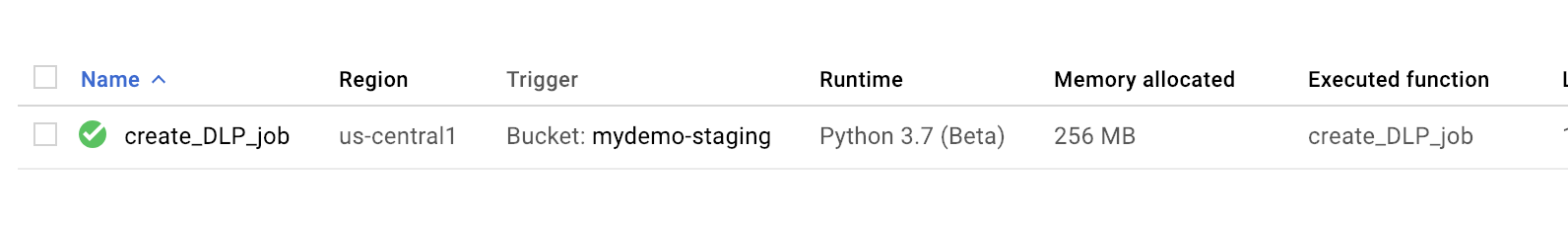

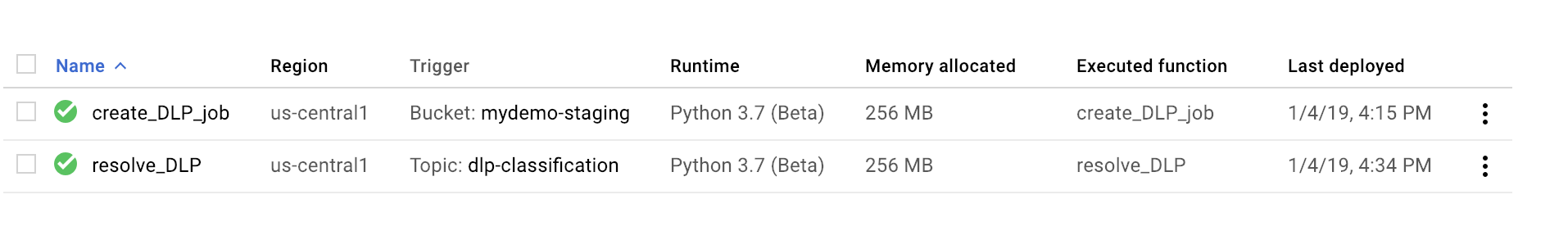

Mit einem grünen Häkchen neben der Funktion wird die erfolgreiche Bereitstellung angezeigt.

gcloud

Öffnen Sie eine Cloud Shell-Sitzung und klonen Sie das GitHub-Repository, das den Code und einige Beispieldatendateien enthält:

Passen Sie die Verzeichnisse gemäß dem Ordner an, in den das Repository geklont wurde:

cd ~dlp-cloud-functions-tutorials/gcs-dlp-classification-python/

Ersetzen Sie in der Datei main.py die folgenden Werte:

[PROJECT_ID_DLP_JOB & TOPIC]: die ID des Projekts, in dem die Cloud Run-Funktion und das Pub/Sub-Thema gehostet werden.[YOUR_QUARANTINE_BUCKET]: der Name des Buckets, in den Sie die zu verarbeitenden Dateien hochladen.[YOUR_SENSITIVE_DATA_BUCKET]: der Name des Buckets, in den Sie vertrauliche Dateien verschieben.[YOUR_NON_SENSITIVE_DATA_BUCKET]: der Name des Buckets, in den Sie die zu verarbeitenden Dateien hochladen.[PUB/SUB_TOPIC: der Name des Pub/Sub-Themas, das Sie zuvor erstellt haben.

Stellen Sie die Funktion bereit und ersetzen Sie dabei

[YOUR_QUARANTINE_BUCKET]durch Ihren Bucket-Namen:gcloud functions deploy create_DLP_job --runtime python37 \ --trigger-resource [YOUR_QUARANTINE_BUCKET] \ --trigger-event google.storage.object.finalizePrüfen Sie, ob die Funktion erfolgreich bereitgestellt wurde:

gcloud functions describe create_DLP_job

Eine erfolgreiche Bereitstellung wird durch einen Bereitschaftsstatus angezeigt, der in etwa so angegeben wird:

status: READY timeout: 60s

Wenn die Cloud Functions-Funktion erfolgreich bereitgestellt wurde, fahren Sie mit dem nächsten Abschnitt fort, um die zweite Cloud Functions-Funktion zu erstellen.

Die zweite Funktion erstellen

Console

Öffnen Sie die Seite Cloud Run Functions – Übersicht:

Wählen Sie das Projekt aus, für das Sie Cloud Run Functions aktiviert haben.

Klicken Sie auf Funktion erstellen.

Ersetzen Sie im Textfeld Funktionsname den Standardnamen durch

resolve_DLP.Wählen Sie im Feld Trigger die Option Pub/Sub aus.

Suchen Sie im Feld Cloud Pub/Sub-Thema auswählen nach dem Pub/Sub-Thema, das Sie zuvor erstellt haben.

Klicken Sie auf Speichern.

Klicken Sie auf Weiter.

Wählen Sie unter Laufzeit die Option Python 3.7 aus.

Wählen Sie unter Quellcode Inline-Editor aus.

Ersetzen Sie im Textfeld Einstiegspunkt den Standardtext durch

resolve_DLP.Ersetzen Sie den Text im Feld main.py durch den Inhalt der folgenden Datei: https://github.com/GoogleCloudPlatform/dlp-cloud-functions-tutorials/blob/master/gcs-dlp-classification-python/main.py. Ersetzen Sie die folgenden Werte:

[PROJECT_ID_DLP_JOB & TOPIC]: die ID des Projekts, in dem die Cloud Run-Funktion und das Pub/Sub-Thema gehostet werden.[YOUR_QUARANTINE_BUCKET]: der Name des Buckets, in den Sie die zu verarbeitenden Dateien hochladen.[YOUR_SENSITIVE_DATA_BUCKET]: der Name des Buckets, in den Sie vertrauliche Dateien verschieben.[YOUR_NON_SENSITIVE_DATA_BUCKET]: der Name des Buckets, in den Sie die zu verarbeitenden Dateien hochladen.[PUB/SUB_TOPIC: der Name des Pub/Sub-Themas, das Sie zuvor erstellt haben.

Klicken Sie auf Bereitstellen.

Mit einem grünen Häkchen neben der Funktion wird die erfolgreiche Bereitstellung angezeigt.

gcloud

Öffnen Sie eine neue oder vorhandene Cloud Shell-Sitzung und klonen Sie das GitHub-Repository, das den Code und einige Beispieldatendateien enthält:

Wechseln Sie in das Verzeichnis mit dem Python-Code:

cd gcs-dlp-classification-python/

Ersetzen Sie in der Datei

main.pydie folgenden Werte:[PROJECT_ID_DLP_JOB & TOPIC]: die ID des Projekts, in dem die Cloud Run-Funktion und das Pub/Sub-Thema gehostet werden.[YOUR_QUARANTINE_BUCKET]: der Name des Buckets, in den Sie die zu verarbeitenden Dateien hochladen.[YOUR_SENSITIVE_DATA_BUCKET]: der Name des Buckets, in den Sie vertrauliche Dateien verschieben.[YOUR_NON_SENSITIVE_DATA_BUCKET]: der Name des Buckets, in den Sie die zu verarbeitenden Dateien hochladen.[PUB/SUB_TOPIC: der Name des Pub/Sub-Themas, das Sie zuvor erstellt haben.

Stellen Sie die Funktion bereit. Ersetzen Sie dabei

[PUB/SUB_TOPIC]durch Ihr Pub/Sub-Thema:gcloud functions deploy resolve_DLP --runtime python37 --trigger-topic [PUB/SUB_TOPIC]

Prüfen Sie, ob die Funktion erfolgreich bereitgestellt wurde:

gcloud functions describe resolve_DLP

Eine erfolgreiche Bereitstellung wird durch einen Bereitschaftsstatus angezeigt, der in etwa so angegeben wird:

status: READY timeout: 60s

Wenn die Cloud Functions-Funktion erfolgreich bereitgestellt wurde, fahren Sie mit dem nächsten Abschnitt fort.

Beispieldateien in den Quarantäne-Bucket hochladen

Das mit diesem Artikel verknüpfte GitHub-Repository enthält Beispieldatendateien. Der Ordner enthält einige Dateien mit sensiblen Daten und andere Dateien mit nicht sensiblen Daten. Als sensibel werden Daten dann klassifiziert, wenn sie mindestens einen der folgenden INFO_TYPES-Werte enthalten:

US_SOCIAL_SECURITY_NUMBER EMAIL_ADDRESS PERSON_NAME LOCATION PHONE_NUMBER

Die Datentypen, die zur Klassifizierung der Beispieldateien verwendet werden, sind in der Datei main.py in der Konstante INFO_TYPES festgelegt, die zu Beginn auf 'FIRST_NAME,PHONE_NUMBER,EMAIL_ADDRESS,US_SOCIAL_SECURITY_NUMBER' gesetzt ist.

Wenn Sie das Repository noch nicht geklont haben, öffnen Sie Cloud Shell und klonen Sie das GitHub-Repository, das den Code und einige Beispieldatendateien enthält:

Passen Sie die Ordner gemäß dem Speicherort der Beispieldatendateien an:

cd ~/dlp-cloud-functions-tutorials/sample_data/

Kopieren Sie die Beispieldatendateien mit dem Befehl

cpin den Quarantäne-Bucket. Ersetzen Sie dabei[YOUR_QUARANTINE_BUCKET]durch den Namen des Quarantäne-Buckets:gcloud storage cp * gs://[YOUR_QUARANTINE_BUCKET]/

Sensitive Data Protection prüft und klassifiziert alle in den Quarantäne-Bucket hochgeladenen Dateien und verschiebt sie entsprechend dieser Klassifizierung in den entsprechenden Ziel-Bucket.

Öffnen Sie in der Cloud Storage-Konsole die Seite Storage-Browser:

Wählen Sie einen der zuvor erstellten Ziel-Buckets aus und überprüfen Sie die hochgeladenen Dateien. Überprüfen Sie die anderen von Ihnen erstellten Buckets ebenfalls.