Cloud Composer 3 | Cloud Composer 2 | Cloud Composer 1

Questa guida spiega come creare una pipeline CI/CD per testare, sincronizzare ed eseguire il deployment dei DAG nel tuo ambiente Cloud Composer dal tuo repository GitHub.

Se vuoi sincronizzare solo i dati di altri servizi, consulta Trasferire i dati da altri servizi.

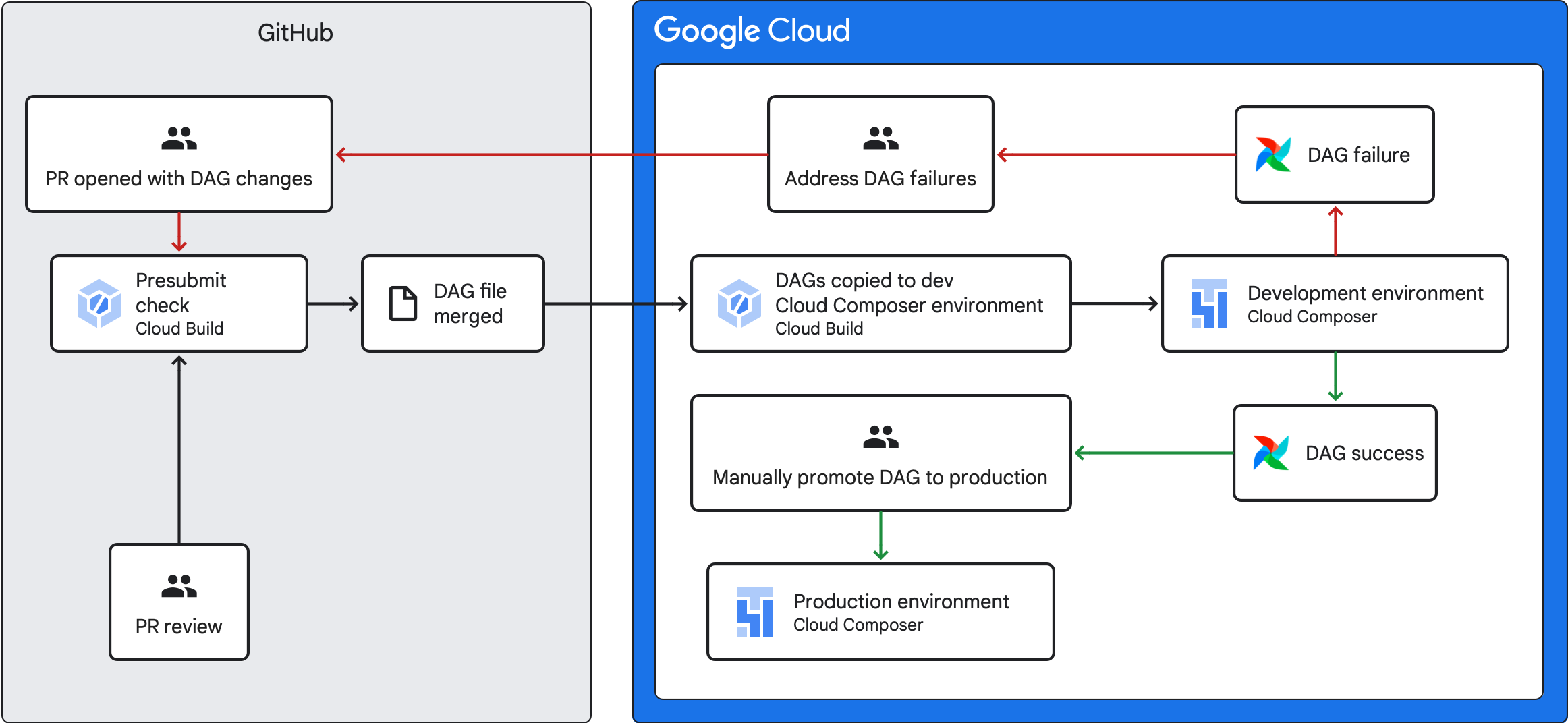

Panoramica della pipeline CI/CD

La pipeline CI/CD per testare, sincronizzare ed eseguire il deployment dei DAG prevede i seguenti passaggi:

Apporta una modifica a un DAG ed esegui il push della modifica in un ramo di sviluppo nel tuo repository.

Apri una richiesta di pull sul ramo principale del tuo repository.

Cloud Build esegue test di unità per verificare la validità del DAG.

La richiesta di pull è stata approvata e unita al ramo principale del repository.

Cloud Build sincronizza il tuo ambiente Cloud Composer di sviluppo con queste nuove modifiche.

Verifica che il DAG si comporti come previsto nell'ambiente di sviluppo.

Se il DAG funziona come previsto, caricalo nell'ambiente Cloud Composer di produzione.

Obiettivi

Prima di iniziare

Questa guida presuppone che tu stia lavorando con due ambienti Cloud Composer identici: un ambiente di sviluppo e un ambiente di produzione.

Ai fini di questa guida, configuri una pipeline CI/CD solo per il tuo ambiente di sviluppo. Assicurati che l'ambiente che utilizzi non sia un ambiente di produzione.

Questa guida presuppone che tu abbia archiviato i DAG e i relativi test in un repository GitHub.

La pipeline CI/CD di esempio mostra i contenuti di un repository di esempio. I DAG e i test vengono memorizzati nella directory

dags/, con i file dei requisiti, il file dei vincoli e i file di configurazione di Cloud Build archiviati a livello superiore. L'utilità di sincronizzazione DAG e i relativi requisiti si trovano nella directoryutils.Questa struttura può essere utilizzata per gli ambienti Airflow 1, Airflow 2, Cloud Composer 1 e Cloud Composer 2.

Crea un job di controllo pre-invio e test di unità

Il primo job Cloud Build esegue un controllo pre-invio, che esegue i test di unità per i DAG.

Aggiungere i test delle unità

Se non l'hai ancora fatto, crea

test di unità per i tuoi DAG. Salva questi test insieme ai DAG nel tuo repository, ciascuno con il suffisso _test. Ad esempio, il file di test per il DAG in example_dag.py è example_dag_test.py. Si tratta dei

test eseguiti come controllo precedente all'invio nel tuo repository.

Crea la configurazione YAML di Cloud Build per il controllo pre-invio

Nel tuo repository, crea un file YAML denominato test-dags.cloudbuild.yaml che configurerà il job Cloud Build per i controlli di preinvio. che prevede tre passaggi:

- Installa le dipendenze necessarie per i DAG.

- Installa le dipendenze necessarie per i test delle unità.

- Esegui i test DAG.

Crea l'attivatore Cloud Build per il controllo pre-invio

Segui la guida Creazione di repository da GitHub per creare un trigger basato sull'app GitHub con le seguenti configurazioni:

Nome:

test-dagsEvento: Pull Request

Origine - Repository: scegli il tuo repository

Origine - Ramo base:

^main$(se necessario, sostituiscimaincon il nome del ramo base del repository)Origine - Controllo commenti: non obbligatorio

Configurazione build - File di configurazione Cloud Build:

/test-dags.cloudbuild.yaml(il percorso del file di build)

Crea un job di sincronizzazione dei DAG e aggiungi lo script di utilità per i DAG

Successivamente, configura un job Cloud Build che esegue uno script di utilità per i DAG. Lo script di utilità in questo job sincronizza i DAG con l'ambiente Cloud Composer dopo che sono stati uniti al branch principale nel repository.

Aggiungi lo script di utilità DAG

Aggiungi lo script di utilità DAG al tuo repository. Questo script di utilità copia tutti i file DAG nella directory dags/ del

repository in una directory temporanea, ignorando tutti i file Python non DAG. Lo script utilizza quindi la libreria client di Cloud Storage per caricare tutti i file da quella directory temporanea alla directory dags/ nel bucket dell'ambiente Cloud Composer.

Crea la configurazione YAML di Cloud Build per la sincronizzazione dei DAG

Nel tuo repository, crea un file YAML denominato

add-dags-to-composer.cloudbuild.yaml che configuri il tuo job Cloud Build per la sincronizzazione dei DAG. che prevede due passaggi:

Installa le dipendenze necessarie allo script di utilità DAG.

Esegui lo script di utilità per sincronizzare i DAG nel tuo repository con il tuo ambiente Cloud Composer.

Crea l'trigger di Cloud Build

Segui la guida Creazione di repository da GitHub per creare un trigger basato sull'app GitHub con le seguenti configurazioni:

Nome:

add-dags-to-composerEvento: push al ramo

Origine - Repository: scegli il tuo repository

Origine - Ramo base:

^main$(se necessario, sostituiscimaincon il nome del ramo base del repository)Origine - Filtro dei file inclusi (glob):

dags/**Configurazione build - File di configurazione Cloud Build:

/add-dags-to-composer.cloudbuild.yaml(il percorso del file di build)

Nella configurazione avanzata, aggiungi due variabili di sostituzione:

_DAGS_DIRECTORY: la directory in cui si trovano i DAG nel repository. Se utilizzi il repository di esempio di questa guida, èdags/._DAGS_BUCKET: il bucket Cloud Storage che contiene la directorydags/nell'ambiente Cloud Composer di sviluppo. Ometti il prefissogs://. Ad esempio:us-central1-example-env-1234ab56-bucket.

Testa la pipeline CI/CD

In questa sezione, segui un flusso di sviluppo DAG che utilizza gli trigger Cloud Build appena creati.

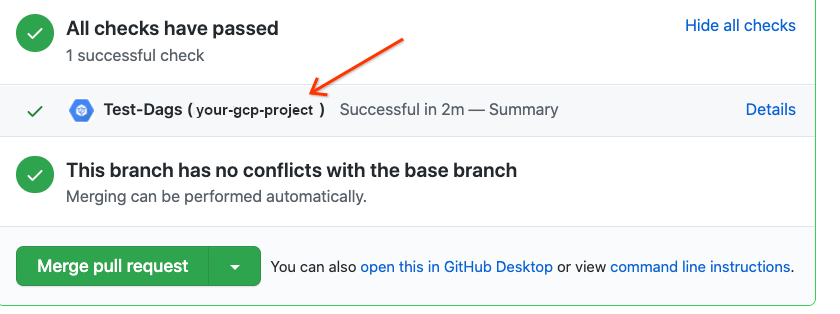

Esegui un job di pre-invio

Crea una richiesta di pull nel ramo principale per testare la compilazione. Individua il controllo preinvio nella pagina. Fai clic su Dettagli e scegli Visualizza altri dettagli su Google Cloud Build per visualizzare i log di build nella console Google Cloud.

Se il controllo precedente all'invio non è andato a buon fine, consulta Risolvere i problemi di compilazione.

Verifica che il DAG funzioni nell'ambiente Cloud Composer di sviluppo

Una volta approvata la richiesta di pull, uniscila al ramo principale. Utilizza la console Google Cloud per visualizzare i risultati della build. Se hai molti trigger Cloud Build, puoi filtrare le build in base al nome dell'triggeradd-dags-to-composer.

Una volta completato il job di sincronizzazione Cloud Build, il DAG sincronizzato viene visualizzato nel tuo ambiente Cloud Composer di sviluppo. Qui puoi verificare che il DAG funzioni come previsto.

Aggiungi il DAG all'ambiente di produzione

Dopo che il DAG funziona come previsto, aggiungilo manualmente all'ambiente di produzione. A tale scopo,

carica il file DAG

nella directory dags/ del bucket dell'ambiente Cloud Composer di produzione.

Se il job di sincronizzazione del DAG non è riuscito o se il DAG non si comporta come previsto nell'ambiente Cloud Composer di sviluppo, consulta Risolvere gli errori di compilazione.

Risolvere gli errori di compilazione

Questa sezione spiega come risolvere gli scenari di errore di compilazione più comuni.

Che cosa succede se il controllo precedente l'invio non è andato a buon fine?

Dalla richiesta di pull, fai clic su Dettagli e scegli Visualizza altri dettagli su Google Cloud Build per visualizzare i log di build nella console Google Cloud. Utilizza questi log per risolvere il problema relativo al DAG. Una volta risolti i problemi, esegui il commit della correzione e esegui il push nel tuo branch. Il controllo di preinvio viene eseguito di nuovo e puoi continuare a eseguire l'iterazione utilizzando i log come strumento di debug.

Cosa succede se il mio job di sincronizzazione DAG non va a buon fine?

Utilizza la console Google Cloud per

visualizzare i risultati della build. Se hai molti trigger Cloud Build, puoi filtrare le build in base al nome dell'triggeradd-dags-to-composer. Esamina i log del job di compilazione e risolvi gli errori. Se hai bisogno di ulteriore assistenza per risolvere gli errori, utilizza i canali di assistenza.

Cosa succede se il mio DAG non funziona correttamente nel mio ambiente Cloud Composer?

Se il DAG non funziona come previsto nell'ambiente Cloud Composer di sviluppo, non promuoverlo manualmente nell'ambiente Cloud Composer di produzione. Esegui invece una delle seguenti operazioni:

- Ripristina la richiesta di pull con le modifiche che hanno danneggiato il DAG per ripristinarlo allo stato immediatamente precedente alle modifiche (in questo modo vengono ripristinati anche tutti gli altri file della richiesta di pull).

- Crea una nuova richiesta pull per ripristinare manualmente le modifiche al DAG non funzionante.

- Crea una nuova richiesta pull per correggere gli errori nel DAG.

Se segui uno di questi passaggi, viene attivato un nuovo controllo di preinvio e, al termine dell'unione, il job di sincronizzazione DAG.