Cloud Composer 3 | Cloud Composer 2 | Cloud Composer 1

En esta página, se explica cómo ajustar los parámetros de rendimiento y escala de tu entorno según las necesidades de tu proyecto para mejorar el rendimiento y reducir los costos de los recursos que no utiliza tu entorno.

Otras páginas sobre la expansión y la optimización:

- Para obtener información sobre cómo escalar tus entornos, consulta Escalado de entornos.

- Para obtener información sobre cómo funciona el escalamiento del entorno, consulta Escalamiento del entorno.

- Si deseas ver un instructivo para supervisar las métricas clave del entorno, consulta Supervisa el estado y el rendimiento del entorno con métricas clave.

Descripción general del proceso de optimización

Realizar cambios en los parámetros de tu entorno puede afectar muchos aspectos de su rendimiento. Te recomendamos que optimices tu entorno en iteraciones:

- Comienza con los ajustes predeterminados del entorno.

- Ejecuta tus DAGs.

- Observa el rendimiento de tu entorno.

- Ajusta los parámetros de escalamiento y rendimiento de tu entorno y, luego, repite el paso anterior.

Comienza con los ajustes predeterminados del entorno

Cuando creas un entorno en la consola de Google Cloud , puedes seleccionar uno de los tres ajustes predeterminados del entorno. Estos ajustes predeterminados establecen la configuración inicial de rendimiento y escalamiento de tu entorno. Después de crear el entorno, puedes cambiar todos los parámetros de rendimiento y escalamiento que proporciona un ajuste predeterminado.

Te recomendamos que comiences con uno de los ajustes predeterminados, según las siguientes estimaciones:

- Cantidad total de DAGs que planeas implementar en el entorno

- Cantidad máxima de ejecuciones simultáneas del DAG

- Cantidad máxima de tareas simultáneas

El rendimiento de tu entorno depende de la implementación de los DAG específicos que ejecutas en él. En la siguiente tabla, se enumeran las estimaciones basadas en el consumo promedio de recursos. Si esperas que tus DAG consuman más recursos, ajusta las estimaciones según corresponda.

| Ajuste predeterminado recomendado | DAGs totales | Cantidad máxima de ejecuciones de DAG simultáneas | Cantidad máxima de tareas simultáneas |

|---|---|---|---|

| Pequeñas | 50 | 15 | 18 |

| Medias | 250 | 60 | 100 |

| Grandes | 1000 | 250 | 400 |

Por ejemplo, un entorno debe ejecutar 40 DAG. Todos los DAG deben ejecutarse al mismo tiempo con una tarea activa cada uno. Luego, este entorno usaría un ajuste predeterminado Medio, ya que la cantidad máxima de ejecuciones y tareas de DAG simultáneas supera las estimaciones recomendadas para el ajuste predeterminado Pequeño.

Ejecuta tus DAG

Una vez que se cree tu entorno, sube tus DAGs a él. Ejecuta tus DAG y observa el rendimiento del entorno.

Te recomendamos que ejecutes tus DAGs según un programa que refleje la aplicación de tus DAGs en la vida real. Por ejemplo, si deseas ejecutar varios DAG al mismo tiempo, asegúrate de verificar el rendimiento de tu entorno cuando todos estos DAG se estén ejecutando de forma simultánea.

Observa el rendimiento de tu entorno

En esta sección, se abordan los aspectos más comunes de ajuste del rendimiento y la capacidad de Cloud Composer 2. Te recomendamos que sigas esta guía paso a paso, ya que primero se abordan las consideraciones de rendimiento más comunes.

Ir al panel de Monitoring

Puedes supervisar las métricas de rendimiento de tu entorno en el panel de supervisión del entorno.

Para ir al panel de Monitoring de tu entorno, haz lo siguiente:

En la consola de Google Cloud , ve a la página Entornos.

Haz clic en el nombre de tu entorno.

Ve a la pestaña Monitoring.

Supervisa las métricas de CPU y memoria del programador

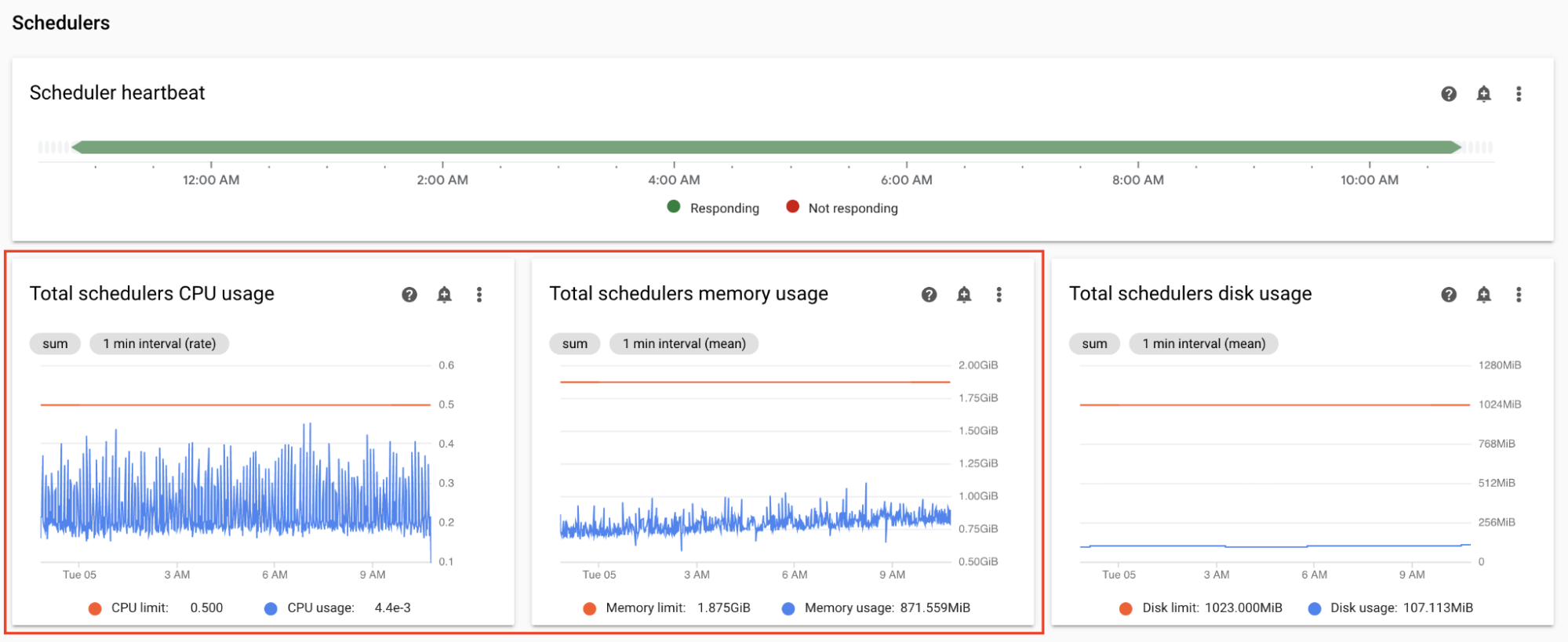

Las métricas de CPU y memoria del programador de Airflow te ayudan a verificar si el rendimiento del programador es un cuello de botella en el rendimiento general de Airflow.

En el panel de Supervisión, en la sección Programadores, observa los grafos de Airflow de tu entorno:

- Uso total de CPU de los programadores

- Uso total de memoria de los programadores

Ajusta la configuración según tus observaciones:

Si el uso de la CPU del programador se mantiene constantemente por debajo del 30% al 35%, es posible que desees hacer lo siguiente:

Si el uso de CPU del programador supera el 80% durante más de un pequeño porcentaje del tiempo total, es posible que desees hacer lo siguiente:

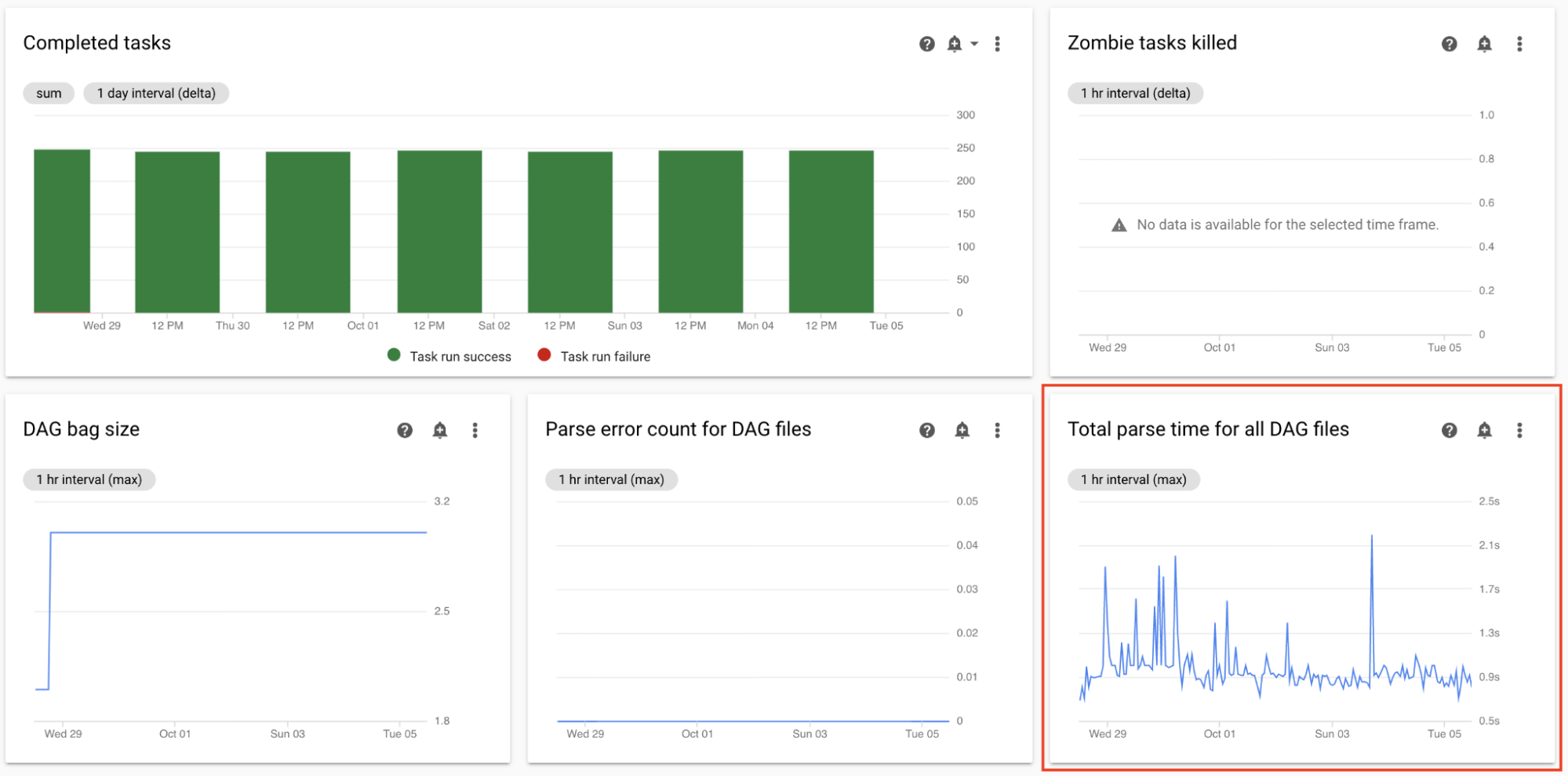

Supervisa el tiempo de análisis total de todos los archivos DAG

Los programadores analizan los DAG antes de programar las ejecuciones de DAG. Si los DAG tardan mucho en analizarse, esto consume la capacidad del programador y podría reducir el rendimiento de las ejecuciones del DAG.

En el panel de Monitoring, en la sección Estadísticas de DAG, observa los gráficos para el tiempo de análisis total del DAG.

Si la cantidad supera los 10 segundos, es posible que tus programadores estén sobrecargados con el análisis de DAG y no puedan ejecutar los DAG de manera eficaz. La frecuencia predeterminada de análisis de DAG en Airflow es de 30 segundos. Si el tiempo de análisis de DAG supera este umbral, los ciclos de análisis comienzan a superponerse, lo que agota la capacidad del programador.

Según tus observaciones, es posible que desees hacer lo siguiente:

- Simplifica tus DAG, incluidas sus dependencias de Python.

- Aumenta el intervalo de análisis del archivo DAG y aumenta el intervalo de la lista de directorios del DAG.

- Aumenta la cantidad de programadores.

- Aumenta la CPU de los programadores.

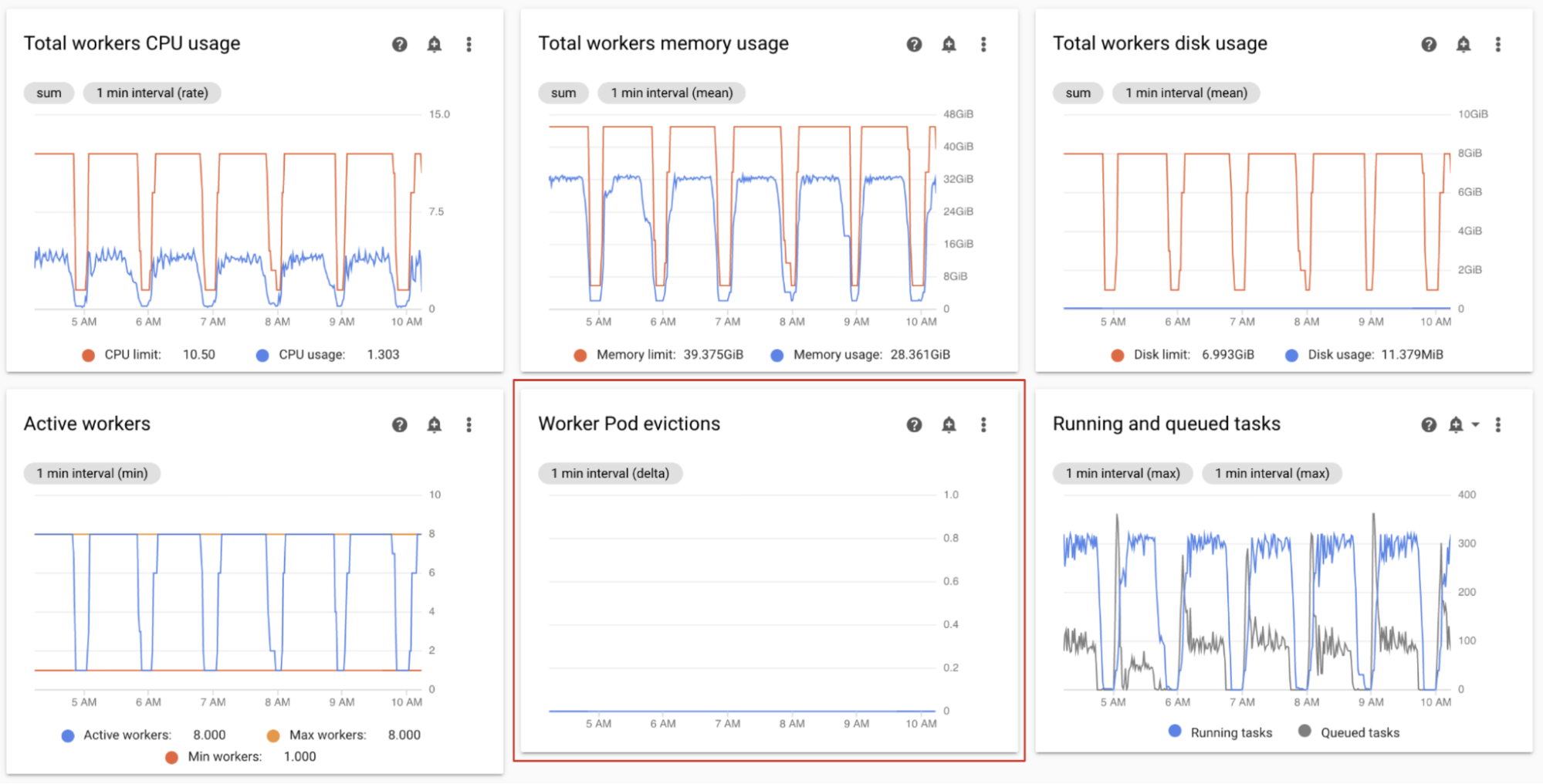

Supervisa las expulsiones de pods de trabajadores

La expulsión de pods puede ocurrir cuando un pod en particular del clúster de tu entorno alcanza sus límites de recursos.

Si se expulsa un pod de trabajador de Airflow, todas las instancias de tareas que se ejecutan en ese pod se interrumpen y, luego, se marcan como con errores en Airflow.

La mayoría de los problemas con las expulsiones de pods de trabajador se deben a situaciones de falta de memoria en los trabajadores.

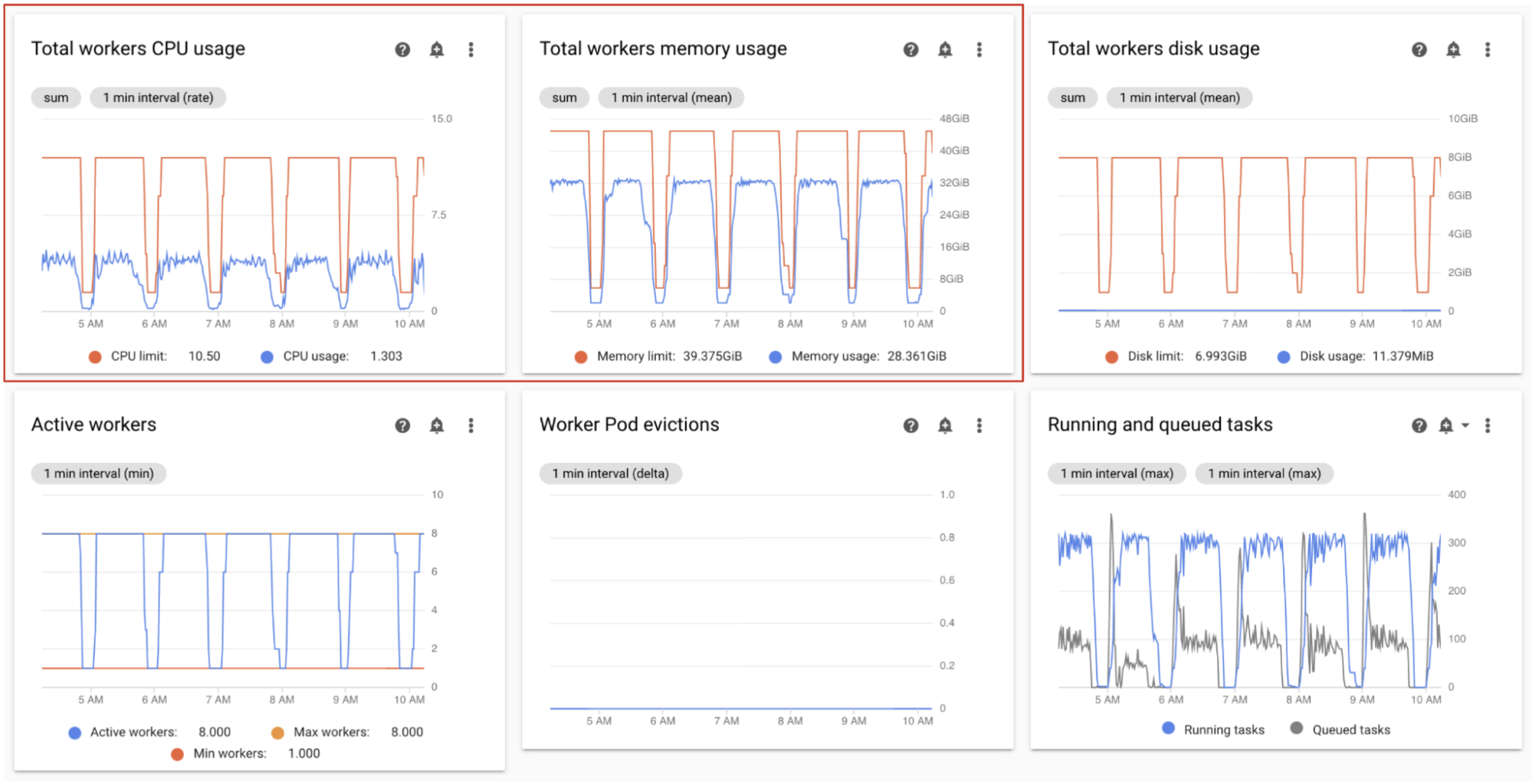

En el panel de Supervisión, en la sección Programadores, observa los gráficos Expulsiones de pods de trabajador de tu entorno:

En el gráfico Uso total de la memoria de trabajadores, se muestra una perspectiva total del entorno. Un solo trabajador puede superar el límite de memoria, incluso si el uso de memoria es adecuado a nivel del entorno.

Según tus observaciones, es posible que desees hacer lo siguiente:

- Aumenta la memoria disponible para los trabajadores.

- Reduce la simultaneidad de los trabajadores. De esta manera, un solo trabajador maneja menos tareas a la vez. Esto proporciona más memoria o almacenamiento a cada tarea individual. Si cambias la simultaneidad de los trabajadores, es posible que también desees aumentar la cantidad máxima de trabajadores. De esta manera, la cantidad de tareas que tu entorno puede controlar a la vez sigue siendo la misma. Por ejemplo, si reduces la simultaneidad de trabajadores de 12 a 6, es posible que desees duplicar la cantidad máxima de trabajadores.

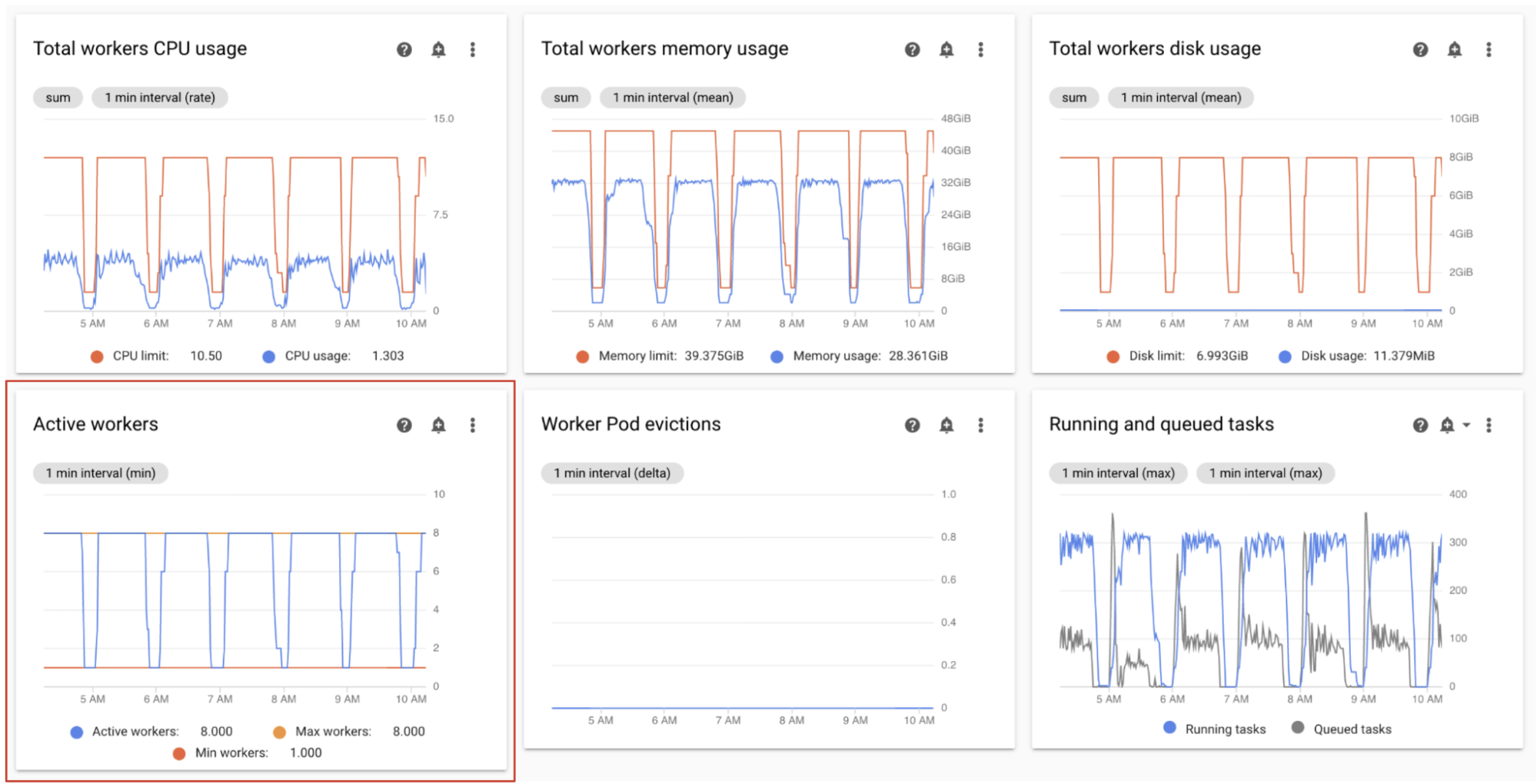

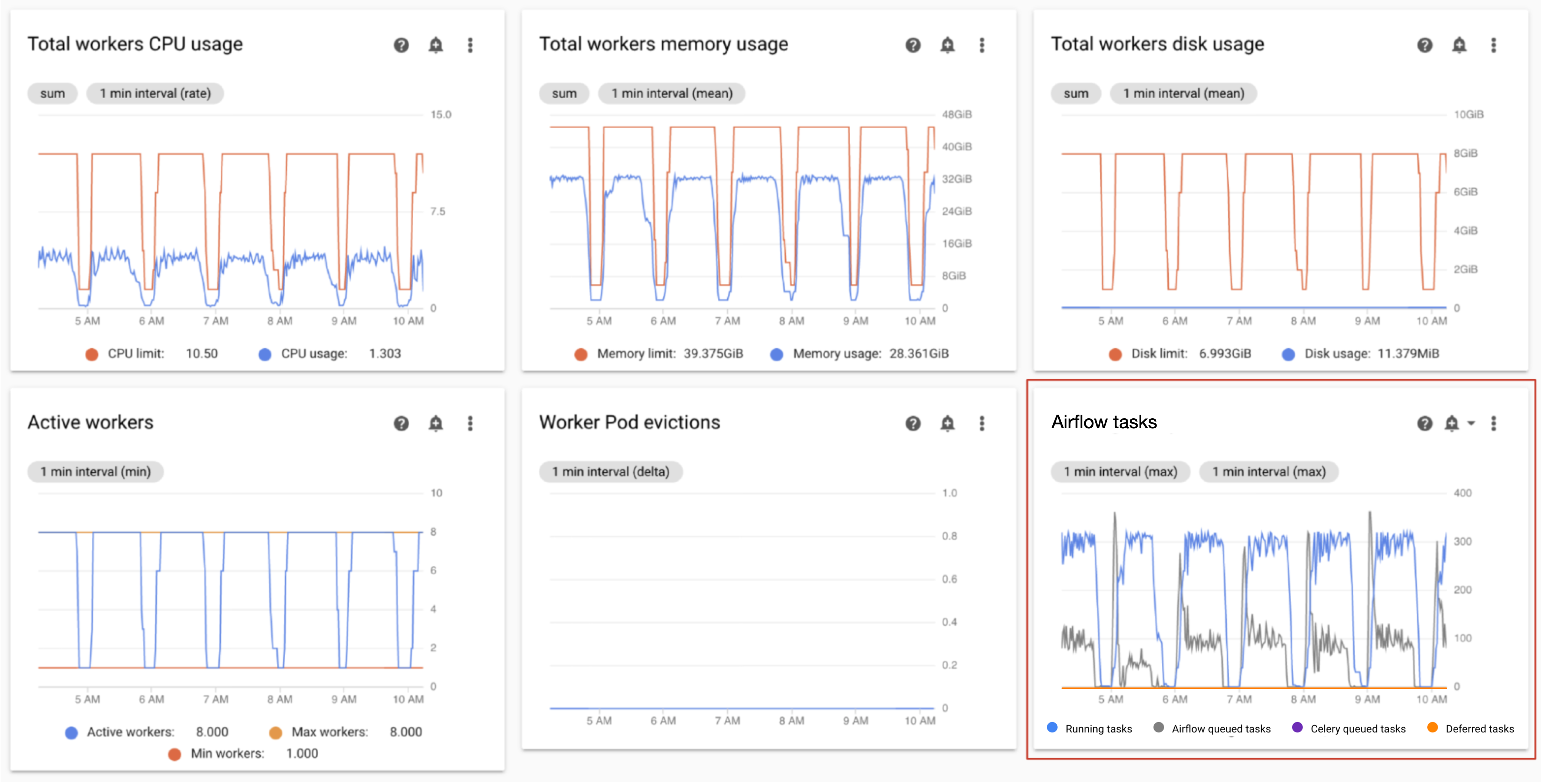

Supervisa a los trabajadores activos

La cantidad de trabajadores en tu entorno se ajusta automáticamente en respuesta a las tareas en cola.

En el panel de Supervisión, en la sección Programadores, observa los gráficos de la cantidad de programadores activos y la cantidad de tareas en la cola:

- Trabajadores activos

- Tareas de Airflow

Ajusta la configuración según tus observaciones:

- Si el entorno alcanza con frecuencia el límite máximo de trabajadores y, al mismo tiempo, la cantidad de tareas en la cola de Celery es continua, es posible que desees aumentar la cantidad máxima de trabajadores.

Si hay retrasos prolongados en la programación entre tareas, pero, al mismo tiempo, el entorno no se ajusta verticalmente a su cantidad máxima de trabajadores, es probable que haya un parámetro de configuración de Airflow que limite la ejecución y evite que los mecanismos de Cloud Composer ajusten el entorno. Dado que los entornos de Cloud Composer 2 se ajustan según la cantidad de tareas en la cola de Celery, configura Airflow para que no limite las tareas que ingresan a la cola:

- Aumenta la simultaneidad de los trabajadores. La simultaneidad de los trabajadores debe establecerse en un valor superior a la cantidad máxima esperada de tareas simultáneas, dividida por la cantidad máxima de trabajadores en el entorno.

- Aumenta la simultaneidad del DAG, si un solo DAG ejecuta una gran cantidad de tareas en paralelo, lo que puede hacer que se alcance la cantidad máxima de instancias de tareas en ejecución por DAG.

- Aumenta la cantidad máxima de ejecuciones activas por DAG, si ejecutas el mismo DAG varias veces en paralelo, lo que puede hacer que Airflow regula la ejecución porque se alcanza el límite máximo de ejecuciones activas por DAG.

Supervisa el uso de CPU y memoria de los trabajadores

Supervisa el uso total de CPU y memoria agregado en todos los trabajadores de tu entorno para determinar si los trabajadores de Airflow utilizan los recursos de tu entorno de forma adecuada.

En el panel de Supervisión, en la sección Programadores, observa los gráficos para el uso de memoria y CPU de los trabajadores de Airflow:

- Uso total de trabajadores de CPU

- Uso total de la memoria de trabajadores

En este gráfico, se representa el uso agregado de recursos; los trabajadores individuales aún pueden alcanzar sus límites de capacidad, incluso si la vista agregada muestra la capacidad libre.

Ajusta la configuración según tus observaciones:

- Si el uso de memoria de los trabajadores se acerca al límite, esto puede provocar expulsiones de pods de trabajador. Para solucionar este problema, aumenta la memoria del trabajador.

- Si el uso de memoria es mínimo en comparación con el límite y no hay expulsiones de pods de trabajadores, es posible que desees disminuir la memoria de los trabajadores.

Si el uso de CPU de los trabajadores se acerca al límite (supera el 80% durante más de un pequeño porcentaje del tiempo total), es posible que desees hacer lo siguiente:

- Aumenta la cantidad de trabajadores. Esto le da a tu entorno más control sobre la capacidad aprovisionada para una carga de trabajo en particular.

- Aumenta la CPU de los trabajadores o reduce la simultaneidad de los trabajadores si las tareas individuales necesitan una mayor asignación de CPU. De lo contrario, te recomendamos que aumentes la cantidad de trabajadores.

Supervisa las tareas en ejecución y en cola

Puedes supervisar la cantidad de tareas en cola y en ejecución para verificar la eficiencia del proceso de programación.

En el panel de Supervisión, en la sección Programadores, observa el gráfico Tareas de Airflow de tu entorno:

Las tareas en la cola están esperando a que los trabajadores las ejecuten. Si tu entorno tiene tareas en cola, es posible que los trabajadores estén ocupados ejecutando otras tareas.

Siempre hay cierta cantidad de filas en un entorno, en especial durante los picos de procesamiento. Sin embargo, si observas una gran cantidad de tareas en cola o una tendencia creciente en el gráfico, esto podría indicar que los trabajadores no tienen suficiente capacidad para procesar las tareas o que Airflow está limitando la ejecución de tareas.

Por lo general, se observa una gran cantidad de tareas en cola cuando la cantidad de tareas en ejecución también alcanza el nivel máximo.

Para abordar ambos problemas, haz lo siguiente:

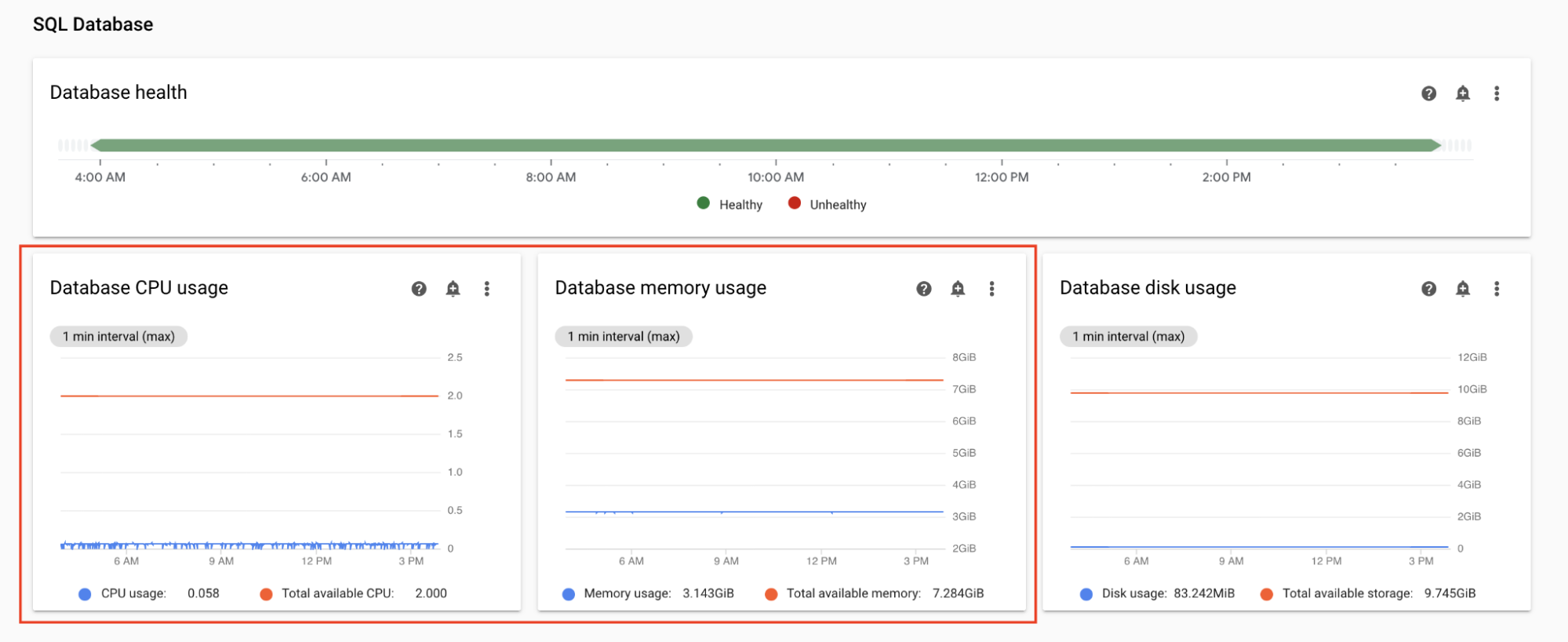

Supervisa el uso de CPU y memoria de la base de datos

Los problemas de rendimiento de la base de datos de Airflow pueden generar problemas generales en la ejecución de los DAG. Por lo general, el uso del disco de la base de datos no es motivo de preocupación, ya que el almacenamiento se extiende automáticamente según sea necesario.

En el panel de Supervisión, en la sección Base de datos SQL, observa los gráficos para el uso de memoria y CPU de la base de datos de Airflow:

- Uso de CPU de la base de datos

- Uso de memoria de la base de datos

Si el uso de CPU de la base de datos supera el 80% durante más de un pequeño porcentaje del tiempo total, la base de datos está sobrecargada y requiere un ajuste de escala.

La configuración del tamaño de la base de datos se controla con la propiedad de tamaño del entorno. Para aumentar o reducir la escala de la base de datos, cambia el tamaño del entorno a un nivel diferente (pequeño, mediano o grande). Aumentar el tamaño del entorno incrementa sus costos.

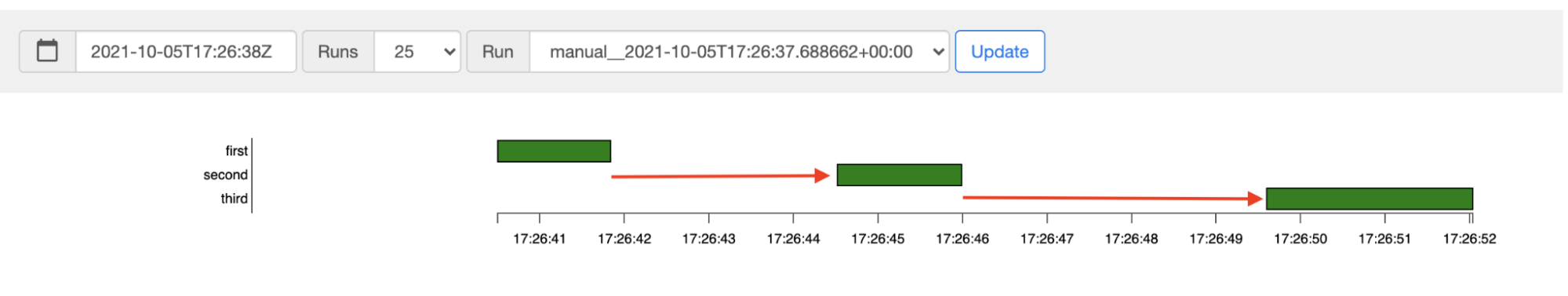

Supervisa la latencia de programación de tareas

Si la latencia entre las tareas supera los niveles esperados (por ejemplo, 20 segundos o más), esto podría indicar que el entorno no puede controlar la carga de tareas generadas por las ejecuciones de DAG.

Puedes ver el gráfico de latencia de programación de tareas en la IU de Airflow de tu entorno.

En este ejemplo, las demoras (2.5 y 3.5 segundos) están dentro de los límites aceptables, pero las latencias significativamente más altas podrían indicar lo siguiente:

- El programador está sobrecargado. Supervisa la CPU y la memoria del programador para detectar indicios de posibles problemas.

- Las opciones de configuración de Airflow limitan la ejecución. Intenta aumentar la simultaneidad de los trabajadores, aumentar la simultaneidad de los DAG o aumentar la cantidad máxima de ejecuciones activas por DAG.

- No hay suficientes trabajadores para ejecutar tareas. Intenta aumentar la cantidad máxima de trabajadores.

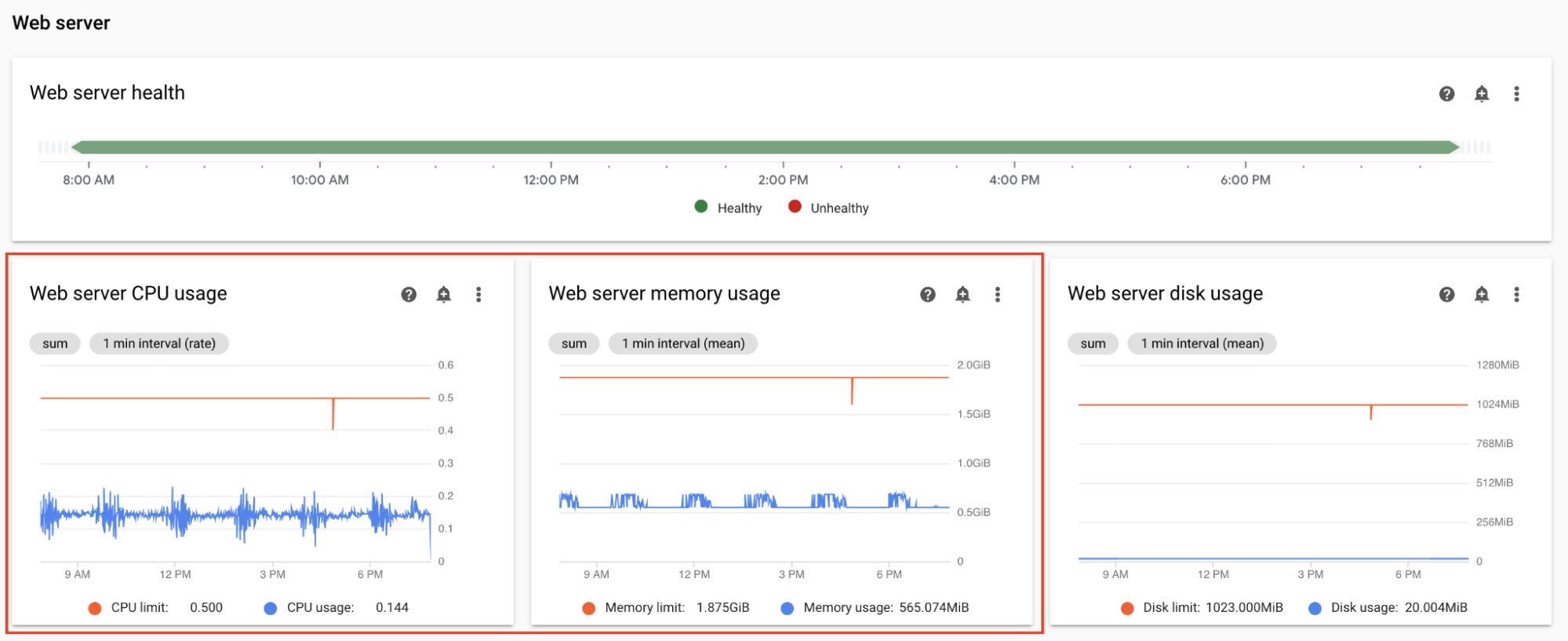

Supervisa la CPU y la memoria del servidor web

El rendimiento del servidor web de Airflow afecta la IU de Airflow. No es común que el servidor web esté sobrecargado. Si esto sucede, es posible que se deteriore el rendimiento de la IU de Airflow, pero esto no afecta el rendimiento de las ejecuciones de DAG.

En el panel de Supervisión, en la sección servidor web, observa los gráficos del servidor web de Airflow:

- Uso de CPU del servidor web

- Uso de memoria del servidor web

Según tus observaciones:

- Si el uso de CPU del servidor web supera el 80% durante más de un pequeño porcentaje del tiempo, considera aumentar la CPU del servidor web.

- Si observas un uso elevado de memoria del servidor web, considera agregar más memoria al servidor web.

Ajusta los parámetros de rendimiento y escalamiento del entorno

Cómo cambiar la cantidad de programadores

Ajustar la cantidad de programadores mejora la capacidad y la resiliencia de la programación de Airflow.

Si aumentas la cantidad de programadores, se incrementará el tráfico hacia y desde la base de datos de Airflow. En la mayoría de los casos, recomendamos usar dos programadores de Airflow. El uso de tres programadores solo es necesario en casos excepcionales que requieren consideraciones especiales. Configurar más de tres programadores suele reducir el rendimiento del entorno.

Si necesitas programar reuniones más rápido, sigue estos pasos:

- Configura dos programadores de Airflow.

- Asigna más recursos de CPU y memoria a los programadores de Airflow.

- Aumenta dag-dir-list-interval

- Aumenta min-file-process-interval

- Aumenta job-heartbeat-sec

Ejemplos:

Console

Sigue los pasos que se indican en Ajusta la cantidad de programadores para establecer la cantidad requerida de programadores para tu entorno.

gcloud

Sigue los pasos que se indican en Ajusta la cantidad de programadores para establecer la cantidad requerida de programadores para tu entorno.

En el siguiente ejemplo, se establece la cantidad de programadores en dos:

gcloud composer environments update example-environment \

--scheduler-count=2

Terraform

Sigue los pasos que se indican en Ajusta la cantidad de programadores para establecer la cantidad requerida de programadores para tu entorno.

En el siguiente ejemplo, se establece la cantidad de programadores en dos:

resource "google_composer_environment" "example-environment" {

# Other environment parameters

config {

workloads_config {

scheduler {

count = 2

}

}

}

}

Cómo cambiar la CPU y la memoria de los programadores

Los parámetros de CPU y memoria son para cada programador de tu entorno. Por ejemplo, si tu entorno tiene dos programadores, la capacidad total es el doble de la cantidad especificada de CPU y memoria.

Console

Sigue los pasos que se indican en Ajusta los parámetros de rendimiento y escalamiento del trabajador, el programador y el servidor web para establecer la CPU y la memoria de los programadores.

gcloud

Sigue los pasos que se indican en Ajusta los parámetros de rendimiento y escalamiento del trabajador, el programador y el servidor web para establecer la CPU y la memoria de los programadores.

En el siguiente ejemplo, se cambian la CPU y la memoria de los programadores. Puedes especificar solo atributos de CPU o memoria, según la necesidad.

gcloud composer environments update example-environment \

--scheduler-cpu=0.5 \

--scheduler-memory=3.75

Terraform

Sigue los pasos que se indican en Ajusta los parámetros de rendimiento y escalamiento del trabajador, el programador y el servidor web para establecer la CPU y la memoria de los programadores.

En el siguiente ejemplo, se cambian la CPU y la memoria de los programadores. Puedes omitir los atributos de CPU o memoria, según sea necesario.

resource "google_composer_environment" "example-environment" {

# Other environment parameters

config {

workloads_config {

scheduler {

cpu = "0.5"

memory_gb = "3.75"

}

}

}

}

Cómo cambiar la cantidad máxima de trabajadores

Si aumentas la cantidad máxima de trabajadores, tu entorno podrá ajustarse automáticamente a una mayor cantidad de trabajadores, si es necesario.

Disminuir la cantidad máxima de trabajadores reduce la capacidad máxima del entorno, pero también puede ser útil para reducir los costos del entorno.

Ejemplos:

Console

Sigue los pasos que se indican en Ajusta la cantidad mínima y máxima de trabajadores para establecer la cantidad máxima de trabajadores requerida para tu entorno.

gcloud

Sigue los pasos que se indican en Ajusta la cantidad mínima y máxima de trabajadores para establecer la cantidad máxima de trabajadores requerida para tu entorno.

En el siguiente ejemplo, se establece la cantidad máxima de trabajadores en seis:

gcloud composer environments update example-environment \

--max-workers=6

Terraform

Sigue los pasos que se indican en Ajusta la cantidad mínima y máxima de trabajadores para establecer la cantidad máxima de trabajadores requerida para tu entorno.

En el siguiente ejemplo, se establece la cantidad máxima de programadores en seis:

resource "google_composer_environment" "example-environment" {

# Other environment parameters

config {

workloads_config {

worker {

max_count = "6"

}

}

}

}

Cómo cambiar la CPU y la memoria del trabajador

Disminuir la memoria del trabajador puede ser útil cuando el gráfico de uso del trabajador indica un uso de memoria muy bajo.

Aumentar la memoria de los trabajadores les permite controlar más tareas de forma simultánea o controlar tareas que requieren mucha memoria. Podría solucionar el problema de desalojos de pods de trabajadores.

Disminuir la CPU del trabajador puede ser útil cuando el gráfico de uso de la CPU del trabajador indica que los recursos de CPU están muy sobreasignados en general.

Aumentar la CPU de los trabajadores permite que estos controlen más tareas de forma simultánea y, en algunos casos, reduce el tiempo que lleva procesarlas.

Cambiar la CPU o la memoria del trabajador reinicia los trabajadores, lo que podría afectar las tareas en ejecución. Te recomendamos que lo hagas cuando no se estén ejecutando DAGs.

Los parámetros de CPU y memoria son para cada trabajador de tu entorno. Por ejemplo, si tu entorno tiene cuatro trabajadores, la capacidad total es cuatro veces la cantidad especificada de CPU y memoria.

Console

Sigue los pasos que se indican en Ajusta los parámetros de rendimiento y escalamiento del trabajador, el programador y el servidor web para establecer la CPU y la memoria de los trabajadores.

gcloud

Sigue los pasos que se indican en Ajusta los parámetros de rendimiento y escalamiento del trabajador, el programador y el servidor web para establecer la CPU y la memoria de los trabajadores.

En el siguiente ejemplo, se cambian la CPU y la memoria de los trabajadores. Si es necesario, puedes omitir el atributo de CPU o memoria.

gcloud composer environments update example-environment \

--worker-memory=3.75 \

--worker-cpu=2

Terraform

Sigue los pasos que se indican en Ajusta los parámetros de rendimiento y escalamiento del trabajador, el programador y el servidor web para establecer la CPU y la memoria de los trabajadores.

En el siguiente ejemplo, se cambian la CPU y la memoria de los trabajadores. Si es necesario, puedes omitir el parámetro de CPU o memoria.

resource "google_composer_environment" "example-environment" {

# Other environment parameters

config {

workloads_config {

worker {

cpu = "2"

memory_gb = "3.75"

}

}

}

}

Cómo cambiar la CPU y la memoria del servidor web

Disminuir la CPU o la memoria del servidor web puede ser útil cuando el gráfico de uso del servidor web indica que se subutiliza de forma continua.

Cambiar los parámetros del servidor web reinicia el servidor web, lo que provoca un tiempo de inactividad temporal. Te recomendamos que realices los cambios fuera de las horas de uso habitual.

Console

Sigue los pasos que se indican en Ajusta los parámetros de rendimiento y escalamiento del trabajador, el programador y el servidor web para configurar la CPU y la memoria del servidor web.

gcloud

Sigue los pasos que se indican en Ajusta los parámetros de rendimiento y escalamiento del trabajador, el programador y el servidor web para configurar la CPU y la memoria del servidor web.

En el siguiente ejemplo, se cambian la CPU y la memoria del servidor web. Puedes omitir los atributos de CPU o memoria, según sea necesario.

gcloud composer environments update example-environment \

--web-server-cpu=2 \

--web-server-memory=3.75

Terraform

Sigue los pasos que se indican en Ajusta los parámetros de rendimiento y escalamiento del trabajador, el programador y el servidor web para configurar la CPU y la memoria del servidor web.

En el siguiente ejemplo, se cambian la CPU y la memoria del servidor web. Puedes omitir los atributos de CPU o memoria, según sea necesario.

resource "google_composer_environment" "example-environment" {

# Other environment parameters

config {

workloads_config {

web_server {

cpu = "2"

memory_gb = "3.75"

}

}

}

}

Cómo cambiar el tamaño del entorno

Cambiar el tamaño del entorno modifica la capacidad de los componentes de backend de Cloud Composer, como la base de datos y la cola de Airflow.

- Considera cambiar el tamaño del entorno a uno más pequeño (por ejemplo, de grande a mediano o de mediano a pequeño) cuando las métricas de uso de la base de datos muestren una subutilización considerable.

Considera aumentar el tamaño del entorno si observas un uso elevado de la base de datos de Airflow.

Console

Sigue los pasos que se indican en Ajusta el tamaño del entorno para establecer el tamaño del entorno.

gcloud

Sigue los pasos que se indican en Ajusta el tamaño del entorno para establecer el tamaño del entorno.

En el siguiente ejemplo, se cambia el tamaño del entorno a Medio.

gcloud composer environments update example-environment \

--environment-size=medium

Terraform

Sigue los pasos que se indican en Ajusta el tamaño del entorno para establecer el tamaño del entorno.

En el siguiente ejemplo, se cambia el tamaño del entorno a Medio.

resource "google_composer_environment" "example-environment" {

# Other environment parameters

config {

environment_size = "medium"

}

}

Cómo cambiar el intervalo de la lista de directorios del DAG

Aumentar el intervalo de la lista de directorios de DAG reduce la carga del programador asociada con el descubrimiento de DAG nuevos en el bucket del entorno.

- Considera aumentar este intervalo si implementas DAG nuevos con poca frecuencia.

- Considera disminuir este intervalo si quieres que Airflow reaccione más rápido a los archivos DAG recién implementados.

Para cambiar este parámetro, anula la siguiente opción de configuración de Airflow:

| Sección | Clave | Valor | Notas |

|---|---|---|---|

scheduler |

dag_dir_list_interval |

Valor nuevo para el intervalo de publicación | El valor predeterminado, en segundos, es 120. |

Cómo cambiar el intervalo de análisis del archivo DAG

Aumentar el intervalo de análisis de archivos DAG reduce la carga del programador asociada con el análisis continuo de los DAG en la bolsa de DAG.

Considera aumentar este intervalo cuando tengas una gran cantidad de DAG que no cambian con demasiada frecuencia o cuando observes una carga alta del programador en general.

Para cambiar este parámetro, anula la siguiente opción de configuración de Airflow:

| Sección | Clave | Valor | Notas |

|---|---|---|---|

scheduler |

min_file_process_interval |

Nuevo valor para el intervalo de análisis del DAG | El valor predeterminado, en segundos, es 30. |

Simultaneidad de trabajadores

El rendimiento de la simultaneidad y la capacidad de tu entorno para ajustarse automáticamente están relacionados con dos parámetros de configuración:

- La cantidad mínima de trabajadores de Airflow

- El parámetro

[celery]worker_concurrency

Los valores predeterminados que proporciona Cloud Composer son óptimos para la mayoría de los casos de uso, pero tu entorno podría beneficiarse de ajustes personalizados.

Consideraciones sobre el rendimiento de la simultaneidad de los trabajadores

El parámetro [celery]worker_concurrency define la cantidad de tareas que un solo trabajador puede tomar de la lista de tareas en cola.

La velocidad de ejecución de la tarea depende de varios factores, como la CPU del trabajador, la memoria y el tipo de trabajo en sí.

Ajuste de escala automático de trabajadores

Cloud Composer supervisa la lista de tareas en cola y genera trabajadores adicionales para tomar las tareas en espera. Establecer [celery]worker_concurrency en un valor alto significa que cada trabajador puede tomar muchas tareas, por lo que, en ciertas circunstancias, es posible que la fila nunca se llene, lo que hace que el ajuste de escala automático nunca se active.

Por ejemplo, en un entorno de Cloud Composer con dos trabajadores de Airflow, [celery]worker_concurrency establecido en 100 y 200 tareas en la cola, cada trabajador tomaría 100 tareas. Esto deja la cola vacía y no activa el ajuste de escala automático. Si estas tareas tardan mucho en completarse, esto podría generar problemas de rendimiento.

Sin embargo, si las tareas son pequeñas y rápidas de ejecutar, un valor alto en el parámetro de configuración [celery]worker_concurrency podría generar un escalamiento demasiado entusiasta.

Por ejemplo, si ese entorno tiene 300 tareas en la cola, Cloud Composer comienza a crear trabajadores nuevos. Sin embargo, si las primeras 200 tareas terminan de ejecutarse cuando los trabajadores nuevos están listos, un trabajador existente puede tomarlas. El resultado final es que el ajuste de escala automático crea trabajadores nuevos, pero no hay tareas para ellos.

El ajuste de [celery]worker_concurrency para casos especiales debe basarse en los tiempos máximos de ejecución de tareas y los números de la cola:

- En el caso de las tareas que tardan más en completarse, los trabajadores no deberían poder vaciar la fila por completo.

- Para tareas más rápidas y pequeñas, aumenta la cantidad mínima de trabajadores de Airflow para evitar un escalamiento excesivo.

Sincronización de registros de tareas

Los trabajadores de Airflow incluyen un componente que sincroniza los registros de ejecución de tareas con los buckets de Cloud Storage. Una gran cantidad de tareas simultáneas realizadas por un solo trabajador genera una gran cantidad de solicitudes de sincronización. Esto podría sobrecargar tu trabajador y generar problemas de rendimiento.

Si observas problemas de rendimiento debido a una gran cantidad de tráfico de sincronización de registros, reduce los valores de [celery]worker_concurrency y, en su lugar, ajusta la cantidad mínima de trabajadores de Airflow.

Cómo cambiar la simultaneidad de trabajadores

Cambiar este parámetro ajusta la cantidad de tareas que un solo trabajador puede ejecutar al mismo tiempo.

Por ejemplo, un Worker con 0.5 CPU suele controlar 6 tareas simultáneas; un entorno con tres de estos Workers puede controlar hasta 18 tareas simultáneas.

Aumenta este parámetro cuando haya tareas en espera en la cola y tus trabajadores usen un porcentaje bajo de sus CPUs y memoria al mismo tiempo.

Disminuye este parámetro cuando se expulsen Pods, lo que reducirá la cantidad de tareas que un solo trabajador intenta procesar. Como alternativa, puedes aumentar la memoria del trabajador.

De forma predeterminada, la simultaneidad del trabajador se establece en función de la cantidad de instancias de tareas simultáneas ligeras que puede admitir un trabajador. Esto significa que su valor depende de los límites de recursos del trabajador. El valor de simultaneidad del trabajador no depende de la cantidad de trabajadores en tu entorno.

Para cambiar este parámetro, anula la siguiente opción de configuración de Airflow:

| Sección | Clave | Valor |

|---|---|---|

celery |

worker_concurrency |

Nuevo valor para la simultaneidad de trabajadores |

Cómo cambiar la simultaneidad del DAG

La simultaneidad del DAG define la cantidad máxima de instancias de tareas que se pueden ejecutar de forma simultánea en cada DAG. Aumenta este valor cuando tus DAG ejecuten una gran cantidad de tareas simultáneas. Si este parámetro de configuración es bajo, el programador retrasa la incorporación de más tareas a la cola, lo que también reduce la eficiencia del ajuste de escala automático del entorno.

Para cambiar este parámetro, anula la siguiente opción de configuración de Airflow:

| Sección | Clave | Valor | Notas |

|---|---|---|---|

core |

max_active_tasks_per_dag |

Nuevo valor para la simultaneidad del DAG | El valor predeterminado es 16. |

Aumenta la cantidad máxima de ejecuciones activas por DAG

Este atributo define la cantidad máxima de ejecuciones activas del DAG por DAG. Cuando el mismo DAG debe ejecutarse varias veces de forma simultánea, por ejemplo, con diferentes argumentos de entrada, este atributo permite que el programador inicie esas ejecuciones en paralelo.

Para cambiar este parámetro, anula la siguiente opción de configuración de Airflow:

| Sección | Clave | Valor | Notas |

|---|---|---|---|

core |

max_active_runs_per_dag |

Nuevo valor para la cantidad máxima de ejecuciones activas por DAG | El valor predeterminado es 25. |

¿Qué sigue?

- Escalar entornos

- Acerca del escalamiento de entornos

- Anular las opciones de configuración de Airflow

- Supervisa el estado y el rendimiento del entorno con métricas clave