GTIG AI 脅威トラッカー: 敵対的な使用を目的とした AI モデルの抽出(蒸留)、実験、(継続的な)統合

Google Threat Intelligence Group

Google Threat Intelligence

Visibility and context on the threats that matter most.

Contact Us & Get a Demo※この投稿は米国時間 2026 年 2 月 13 日に、Google Cloud blog に投稿されたものの抄訳です。

はじめに

2025 年の第 4 四半期、Google Threat Intelligence Group(GTIG)は、脅威アクターが攻撃ライフサイクルを加速するために AI の統合をますます進め、偵察、ソーシャル エンジニアリング、マルウェア開発の生産性を高めていることを確認しました。このレポートは、脅威アクターによる AI ツールの利用拡大に関する 2025 年 11 月の調査結果の最新版です。

GTIG は、こうした初期の兆候と攻撃的な概念実証を特定することで、AI を活用した次の段階の脅威の予測、悪意のある活動の事前阻止、分類器とモデルの両方を継続的に強化するための必要なインテリジェンスを防御者に提供することを目指しています。

エグゼクティブ サマリー

Google DeepMind と GTIG は、モデル抽出の試みである「蒸留攻撃」の増加を確認しました。これは、Google の利用規約に違反する知的財産窃盗の手法です。このレポートでは、モデル抽出活動の検出、阻止、軽減など、悪意のある活動を阻止するために Google が講じた手順を随所で紹介しています。高度標的型攻撃(APT)アクターによるフロンティアモデル(最先端モデル)や生成 AI プロダクトへの直接的な攻撃は確認されていませんが、世界中の民間企業や、独自のロジックをクローン作成しようとする研究者によるモデル抽出攻撃が頻繁に発生しており、Google はこうした攻撃を軽減しています。

政府の支援を受けた脅威アクターにとって、大規模言語モデル(LLM)は、技術的な調査、ターゲットの絞り込み、巧妙なフィッシング メールの迅速な生成に不可欠なツールとなっています。この四半期レポートでは、2025 年後半に北朝鮮(DPRK)、イラン、中国(PRC)、ロシアの脅威アクターが AI をどのように活用したかを取り上げ、生成 AI の敵対的な悪用が、Google が阻止したキャンペーンでどのような形で組み込まれているかについて理解を深めることができます。GTIG は、脅威の状況を根本的に変えるような画期的能力を実現した APT アクターや情報工作(IO)アクターをまだ確認していません。

このレポートでは、特に以下の点を検証しています。

-

モデル抽出攻撃: 「蒸留攻撃」は、知的財産窃盗の手法として昨年から増加している。

-

AI による攻撃活動の強化: 実際のケーススタディで、グループが標的に対する偵察と信頼関係構築を目的としたフィッシングをどのように効率化しているかを明らかにする。

-

エージェント型 AI: 脅威アクターは、マルウェアやツールの開発をサポートするエージェント型 AI 機能の構築に関心を示し始めている。

-

AI 統合型マルウェア: HONESTCUE などの新しいマルウェア ファミリーでは、Gemini のアプリケーション プログラミング インターフェース(API)を使用して、第 2 段階のマルウェアのダウンロードと実行を可能にするコードを生成する試みがなされている。

-

アンダーグラウンドの「ジェイルブレイク」エコシステム: Xanthorox のような悪意のあるサービスがアンダーグラウンドで出現しており、独立したモデルであると主張しながら、実際にはジェイルブレイクされた商用 API とオープンソースの Model Context Protocol(MCP)サーバーに依存している。

Google は、責任ある方法による AI の果敢な開発に尽力しており、不正な行為者が関わっているプロジェクトやアカウントを無効化することで、悪意のある活動を阻止する積極的な措置を講じています。また同時に、悪用されにくくなるよう、モデルの継続的な改善にも取り組んでいます。さらに業界のベスト プラクティスを積極的に共有して防御者を支援し、エコシステム全体でより強固な保護を可能にしています。このレポートでは、アセットを無効化したり、インテリジェンスの適用による分類器とモデルの強化で今後の不正使用からモデルを保護したりするなど、悪意のある活動を阻止するために Google が講じた手順を紹介しています。Gemini をどのように保護、防御しているかについて詳しくは、ホワイト ペーパー「Gemini のセキュリティ保護対策の強化」をご覧ください。

モデルの直接的なリスク: モデル抽出攻撃の阻止

組織が LLM を中核的な業務に統合するにつれて、これらのモデルの独自のロジックと専門的なトレーニングが、価値の高い標的として浮上しています。これまで、ハイテク機能を盗もうとする攻撃者は、コンピュータを利用した従来型の侵入活動によって組織を侵害し、企業秘密を含むデータを窃取していました。LLM がサービスとして提供される多くの AI テクノロジーでは、こうしたアプローチはもはや必要ありません。アクターは正当な API アクセスを使用して、特定の AI モデルの機能の「クローン作成」を試みることができるからです。

2025 年は、追跡対象の APT アクターや情報工作(IO)アクターによるフロンティアモデルへの直接的な攻撃は確認されませんでした。しかし、モデルの根底にある推論と Chain-of-Thought プロセスに関する分析情報を得ることを目的とした、Google AI モデルに対するモデル抽出攻撃(蒸留攻撃とも呼ばれる)が確認されました。

モデル抽出攻撃とは

モデル抽出攻撃(MEA)は、成熟した ML モデルに正当なアクセスを行い、体系的にプローブし、新しいモデルのトレーニングに使用する情報を抽出する攻撃です。モデル抽出攻撃を仕掛ける攻撃者は、知識蒸留(KD)と呼ばれる手法を使用して、1 つのモデルから抽出した情報を別のモデルに転送します。こうした理由で、モデル抽出攻撃は「蒸留攻撃」とよく呼ばれます。

モデル抽出とそれに続く知識蒸留により、攻撃者は AI モデルの開発を大幅に低い費用で加速できます。こうした活動は、事実上、知的財産(IP)の窃盗に相当します。

知識蒸留(KD)は、既存の「教師」モデルを使用して「生徒」モデルをトレーニングするために使用される一般的な ML 手法です。この手法は多くの場合、特定分野の問題について教師モデルに対してクエリを実行し、その結果に対して教師ありファインチューニング(SFT)を実行したり、他のモデル トレーニング手順でその結果を利用して生徒モデルを生成したりします。蒸留には正当な用途があり、Google Cloud には蒸留を実行するための既存のサービスがあります。しかし、Google の Gemini モデルから許可なく蒸留することは、Google の利用規約に違反する行為であり、Google はこうした試みを検出して軽減する手法を継続的に開発しています。

図 1: モデル抽出攻撃の図

Google DeepMind と GTIG は、世界中の研究者や民間企業によって仕掛けられた、モデルの盗用や機能の抽出を目的としたモデル抽出攻撃を特定し、阻止しました。

ケーススタディ: 推論トレースの強制出力

攻撃者がよく標的とするのは、Gemini の優れた推論能力です。内部の推論トレースは通常、ユーザーに提供される前に要約されますが、攻撃者はモデルに完全な推論プロセスを出力させようとしました。

特定された攻撃の一つでは、Gemini に「...思考過程で使用される言語は、ユーザー入力のメイン言語と厳密に一致している必要があります」と指示していました。

このキャンペーンの分析結果:

表 1: キャンペーン分析の結果

モデル抽出と蒸留攻撃のリスク

モデル抽出と蒸留の攻撃は、AI サービスの機密性、可用性、完全性を脅かすものではないため、一般ユーザーにとって通常はリスクとはなりません。その代わりに、リスクはモデル開発者とサービス プロバイダに集中します。

AI モデルをサービスとして提供する組織は、API アクセスをモニタリングして、抽出パターンや蒸留パターンが検出されないかを確認する必要があります。たとえば、財務データ分析用にチューニングされたカスタムモデルは、デリバティブ商品の構築を試みる競合他社から標的にされる可能性があります。また、コーディング モデルは、ガードレールがない環境で機能を複製しようとする攻撃者から標的にされる可能性があります。

AI で強化された悪意のある活動のハイライト

過去 1 年間で得られた一貫した調査結果から、政府の支援を受けた攻撃者がコーディングやスクリプト作成のタスク、標的候補に関する情報収集、既知の脆弱性に関する調査、侵入後の活動に Gemini を悪用していることがわかっています。2025 年第 4 四半期には、GTIG は、脅威アクターによる Gemini の不正使用と実際の活動との直接的および間接的な関連性を確認し、これらの活動が実際の運用にどのように結びついているかの理解を深めました。

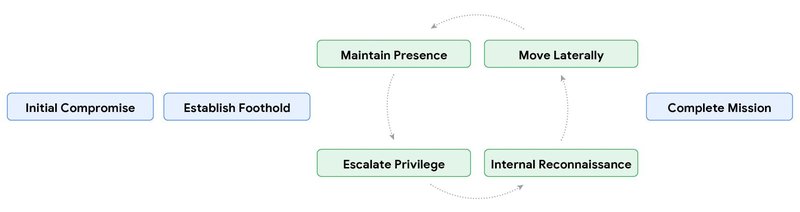

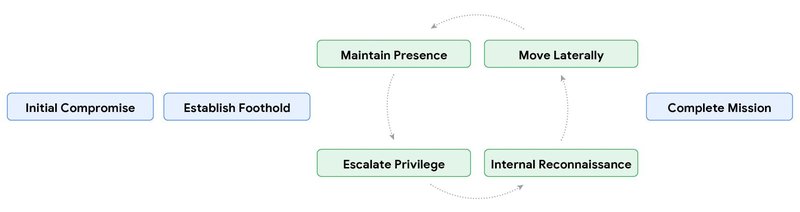

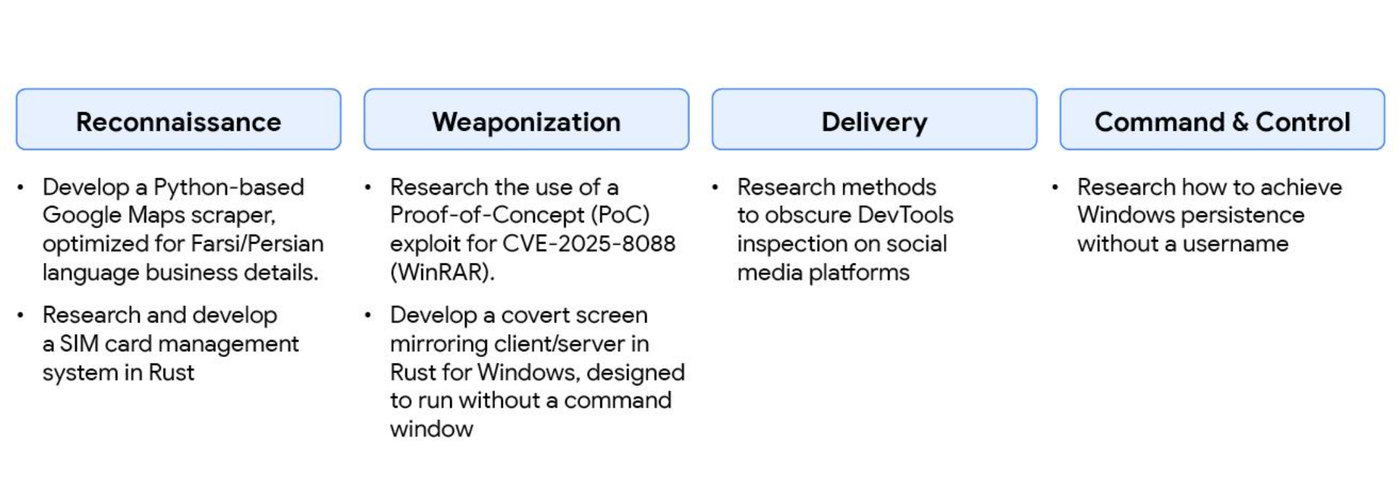

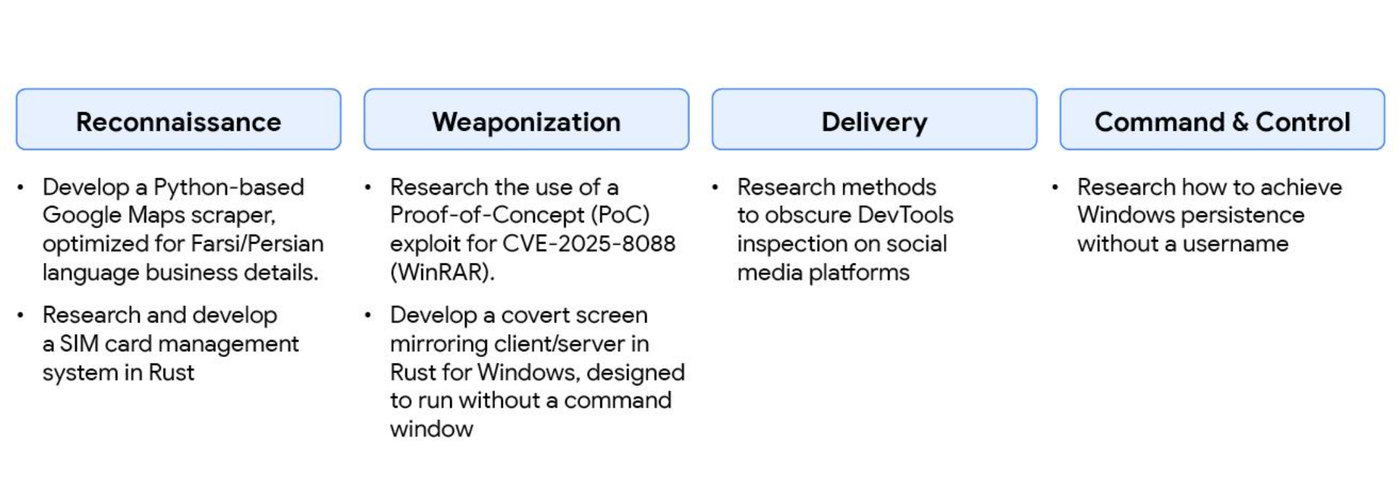

図 2: 脅威アクターは攻撃ライフサイクルのすべての段階で AI を活用している

偵察と標的開発のサポート

APT アクターは、初期侵入を実行しやすくする目的で、偵察と標的開発に重点を置くなど、攻撃ライフサイクルのいくつかの段階に Gemini を活用しました。この活動は、AI によってフィッシングの手法が高度化していることを示しています。LLM のスピードと精度により、これまで被害組織のプロファイリングに必要だった手作業を回避できるからです。LLM はフィッシングのおとりコンテンツを生成するだけでなく、攻撃の偵察段階で戦略的な効果を増幅させる役割を果たすため、脅威アクターがオープンソース インテリジェンス(OSINT)を迅速に統合して、価値の高い標的のプロファイリング、防御部門内の主要な意思決定者の特定、組織階層の把握を行うことができます。脅威アクターは、これらのツールをワークフローに統合することで、最初の偵察からアクティブな標的設定までを、より迅速かつ大規模に進めることができます。

-

UNC6418 は、帰属不明の脅威アクターで、Gemini を悪用して標的型インテリジェンス収集を実施し、特に機密性の高いアカウント認証情報とメールアドレスを抽出しました。その後すぐに、GTIG は、脅威アクターがウクライナと防衛部門を狙ったフィッシング キャンペーンでこれらすべてのアカウントを標的にしていることを確認しました。Google は、このアクターの活動に関連するアセットを無効化することで、このアクターに対処しました。

-

Temp.HEX は、中国を拠点とする脅威アクターで、Gemini やその他の AI ツールを悪用して、パキスタンの標的を含む特定個人に関する詳細な情報を取得してまとめ、さまざまな国の分離独立派組織に関する運用データや構造データを収集しました。こうした調査の結果として直接的な標的化は確認されませんでしたが、脅威アクターはその後すぐに、パキスタンにいる同様の標的をキャンペーンに含めていました。Google は、このアクターの活動に関連するアセットを無効化することで、このアクターに対処しました。

フィッシングの強化

防御者および標的とされる組織は、フィッシング攻撃を特定するために長い間、文法が不自然、構文がぎこちない、文化的背景が欠けているなどの特徴を手掛かりにしてきました。しかし、脅威アクターは LLM をさらに活用することで、標的組織のプロフェッショナルなトーンや現地の言語を反映し、文化的なニュアンスが盛り込まれ高度にパーソナライズされたおとりコンテンツを生成するようになっています。

この機能を利用すると、単純なメール生成だけでなく、「信頼関係構築型フィッシング」も実施できます。こうしたフィッシングでは、モデルを使用して被害者との間で複数ターンの信頼性の高い会話を進め、信頼関係を構築してから悪意のあるペイロードが配信されます。母国語が異なる人にとってのハードルを下げ、高品質のコンテンツの作成を自動化することで、攻撃者はこれまでの「不自然さ」をほぼなくし、ソーシャル エンジニアリング活動の効果を高めることができます。

-

イラン政府の支援を受けたアクターである APT42 は、Gemini などの生成 AI モデルを活用して、偵察と標的型ソーシャル エンジニアリングを大幅に強化しました。APT42 は Gemini を悪用して、特定の組織の公式メールを検索して潜在的なビジネス パートナーを偵察し、その組織にアプローチするための信頼性のある口実を作り上げました。この活動には、特定組織の公式メールアドレスを列挙しようとする試みや、アプローチするための信頼性のある口実を作り上げるための調査が含まれました。APT42 は、標的の略歴を Gemini に提供し、標的の関心を引くための最適なペルソナやシナリオを作成するために Gemini を悪用しました。GTIG が追跡している多くの脅威アクターと同様に、APT42 は Gemini を使用して現地語への翻訳や現地語からの翻訳を行ったり、母国語でない言語のフレーズや参照情報をより深く理解したりしていました。Google は、このアクターの活動に関連するアセットを無効化することで、このアクターに対処しました。

-

北朝鮮政府の支援を受けたアクター UNC2970 は、キャンペーンで一貫して防衛部門を標的とし、企業の採用担当者を装うことに重点を置いていました。このグループは Gemini を使用して OSINT を合成し、価値の高い標的をプロファイリングして、キャンペーンの計画と偵察をサポートしていました。このアクターによる標的のプロファイリングには、主要なサイバーセキュリティ企業や防衛関連企業に関する情報の検索、特定の技術職の役割と給与情報の関連付けが含まれていました。こうした活動では、アクターは調整された忠実度の高いフィッシング用ペルソナを作成し、容易に初期侵害できる潜在的標的の特定に必要な情報を収集するため、日常的に行う専門的な調査と悪意のある偵察の区別が曖昧になります。Google は、このアクターの活動に関連するアセットを無効化することで、このアクターに対処しました。

脅威アクターはコーディングとツール開発に引き続き AI を使用

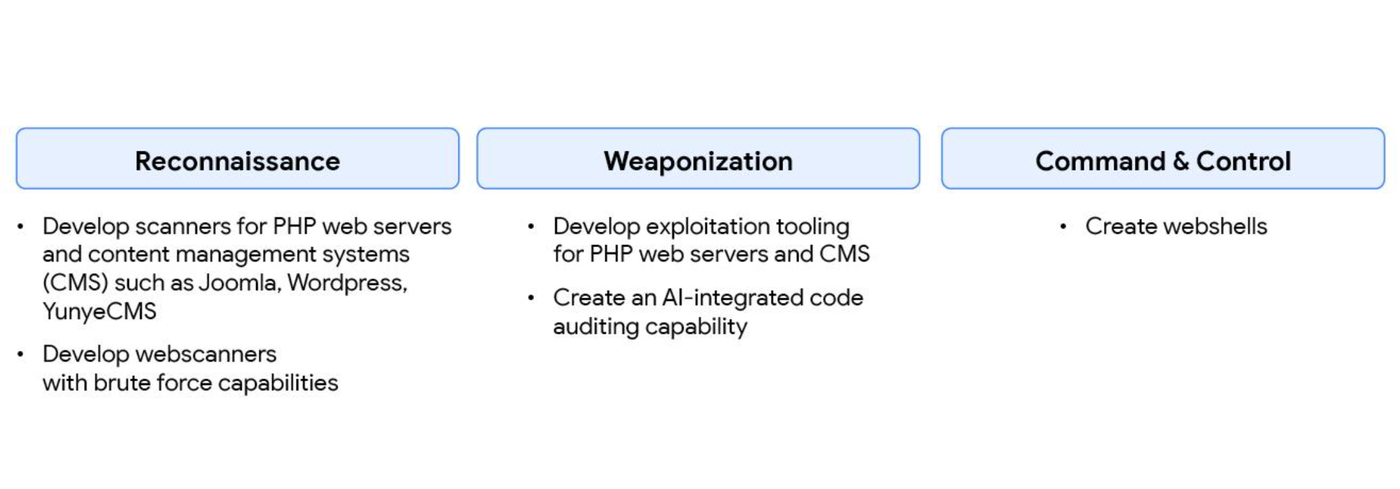

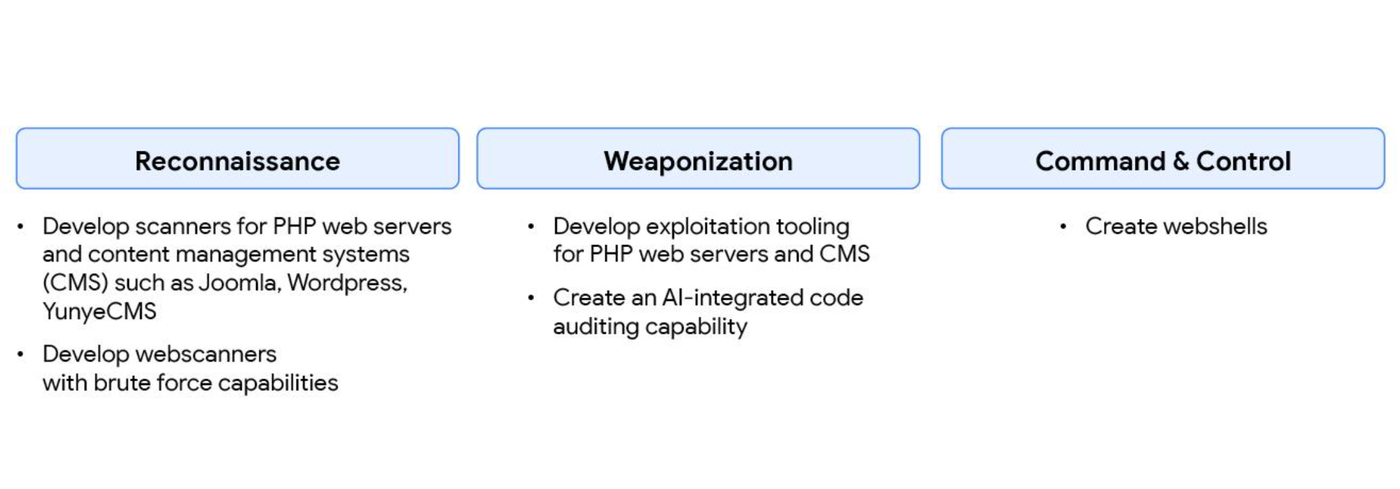

国家支援を受けたアクターは、偵察やフィッシングのおとりコンテンツ作成から、コマンド&コントロール(C2 または C&C)の開発、データの引き出しまで、あらゆる段階で活動を強化するために Gemini を悪用し続けています。また、Gemini がサイバーセキュリティ専門家のペルソナとして回答してくれるようプロンプトを入力したり、AI 統合型のコード監査機能を作成しようとしたりするなど、エージェント型 AI 機能のキャンペーンへの活用に関心を持っていることを示す活動も確認されています。

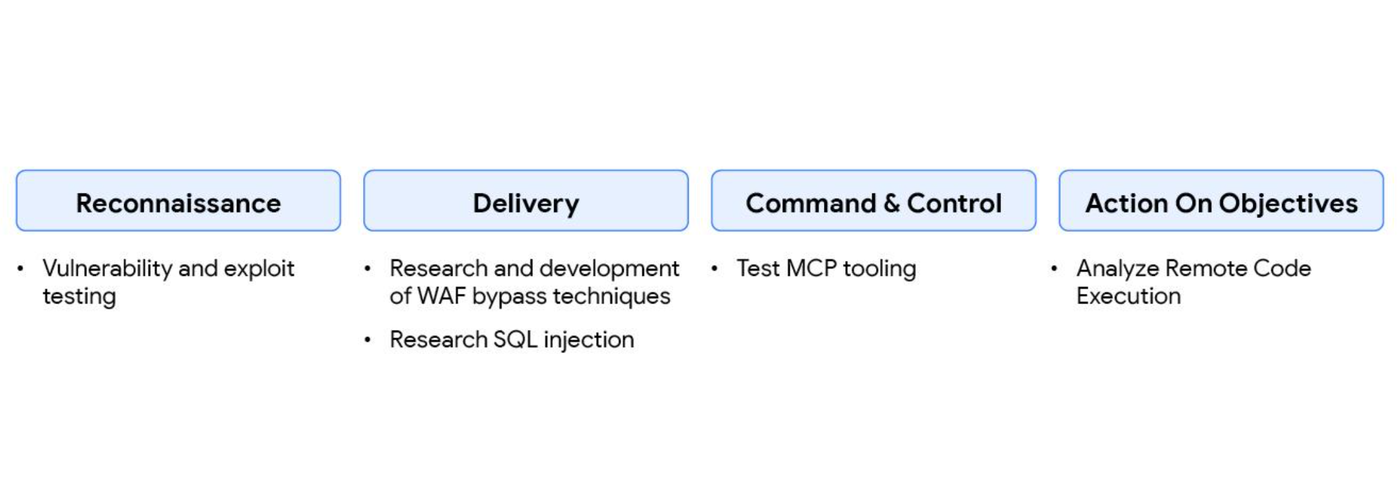

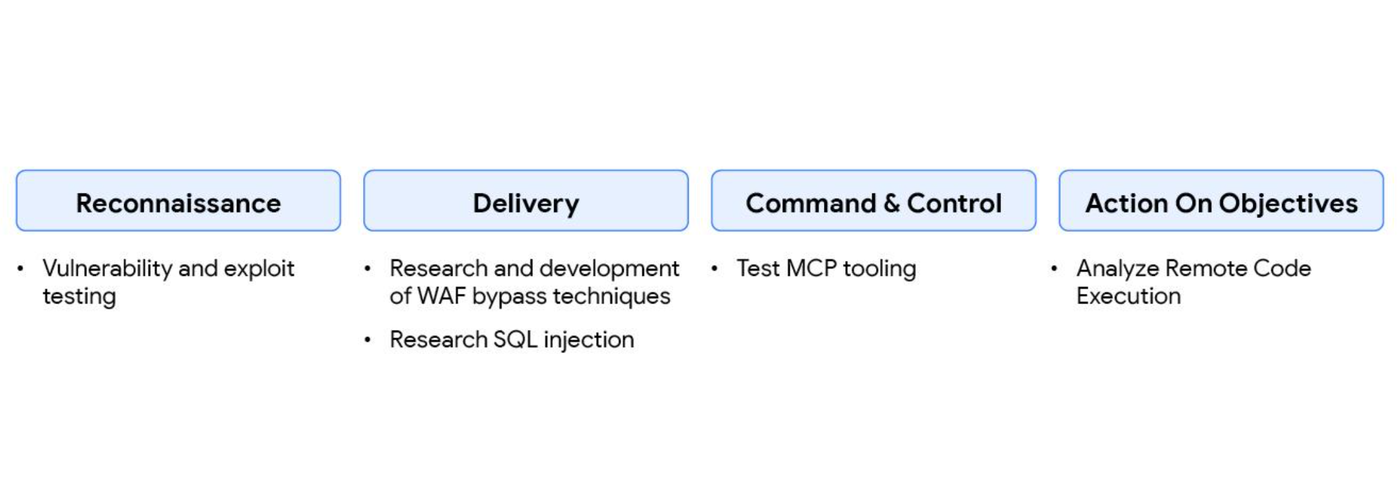

APT31 は、Gemini がサイバーセキュリティ専門のペルソナとして回答するようにプロンプトを入力することで、脆弱性の分析を自動化して、標的を絞ったテスト計画を生成するという、高度に構造化されたアプローチを採用しました。中国を拠点とするこの脅威アクターは、シナリオを捏造し、あるケースでは Hexstrike MCP ツールを試験的に運用して、米国を拠点とする特定の標的に対するリモートコード実行(RCE)、ウェブ アプリケーション ファイアウォール(WAF)バイパス手法、SQL インジェクション テストの結果を分析するようモデルに指示しました。これにより、技術的な脆弱性や組織の防御の弱点を特定するためのインテリジェンス収集が自動化されました。このような操作は、日常的なセキュリティ評価クエリと、標的を絞った悪意ある偵察活動の境界線を明らかに曖昧にします。Google は、このアクターの活動に関連するアセットを無効化することで、このアクターに対処しました。

図 3: APT31 のプロンプトの例

図 4: 攻撃ライフサイクルの各段階での APT31 による Gemini 悪用方法を示す図

中国を拠点とするアクターである UNC795 は、攻撃ライフサイクル全体を通じて Gemini に大きく依存していました。GTIG は、このグループが週に数日、Gemini を使用してコードのトラブルシューティング、調査、侵入活動のための技術的機能の生成を継続的に行っていることを確認しました。脅威アクターのこうした活動により安全システムが作動し、Gemini はポリシー違反に当たる機能を作成しようとするアクターの試みに応じませんでした。

このグループはまた、Gemini を使用して AI 統合型のコード監査機能を作成していたため、侵入活動を支援するエージェント型 AI ユーティリティに関心を持っている可能性があります。Google は、このアクターの活動に関連するアセットを無効化することで、このアクターに対処しました。

図 5: 攻撃ライフサイクルの各段階での UNC795 による Gemini 悪用方法を示す図

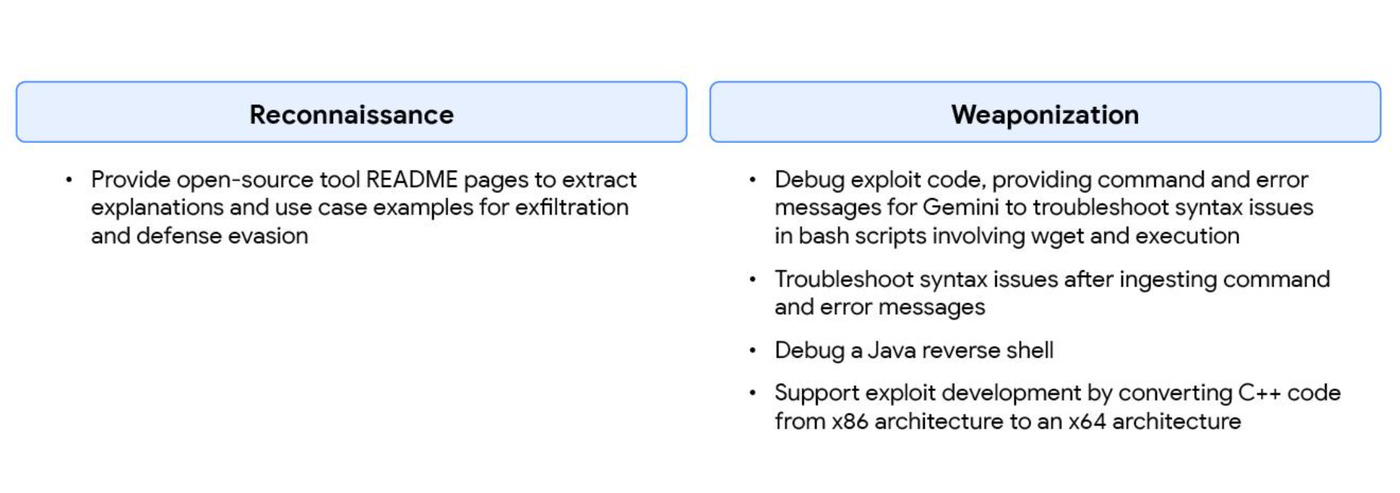

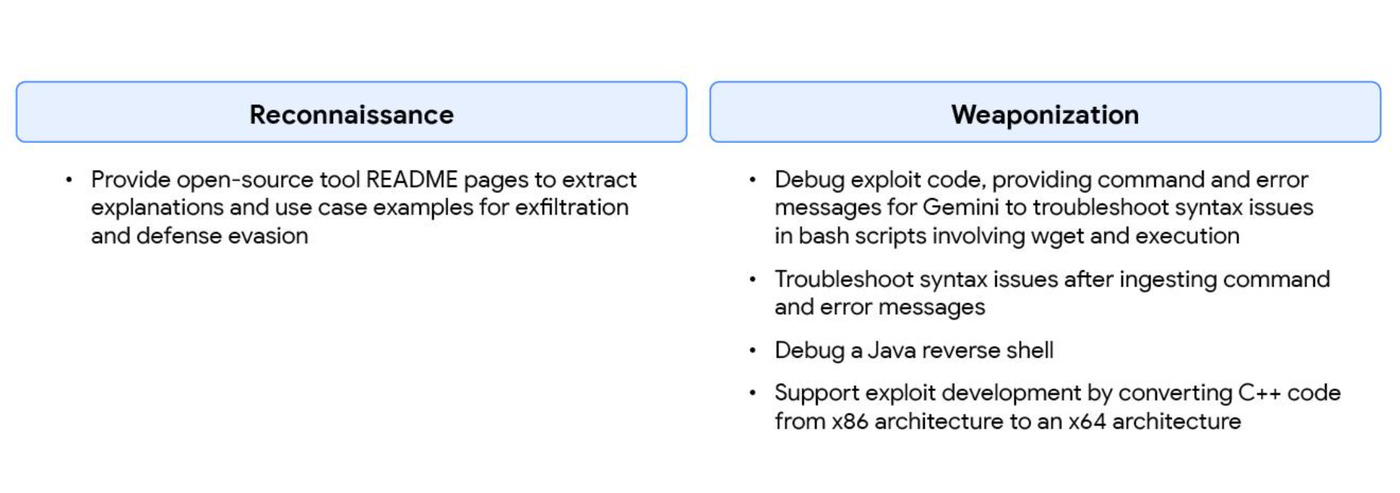

Google は、中国を拠点とする脅威アクター APT41 に関連すると思われる活動を観測しました。このアクターは、知識の統合、リアルタイムのトラブルシューティング、コード変換などを目的とした、悪意のあるツールの開発とデプロイを加速するために Gemini を利用していました。特に、このアクターは Gemini にオープンソース ツールの README ページを複数回提供し、特定のツールについて説明とユースケースの例を求めていました。Google は、このアクターの活動に関連するアセットを無効化することで、このアクターに対処しました。

図 6: 攻撃ライフサイクルの各段階での APT41 による Gemini 悪用方法を示す図

イランの脅威アクターである APT42 は、前述のソーシャル エンジニアリング キャンペーンに Gemini を利用するだけでなく、悪意のある専門ツールの開発を加速するためのエンジニアリング プラットフォームとしても Gemini を使用していました。この脅威アクターは、Gemini をデバッグ、コード生成、悪用手法の調査に活用して、新しいマルウェアや攻撃ツールを積極的に開発していました。Google は、このアクターの活動に関連するアセットを無効化することで、このアクターに対処しました。

図 7: 攻撃ライフサイクルの各段階での APT42 による Gemini 悪用方法を示す図

Gemini を使用して情報工作を支援

GTIG は、情報工作(IO)アクターが生産性向上(調査、コンテンツ作成、ローカライズなど)のために Gemini を使用していることを引き続き確認しています。これは、以前の Gemini の使用方法と同じです。脅威アクターが Gemini に積極的に働きかけて記事の作成、アセットの生成、コーディングを行っていることを示す Gemini アクティビティが確認されています。しかし、Google はこうして生成されたコンテンツが実際に悪用されているのを確認していません。これらの試みは、IO キャンペーンの画期的な機能を生み出すには至っていないということです。中国、イラン、ロシア、サウジアラビアの脅威アクターは、政治風刺やプロパガンダを作成し、デジタル プラットフォームと印刷ポスターなどの物理メディアの両方で特定のアイデアを広めています。

AI を活用したマルウェアの継続的な実験

GTIG は、2025 年後半に脅威アクターが AI を利用してマルウェア ファミリーに新しい機能を実装する実験を続けていることを確認しました。脅威の状況に革命的なパラダイム シフトをもたらすような、AI を活用した実験的な手法はまだ確認されていませんが、これらの概念実証型マルウェア ファミリーは、脅威アクターが将来の活動の一環として AI 手法をどう実装できるかを示す初期の兆候です。こうした探索的な実験は今後増加すると予想されます。

新しい機能の実験が継続されていることに加え、2025 年後半を通じて、GTIG は脅威アクターが従来の AI 生成機能を COINBAIT フィッシング キットなどの侵入活動に統合していることを確認しました。脅威アクターは、マルウェアの作成のサポート、既存のマルウェアの改良、脆弱性の調査、偵察の実施、おとりコンテンツの生成など、攻撃ライフサイクル全体に引き続き AI を組み込んでいくと予想されます。

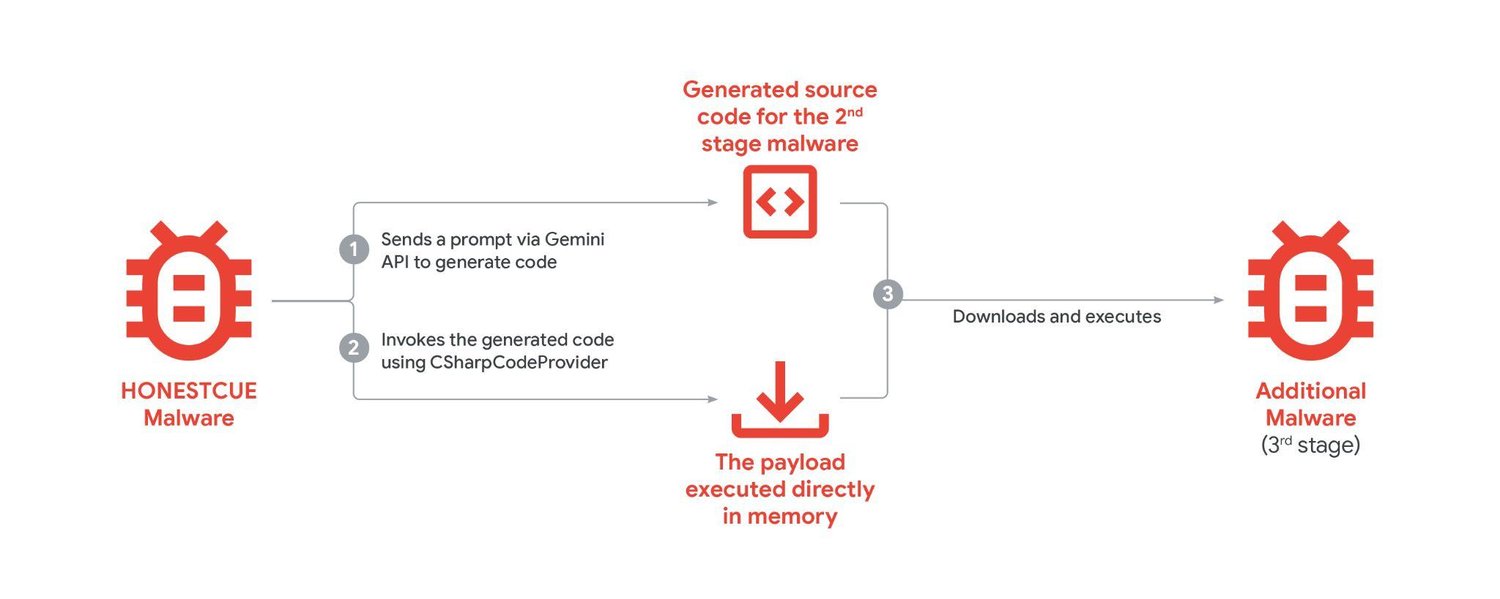

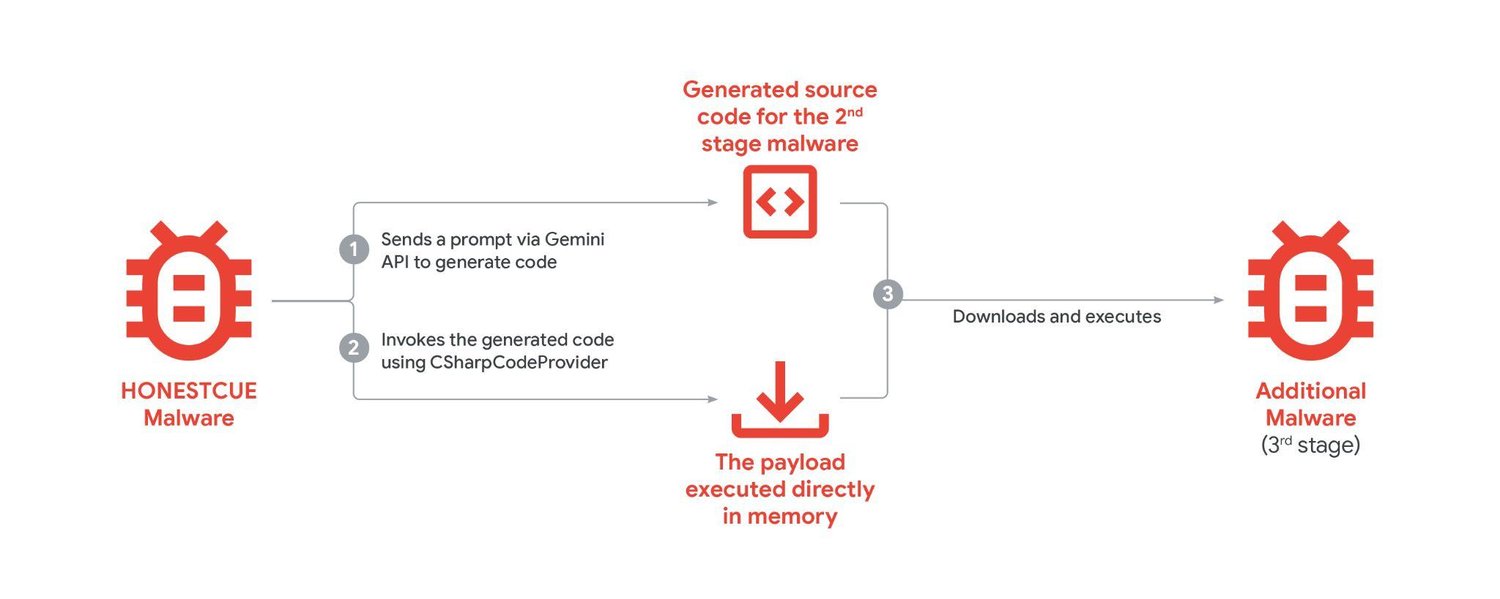

機能生成のアウトソーシング: HONESTCUE

2025 年 9 月、GTIG は HONESTCUE として追跡しているマルウェア サンプルが、Gemini の API を利用して機能生成をアウトソーシングしていることを確認しました。HONESTCUE マルウェア サンプルの調査から、攻撃者が AI を組み込んだ目的は、従来のネットワークベースの検出と静的分析を弱体化して、多層的な難読化アプローチをサポートすることである可能性が高いことがわかりました。

HONESTCUE は、Google Gemini の API を介してプロンプトを送信し、C# ソースコードをレスポンスとして受け取るダウンローダおよびランチャー フレームワークです。特に、HONESTCUE は、以前に確認された PROMPTFLUX の「ジャストインタイム」(JIT)手法と同様の機能を共有しています。ただし、HONESTCUE は LLM を利用して自身を更新するのではなく、Gemini API を呼び出して「第 2 段階」の機能を実施するコードを生成します。このコードにより、別のマルウェアがダウンロードおよび実行されます。さらに、HONESTCUE はファイルレスの第 2 段階で、Gemini API から受信した C# ソースコードを受け取り、正規の .NET CSharpCodeProvider フレームワークを使用して、ペイロードをメモリ内で直接コンパイルおよび実行します。このアプローチでは、ディスクにペイロード アーティファクトが残りません。また、脅威アクターが Discord CDN などのコンテンツ配信ネットワーク(CDN)を使用して最終ペイロードをホストしていることも確認されています。

図 8: HONESTCUE マルウェア

このマルウェアは、既存の脅威活動のクラスタとは関連付けられていませんが、ある程度の技術的専門知識を持つ開発者によって開発されていると推測されます。具体的には、多くのサンプルに小さな反復的な変更が見られるとともに、VirusTotal への検体投稿者が一人であることから、ウイルス対策機能をテストしている可能性があり、単一のアクターまたは少人数グループであると思われます。さらに、ペイロード配信のテストに Discord を使用し、Discord bot を登録していることから、技術的な洗練度が低いアクターであることがわかります。botアーキテクチャの一貫性と明確さ、そして調査したマルウェア サンプルが段階的に進化していることから、これは実装の概念実証段階にある単一のアクターまたは少人数グループによるものである可能性が高いことを示しています。

HONESTCUE がハードコードされたプロンプトを使用すること自体は悪意のあるものではなく、マルウェアに関連するコンテキストがなければ、そのプロンプトが悪意のあるものと見なされる可能性は低いでしょう。マルウェア機能の一部をアウトソーシングし、LLM を活用して、より大きな悪意のある構造に組み込まれる一見無害なコードを開発することは、脅威アクターがセキュリティ ガードレールを回避しながら、キャンペーンを強化するために AI アプリケーションを活用する可能性が高いことを示しています。

図 9: ハードコードされたプロンプトの例

図 10: ハードコードされたプロンプトの例

図 11: ハードコードされたプロンプトの例

AI 生成のフィッシング キット: COINBAIT

2025 年 11 月、GTIG はフィッシング キット COINBAIT を特定しました。このキットは、AI コード生成ツールによって構築が加速された可能性が高く、認証情報を収集するために大手暗号通貨取引所を装っていました。インフラストラクチャの直接的な重複と帰属ドメインの使用に基づいて、この活動の一部は高い確率で UNC5356 と重複していると見られています。UNC5356 は、金銭目的の脅威クラスタであり、SMS ベースと電話ベースのフィッシング キャンペーンを利用して、金融機関、暗号通貨関連企業、その他さまざまな人気のある企業やサービスの顧客を標的にしています。

マルウェア サンプルを調査したところ、lovableSupabase クライアントと lovable.app が画像ホスティングに使用されていることから、AI 搭載プラットフォーム Lovable AI を使用してこのキットが構築されたことがわかりました。

-

攻撃者はコンテンツを正当かつ信頼できるサービスでホスティングすることで、疑わしいプライマリ ドメインをブロックするネットワーク セキュリティ フィルタを回避する可能性を高めている。

-

このフィッシング キットは、複雑な状態管理とルーティングを備えた完全な React シングルページ アプリケーション(SPA)でラップされていた。この複雑さは、コードが Lovable AI などのフレームワークを使用して高レベルのプロンプト(例: 「ウォレット復元用の Coinbase スタイルの UI を作成してください」)で作成されたことを示している。

-

LLM の使用を示すもう一つの重要な手がかりは、マルウェアのソースコード内に、開発者向けの冗長なログ メッセージが直接含まれていることである。これらのメッセージは、常に「? Analytics:」という接頭辞が付けられており、キットの悪意のあるトラッキングとデータ引き出し活動のリアルタイムのトレースに役立ち、このコード ファミリー固有のフィンガープリントとして機能する。

表 2: COINBAIT のソースコードから抽出された console.log メッセージの例

また Google は、このグループが、攻撃者の IP アドレスを隠すために Cloudflare を介してフィッシング ドメインをプロキシしたり、フィッシング ページの画像アセットを Lovable AI から直接ホットリンクしたりするなど、インフラストラクチャと検出回避戦術を運用に活用していることも確認しました。

COINBAIT フィッシング キットが導入されたことは、UNC5356 のツールが進化し、ソーシャル エンジニアリング キャンペーンの巧妙さとスケーラビリティを高めるために、最新のウェブ フレームワークと正規のクラウド サービスの利用が拡大していることを示しています。しかし、COINBAIT が複数の異なる脅威アクターに提供されているサービスである可能性を示す証拠が少なからずあります。

サイバー犯罪における AI ツールの使用

業界全体では、既存の AI 対応のツールやサービスの不正使用だけでなく、不法行為を可能にするために構築された AI ツールやサービスに対する関心と市場が拡大しています。アンダーグラウンド フォーラムを通じて提供されるツールやサービスを利用することで、技術的な知識や資金が限られた下位レベルのアクターでも、侵入の頻度、範囲、有効性、複雑さを高めることができます。金銭的動機を持つ脅威アクターは実験を続けていますが、AI ツールの開発におけるブレークスルーはまだ達成されていません。

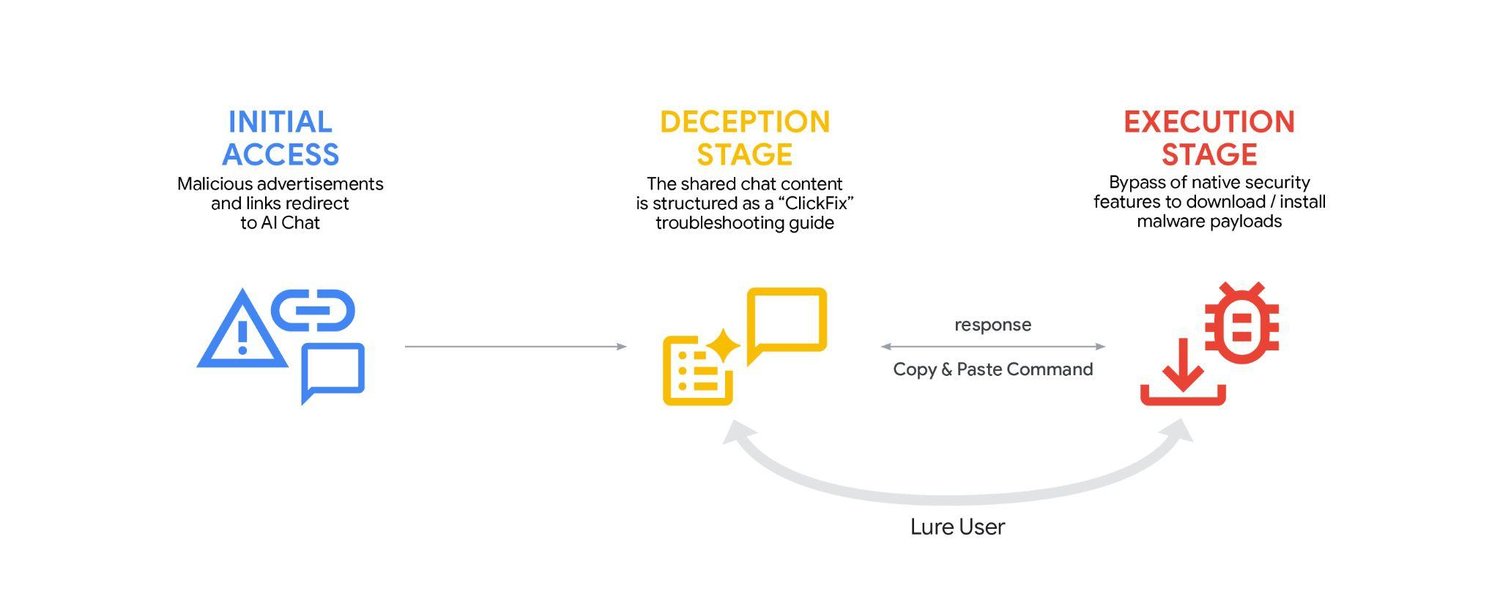

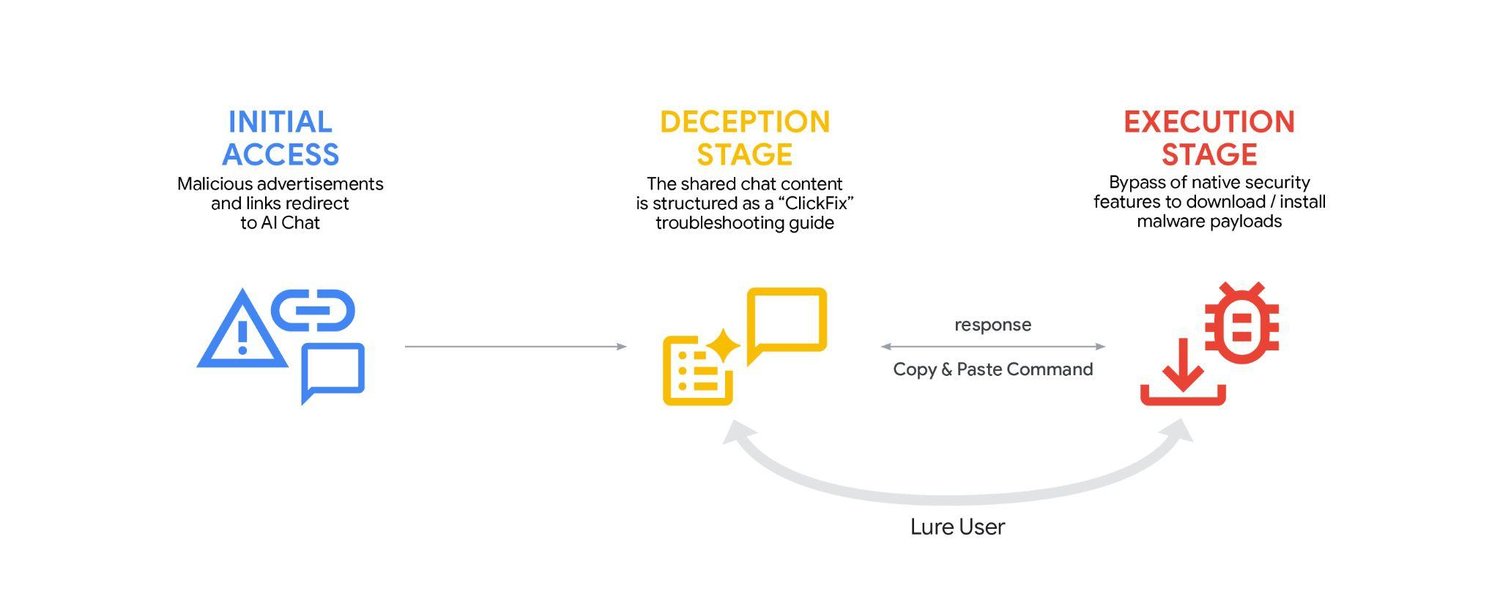

「ClickFix」キャンペーンで AI サービスをソーシャル エンジニアリングに利用している脅威アクター

これは新しいマルウェアの手法ではありませんが、GTIG は、脅威アクターが生成 AI サービスに対する社会的信頼を悪用してマルウェアを配信しようとする事例を観測しました。GTIG は、脅威アクターが Gemini などの生成 AI サービスの一般公開機能を利用して、虚偽のソーシャル エンジニアリング コンテンツをホストする新しいキャンペーンを特定しました。2025 年 12 月初旬に初めて確認されたこの活動は、確立された「ClickFix」手法を使用して、ユーザーをだましてマルウェアをインストールさせようとしていました。この ClickFix 手法はソーシャル エンジニアリングによりユーザーを欺き、悪意のあるコマンドをコピーしてコマンド ターミナルに貼り付けるよう促していたのです。

脅威アクターは、安全ガードレールを回避して、macOS でのさまざまなタスク実行方法に関する悪意のある指示を与え、最終的に macOS 環境を標的とする情報窃取型マルウェア ATOMIC の亜種を配布していました。このマルウェアは、ブラウザデータ、暗号通貨ウォレット、システム情報、デスクトップ フォルダとドキュメント フォルダ内のファイルを収集する機能を備えています。このキャンペーンの背後にいる脅威アクターは、ChatGPT、CoPilot、DeepSeek、Gemini、Grok など、さまざまな AI チャット プラットフォームを使用して、悪意のある指示をホストしています。

このキャンペーンの目的は、主に Windows システムや macOS システムのユーザーを誘い込み、悪意のあるコマンドを手動で実行させることです。この攻撃チェーンは次のように動作します。

-

脅威アクターはまず、悪意のあるコマンドラインを作成する。被害者がこれをコピーして貼り付けると、マルウェアに感染する。

-

次に、脅威アクターは AI を操作して、一般的なコンピュータの問題(ディスク容量のクリアやソフトウェアのインストールなど)を解決するための信憑性の高い指示を作成しながらも、悪意のあるコマンドラインを解決策として AI に与える。

-

ユーザーが、Gemini やその他の AI ツールでの特定チャットの文字起こしへの共有可能なリンクを作成し、AI による特定の回答を他のユーザーと共有できるようにする。これで攻撃者は、AI サービスのインフラストラクチャでホストされている悪意のある ClickFix ランディング ページへのリンクを用意できたことになる。

-

攻撃者は、悪意のある広告を購入するか、疑いを持たない被害者を一般公開されているチャットの文字起こしに誘導する。

-

被害者は AI チャットの文字起こしに騙され、一見正当なコマンドライン スクリプトをコピーして、システムのターミナルに直接貼り付けるという指示に従う。このコマンドにより、マルウェアがダウンロードおよびインストールされる。こうした操作はユーザーが開始し、組み込みのシステム コマンドが使用されるため、セキュリティ ソフトウェアで検出してブロックすることが難しい場合がある。

図 12: ClickFix の攻撃チェーン

Windows と MacOS 向けに異なるおとりコンテンツが生成され、ペイロードの配布に悪意のある広告手法が使用されていることから、標的はかなり広範囲におよび、日和見的である可能性があります。

この手法により、脅威アクターは信頼できるドメインを利用して初期段階の指示をホストし、ソーシャル エンジニアリングを活用して、非常に破壊的なステップを最終的に実行します。これは広く使用されているアプローチですが、GTIG が AI サービスの一般公開機能が信頼できるドメインとして悪用されていることを確認したのは今回が初めてです。

アンダーグラウンド マーケットプレイスでの観測: AI の API キーを悪用する脅威アクター

脅威アクターは正規の AI サービスをツールとして利用し続けていますが、悪意のある活動を支援するために特別に設計された AI サービスの市場も変わらず存在しています。英語とロシア語のアンダーグラウンド フォーラムの現在の状況から、AI 対応のツールやサービスに対する需要が依然として大きいことがわかっています。これは、このようなプラットフォームに関する以前の評価と一致しています。

しかし、脅威アクターはカスタムモデルの開発に苦労しており、代わりに Gemini などの成熟したモデルに依存しています。たとえば、「Xanthorox」は、マルウェアの自律的なコード生成やフィッシング キャンペーンの開発など、サイバー攻撃を目的としたカスタム AI として宣伝されているアンダーグラウンド ツールキットです。このモデルは、マルウェア、ランサムウェア、フィッシング コンテンツを自律的に生成するように設計された「プライバシーを保護する、カスタマイズされた自己ホスト型 AI」として宣伝されていました。しかし、調査の結果、Xanthorox はカスタム AI ではなく、Gemini を含む複数のサードパーティ製および商用 AI プロダクトを基盤としていることが判明しました。

この設定では、複数のオープンソース AI プロダクト(具体的には、Crush、Hexstrike AI、LibreChat-AI、Open WebUI)の統合という主要な悪用手段が活用されています。これらのプロダクトを、Model Context Protocol(MCP)サーバーを介して日和見的に利用することで、商用モデル上にエージェント型 AI サービスが構築されています。

脅威アクターが LLM サービスを悪意のある操作にスケーラブルな形で悪用するには、LLM 統合を可能にする API キーとリソースが必要です。こうした理由から、豊富なクラウド リソースと AI リソースを持つ組織は、乗っ取りのリスクにさらされます。

さらに、ユーザーから AI の API キーを盗むために、脆弱なオープンソースの AI ツールがよく悪用されています。これにより、不正な API の再販やキーの乗っ取りの闇市場が活況を呈しており、広範囲にわたる不正使用が可能になり、影響を受けたユーザーに金銭的な被害が発生しています。たとえば、国レベルの検閲を受けているユーザーに人気の One API や New API プラットフォームは、攻撃者によって API キーが定期的に収集され、デフォルトの認証情報、安全でない認証、レート制限の欠如、XSS の欠陥、安全でない API エンドポイントを介した API キーの漏洩など、既知の脆弱性が悪用されています。

安全な責任ある AI の構築

Google は、AI へのアプローチは大胆かつ責任あるものでなければならないと考えています。これは課題に対処しつつ、社会への利益を最大化するような方法で AI を開発することを意味します。Google は AI に関する原則に従い、堅牢なセキュリティ手法と強固な安全ガードレールを備えた AI システムを設計し、自社モデルのセキュリティと安全性を継続的にテストして改良しています。

Google のポリシー ガイドラインおよび使用禁止に関するポリシーでは、Google の生成 AI ツールの安全性と責任ある使用が最優先とされています。Google のポリシー策定プロセスには、最近の傾向の特定、エンドツーエンドの思考、安全性を念頭に置いた設計が含まれています。Google は自社プロダクトの安全保護対策を常に強化し続け、全世界のユーザーにスケーリングされた保護機能を提供します。

Google は、攻撃者の活動を阻止するため脅威インテリジェンスを活用しています。自社のプロダクト、サービス、ユーザー、プラットフォームの乱用を調査しています。これには、政府の支援を受けた脅威アクターによる悪意のあるサイバー活動も含まれ、該当する場合は法執行機関と協力して対応します。さらに、悪意のある活動に対抗する中で得た知見は、Google のプロダクト開発にフィードバックされ、AI モデルの安全性とセキュリティの向上に活用されます。これらの変更は、分類器とモデルの両方のレベルで行うことができ、防御の俊敏性を維持し、さらなる悪用を防ぐために不可欠です。

Google DeepMind も、潜在的な脆弱性を特定する脅威対策向け生成 AI モデルを開発しており、不正使用に対処する新しい評価およびトレーニング手法を作成しています。この研究と併せて Google DeepMind は、AI システムに、防御機能の他に測定ツールやモニタリング ツールを積極的にデプロイしていることを公表しています。こうしたツールには、間接的なプロンプト インジェクション攻撃に対する AI の脆弱性を自動的にレッドチーム評価できる堅牢な評価フレームワークも含まれます。

Google の AI 開発チームと Trust & Safety チームも、不正使用を阻止するため、Google の脅威インテリジェンス、セキュリティ、およびモデル作成チームと密接に協力しています。

AI、特に生成 AI がもたらす可能性は無限大です。イノベーションが進むにつれて、業界では責任ある AI を構築してデプロイするためのセキュリティ基準が求められています。このため、Google はセキュアな AI システムの概念的枠組みであるセキュア AI フレームワーク(SAIF)を導入しています。Google は、責任を持って AI モデルを設計、構築、評価するための包括的なデベロッパー向けツールキットと、リソースやガイダンスを共有しました。また、Google は安全保護対策の実装、モデルの安全性の評価、AI システムをテストして安全性を保証するためのレッドチーム評価、包括的なプロンプト インジェクション アプローチに関するベスト プラクティスも共有しました。

すべてのユーザーの保護を強化するうえで、業界パートナーと緊密に連携することは非常に重要です。これを実現するために、幸い Google は多くの研究者と緊密な協力関係を構築できています。また、レッドチーム演習を実施し、防御を強化するために尽力してくださる研究者やコミュニティの皆様に感謝しています。

さらに責任ある AI の構築を確実にし、リスクを自動的に発見する AI の可能性を活用するために AI 研究への継続的な投資も行っています。昨年、Google は Google DeepMind と Google Project Zero が開発した AI エージェントである Big Sleep を発表しました。これは、ソフトウェアの未知のセキュリティ脆弱性を積極的に検索して発見するものです。Big Sleep はその後、実世界で初のセキュリティ脆弱性を発見しました。脅威アクターが悪用しようとしていた脆弱性の発見に Big Sleep が貢献したことで、GTIG はこれを事前に阻止することができました。また、脆弱性の発見だけでなく、パッチの適用にも AI を活用する試験運用を行っています。Google は最近、Gemini モデルの高度な推論機能を活用して重大なコードの脆弱性を自動的に修正する、AI を活用した試験運用版エージェント CodeMender を導入しました。

セキュリティ侵害インジケーター(IoC)

このブログ投稿で概要を説明した活動をコミュニティ全体で捕捉および特定できるように、登録ユーザー向けに IOC を無料の GTI コレクションに加えました。

著者略歴

Google Threat Intelligence Group は、Alphabet、Google のユーザー、Google のお客様に対するあらゆる種類のサイバー脅威を特定、分析、低減し、取り除くことを重要な目的としています。活動内容には、政府の支援を受けたアクター、ターゲットが絞られたゼロデイ不正使用、調整された情報工作(IO)、そして深刻なサイバー犯罪ネットワークからの脅威に立ち向かうことが含まれます。Google Threat Intelligence グループのインテリジェンスを適用することで Google の防御を強化し、Google のユーザーとお客様を保護します。

- Google Threat Intelligence Group