Bilder mit der AutoML Vision Edge API mit Labels versehen

In dieser Kurzanleitung werden folgende Verfahren erläutert:

- Mithilfe der AutoML Vision-Objekterkennung ein Dataset erstellen, ein benutzerdefiniertes AutoML Vision Edge-Modell trainieren und eine Vorhersage treffen

- AutoML Vision Edge-Modell exportieren und verwenden

In dieser Kurzanleitung verwenden Sie die Benutzeroberfläche (UI), um mit der AutoML Vision API zu interagieren und Ihr AutoML Vision Edge-Modell zu exportieren.

Hinweis

Bevor Sie die AutoML Vision-Objekterkennung verwenden können, müssen Sie ein Google Cloud-Projekt erstellen, das noch nie mit einem anderen AutoML-Produkt verwendet wurde, und die AutoML Vision-Objekterkennung für dieses Projekt aktivieren.

- Melden Sie sich bei Ihrem Google Cloud-Konto an. Wenn Sie mit Google Cloud noch nicht vertraut sind, erstellen Sie ein Konto, um die Leistungsfähigkeit unserer Produkte in der Praxis sehen und bewerten zu können. Neukunden erhalten außerdem ein Guthaben von 300 $, um Arbeitslasten auszuführen, zu testen und bereitzustellen.

-

Wählen Sie in der Google Cloud Console auf der Seite der Projektauswahl ein Google Cloud-Projekt aus oder erstellen Sie eines.

-

Die Abrechnung für das Google Cloud-Projekt muss aktiviert sein.

-

Cloud AutoML and Storage APIs aktivieren.

-

Wählen Sie in der Google Cloud Console auf der Seite der Projektauswahl ein Google Cloud-Projekt aus oder erstellen Sie eines.

-

Die Abrechnung für das Google Cloud-Projekt muss aktiviert sein.

-

Cloud AutoML and Storage APIs aktivieren.

Beta-Anforderungen

- Für diese Betafunktion müssen Sie

us-central1als Region angeben.

Dataset vorbereiten

In dieser Kurzanleitung verwenden Sie ein Dataset, das aus Open Images Dataset Version 4 erstellt wurde.

Dieses öffentlich verfügbare „Salads”-Dataset ist unter gs://cloud-ml-data/img/openimage/csv/salads_ml_use.csv gespeichert.

Das CSV-Format lautet:

TRAINING,gs://cloud-ml-data/img/openimage/3/2520/3916261642_0a504acd60_o.jpg,Salad,0.0,0.0954,,,0.977,0.957,, VALIDATION,gs://cloud-ml-data/img/openimage/3/2520/3916261642_0a504acd60_o.jpg,Seafood,0.0154,0.1538,,,1.0,0.802,, TEST,gs://cloud-ml-data/img/openimage/3/2520/3916261642_0a504acd60_o.jpg,Tomato,0.0,0.655,,,0.231,0.839,,

3916261642_0a504acd60_o.jpgJede Zeile entspricht einem Objekt, das sich in einem größeren Bild befindet. Alle Objekte sind dabei jeweils spezifisch als Test-, Trainings- oder Validierungsdaten festgelegt. Die drei hier angegebenen Zeilen geben drei verschiedene Objekte an, die sich im gleichen Bild befinden, das unter gs://cloud-ml-data/img/openimage/3/2520/3916261642_0a504acd60_o.jpg verfügbar ist. Jede Zeile hat ein anderes Label: Salad, Seafood, Tomato. Daneben gibt es weitere Zeilen mit Labels wie Baked goods oder Cheese.

Über die Eckpunkte oben links und unten rechts werden für jedes Bild Begrenzungsrahmen festgelegt:

- (0, 0) entspricht dem Eckpunkt ganz oben links.

- (1, 1) entspricht dem Eckpunkt ganz unten rechts.

Für die erste Zeile, die oben angezeigt wird, lauten die Koordinaten (x, y) für den Eckpunkt oben links des Objekts mit dem Label Salad (0,0, 0,0954). Die Koordinaten für den Eckpunkt unten rechts des Objekts lauten (0,977, 0,957).

Ausführliche Informationen zum Formatieren der CSV-Datei und zu den Mindestanforderungen zum Erstellen eines gültigen Datasets finden Sie unter Trainingsdaten vorbereiten.

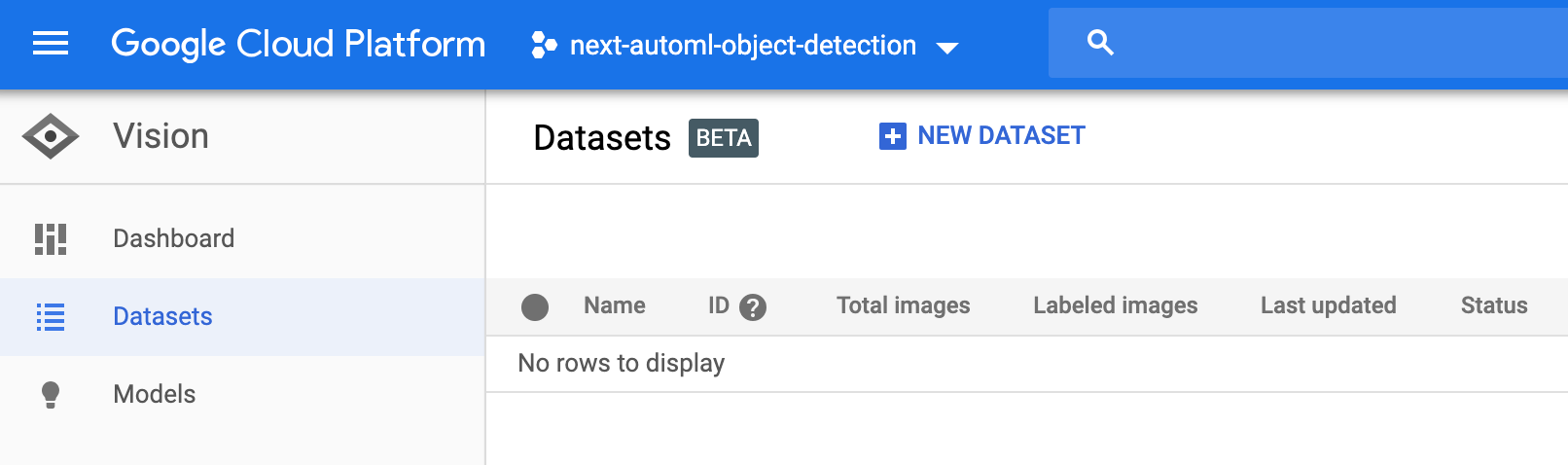

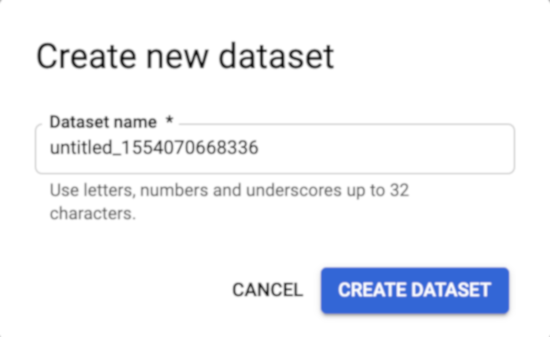

Dataset erstellen

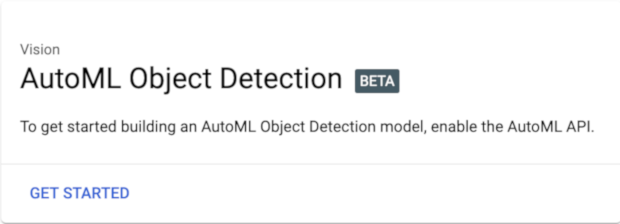

- Öffnen Sie die Benutzeroberfläche von AutoML Vision Object Detection und wählen Sie Ihr Projekt aus der Drop-down-Liste in der Titelleiste aus.

Wenn Sie die UI der AutoML Vision Object Detection zum ersten Mal öffnen, müssen Sie die AutoML API aktivieren, falls sie noch nicht aktiv ist.

- Wählen Sie Erste Schritte im Pop-up-Fenster aus, wenn Sie dazu aufgefordert werden.

-

Sie werden zu einer Seite mit einer Liste der Datasets weitergeleitet. Wählen Sie Neues Dataset aus, um ein neues Dataset zu erstellen.

Geben Sie einen eindeutigen Namen für das Dataset ein.

-

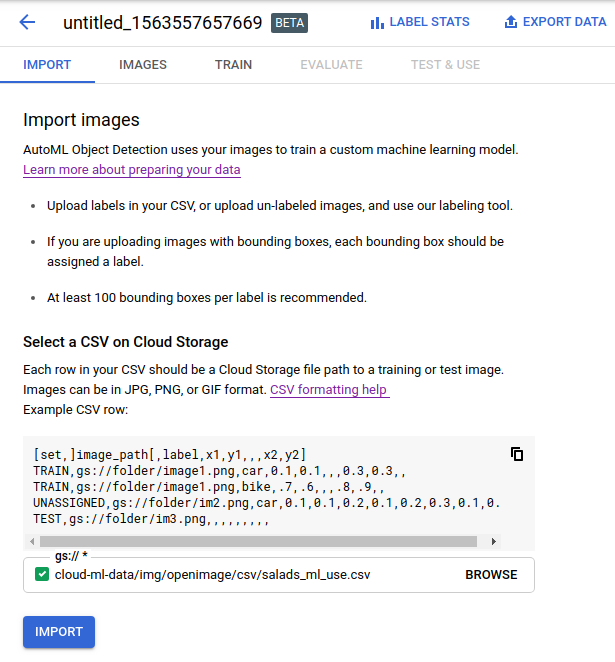

Geben Sie im darauffolgenden Fenster den Speicherort der zu importierenden Trainingsdaten ein.

Geben Sie im Textfeld Select a CSV file on Cloud Storage (CSV-Datei in Cloud Storage auswählen) den Pfad zu der Beispiel-CSV-Datei ein. Das Präfix

gs://wird automatisch hinzugefügt.cloud-ml-data/img/openimage/csv/salads_ml_use.csv

Alternativ können Sie Durchsuchen auswählen und in einem Ihrer Google Cloud Storage-Buckets die CSV-Datei aufrufen.

In dieser Kurzanleitung werden Beispieldaten verwendet, die in einem öffentlichen Google Cloud Storage-Bucket bereitgestellt werden. Die Trainingsdaten sind Beispiel-JPG-Bilder, die mit dem Begrenzungsrahmen und dem Label der Objekte versehen sind, die das Modell zu identifizieren lernen soll. Verwenden Sie zum Importieren der Trainingsdaten in das Dataset eine CSV-Datei, die auf die Image-Dateien (JPEG, PNG, GIF, BMP oder ICO) verweist. Weitere Informationen zu den Format- und Bildspezifikationen finden Sie unter Trainingsdaten vorbereiten.

-

Wählen Sie Importieren aus.

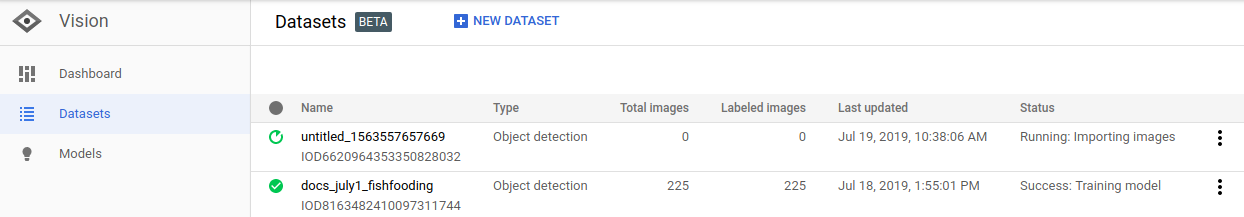

Ihr Dataset zeigt während des Imports Ihrer Bilder den Status

Running:importing imagesan. Dieser Vorgang dauert nur wenige Minuten.

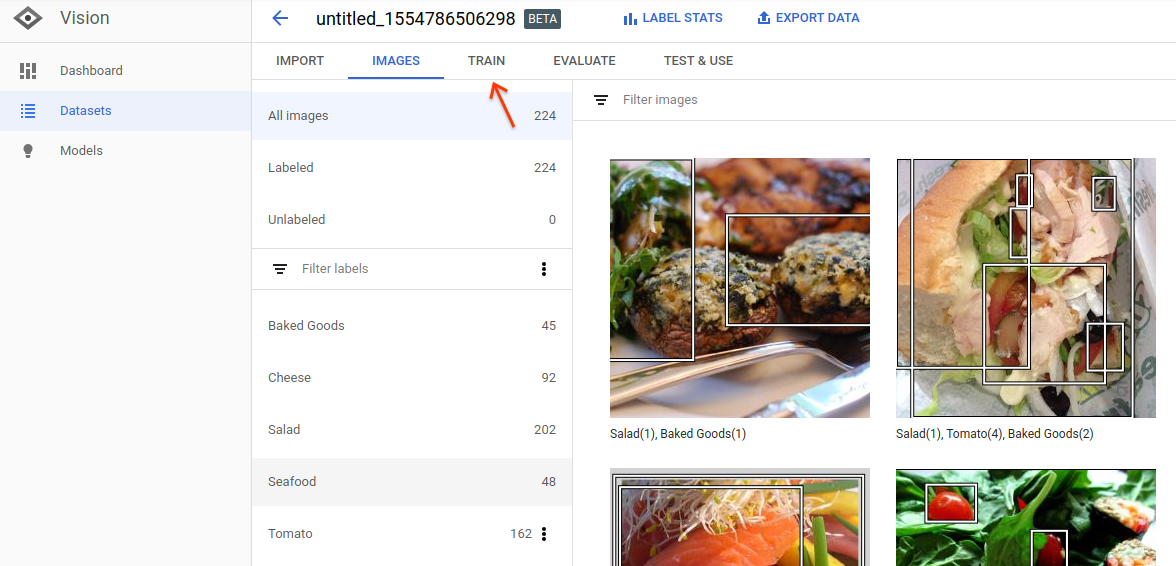

Wenn Ihre Trainingsdaten erfolgreich importiert wurden, steht in der Spalte Status Success:Creating dataset und die Benutzeroberfläche zeigt die generierte ID für das Dataset (die bei AutoML API-Aufrufen verwendet wird) sowie die Anzahl der importierten Artikel an.

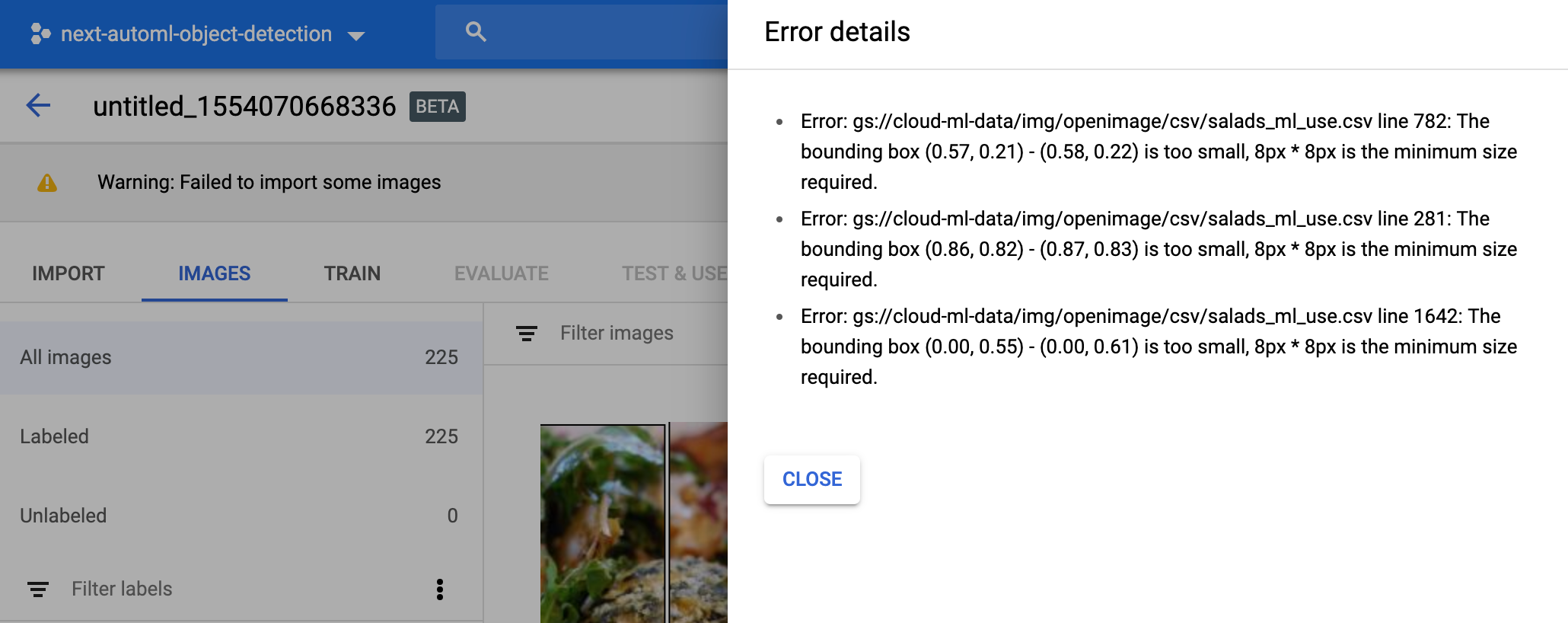

Wenn beim Importieren der Bilder Probleme auftreten, wird als Status Warning: Importing

images angezeigt. Wählen Sie den Dataset-Namen und Details aus, um die Fehler bei einem bestimmten Bildimport anzuzeigen.

Modell trainieren

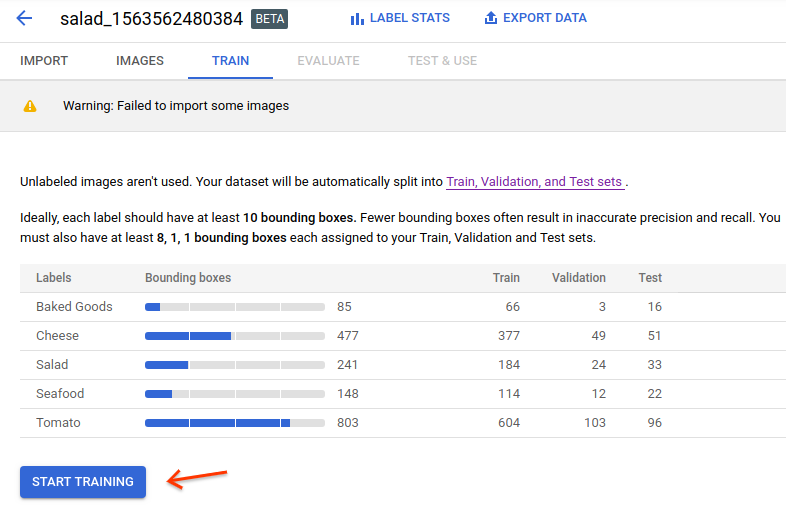

Sobald Ihr Dataset erstellt und verarbeitet wurde, wählen Sie den Tab Train (Trainieren) aus, um mit dem Modelltraining zu beginnen.

Wählen Sie Start training (Training starten) aus, um fortzufahren.

Dadurch wird ein Seitenfenster mit Trainingsoptionen geöffnet.

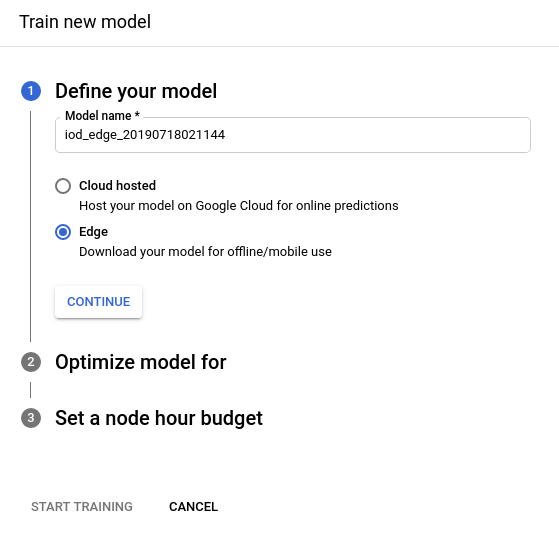

Ändern Sie im Trainingsbereich Modell bestimmen den Modellnamen und wählen Sie als Modelltyp radio_button_checked Edge aus. Nachdem Sie die Option zum Trainieren eines Edge-Modells ausgewählt haben, klicken Sie auf Weiter.

Wählen Sie anschließend im Bereich Modell optimieren für die Standardoption radio_button_checked Bester Kompromiss aus. Wählen Sie nach der Auswahl der Optimierungskriterien Weiter aus.

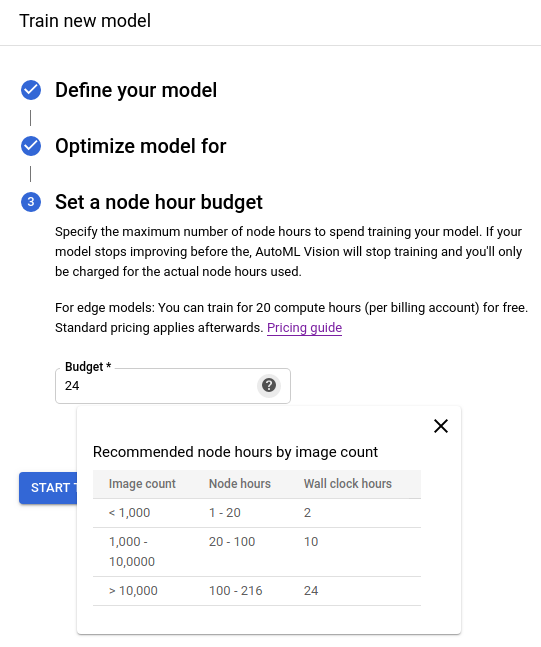

Verwenden Sie anschließend im Bereich Knotenstundenbudget festlegen das empfohlene Knotenstundenbudget (24).

Wählen Sie Start training (Training starten), um mit dem Modelltraining zu beginnen.

Das Training des Modells wird gestartet und sollte etwa eine Stunde dauern. Das Training endet möglicherweise vor der ausgewählten Knotenstunde. Wenn das Training abgeschlossen ist oder ein Fehler auftritt, werden Sie per E-Mail benachrichtigt.

Sobald das Training abgeschlossen ist, können Sie auf die Bewertungsmesswerte zurückgreifen und das Modell testen und verwenden.

Wählen Sie die Option Bewerten aus, um weitere Informationen zu F1, Precision und Recall zu erhalten.

Wählen Sie unter Labels filtern ein einzelnes Label aus, um mehr Informationen zu richtig positiven, falsch negativen und falsch positiven Ergebnissen zu erhalten.

Vorhersagen treffen

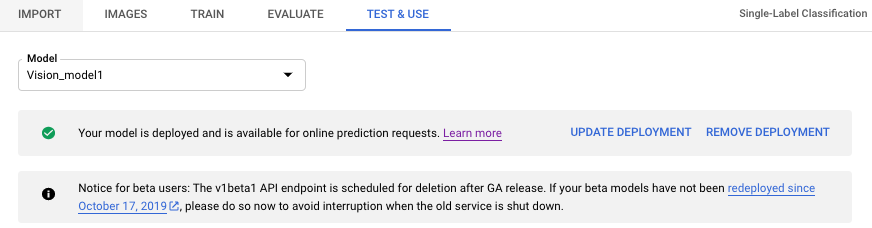

Nach Abschluss des Trainings muss Ihr Modell manuell bereitgestellt werden, bevor Sie mit dem Modell Onlinevorhersagen treffen können.

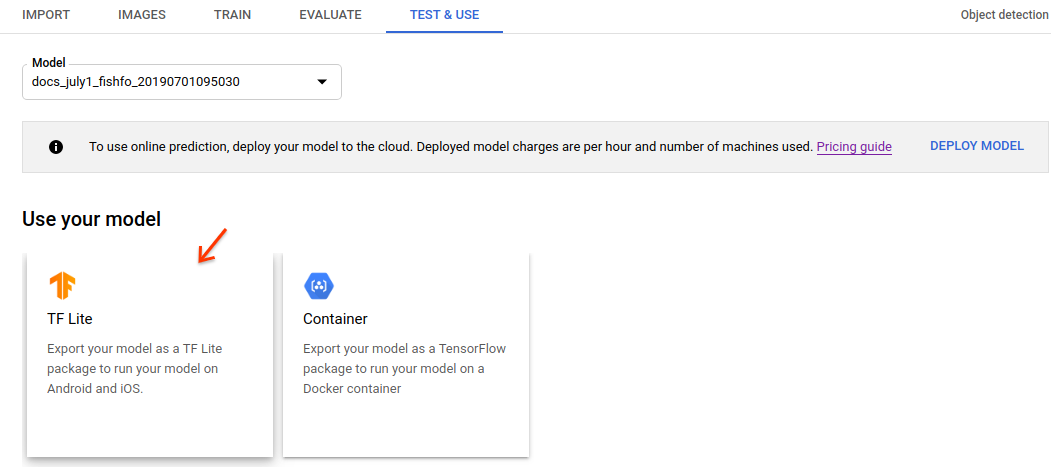

Wählen Sie den Tab Test und Nutzung aus, um Ihr Modell bereitzustellen oder die Bereitstellung aufzuheben. Auf der Seite Test und Nutzung finden Sie außerdem eine Anleitung zum Senden eines Bildes an das Modell für eine Vorhersage. Entsprechende Beispiele finden Sie auch unter Bilder annotieren.

Edge-Modell exportieren und verwenden

Im letzten Schritt bei der Verwendung eines AutoML Vision Edge-Modells wird das Modell exportiert (optimiert und heruntergeladen) und verwendet.

Es gibt mehrere Möglichkeiten, Ihre Modelle für Vorhersagen auf Edge-Geräte zu exportieren und zu verwenden.

In dieser Kurzanleitung verwenden Sie Tensorflow Lite (TF Lite) als Beispiel. TF Lite-Modelle sind einfach zu verwenden und bieten eine Vielzahl von Anwendungsfällen.

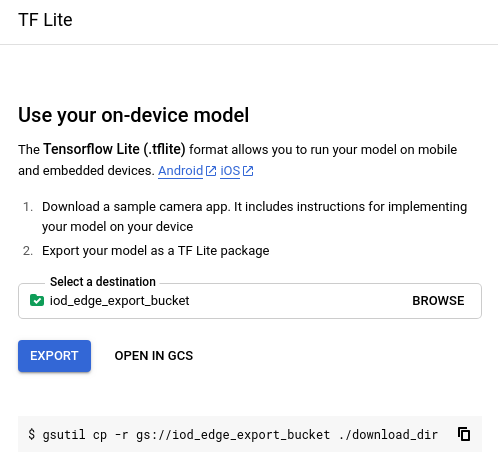

Wählen Sie unter Use your model (Modell verwenden) die Option TF Lite.

Geben Sie im daraufhin angezeigten Seitenfenster einen Google Cloud Storage-Speicherort für das exportierte Modell an.

Wenn Sie einen Speicherort angegeben haben, wählen Sie Exportieren aus, um ein TF Lite-Paket in Ihren Cloud Storage-Storage-Bucket zu exportieren. Der Exportvorgang dauert in der Regel einige Minuten.

Wählen Sie nach dem Export den Link In Google Cloud Storage öffnen aus, um in der Google Cloud Platform Console zum Google Cloud Storage-Zielordner zu gelangen.

Am Google Cloud Storage-Zielort befindet sich ein Ordner mit dem Namen für den Zeitstempel und das Modellformat, unter dem Sie die folgenden Dateien finden:

- eine tflite-Datei (

model.tflite) - eine Wörterbuchdatei (

dict.txt) - eine Metadatendatei (

tflite_metadata.json)

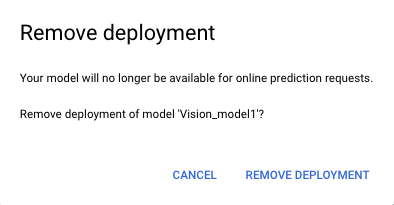

Bereinigen

Mit den folgenden Schritten vermeiden Sie, dass Ihrem Google Cloud-Konto die in dieser Anleitung verwendeten Ressourcen in Rechnung gestellt werden:

Nächste Schritte

Mit diesen Dateien können Sie den Anleitungen auf Android-Geräten, iOS-Geräten oder Raspberry Pi 3 folgen.

Weitere Optionen zur Verwendung des Modells:

- Sie können das Modell auch als TensorFlow SavedModel exportieren und mit einem Docker-Container auf dem Tab Container verwenden. Anleitungen zum Exportieren in einen Container finden Sie in der Container-Anleitung.

- Sie können das Modell zur Ausführung auf Edge TPU auf dem Tab Edge-Geräte exportieren. In dieser offiziellen Edge TPU-Dokumentation erfahren Sie, wie Sie das Modell verwenden.