Gérer les ensembles de données

Un ensemble de données contient des échantillons représentatifs du type de contenu auquel vous souhaitez étiqueter, avec les étiquettes de cadre de délimitation que vous souhaitez que le modèle utilise. Il sert d'entrée pour l'entraînement d'un modèle.

Voici les principales étapes à suivre pour créer un ensemble de données :

- Créer un ensemble de données et spécifier s'il faut autoriser plusieurs étiquettes sur chaque élément.

- Importer des éléments de données dans l'ensemble de données.

Avant d'entraîner un modèle, veillez à préparer vos données.

Un projet peut avoir plusieurs ensembles de données, chacun servant à entraîner un modèle distinct. Vous pouvez accéder à la liste des ensembles de données disponibles et supprimer les ensembles de données dont vous n'avez plus besoin.

Créer un ensemble de données

La première étape de l'élaboration d'un modèle consiste à créer un ensemble de données vide, qui contiendra à terme les données d'entraînement du modèle.

UI Web

L'interface utilisateur d'AutoML Video Object Tracking vous permet de créer un ensemble de données, puis d'y importer des éléments à partir de la même page.- Ouvrez l'interface utilisateur d'AutoML Video Object Tracking.

La page Datasets (Ensembles de données) indique l'état des ensembles de données créés précédemment pour le projet en cours.

Si vous souhaitez ajouter un ensemble de données pour un autre projet, sélectionnez ce projet dans la liste déroulante située dans l'angle supérieur droit de la barre de titre.

Si vous souhaitez ajouter un ensemble de données pour un autre projet, sélectionnez ce projet dans la liste déroulante située dans l'angle supérieur droit de la barre de titre. - Sur la page Datasets (Ensembles de données), cliquez sur Create Dataset (Créer un ensemble de données).

- Dans la boîte de dialogue Créer un ensemble de données, procédez comme suit :

- Spécifiez un nom pour cet ensemble de données.

- Sélectionnez Suivi des objets vidéo.

- Cliquez sur Créer un ensemble de données.

- Sur la page de votre ensemble de données, indiquez l'URI Cloud Storage du fichier CSV contenant les URI de vos données d'entraînement, sans le préfixe

gs://au début. - Toujours sur la page de votre ensemble de données, cliquez sur Continuer pour commencer l'importation.

REST

L'exemple suivant crée un ensemble de données nommé my_dataset01 compatible avec les cas d'utilisation du suivi des objets. Ce nouvel ensemble de données ne contient aucune donnée tant que vous n'y importez pas d'éléments.

Enregistrez le nom ("name") du nouvel ensemble de données (issu de la réponse) afin de l'utiliser pour d'autres opérations, par exemple y importer des éléments ou entraîner un modèle.

Avant d'utiliser les données de requête, effectuez les remplacements suivants:

- dataset-name : nom de l'ensemble de données cible.

Par exemple,my_dataset_01 - Remarque :

- project-number : numéro de votre projet.

- location-id : région cloud dans laquelle l'annotation doit avoir lieu. Les régions cloud compatibles sont les suivantes :

us-east1,us-west1,europe-west1etasia-east1. Si aucune région n'est spécifiée, une région sera déterminée en fonction de l'emplacement du fichier vidéo.

Méthode HTTP et URL :

POST https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets

Corps JSON de la requête :

{

"displayName": "dataset-name",

"videoObjectTrackingDatasetMetadata": { }

}

Pour envoyer votre requête, choisissez l'une des options suivantes :

curl

Enregistrez le corps de la requête dans un fichier nommé request.json et exécutez la commande suivante:

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "x-goog-user-project: project-number" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets"

PowerShell

Enregistrez le corps de la requête dans un fichier nommé request.json et exécutez la commande suivante:

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred"; "x-goog-user-project" = "project-number" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets" | Select-Object -Expand Content

VOT12345....

Java

Pour vous authentifier auprès du suivi des objets AutoML Video, configurez les Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Node.js

Pour vous authentifier auprès du suivi des objets AutoML Video, configurez les Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Python

Pour vous authentifier auprès du suivi des objets AutoML Video, configurez les Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Importer des éléments dans un ensemble de données

Une fois que vous avez créé un ensemble de données, vous pouvez importer des données étiquetées à partir de fichiers CSV stockés dans un bucket Cloud Storage. Pour plus de détails sur la préparation des données et la création d'un fichier CSV à importer, consultez la page Préparer les données d'entraînement.

Vous pouvez importer des éléments dans un ensemble de données vide, ou importer des éléments supplémentaires dans un ensemble de données existant.

UI Web

En règle générale, vous importez vos données lorsque vous créez votre ensemble de données.Toutefois, si vous devez importer les données après avoir créé votre ensemble de données, procédez comme suit :

- Ouvrez l'interface utilisateur d'AutoML Video Object Tracking.

La page Datasets (Ensembles de données) indique l'état des ensembles de données créés précédemment pour le projet en cours.

- Dans la liste, cliquez sur l'ensemble de données dans lequel vous souhaitez importer des données.

- Dans l'onglet Import (Importer), indiquez l'URI Cloud Storage du fichier CSV contenant les URI de vos données d'entraînement, sans le préfixe

gs://au début. - Toujours dans l'onglet Importer de votre ensemble de données, cliquez sur Continuer pour commencer l'importation.

REST

Pour importer vos données d'entraînement, utilisez la méthodeimportData. Cette méthode nécessite de fournir deux paramètres :

Avant d'utiliser les données de requête, effectuez les remplacements suivants:

- dataset-id : ID de votre ensemble de données. L'ID correspond au dernier élément du nom de l'ensemble de données. Exemple :

- Nom de l'ensemble de données :

projects/project-number/locations/location-id/datasets/3104518874390609379 - ID de l'ensemble de données :

3104518874390609379

- Nom de l'ensemble de données :

- bucket-name : remplacez cette valeur par le nom du bucket Cloud Storage dans lequel vous avez stocké le fichier CSV de votre liste de fichiers d'entraînement de modèle.

- csv-file-name : remplacez cette valeur par le nom du fichier CSV de votre liste de fichiers d'entraînement de modèle.

- Remarque :

- project-number : numéro de votre projet.

- location-id : région cloud dans laquelle l'annotation doit avoir lieu. Les régions cloud compatibles sont les suivantes :

us-east1,us-west1,europe-west1etasia-east1. Si aucune région n'est spécifiée, une région sera déterminée en fonction de l'emplacement du fichier vidéo.

Méthode HTTP et URL :

POST https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets/dataset-id:importData

Corps JSON de la requête :

{

"inputConfig": {

"gcsSource": {

"inputUris": ["gs://bucket-name/csv-file-name.csv"]

}

}

}

Pour envoyer votre requête, choisissez l'une des options suivantes :

curl

Enregistrez le corps de la requête dans un fichier nommé request.json et exécutez la commande suivante:

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "x-goog-user-project: project-number" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets/dataset-id:importData"

PowerShell

Enregistrez le corps de la requête dans un fichier nommé request.json et exécutez la commande suivante:

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred"; "x-goog-user-project" = "project-number" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets/dataset-id:importData" | Select-Object -Expand Content

VOT7506374678919774208.

Java

Pour vous authentifier auprès du suivi des objets AutoML Video, configurez les Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Node.js

Pour vous authentifier auprès du suivi des objets AutoML Video, configurez les Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Python

Pour vous authentifier auprès du suivi des objets AutoML Video, configurez les Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Appliquer des étiquettes aux éléments d'entraînement

Chaque élément d'un ensemble de données doit contenir au moins un cadre de délimitation et être associé à au moins une étiquette de catégorie pour pouvoir servir à l'entraînement d'un modèle. Vous pouvez fournir des étiquettes et des cadres de délimitation pour vos éléments d'entraînement de deux manières :

- Incluez des étiquettes et des cadres de délimitation dans votre fichier CSV.

- Appliquez des étiquettes et des cadres de délimitation à vos éléments dans l'interface utilisateur d'AutoML Video Object Tracking.

Pour savoir comment attribuer des étiquettes aux éléments dans votre fichier CSV, consultez la page Préparer les données d'entraînement.

Pour appliquer des étiquettes à des éléments dans l'interface utilisateur d'AutoML Video Object Tracking, sélectionnez un ensemble de données sur la page où ils sont répertoriés afin d'afficher les détails correspondants. Le nom à afficher de l'ensemble de données sélectionné s'affiche dans la barre de titre. La page répertorie chaque élément de l'ensemble de données et l'étiquette correspondante. La barre de navigation de gauche récapitule le nombre d'éléments avec et sans étiquette. Elle vous permet également de filtrer la liste d'éléments par étiquette.

![]()

Pour attribuer des étiquettes et des cadres de délimitation à des vidéos sans étiquette ou pour modifier les étiquettes et les cadres de délimitation des vidéos, procédez comme suit :

- Sur la page de l'ensemble de données, cliquez sur la vidéo pour laquelle vous souhaitez ajouter des étiquettes.

Sur la page de la vidéo, procédez comme suit :

- Lancez la vidéo jusqu'à ce que l'élément auquel vous souhaitez ajouter une étiquette apparaisse.

- Faites glisser le curseur pour tracer un cadre de délimitation autour de l'élément.

- Après avoir tracé le cadre de délimitation, sélectionnez l'étiquette que vous souhaitez utiliser.

- Cliquez sur Enregistrer.

![]()

Si vous devez ajouter une étiquette à l'ensemble de données, cliquez sur les trois points à côté de la rubrique Filter labels (Filtrer les étiquettes), puis sur Add new label (Ajouter une étiquette) au-dessus de la liste des étiquettes existantes sur la page de l'ensemble de données.

Modifier des étiquettes dans les données

Vous pouvez également modifier les étiquettes appliquées aux vidéos d'un ensemble de données. Dans l'interface utilisateur d'AutoML Video Object Tracking, procédez comme suit :

- Sur la page de l'ensemble de données, cliquez sur la vidéo dont vous souhaitez modifier les étiquettes.

Sur la page de la vidéo, procédez comme suit :

- Dans la liste des étiquettes sur la gauche, sélectionnez celle que vous souhaitez modifier.

- Dans l'aperçu de la vidéo, effectuez un clic droit sur le cadre de délimitation de la vidéo et sélectionnez l'étiquette de votre choix.

- Cliquez sur Enregistrer.

![]()

Répertorier les ensembles de données

Un projet peut inclure de nombreux ensembles de données. Cette section explique comment récupérer la liste des ensembles de données disponibles pour un projet.

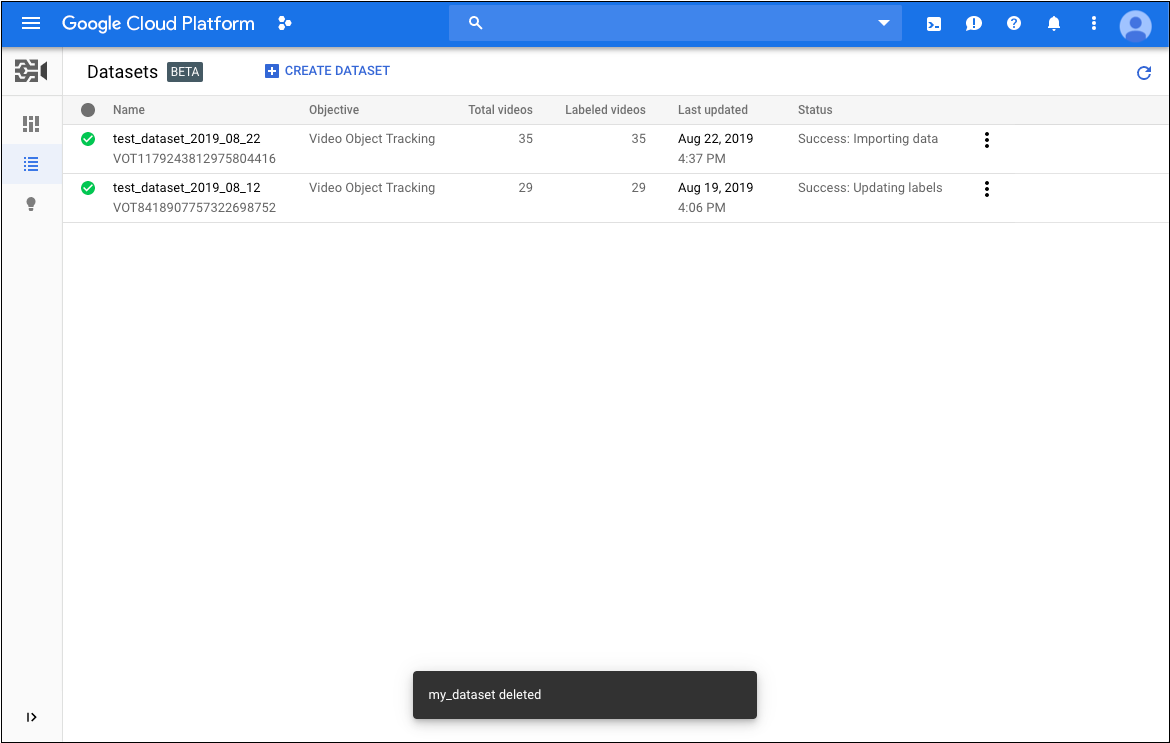

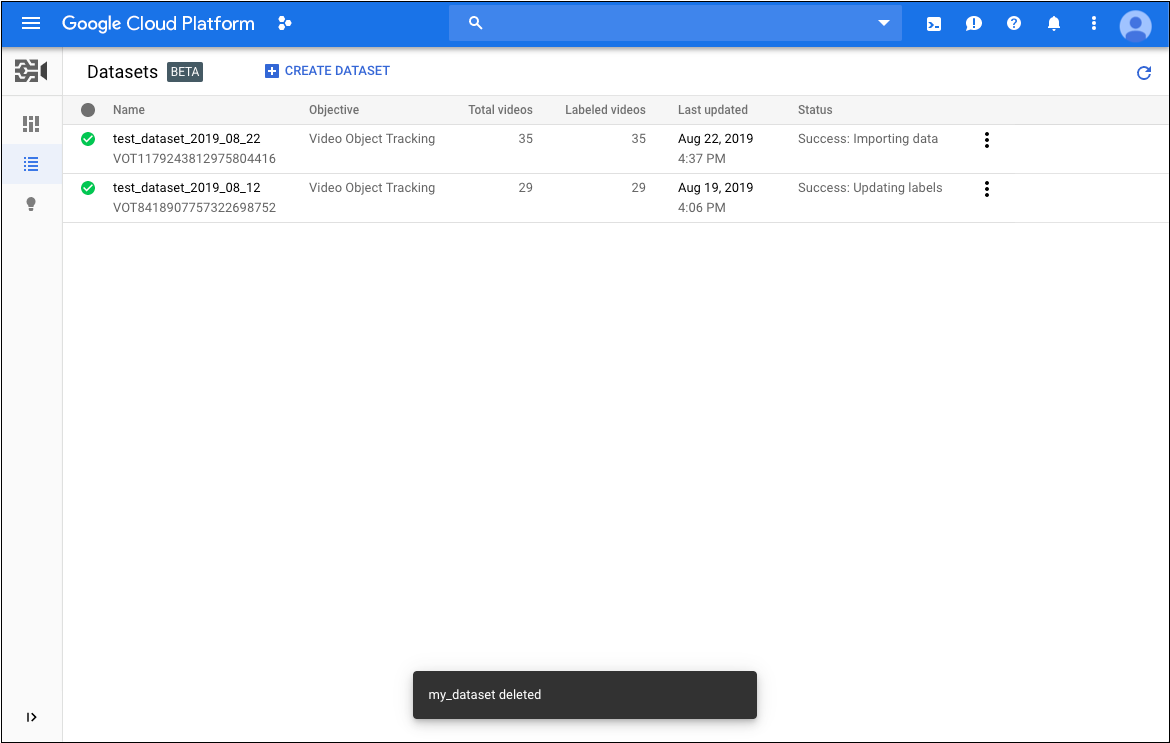

UI Web

Pour afficher la liste des ensembles de données disponibles à l'aide de l'interface utilisateur d'AutoML Video Object Tracking, accédez à la page Ensembles de données.![]()

Pour afficher les ensembles de données d'un autre projet, sélectionnez le projet dans la liste déroulante située dans l'angle supérieur droit de la barre de titre.

REST

Utilisez les commandescurl ou PowerShell suivantes pour obtenir la liste de vos ensembles de données et le nombre d'échantillons vidéo qui y ont été importés.

Avant d'utiliser les données de requête, effectuez les remplacements suivants:

- project-number : numéro de votre projet.

- location-id : région cloud dans laquelle l'annotation doit avoir lieu. Les régions cloud compatibles sont les suivantes :

us-east1,us-west1,europe-west1etasia-east1. Si aucune région n'est spécifiée, une région sera déterminée en fonction de l'emplacement du fichier vidéo.

Méthode HTTP et URL :

GET https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets

Pour envoyer votre requête, choisissez l'une des options suivantes :

curl

exécutez la commande suivante :

curl -X GET \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "x-goog-user-project: project-number" \

"https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets "

PowerShell

exécutez la commande suivante :

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred"; "x-goog-user-project" = "project-number" }

Invoke-WebRequest `

-Method GET `

-Headers $headers `

-Uri "https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets " | Select-Object -Expand Content

VOT3940649673949184000 est l'ID de l'opération de longue durée créée pour la requête et fourni dans la réponse lorsque vous avez lancé l'opération.

Java

Pour vous authentifier auprès du suivi des objets AutoML Video, configurez les Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Node.js

Pour vous authentifier auprès du suivi des objets AutoML Video, configurez les Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Python

Pour vous authentifier auprès du suivi des objets AutoML Video, configurez les Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Supprimer un ensemble de données

Le code suivant montre comment supprimer un ensemble de données.

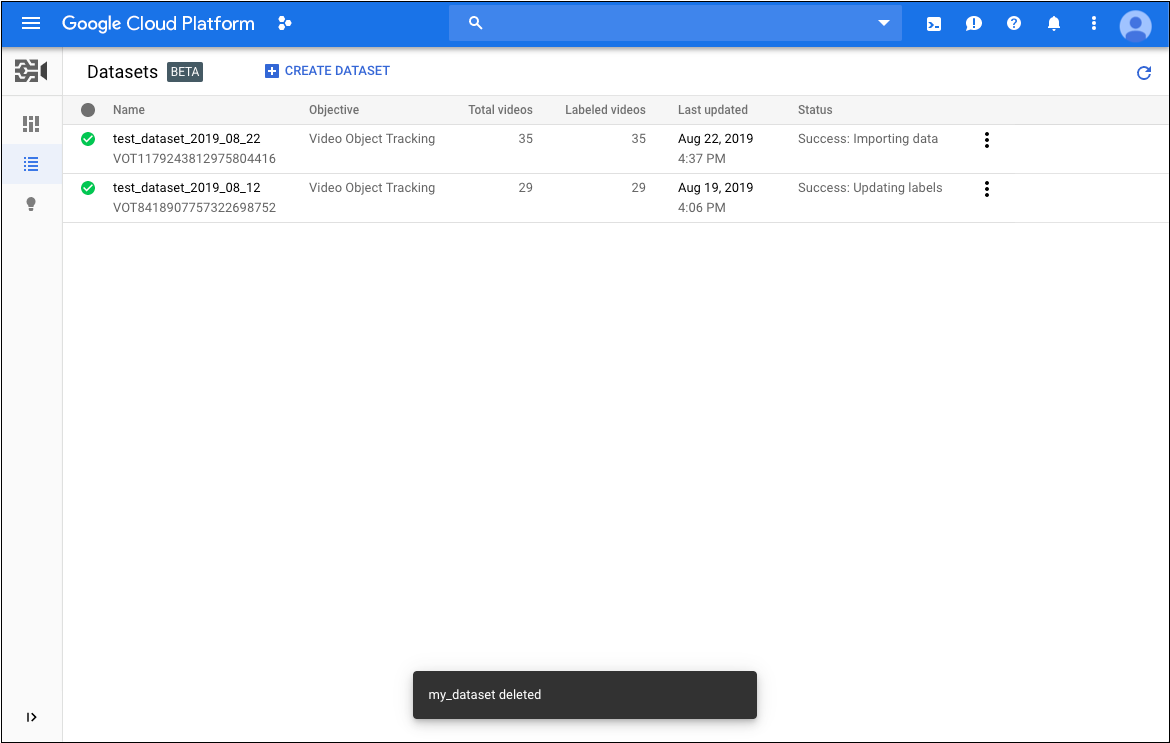

UI Web

-

Accédez à la page Ensembles de données dans l'interface utilisateur d'AutoML Video Object Tracking.

- Cliquez sur le menu à trois points à l'extrémité droite de la ligne à supprimer, puis sélectionnez Supprimer l'ensemble de données.

- Cliquez sur Supprimer dans la boîte de dialogue de confirmation.

REST

Avant d'utiliser les données de requête, effectuez les remplacements suivants:

- project-number : numéro de votre projet.

- location-id : région cloud dans laquelle l'annotation doit avoir lieu. Les régions cloud compatibles sont les suivantes :

us-east1,us-west1,europe-west1etasia-east1. Si aucune région n'est spécifiée, une région sera déterminée en fonction de l'emplacement du fichier vidéo. - datase-id : remplacez cette valeur par l'identifiant de votre ensemble de données.

Méthode HTTP et URL :

DELETE https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets/dataset-id

Pour envoyer votre requête, développez l'une des options suivantes :

Vous devriez recevoir un code d'état indiquant le succès de l'opération (2xx), ainsi qu'une réponse vide.

Java

Pour vous authentifier auprès du suivi des objets AutoML Video, configurez les Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Node.js

Pour vous authentifier auprès du suivi des objets AutoML Video, configurez les Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.

Python

Pour vous authentifier auprès du suivi des objets AutoML Video, configurez les Identifiants par défaut de l'application. Pour en savoir plus, consultez Configurer l'authentification pour un environnement de développement local.