Como gerenciar conjuntos de dados

Um conjunto de dados contém amostras representativas do tipo de conteúdo que você quer classificar, marcado com as etiquetas de categoria que você quer que seu modelo personalizado use. O conjunto de dados serve como entrada para treinar um modelo.

Veja a seguir as principais etapas para criar um conjunto de dados:

- Crie um conjunto de dados e especifique se quer permitir várias etiquetas em cada item.

- Importe itens de dados para o conjunto de dados.

- Use etiquetas nos itens.

Um projeto pode ter vários conjuntos de dados, cada um usado para treinar um modelo diferente. É possível conseguir uma lista dos conjuntos de dados disponíveis e excluir aqueles que não são mais necessários.

Como criar um conjunto de dados

A primeira etapa na criação de um modelo personalizado é criar um conjunto de dados vazio que vai armazenar os dados de treinamento do modelo.

IU da Web

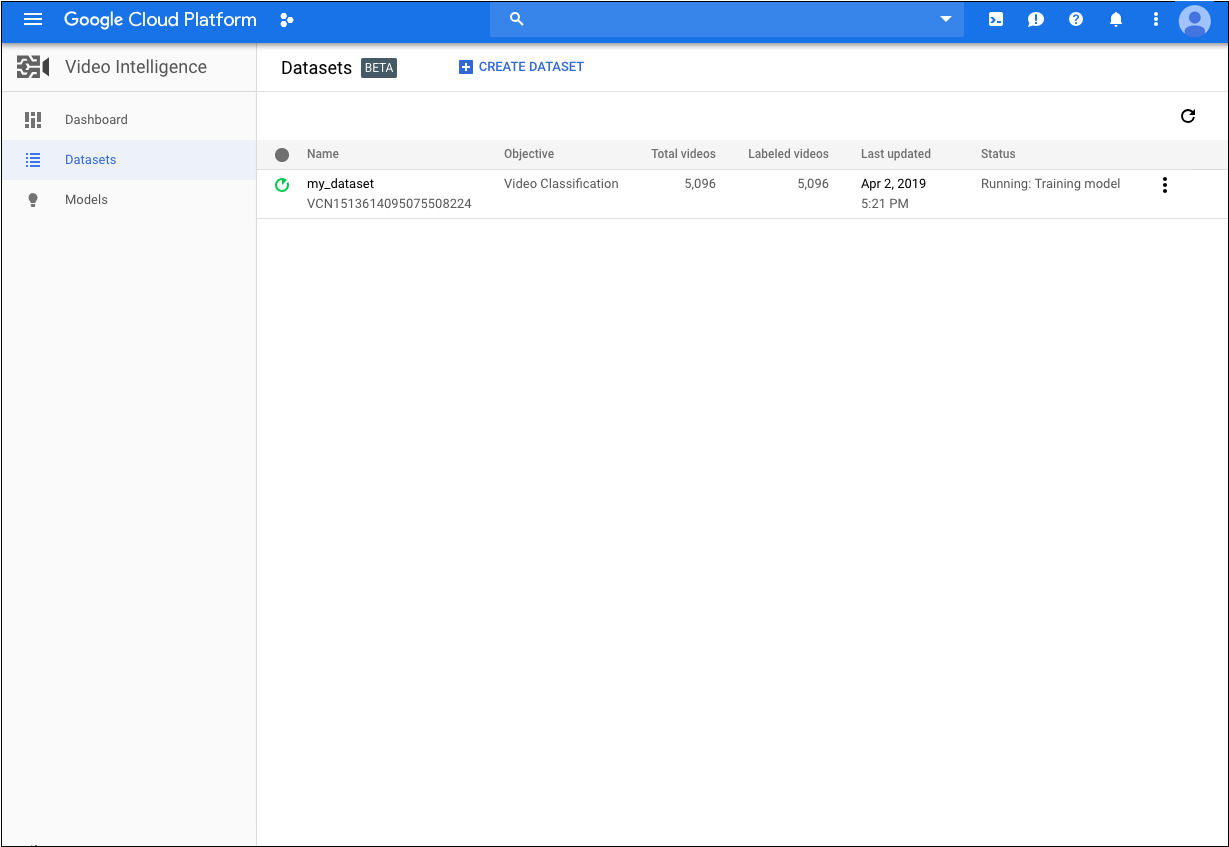

Na IU do AutoML Video, é possível criar um novo conjunto de dados e importar itens para ele na mesma página.- Abra a IU do AutoML Video.

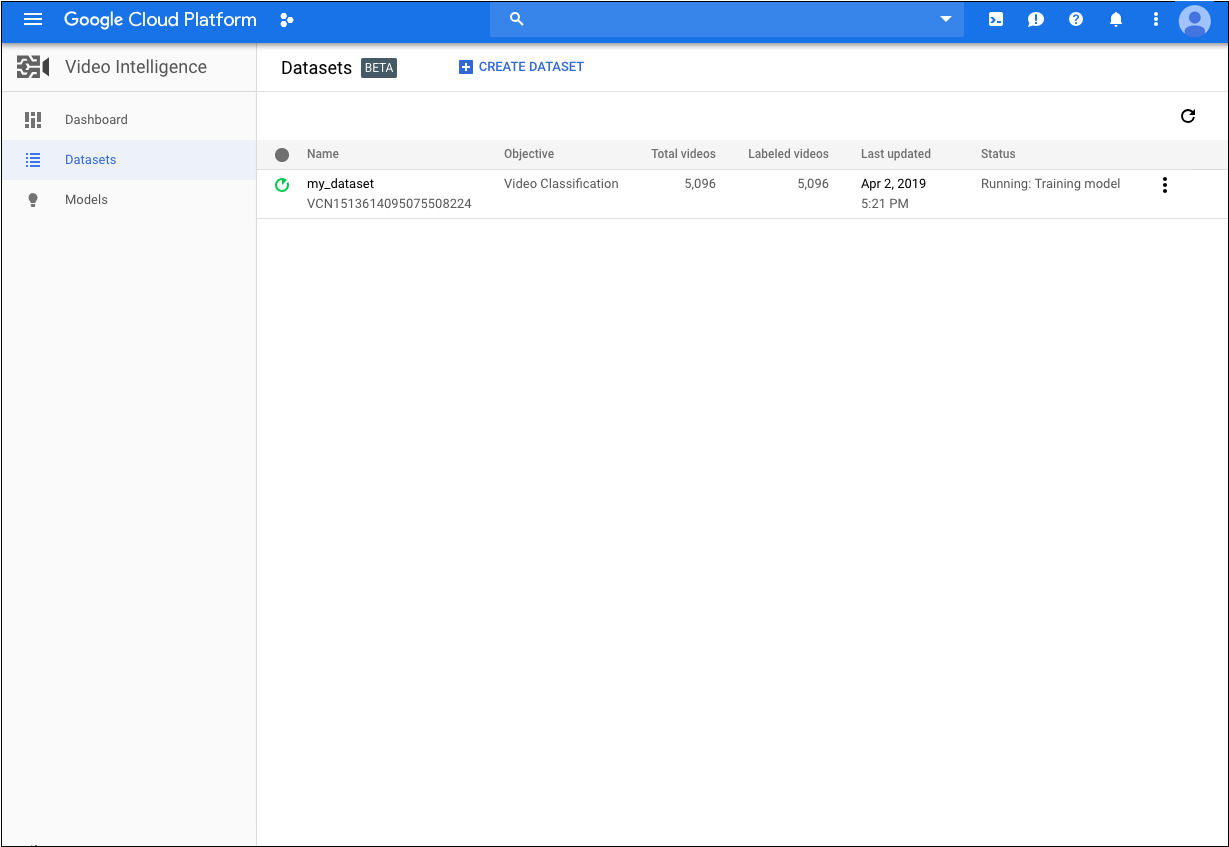

A página Conjuntos de dados mostra o status de conjuntos de dados criados anteriormente para o projeto atual.

Para adicionar um conjunto de dados em um projeto diferente, selecione o projeto na lista suspensa no canto superior direito da barra de título.

Para adicionar um conjunto de dados em um projeto diferente, selecione o projeto na lista suspensa no canto superior direito da barra de título. - Na página Conjuntos de dados, clique em Criar conjunto de dados.

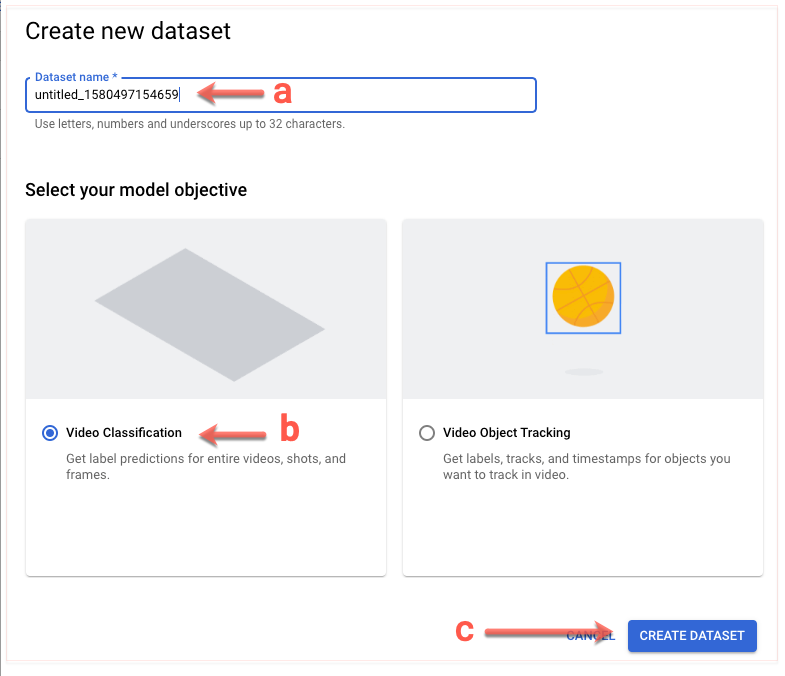

A seguinte tela será exibida:

- Insira informações sobre o conjunto de dados:

Especifique um nome para ele.- Selecione Classificação de vídeo.

- Clique em Criar conjunto de dados.

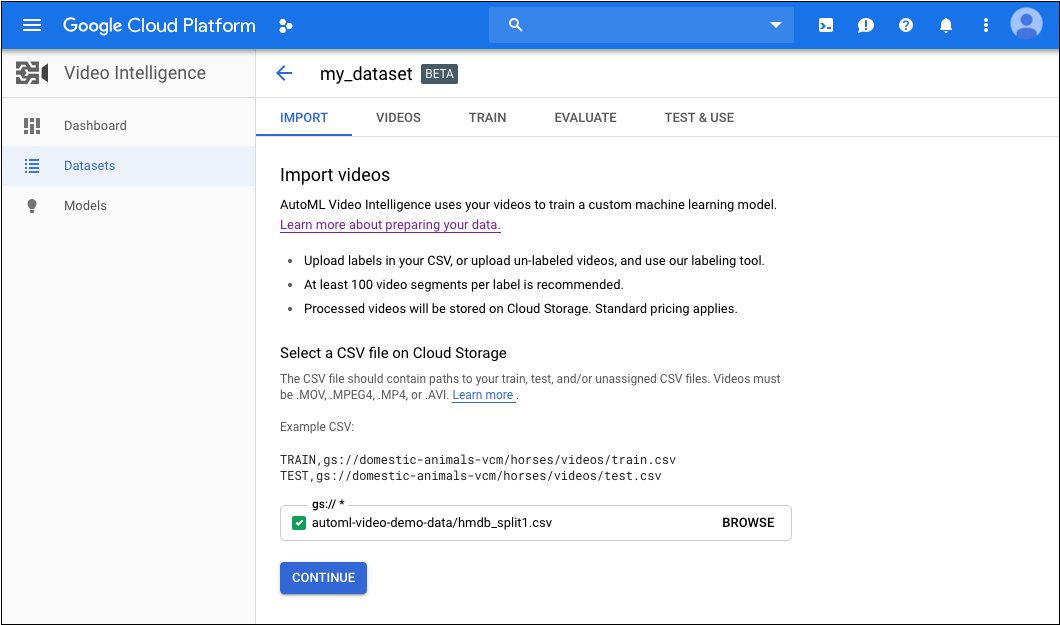

A seguinte tela será exibida:

- Digite as seguintes informações:

- Forneça o URI do Cloud Storage do arquivo CSV que contém os URIs dos dados de treinamento. Consulte Preparar dados.

Neste guia de início rápido, use:

automl-video-demo-data/hmdb_split1.csv

- Clique em Continuar para começar a importar seus dados.

A seguinte tela será exibida:

- Forneça o URI do Cloud Storage do arquivo CSV que contém os URIs dos dados de treinamento. Consulte Preparar dados.

O processo de importação pode demorar um pouco, dependendo do número e da duração dos vídeos que você forneceu.

REST

Antes de usar os dados da solicitação, faça as substituições a seguir:

- dataset-name: nome do conjunto de dados a ser exibido na interface

- Observação:

- project-number: o número do seu projeto

- location-id: a região do Cloud em que a anotação deve ocorrer. As regiões de nuvem compatíveis são:

us-east1,us-west1,europe-west1easia-east1. Se nenhuma região for especificada, uma região será determinada com base na localização do arquivo de vídeo.

Método HTTP e URL:

POST https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets

Corpo JSON da solicitação:

{

"displayName": "dataset-name",

"videoClassificationDatasetMetadata": {

}

}

Para enviar a solicitação, escolha uma destas opções:

curl

Salve o corpo da solicitação em um arquivo com o nome request.json e execute o comando a seguir:

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "x-goog-user-project: project-number" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

" https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets"

PowerShell

Salve o corpo da solicitação em um arquivo com o nome request.json e execute o comando a seguir:

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred"; "x-goog-user-project" = "project-number" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri " https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets" | Select-Object -Expand Content

name para sua operação. Veja a seguir um exemplo dessa resposta, em que project-number é o número do projeto e operation-id é o ID da operação de longa duração criada para a solicitação.

Java

Para se autenticar no AutoML Video, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Node.js

Para se autenticar no AutoML Video, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Python

Para se autenticar no AutoML Video, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Importar itens para um conjunto de dados

Depois de criar um conjunto de dados, será possível importar dados rotulados de arquivos CSV armazenados em um bucket do Cloud Storage. Para mais informações sobre como preparar os dados e criar arquivos CSV para importação, consulte Como preparar dados de treinamento.

Você pode importar itens para um conjunto de dados vazio ou importar itens adicionais para um conjunto de dados existente.

IU da Web

Os dados são importados quando você cria o conjunto de dados.REST

Antes de usar os dados da solicitação, faça as substituições a seguir:

- input-uri: um bucket do Cloud Storage que contém o arquivo que você quer anotar, incluindo o nome do arquivo. Precisa começar com gs://. Por exemplo:

"inputUris": ["gs://automl-video-demo-data/hmdb_split1.csv"] - dataset-id: substitua pelo identificador do conjunto de dados do seu conjunto de dados (e não pelo nome de exibição). Por exemplo:

VCN4798585402963263488 - Observação:

- project-number: o número do seu projeto

- location-id: a região do Cloud em que a anotação deve ocorrer. As regiões de nuvem compatíveis são:

us-east1,us-west1,europe-west1easia-east1. Se nenhuma região for especificada, uma região será determinada com base na localização do arquivo de vídeo.

Método HTTP e URL:

POST https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets/dataset-id:importData

Corpo JSON da solicitação:

{

"inputConfig": {

"gcsSource": {

"inputUris": input-uri

}

}

}

Para enviar a solicitação, escolha uma destas opções:

curl

Salve o corpo da solicitação em um arquivo com o nome request.json e execute o comando a seguir:

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "x-goog-user-project: project-number" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

" https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets/dataset-id:importData"

PowerShell

Salve o corpo da solicitação em um arquivo com o nome request.json e execute o comando a seguir:

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred"; "x-goog-user-project" = "project-number" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri " https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets/dataset-id:importData" | Select-Object -Expand Content

VCN7506374678919774208.

É possível usar o ID da operação para saber o status da tarefa. Veja um exemplo em Como saber o status de uma operação.

Java

Para se autenticar no AutoML Video, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Node.js

Para se autenticar no AutoML Video, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Python

Para se autenticar no AutoML Video, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Rotular itens de treinamento

Para ser útil ao treinamento de um modelo, cada item em um conjunto de dados precisa ter pelo menos um rótulo de categoria atribuído a ele. O AutoML Video ignora itens sem um rótulo de categoria. Há duas maneiras de você fornecer rótulos para seus itens de treinamento:

- Incluindo rótulos no seu arquivo .CSV

- Rotulando os itens na IU do AutoML Video

Para detalhes sobre como rotular itens no arquivo .CSV, consulte Como preparar seus dados de treinamento.

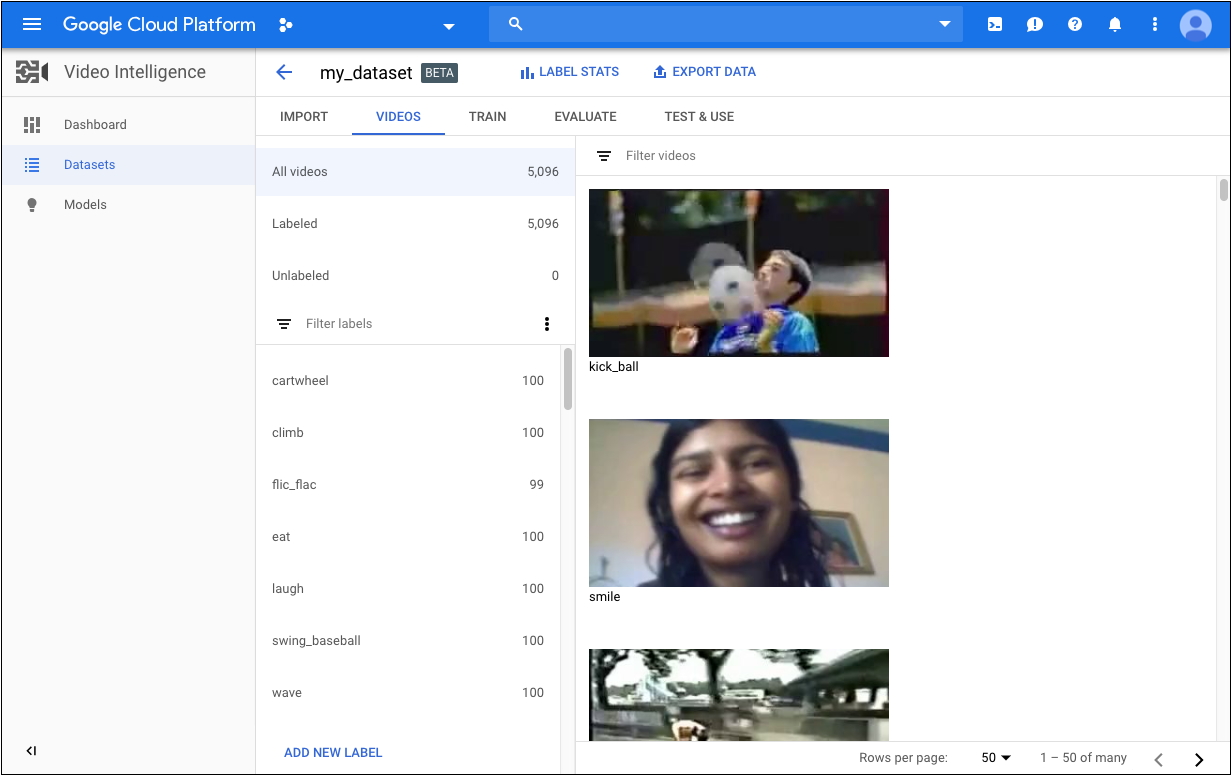

Para rotular itens na interface do usuário do AutoML Video, selecione o conjunto de dados na página de listagem do conjunto de dados para ver seus detalhes. O nome de exibição do conjunto de dados selecionado é exibido na barra de título, e a página relaciona os itens individuais no conjunto de dados com os respectivos rótulos. A barra de navegação à esquerda resume o número de itens rotulados e não rotulados. É possível filtrar a lista de itens por rótulo.

Para atribuir rótulos a vídeos sem rótulos ou alterar rótulos de vídeo, faça o seguinte:

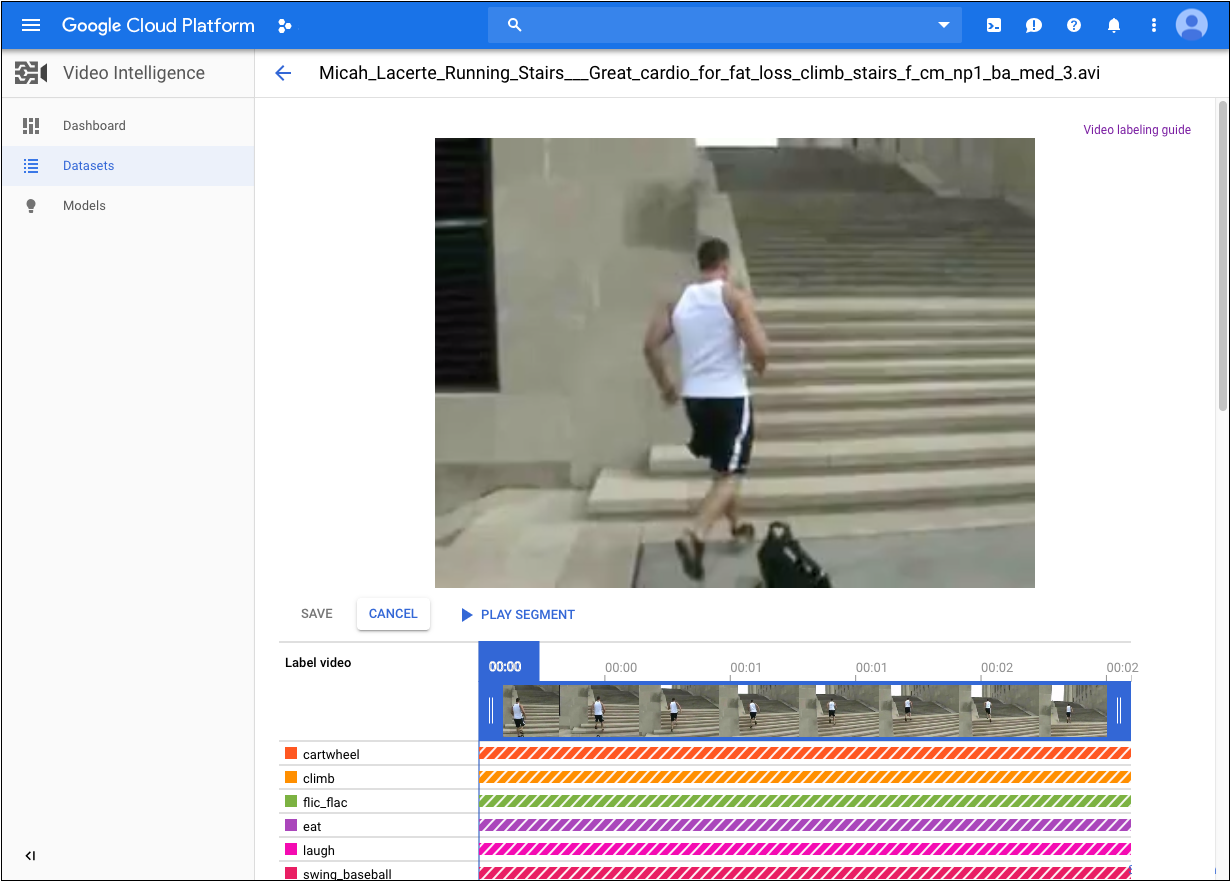

- Na página do conjunto de dados, clique no vídeo para adicionar ou alterar rótulos.

Na página do vídeo, faça o seguinte:

- Clique em Adicionar segmento.

- Arraste as setas nos dois lados da linha do tempo do vídeo para definir a região que você quer rotular. Por padrão, toda a duração do vídeo é selecionada.

- Na lista de rótulos, clique nos que você quer aplicar ao vídeo. A cor da barra do rótulo fica sólida após a seleção.

- Clique em Salvar.

Se você precisar adicionar um novo rótulo ao conjunto de dados, na página do conjunto de dados, acima da lista de rótulos atuais, clique nos três pontos ao lado de Filtrar rótulos e, em seguida, clique em Adicionar novo rótulo.

Como listar conjuntos de dados

Um projeto pode incluir vários conjuntos de dados. Esta seção descreve como recuperar uma lista dos conjuntos de dados disponíveis para um projeto.

IU da Web

Para ver uma lista dos conjuntos de dados disponíveis usando a interface do usuário do AutoML Video, navegue até a página Conjuntos de dados.

Para ver os conjuntos de dados de outro projeto, selecione-o na lista suspensa na parte superior direita da barra de título.

REST

Antes de usar os dados da solicitação, faça as substituições a seguir:

- project-number: o número do seu projeto

- location-id: a região do Cloud em que a anotação deve ocorrer. As regiões de nuvem compatíveis são:

us-east1,us-west1,europe-west1easia-east1. Se nenhuma região for especificada, uma região será determinada com base no local do arquivo de vídeo.

Método HTTP e URL:

https://automl.googleapis.com/v1beta1/projects/project-number/locations/location-id/datasets

Para enviar a solicitação, expanda uma destas opções:

Você receberá uma resposta JSON semelhante a esta:

Java

Para se autenticar no AutoML Video, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Node.js

Para se autenticar no AutoML Video, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Python

Para se autenticar no AutoML Video, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Excluir um conjunto de dados

O código a seguir demonstra como excluir um conjunto de dados.

IU da Web

-

Navegue até a página Conjuntos de dados na IU do AutoML Video.

- Clique no menu de três pontos à extrema direita da linha que você quer excluir e selecione Excluir conjunto de dados.

- Clique em Confirmar na caixa de diálogo de confirmação.

REST

Antes de usar os dados da solicitação, faça as substituições a seguir:

- dataset-name: o nome completo do conjunto de dados com base na resposta recebida quando você o criou. Ele tem o formato

projects/project-number/locations/location-id/datasets/dataset-id - project-number: o número do seu projeto

- location-id: a região do Cloud em que a anotação deve ocorrer. As regiões de nuvem compatíveis são:

us-east1,us-west1,europe-west1easia-east1. Se nenhuma região for especificada, uma região será determinada com base no local do arquivo de vídeo. - dataset-id: o código fornecido quando você criou o conjunto de dados

Método HTTP e URL:

DELETE https://automl.googleapis.com/v1beta1/dataset-name

Para enviar a solicitação, expanda uma destas opções:

Você receberá uma resposta JSON semelhante a esta:

Java

Para se autenticar no AutoML Video, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Node.js

Para se autenticar no AutoML Video, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.

Python

Para se autenticar no AutoML Video, configure o Application Default Credentials. Para mais informações, consulte Configurar a autenticação para um ambiente de desenvolvimento local.