Cette page explique comment exporter des bases de données Spanner avec la console Google Cloud.

Pour exporter une base de données Spanner à l'aide de l'API REST ou de l'outil de ligne de commande gcloud spanner, suivez les étapes décrites dans la section Avant de commencer de cette page, puis consultez les instructions détaillées de la section Spanner vers Cloud Storage Avro dans la documentation Dataflow.

Le processus d'exportation utilise Dataflow et écrit les données dans un dossier d'un bucket Cloud Storage. Le dossier résultant contient un ensemble de fichiers Avro et de fichiers manifestes JSON.

Avant de commencer

Pour exporter une base de données Spanner, vous devez d'abord activer les API Spanner, Cloud Storage, Compute Engine et Dataflow :

Vous devez également disposer d'un quota suffisant, ainsi que des autorisations IAM requises.

Exigences en matière de quota

Les exigences de quota pour les jobs d'exportation sont les suivantes:

- Spanner: aucune capacité de calcul supplémentaire n'est requise pour exporter une base de données, mais il peut être nécessaire d'en augmenter la capacité pour que votre tâche se termine dans un délai raisonnable. Pour en savoir plus, consultez la section Optimiser les missions.

- Cloud Storage : pour effectuer des exportations, vous devez créer un bucket pour vos fichiers exportés, si ce n'est pas déjà fait. Vous pouvez le faire dans la console Google Cloud, sur la page Cloud Storage ou lors de la création de votre exportation sur la page Spanner. Il n'est pas nécessaire de spécifier une taille pour ce bucket.

- Dataflow : les tâches d'exportation sont soumises aux mêmes exigences que les autres tâches Dataflow en ce qui concerne les quotas Compute Engine, aussi bien pour l'utilisation de processeurs et d'espace disque que pour le nombre d'adresses IP.

Compute Engine : avant d'exécuter une tâche d'exportation, vous devez définir les quotas initiaux Compute Engine utilisés par Dataflow. Ces quotas représentent le nombre maximal de ressources que vous permettez à Dataflow d'utiliser pour votre tâche. Les valeurs de départ recommandées sont les suivantes :

- Processeurs : 200

- Adresses IP en cours d'utilisation : 200

- Disque persistant standard : 50 To

En règle générale, vous n'avez aucun autre ajustement à effectuer. Dataflow gère l'autoscaling de sorte que vous n'ayez à payer que pour les ressources effectivement utilisées lors de l'exportation. S'il apparaît que votre tâche pourrait utiliser davantage de ressources, l'interface utilisateur de Dataflow affiche une icône d'avertissement, mais cela n'empêche normalement pas la tâche d'aboutir.

Exigences IAM

Pour exporter une base de données, vous devez également disposer de rôles IAM accordant des autorisations suffisantes pour utiliser tous les services impliqués dans une tâche d'exportation. Pour en savoir plus sur l'attribution de rôles et l'attribution d'autorisations, consultez la page Attribuer des rôles IAM.

Pour exporter une base de données, vous avez besoin des rôles suivants :

- Au niveau du projet Google Cloud :

- Lecteur Spanner (

roles/spanner.viewer) - Administrateur Dataflow (

roles/dataflow.admin) - Administrateur de l'espace de stockage (

roles/storage.admin)

- Lecteur Spanner (

- Au niveau de la base de données ou de l'instance Spanner, ou au niveau du projet Google Cloud :

- Lecteur de base de données Spanner (

roles/spanner.databaseReader) - Administrateur de bases de données Spanner (

roles/spanner.databaseAdmin)

- Lecteur de base de données Spanner (

Pour utiliser les ressources de calcul indépendantes de Spanner Data Boost lors d'une exportation, vous devez également disposer de l'autorisation IAM spanner.databases.useDataBoost. Pour en savoir plus, consultez la présentation de Data Boost.

Exporter une base de données

Une fois que vous avez satisfait aux exigences de quota et IAM décrites précédemment, vous pouvez exporter une base de données Spanner existante.

Pour exporter votre base de données Spanner vers un bucket Cloud Storage, procédez comme suit.

Accédez à la page Instances de Spanner.

Cliquez sur le nom de l'instance contenant votre base de données.

Cliquez sur l'élément de menu Importer/Exporter dans le volet de gauche, puis sur le bouton Exporter.

Sous Sélectionner l'emplacement de stockage de votre exportation, cliquez sur Parcourir.

Si vous ne possédez pas déjà un bucket Cloud Storage pour votre exportation :

- Cliquez sur Nouveau bucket

.

. - Saisissez un nom pour ce bucket. Les noms de buckets doivent être uniques dans Cloud Storage.

- Sélectionnez une classe de stockage et un emplacement par défaut, puis cliquez sur Créer.

- Cliquez sur le bucket pour le sélectionner.

Si vous disposez déjà d'un bucket, sélectionnez-le dans la liste initiale ou cliquez sur Rechercher

pour filtrer la liste, puis cliquez sur votre bucket pour le sélectionner.

pour filtrer la liste, puis cliquez sur votre bucket pour le sélectionner.- Cliquez sur Nouveau bucket

Cliquez sur Sélectionner.

Sélectionnez la base de données à exporter dans le menu déroulant Sélectionner une base de données à exporter.

Facultatif: Pour exporter votre base de données à partir d'un moment précis, cochez la case et saisissez un code temporel.

Sélectionnez une région dans le menu déroulant Choisir une région pour la tâche d'exportation.

Facultatif: Pour chiffrer l'état du pipeline Dataflow à l'aide d'une clé de chiffrement gérée par le client, procédez comme suit:

- Cliquez sur Afficher les options de chiffrement.

- Sélectionnez Utiliser une clé de chiffrement gérée par le client (CMEK).

- Sélectionnez votre clé dans la liste déroulante.

Cette option n'affecte pas le chiffrement au niveau du bucket Cloud Storage de destination. Pour activer les CMEK pour votre bucket Cloud Storage, consultez la page Utiliser CMEK avec Cloud Storage.

Facultatif: Pour exporter à l'aide de Spanner Data Boost, cochez la case Utiliser Spanner Data Boost. Pour en savoir plus, consultez la présentation de Data Boost.

Cochez la case sous Confirmer les frais pour accepter la facturation de frais en plus de ceux facturés par votre instance Spanner existante.

Cliquez sur Exporter.

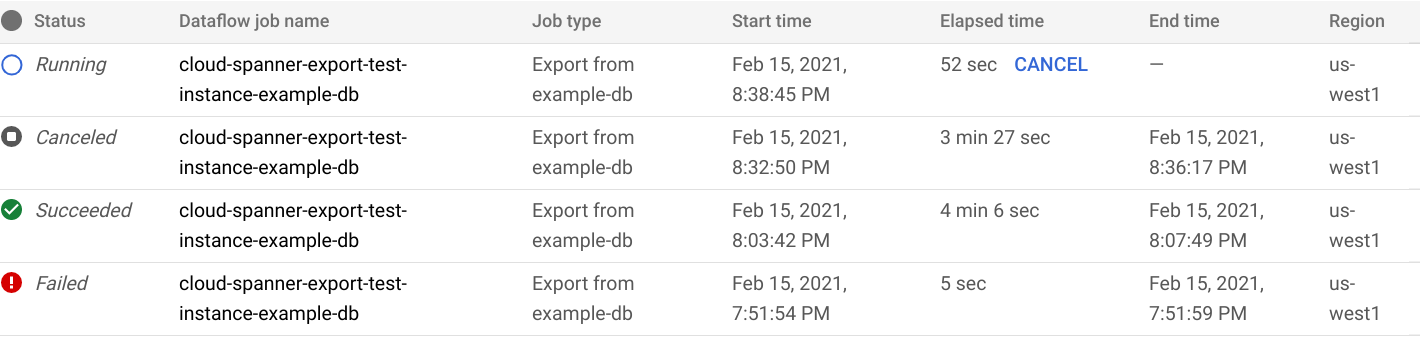

La console Google Cloud affiche la page Importation/Exportation de base de données, qui affiche à présent un élément de ligne correspondant à votre job d'exportation dans la liste des jobs d'importation/exportation, y compris le temps écoulé.

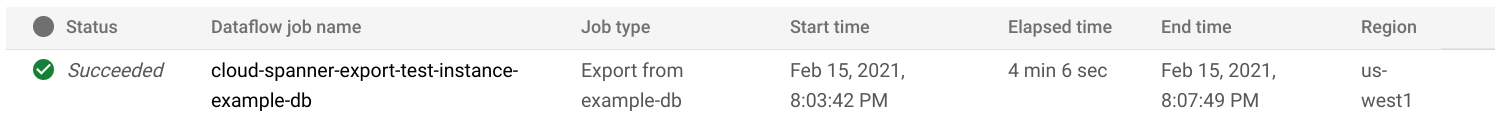

Lorsque la tâche se termine ou est interrompue, l'état est mis à jour dans la liste d'importation/exportation. Si la tâche a abouti, l'état Réussie s'affiche :

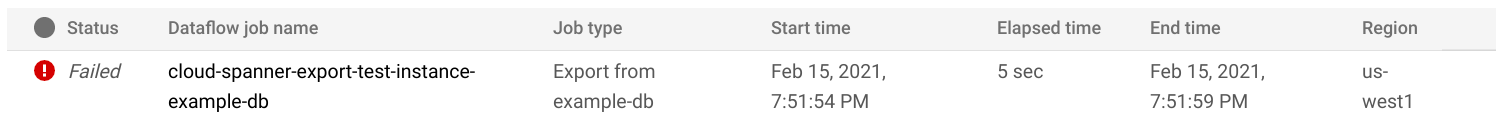

Si la tâche a échoué, l'état Failed s'affiche:

Pour afficher les détails de l'opération Dataflow correspondant à votre tâche, cliquez sur le nom de la tâche dans la colonne Nom de la tâche Dataflow.

En cas d'échec, consultez les journaux Dataflow de cette tâche pour connaître les détails de l'erreur.

Afin d'éviter une facturation Cloud Storage pour les fichiers créés par une tâche d'exportation ayant échoué, supprimez le dossier et ses fichiers. Pour savoir comment trouver le dossier, consultez la section Afficher votre exportation.

Remarque sur l'exportation des colonnes générées et des flux de modifications

Les valeurs d'une colonne générée stockée ne sont pas exportées. La définition de colonne est exportée vers le schéma Avro en tant que champ d'enregistrement de type null, la définition de colonne comme propriétés personnalisées du champ. Tant que l'opération de remplissage d'une colonne nouvellement ajoutée n'est pas terminée, celle-ci est ignorée comme si elle n'existait pas dans le schéma.

Les flux de modifications exportés en tant que fichiers Avro ne contiennent que le schéma des flux de modifications, et aucun enregistrement de modification de données.

Remarque sur l'exportation de séquences

Les séquences (GoogleSQL, PostgreSQL) sont des objets de schéma permettant de générer des valeurs entières uniques.

Spanner exporte chacun des objets de schéma vers le schéma Avro en tant que champ d'enregistrement, avec son genre de séquence, la plage ignorée et le compteur en tant que propriétés du champ. Notez que pour éviter qu'une séquence ne soit réinitialisée et génère des valeurs en double après l'importation, lors de l'exportation du schéma, la fonction GET_INTERNAL_SEQUENCE_STATE() (GoogleSQL, PostgreSQL) capture le compteur de séquence. Spanner ajoute un tampon de 1 000 au compteur et écrit la nouvelle valeur du compteur dans le champ d'enregistrement. Cette approche évite les erreurs de valeur en double qui pourraient se produire après l'importation.

S'il y a davantage d'écritures dans la base de données source lors de l'exportation des données, vous devez ajuster le compteur de séquence réel à l'aide de l'instruction ALTER SEQUENCE (GoogleSQL, PostgreSQL).

Lors de l'importation, la séquence commence à partir de ce nouveau compteur au lieu du compteur trouvé dans le schéma. Vous pouvez également utiliser l'instruction ALTER SEQUENCE (GoogleSQL, PostgreSQL) pour mettre à jour la séquence avec un nouveau compteur.

Afficher votre exportation dans Cloud Storage

Pour afficher le dossier contenant votre base de données exportée dans la console Google Cloud, accédez au navigateur Cloud Storage et choisissez le bucket que vous avez précédemment sélectionné:

Accéder au navigateur Cloud Storage

Le bucket contient maintenant un dossier dans lequel se trouve la base de données exportée. Le nom du dossier commence par l'ID de votre instance, le nom de la base de données et l'horodatage de la tâche d'exportation. Le dossier contient :

- Un fichier

spanner-export.json. - Un fichier

TableName-manifest.jsonpour chaque table de la base de données que vous avez exportée. Un ou plusieurs fichiers

TableName.avro-#####-of-#####. Le premier nombre figurant dans l'extension.avro-#####-of-#####représente l'index du fichier Avro compté à partir de zéro, tandis que le second correspond au nombre de fichiers Avro générés pour chaque table.Par exemple,

Songs.avro-00001-of-00002est le deuxième des deux fichiers contenant les données de la tableSongs.Un fichier

ChangeStreamName-manifest.jsonpour chaque flux de modifications de la base de données que vous avez exportée.Un fichier

ChangeStreamName.avro-00000-of-00001pour chaque flux de modifications. Ce fichier contient des données vides avec uniquement le schéma Avro du flux de modifications.

Choisir une région pour votre job d'importation

Vous pouvez choisir une région différente en fonction de l'emplacement de votre bucket Cloud Storage. Pour éviter les frais de transfert de données sortant, choisissez une région correspondant à l'emplacement de votre bucket Cloud Storage.

Si l'emplacement de votre bucket Cloud Storage est une région, vous pouvez bénéficier de l'utilisation gratuite du réseau en choisissant la même région pour votre job d'importation, en supposant que cette région est disponible.

Si l'emplacement de votre bucket Cloud Storage est birégional, vous pouvez bénéficier de l'utilisation gratuite du réseau en choisissant l'une des deux régions qui composent la birégionale pour votre tâche d'importation, en supposant que l'une des régions soit disponible.

Si aucune région colocalisée n'est disponible pour votre job d'importation ou si l'emplacement de votre bucket Cloud Storage est multirégional, des frais de transfert de données sortant s'appliquent. Consultez les tarifs de transfert de données sur Cloud Storage pour choisir la région qui entraîne les frais de transfert de données les plus bas.

Exporter un sous-ensemble de tables

Si vous souhaitez exporter uniquement les données de certaines tables, et non l'ensemble de la base de données, vous pouvez spécifier ces tables lors de l'exportation. Dans ce cas, Spanner exporte l'intégralité du schéma de la base de données, y compris les données des tables que vous spécifiez. Toutes les autres tables sont présentes dans le fichier exporté, mais vides.

Vous pouvez spécifier un sous-ensemble de tables à exporter à l'aide de la page Dataflow de la console Google Cloud ou de la ligne de commande. (Cette action n'est pas disponible sur la page Spanner.)

Si vous exportez les données d'une table qui est l'enfant d'une autre table, vous devez également exporter les données de sa table parent. Si les parents ne sont pas exportés, le job d'exportation échoue.

Pour exporter un sous-ensemble de tables, commencez l'exportation à l'aide du modèle Spanner vers Cloud Storage Avro de Dataflow, puis spécifiez les tables à l'aide de la page Dataflow de la console Google Cloud ou de Google Cloud CLI, comme décrit ci-dessous:

Console Google Cloud

Si vous utilisez la page Dataflow de la console Google Cloud, le paramètre Noms des tables Cloud Spanner se trouve dans la section Paramètres facultatifs de la page Créer une tâche à partir d'un modèle. Vous pouvez spécifier plusieurs tableaux en les séparant par une virgule.

gcloud CLI

Si vous utilisez la Google Cloud CLI, utilisez l'argument tableNames pour spécifier la table. Exemple :

gcloud dataflow jobs run my-export-job \

--gcs-location='gs://dataflow-templates/latest/Cloud_Spanner_to_GCS_Avro' \

--region=us-central1 \

--parameters='instanceId=test-instance,databaseId=example-db,tableNames=table1,outputDir=gs://my-gcs-bucket' \

--max-workers=10

La spécification de plusieurs tables dans gcloud nécessite un échappement d'argument de type dictionnaire.

L'exemple suivant utilise "|" comme caractère d'échappement:

gcloud dataflow jobs run my-export-job \

--gcs-location='gs://dataflow-templates/latest/Cloud_Spanner_to_GCS_Avro' \

--region=us-central1 \

--parameters='^|^instanceId=test-instance|databaseId=example-db|tableNames=table1,table2|outputDir=gs://my-gcs-bucket' \

--max-workers=10

Le paramètre shouldExportRelatedTables est une option pratique pour exporter automatiquement toutes les tables parentes des tables souhaitées. Par exemple, dans cette hiérarchie de schémas avec les tables Singers, Albums et Songs, il nous suffit de spécifier Songs. L'option shouldExportRelatedTables exporte également Singers et Albums, car Songs est un descendant des deux.

gcloud dataflow jobs run my-export-job \

--gcs-location='gs://dataflow-templates/latest/Cloud_Spanner_to_GCS_Avro' \

--region=us-central1 \

--parameters='instanceId=test-instance,databaseId=example-db,tableNames=Songs,shouldExportRelatedTables=true,outputDir=gs://my-gcs-bucket' \

--max-workers=10

Afficher ou dépanner des jobs dans l'interface utilisateur de Dataflow

Après avoir démarré une tâche d'exportation, vous pouvez en afficher les détails et les journaux dans la section Dataflow de la console Google Cloud.

Afficher les détails du job Dataflow

Pour afficher les détails des tâches d'importation/exportation exécutées au cours de la dernière semaine, y compris les tâches en cours d'exécution :

- Accédez à la page Présentation de la base de données correspondant à la base de données.

- Cliquez sur l'élément de menu du volet Importations/Exportations à gauche. La page Importations/Exportations de la base de données affiche la liste des tâches récentes.

Sur la page Importations/Exportations de la base de données, cliquez sur le nom de la tâche dans la colonne Nom de la tâche Dataflow :

La console Google Cloud affiche les détails de la tâche Dataflow.

Pour afficher une tâche que vous avez exécutée il y a plus d'une semaine :

Accédez à la page des jobs Dataflow dans la console Google Cloud.

Recherchez votre tâche dans la liste, puis cliquez sur son nom.

La console Google Cloud affiche les détails de la tâche Dataflow.

Afficher les journaux Dataflow associés à votre job

Pour afficher les journaux d'une tâche Dataflow, accédez à la page des détails de la tâche comme décrit ci-dessus, puis cliquez sur Journaux à droite du nom de la tâche.

Si une tâche échoue, recherchez les erreurs dans les journaux. Si des erreurs ont été enregistrées, leur nombre s'affiche à côté du bouton Logs (Journaux) :

Pour afficher les erreurs relatives à une tâche :

Cliquez sur le nombre d'erreurs affiché à côté du bouton Logs (Journaux).

La console Google Cloud affiche les journaux de la tâche. Vous devrez éventuellement faire défiler l'affichage pour voir les erreurs.

Repérez les entrées signalées par l'icône d'erreur

.

.Cliquez sur une entrée de journal pour développer son contenu.

Pour en savoir plus sur le dépannage des tâches Dataflow, consultez la page Résoudre les problèmes liés à votre pipeline.

Résoudre les problèmes d'échec des jobs d'exportation

Si les erreurs suivantes s'affichent dans les journaux de vos tâches :

com.google.cloud.spanner.SpannerException: NOT_FOUND: Session not found --or-- com.google.cloud.spanner.SpannerException: DEADLINE_EXCEEDED: Deadline expired before operation could complete.

Vérifiez la latence de lecture de 99% dans l'onglet Surveillance de votre base de données Spanner dans la console Google Cloud. Si elle affiche des valeurs élevées (plusieurs secondes), cela signifie que l'instance est surchargée, ce qui entraîne l'expiration et l'échec de la lecture.

L'une des causes de la latence élevée est que le job Dataflow s'exécute en utilisant trop de nœuds de calcul, ce qui entraîne une charge trop importante sur l'instance Spanner.

Pour spécifier une limite du nombre de nœuds de calcul Dataflow, au lieu d'utiliser l'onglet Importation/Exportation de la page des détails de l'instance Spanner dans la console Google Cloud, vous devez démarrer l'exportation à l'aide du modèle Cloud Spanner vers Cloud Storage Avro pour Dataflow, puis spécifier le nombre maximal de nœuds de calcul comme décrit ci-dessous :Si vous utilisez la console Dataflow, le paramètre Nombre maximal de nœuds de calcul se trouve dans la section Paramètres facultatifs de la page Créer une tâche à partir d'un modèle.

Si vous utilisez gcloud, spécifiez l'argument

max-workers. Exemple :gcloud dataflow jobs run my-export-job \ --gcs-location='gs://dataflow-templates/latest/Cloud_Spanner_to_GCS_Avro' \ --region=us-central1 \ --parameters='instanceId=test-instance,databaseId=example-db,outputDir=gs://my-gcs-bucket' \ --max-workers=10

Optimiser les tâches d'exportation lentes

Si vous avez adopté les paramètres initiaux suggérés plus haut, vous n'avez en principe aucun autre réglage à effectuer. Voici toutefois quelques possibilités d'optimisation supplémentaires à envisager si l'exécution de votre tâche est lente :

Optimisez l'emplacement du job et des données: exécutez votre job Dataflow dans la même région que votre instance Spanner et votre bucket Cloud Storage.

Assurez-vous que les ressources Dataflow sont suffisantes: si les quotas Compute Engine pertinents limitent les ressources de votre tâche Dataflow, la page Dataflow correspondante dans la console Google Cloud affiche une icône d'avertissement

et des messages de journal:

et des messages de journal:

Dans ce cas, l'augmentation des quotas en termes de processeurs, d'adresses IP en cours d'utilisation et de disques persistants standards peut accélérer l'exécution de votre tâche, mais également augmenter les frais facturés pour Compute Engine.

Vérifiez l'utilisation du processeur Spanner: si vous constatez que l'utilisation du processeur pour l'instance est supérieure à 65%, vous pouvez augmenter la capacité de calcul de cette instance. La capacité permet d'ajouter des ressources Spanner, et la tâche devrait s'accélérer, mais des frais Spanner supplémentaires vous sont facturés.

Facteurs qui influent sur les performances des tâches d'exportation

Plusieurs facteurs influent sur le temps nécessaire pour mener à bien une tâche d'exportation.

Taille de la base de données Spanner: le traitement de davantage de données nécessite plus de temps et de ressources.

Schéma de la base de données Spanner, y compris:

- Le nombre de tables

- La taille des lignes

- Nombre d'index secondaires

- Le nombre de clés étrangères

- le nombre de flux de modifications ;

Emplacement des données: les données sont transférées de Spanner et de Cloud Storage à l'aide de Dataflow. Dans l'idéal, ces trois composants doivent se trouver dans la même région. Dans le cas contraire, le déplacement des données entre les régions ralentit l'exécution de la tâche.

Nombre de nœuds de calcul Dataflow : les nœuds de calcul Dataflow optimaux sont nécessaires pour de bonnes performances. En utilisant l'autoscaling, Dataflow choisit le nombre de nœuds de calcul pour la tâche en fonction de la quantité de travail à effectuer. Le nombre de nœuds de calcul sera toutefois limité par les quotas en matière de processeurs, d'adresses IP en cours d'utilisation et de disques persistants standards. L'interface utilisateur de Dataflow affiche une icône d'avertissement lorsque des limites de quota sont atteintes. Dans ce cas, la progression est ralentie, mais la tâche doit néanmoins aboutir.

Charge existante sur Spanner : une tâche d'exportation ajoute généralement une faible charge sur une instance Spanner. Si cette instance présentait déjà une charge importante, l'exécution de la tâche est ralentie.

Quantité de capacité de calcul Spanner: si l'utilisation du processeur pour l'instance est supérieure à 65%, l'exécution de la tâche est plus lente.