L-ragam adalah properti set data dan perluasan dari k-anonymity yang mengukur keragaman nilai sensitif untuk setiap kolom tempat nilai tersebut terjadi. Set data memiliki keberagaman l jika, untuk setiap set baris dengan ID kuasi yang identik, setidaknya ada l nilai berbeda untuk setiap atribut sensitif.

Anda dapat menghitung nilai l-beragam berdasarkan satu atau beberapa kolom, atau kolom, dari set data. Topik ini menunjukkan cara menghitung nilai keragaman l untuk set data menggunakan Perlindungan Data Sensitif. Untuk mengetahui informasi selengkapnya tentang l-beragam atau analisis risiko secara umum, lihat topik konsep analisis risiko sebelum melanjutkan.

Sebelum memulai

Sebelum melanjutkan, pastikan Anda telah melakukan hal berikut:

- Login ke Akun Google Anda.

- Di Konsol Google Cloud, pada halaman pemilih project, pilih atau buat project Google Cloud. Buka pemilih project

- Pastikan penagihan telah diaktifkan untuk project Google Cloud Anda. Pelajari cara mengonfirmasi bahwa penagihan diaktifkan untuk project Anda.

- Aktifkan Perlindungan Data Sensitif. Aktifkan Perlindungan Data Sensitif

- Pilih {i>dataset<i} BigQuery untuk dianalisis. Perlindungan Data Sensitif menghitung metrik keragaman l dengan memindai tabel BigQuery.

- Tentukan ID kolom sensitif (jika ada) dan setidaknya satu quasi-ID dalam set data. Untuk informasi selengkapnya, lihat Istilah dan teknik analisis risiko.

Menghitung l-ragam

Perlindungan Data Sensitif melakukan analisis risiko setiap kali tugas analisis risiko dijalankan. Anda harus membuat tugas terlebih dahulu, baik dengan menggunakan Konsol Google Cloud, mengirim permintaan DLP API, atau menggunakan library klien Perlindungan Data Sensitif.

Konsol

Di konsol Google Cloud, buka halaman Create risk analysis.

Di bagian Choose input data, tentukan tabel BigQuery yang akan dipindai dengan memasukkan project ID dari project yang berisi tabel tersebut, ID set data tabel, dan nama tabel.

Di bagian Metrik privasi untuk dihitung, pilih l-diversity.

Di bagian ID Lowongan, Anda dapat secara opsional memberikan ID kustom ke tugas tersebut dan memilih lokasi resource yang menjadi tempat Perlindungan Data Sensitif akan memproses data Anda. Setelah selesai, klik Lanjutkan.

Di bagian Tentukan kolom, tentukan kolom sensitif dan quasi-ID untuk tugas risiko -beragam l. Perlindungan Data Sensitif mengakses metadata dari tabel BigQuery yang Anda tentukan di langkah sebelumnya dan mencoba mengisi daftar kolom.

- Pilih kotak centang yang sesuai untuk menentukan kolom sebagai kolom sensitif (S) atau ID semu (QI). Anda harus memilih 1 kolom sensitif dan minimal 1 quasi-ID.

- Jika Perlindungan Data Sensitif tidak dapat mengisi kolom, klik Masukkan nama kolom untuk memasukkan satu atau beberapa kolom secara manual dan menetapkan setiap kolom sebagai ID kuasi atau kolom sensitif. Setelah selesai, klik Lanjutkan.

Di bagian Tambahkan tindakan, Anda dapat menambahkan tindakan opsional untuk dilakukan saat tugas risiko selesai. Opsi yang tersedia adalah:

- Save to BigQuery: Menyimpan hasil pemindaian analisis risiko ke tabel BigQuery.

Publikasikan ke Pub/Sub: Memublikasikan notifikasi ke topik Pub/Sub.

Beri tahu melalui email: Mengirimkan email yang berisi hasil kepada Anda. Setelah selesai, klik Buat.

Tugas analisis risiko l-beragam akan segera dimulai.

C#

Untuk mempelajari cara menginstal dan menggunakan library klien untuk Perlindungan Data Sensitif, lihat Library klien Perlindungan Data Sensitif.

Untuk mengautentikasi Perlindungan Data Sensitif, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, baca Menyiapkan autentikasi untuk lingkungan pengembangan lokal.

Go

Untuk mempelajari cara menginstal dan menggunakan library klien untuk Perlindungan Data Sensitif, lihat Library klien Perlindungan Data Sensitif.

Untuk mengautentikasi Perlindungan Data Sensitif, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, baca Menyiapkan autentikasi untuk lingkungan pengembangan lokal.

Java

Untuk mempelajari cara menginstal dan menggunakan library klien untuk Perlindungan Data Sensitif, lihat Library klien Perlindungan Data Sensitif.

Untuk mengautentikasi Perlindungan Data Sensitif, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, baca Menyiapkan autentikasi untuk lingkungan pengembangan lokal.

Node.js

Untuk mempelajari cara menginstal dan menggunakan library klien untuk Perlindungan Data Sensitif, lihat Library klien Perlindungan Data Sensitif.

Untuk mengautentikasi Perlindungan Data Sensitif, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, baca Menyiapkan autentikasi untuk lingkungan pengembangan lokal.

PHP

Untuk mempelajari cara menginstal dan menggunakan library klien untuk Perlindungan Data Sensitif, lihat Library klien Perlindungan Data Sensitif.

Untuk mengautentikasi Perlindungan Data Sensitif, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, baca Menyiapkan autentikasi untuk lingkungan pengembangan lokal.

Python

Untuk mempelajari cara menginstal dan menggunakan library klien untuk Perlindungan Data Sensitif, lihat Library klien Perlindungan Data Sensitif.

Untuk mengautentikasi Perlindungan Data Sensitif, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, baca Menyiapkan autentikasi untuk lingkungan pengembangan lokal.

REST

Untuk menjalankan tugas analisis risiko baru guna menghitung l-beragam, kirim permintaan ke resource projects.dlpJobs, dengan PROJECT_ID menunjukkan ID project Anda:

https://dlp.googleapis.com/v2/projects/PROJECT_ID/dlpJobs

Permintaan berisi objek RiskAnalysisJobConfig, yang terdiri dari hal berikut:

Objek

PrivacyMetric. Di sini, Anda menentukan bahwa Anda menghitung l-beragam dengan menyertakan objekLDiversityConfig.Objek

BigQueryTable. Tentukan tabel BigQuery yang akan dipindai dengan menyertakan semua hal berikut:projectId: ID project dari project yang berisi tabel.datasetId: ID set data dari tabel.tableId: Nama tabel.

Kumpulan satu atau beberapa objek

Action, yang mewakili tindakan yang akan dijalankan, dalam urutan yang ditentukan pada penyelesaian tugas. Setiap objekActiondapat berisi salah satu tindakan berikut:- Objek

SaveFindings: Menyimpan hasil pemindaian analisis risiko ke tabel BigQuery. Objek

PublishToPubSub: Memublikasikan notifikasi ke topik Pub/Sub.Objek

JobNotificationEmails: Mengirimkan email yang berisi hasil kepada Anda.

Dalam objek

LDiversityConfig, Anda menetapkan hal berikut:quasiIds[]: Kumpulan ID kuasi (objekFieldId) yang menunjukkan cara class ekuivalensi ditentukan untuk komputasi keberagaman l. Seperti halnyaKAnonymityConfig, saat Anda menentukan beberapa kolom, kolom tersebut akan dianggap sebagai satu kunci gabungan.sensitiveAttribute: Kolom sensitif (objekFieldId) untuk menghitung nilai keberagaman l.

- Objek

Begitu Anda mengirim permintaan ke DLP API, tugas analisis risiko akan dimulai.

Membuat daftar tugas analisis risiko yang telah selesai

Anda dapat melihat daftar tugas analisis risiko yang telah dijalankan dalam project saat ini.

Konsol

Untuk menampilkan daftar tugas analisis risiko yang sedang berjalan dan sebelumnya di Konsol Google Cloud, lakukan hal berikut:

Di Konsol Google Cloud, buka Perlindungan Data Sensitif.

Klik tab Tugas & pemicu tugas di bagian atas halaman.

Klik tab Risk jobs.

Listingan pekerjaan berisiko akan muncul.

Protocol

Untuk menampilkan daftar tugas analisis risiko yang sedang berjalan dan yang sebelumnya dijalankan, kirim permintaan GET ke

resource

projects.dlpJobs. Menambahkan filter jenis tugas (?type=RISK_ANALYSIS_JOB) akan mempersempit

respons hanya ke tugas analisis risiko.

https://dlp.googleapis.com/v2/projects/PROJECT_ID/dlpJobs?type=RISK_ANALYSIS_JOB

Respons yang Anda terima berisi representasi JSON dari semua tugas analisis risiko saat ini dan sebelumnya.

Lihat hasil lowongan l-migration

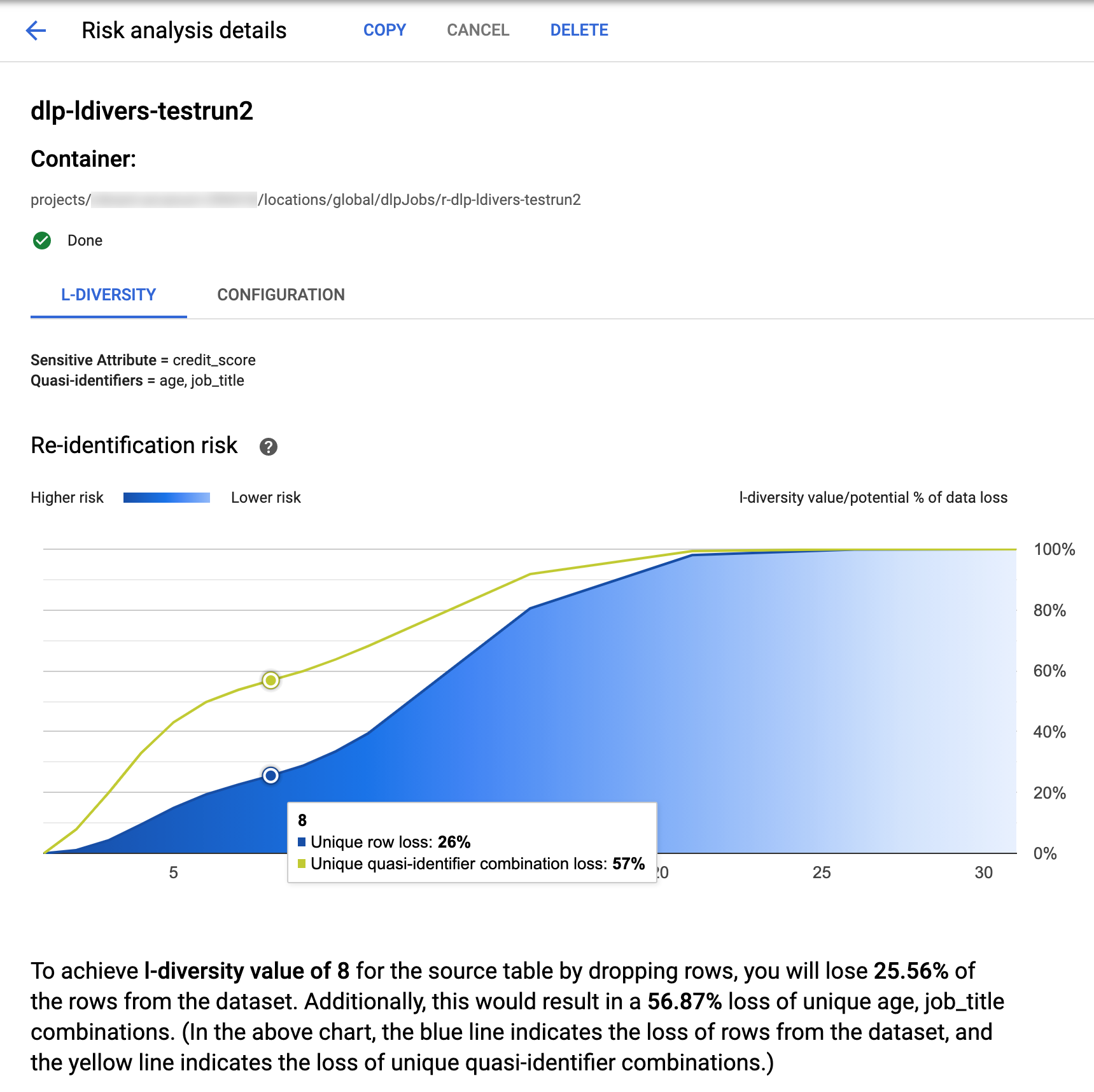

Perlindungan Data Sensitif di Konsol Google Cloud menampilkan visualisasi bawaan untuk tugas l-beragam yang sudah selesai. Setelah mengikuti petunjuk di bagian sebelumnya, dari listingan tugas analisis risiko, pilih tugas yang ingin Anda lihat hasilnya. Dengan asumsi tugas telah berhasil berjalan, bagian atas halaman Detail analisis risiko akan terlihat seperti ini:

Di bagian atas halaman terdapat informasi tentang tugas risiko l-beragam, termasuk ID tugasnya dan, di bagian Container, lokasi resource-nya.

Untuk melihat hasil penghitungan l-keragaman, klik tab Keberagaman L. Untuk melihat konfigurasi tugas analisis risiko, klik tab Configuration.

Tab L-ragam pertama-tama mencantumkan nilai sensitif dan ID semu yang digunakan untuk menghitung keragaman l.

Diagram risiko

Diagram Risiko identifikasi ulang memetakan, pada sumbu y, potensi persentase kehilangan data untuk baris unik dan kombinasi ID semu unik untuk mencapai nilai keberagaman l pada sumbu x. Warna diagram juga menunjukkan potensi risiko. Warna biru yang lebih gelap menunjukkan risiko yang lebih tinggi, sedangkan warna yang lebih terang menunjukkan risiko yang lebih kecil.

Nilai l-beragam yang lebih tinggi menunjukkan lebih sedikit keragaman nilai, yang dapat membuat set data kurang dapat diidentifikasi ulang dan lebih aman. Namun, untuk mencapai nilai l-beragam yang lebih tinggi, Anda harus menghapus persentase total baris yang lebih tinggi dan kombinasi kuasi-ID unik yang lebih tinggi, yang dapat mengurangi utilitas data. Untuk melihat potensi nilai kerugian persentase tertentu untuk nilai keragaman l tertentu, arahkan kursor ke diagram. Seperti yang ditunjukkan di screenshot, tooltip muncul pada diagram.

Untuk melihat detail selengkapnya tentang nilai keragaman l tertentu, klik titik data yang sesuai. Penjelasan mendetail ditampilkan di bawah diagram, dan contoh tabel data muncul di bagian bawah halaman.

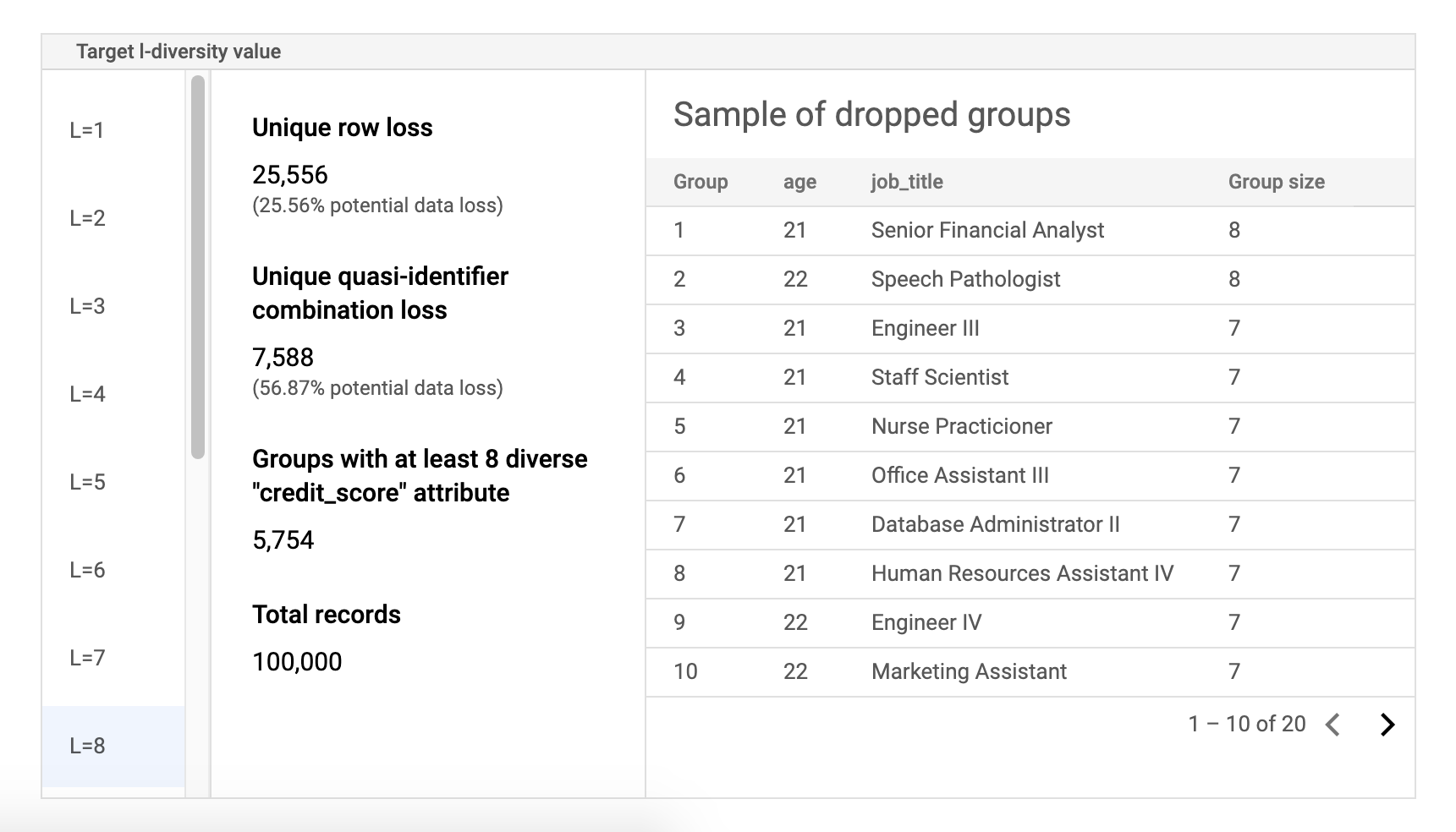

Tabel data sampel risiko

Komponen kedua dari halaman hasil tugas risiko adalah tabel data sampel. Halaman ini menampilkan kombinasi kuasi-ID untuk nilai keberagaman l target tertentu.

Kolom pertama dari tabel mencantumkan nilai k-anonymity. Klik nilai l-beragam untuk melihat data sampel terkait yang perlu dihapus untuk mencapai nilai tersebut.

Kolom kedua menampilkan masing-masing potensi kehilangan data dari baris unik dan kombinasi quasi-ID untuk mencapai nilai keragaman l yang dipilih, serta jumlah grup dengan atribut sensitif minimal l dan jumlah total catatan.

Kolom terakhir menampilkan sampel grup yang memiliki kombinasi ID semu, beserta jumlah catatan yang ada untuk kombinasi tersebut.

Mengambil detail tugas menggunakan REST

Untuk mengambil hasil tugas analisis risiko l-beragam menggunakan REST API, kirim permintaan GET berikut ke resource projects.dlpJobs. Ganti PROJECT_ID dengan project ID Anda dan JOB_ID dengan ID tugas yang ingin Anda dapatkan hasilnya.

ID tugas ditampilkan saat Anda memulai tugas, dan juga dapat diambil dengan

mencantumkan semua tugas.

GET https://dlp.googleapis.com/v2/projects/PROJECT_ID/dlpJobs/JOB_ID

Permintaan menampilkan objek JSON yang berisi instance tugas. Hasil

analisis ada di dalam kunci "riskDetails", dalam objek

AnalyzeDataSourceRiskDetails. Untuk mengetahui informasi selengkapnya, lihat referensi API untuk

resource

DlpJob.

Langkah selanjutnya

- Pelajari cara menghitung nilai k-anonymity untuk set data.

- Pelajari cara menghitung nilai k-map untuk set data.

- Pelajari cara menghitung nilai /*-presence untuk set data.